Zyphra 的 ZAYA1-8B 最值得注意的地方,不是它已經證明自己全面勝過所有前沿模型,而是它把問題問得更精準:在真正被啟用的參數很少時,模型還能做出多少推理、數學與程式碼能力?Zyphra 報告,這個 MoE 模型有 84 億總參數,但活躍參數為 7.6 億,並在推理、數學與程式碼任務上呈現強勁成績 [1][

6]。

換句話說,ZAYA1-8B 的意義更像一場效率測試,而不是單純的巨獸對決。

先看懂:總參數不等於活躍參數

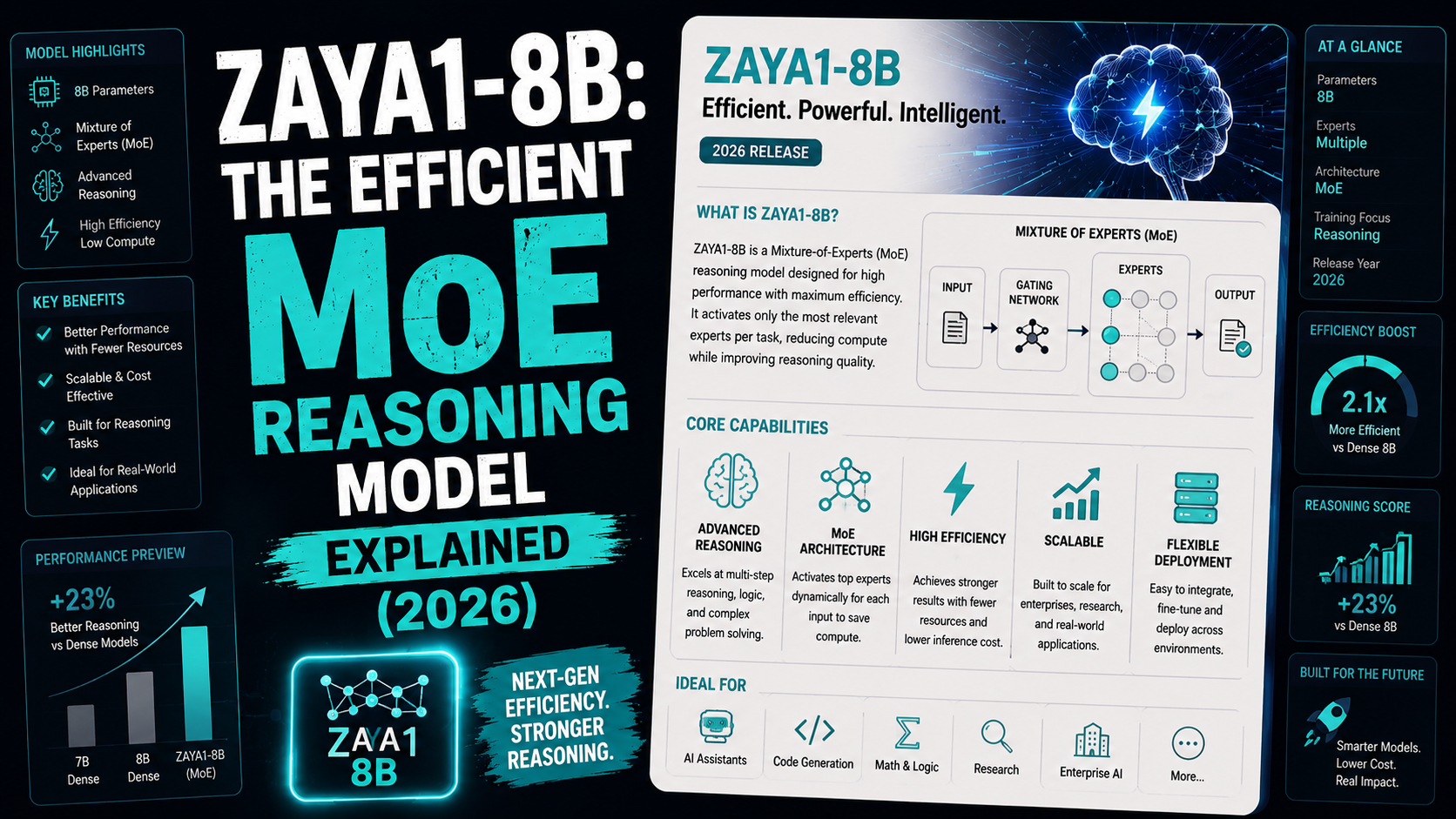

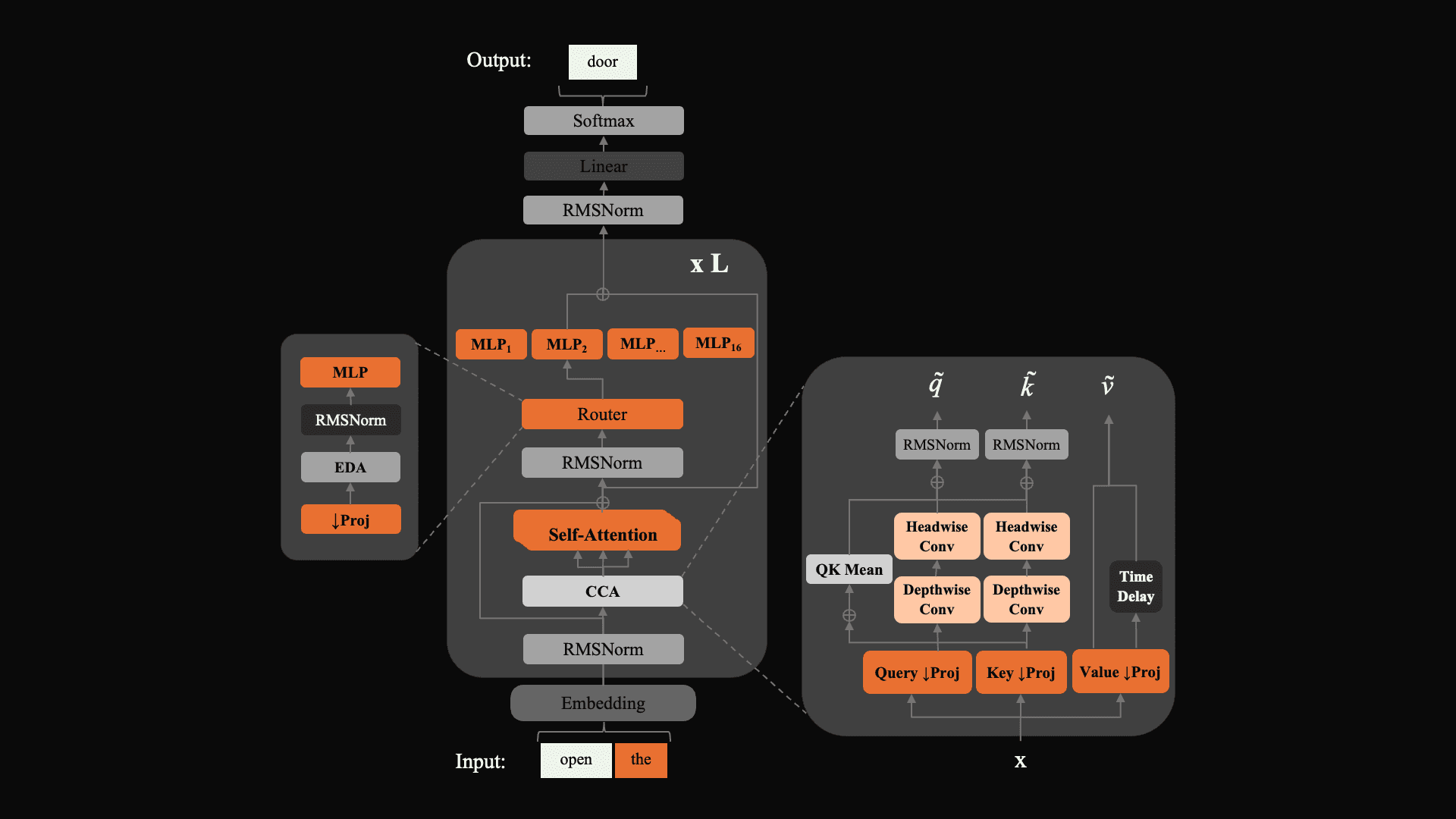

ZAYA1-8B 是 Zyphra 建立的小型混合專家語言模型,也就是 Mixture-of-Experts,簡稱 MoE。它在 Hugging Face 的模型卡列出 8.4B 總參數、760M 活躍參數,並稱模型由 Zyphra 端到端訓練完成 [6]。

這裡的「總參數」和「活躍參數」差別很重要。MoE 模型的標稱規模與實際活躍算力足跡並不相同;Zyphra 與其發布稿都把 ZAYA1-8B 描述為:總參數達 8.4B,但運作時活躍參數少於 10 億 [4][

6]。

Zyphra 將這款模型定位為參數規模下的「智慧效率」進展,並把成果歸因於架構、預訓練與後訓練選擇的組合 [6]。模型卡也說,ZAYA1-8B 特別擅長詳細的長篇推理,尤其是數學與程式碼任務 [

6]。

真正的比較:每個活躍參數有多少含金量

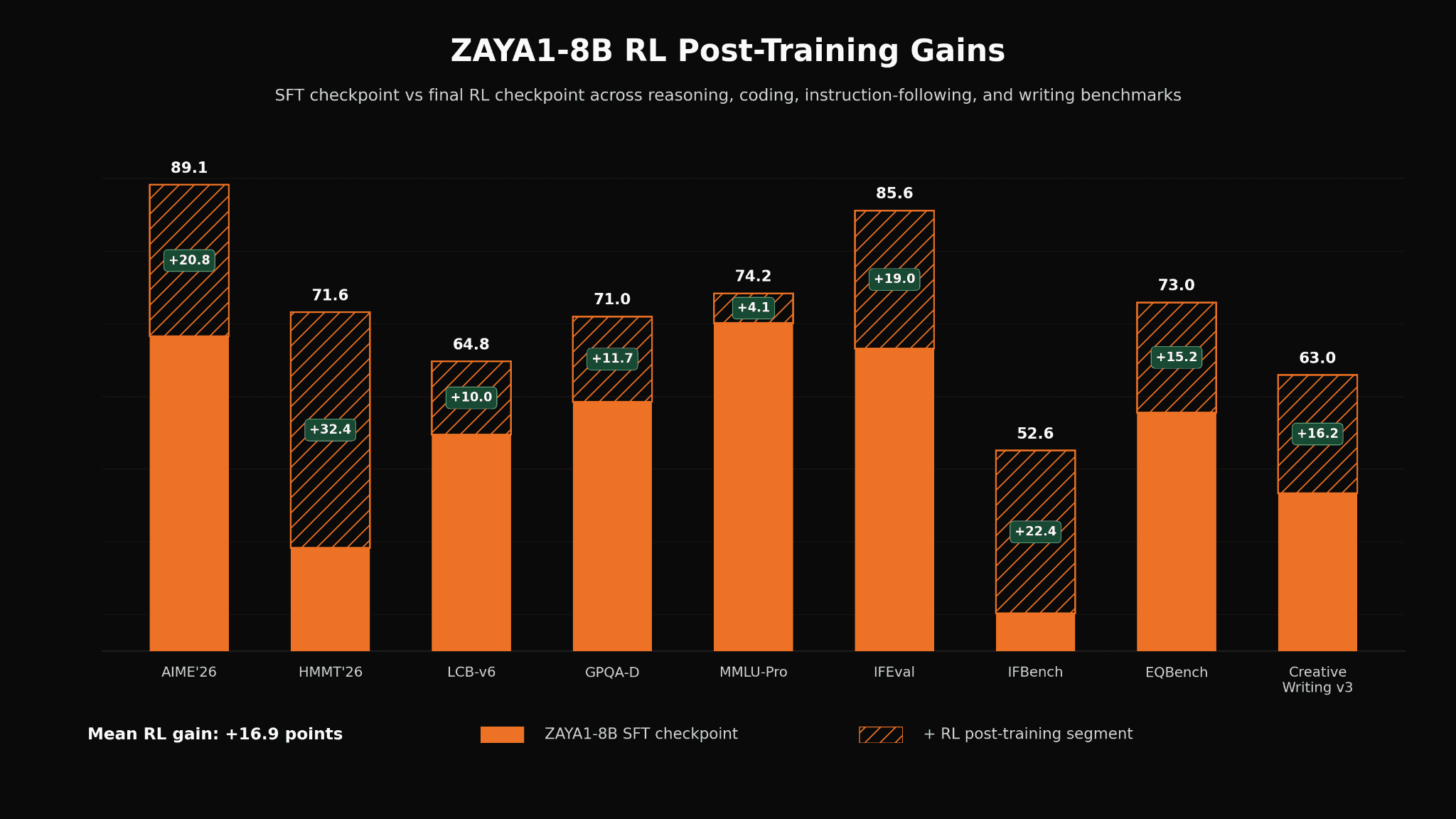

如果只問 ZAYA1-8B 是否贏過每一個大型前沿模型,問題反而問窄了。它最強的主張不是「絕對霸榜」,而是「智慧密度」:在活躍參數很少的情況下,能擠出多少有用的推理能力。

Zyphra 表示,ZAYA1-8B 在複雜推理、數學與程式碼任務上表現強勁,並在某些數學與程式碼基準測試上勝過大得多的開放權重模型 [1]。公司的發布稿也稱,這款模型在使用少於 10 億活躍參數的情況下,於複雜推理、數學與程式碼任務上匹配或超越大得多的開放權重模型 [

4]。

這就是它會被拿來和大型系統比較的原因。若相關結果能被更廣泛重現,ZAYA1-8B 代表的訊號是:接近前沿風格的推理能力,未必只靠總參數堆大。對需要大量推論或測試時計算流程的應用來說,活躍足跡更小可能很關鍵;Zyphra 的模型卡也特別提到,其推論效率與小尺寸使它可在 test-time compute harnesses 中有效運作 [6]。

AMD 訓練路線為何值得看

ZAYA1-8B 的另一個看點,是它怎麼被訓練出來。Zyphra 稱,ZAYA1-8B 是首個在 AMD Instinct MI300 堆疊上完成預訓練、中期訓練與監督式微調的 MoE 模型 [1]。公司發布稿也描述它是在全端 AMD 基礎設施上訓練而成 [

4]。

外部報導同樣強調,ZAYA1-8B 建立在 AMD 矽晶片路線上,而不是 Nvidia 硬體 [3]。這裡合理的結論不是「AMD 已經全面打敗 Nvidia」,而是更精確的一點:Zyphra 正在展示一個可被認真看待的高階 MoE 訓練案例,且它使用的是另一套加速器堆疊 [

1][

3][

4]。

開發者能實際檢查什麼

ZAYA1-8B 已列在 Hugging Face 上,開發者可以直接查看模型卡與發布細節 [6]。二手報導則稱,該模型在 Hugging Face 上以 Apache 2.0 授權提供,並可透過 Zyphra Cloud 的 serverless endpoint 使用 [

5]。

這點重要,因為效率主張只有在更多人能實際跑模型、做基準測試、放進工作流程裡比較時,才更容易被驗證。不過,有模型卡和可用端點,並不等於已經在各種真實工作負載中完成廣泛獨立驗證。

它還沒有證明什麼

目前最穩妥的看法,是把 ZAYA1-8B 視為一個有前景的效率成果,而不是前沿模型競賽的最終判決。現有許多說法來自 Zyphra 自己的研究文章、模型卡、發布稿,或二手媒體整理 [1][

4][

5][

6][

9]。

這些資料的重點集中在數學、程式碼與長篇推理;它們沒有證明 ZAYA1-8B 在所有任務上都更強 [1][

6]。VentureBeat 報導稱,ZAYA1-8B 在第三方基準測試上相對 GPT-5-High 與 DeepSeek-V3.2 具有競爭力;但那仍是基準測試比較,不等於它一定是更好的通用模型 [

9]。

更公平、也更有用的讀法是:ZAYA1-8B 似乎把相當高的推理能力,壓進了少於 10 億活躍參數的模型裡。這件事本身就值得關注,即使它還沒有解答所有大型前沿系統在正式產品環境中的比較問題。

結論:小模型不一定只是配角

ZAYA1-8B 重要,因為它把「效率」推到檯面中央。它以 8.4B 總參數、760M 活躍參數、Zyphra 報告的推理/數學/程式碼表現,以及端到端 AMD 訓練,挑戰了「有用的前沿式推理一定需要更大活躍參數預算」這個直覺 [1][

4][

6]。

但現在最安全的判斷仍然是:值得重視,也值得密切追蹤;只是尚未由廣泛獨立測試完全定論。若後續結果能被更多研究者與開發者重現,ZAYA1-8B 指向的可能是一場新的 AI 競賽:架構、訓練配方、後訓練與硬體多樣性,會和原始模型大小一樣重要 [1][

6]。