把 Claude 的「隱藏推理」想像成模型裡藏著一篇草稿,會有點誤導。Anthropic 的做法更像是在造一台研究儀器:一組機制可解釋性工具,被它形容為朝 AI「顯微鏡」前進,用來觀察模型如何把輸入文字轉成輸出文字的部分內部計算 [9][

10]。

先釐清:這不是讀心術

Claude 寫出的理由,本身也是生成文字。Anthropic 關心的是產生這些文字背後的運算:公司指出,模型每寫出一個字,都牽涉數十億次計算,而這些策略即使對開發者也並不透明 [10]。

因此,目標不是挖出一段私密的 chain-of-thought 逐字稿,而是把部分神經活動轉譯成研究者能命名、檢查、測試的結構 [9][

10]。

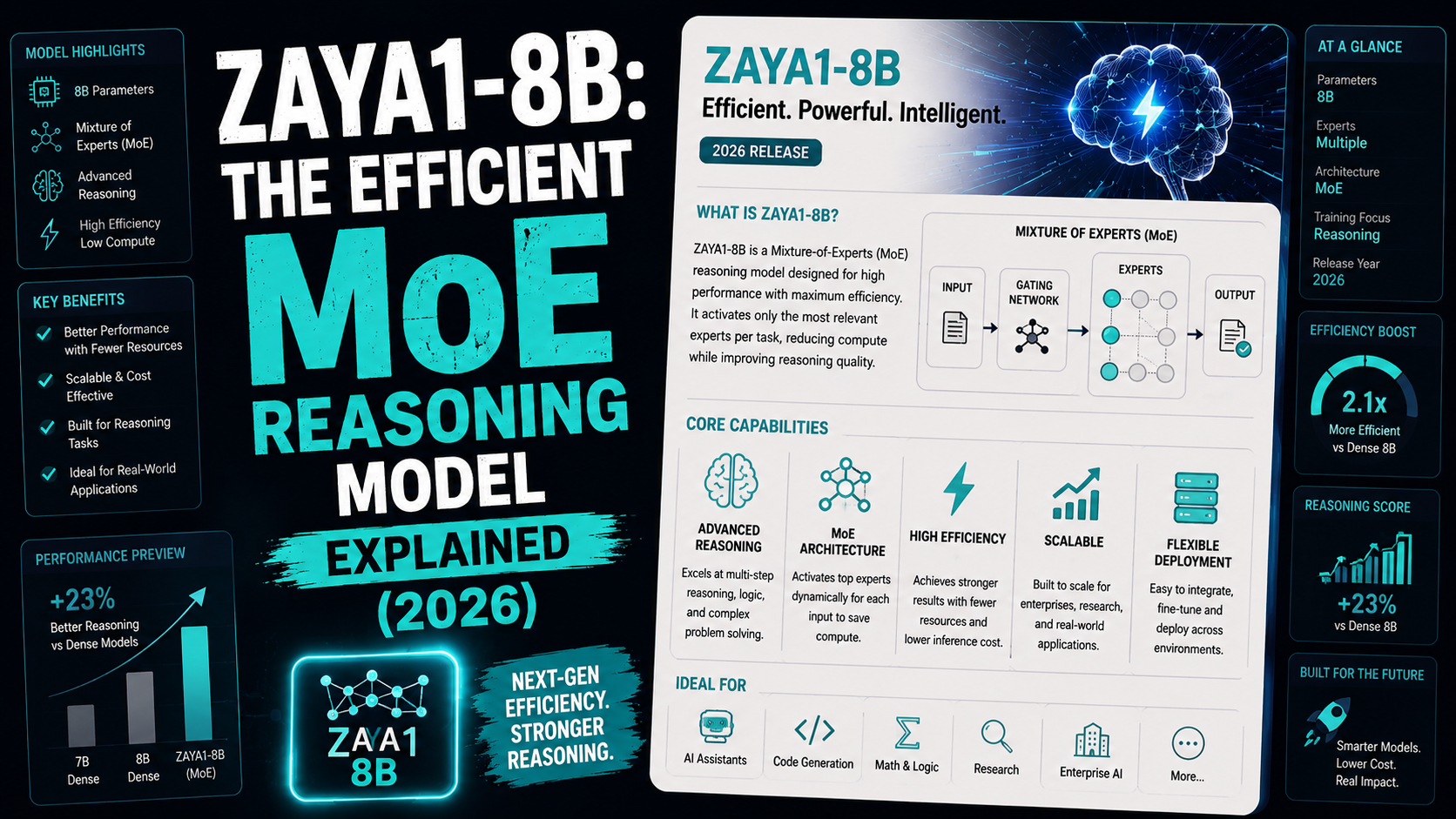

第一步:找出「特徵」

Anthropic 先前的可解釋性工作,會在模型內部尋找可解讀的概念,稱為 features(特徵)[9][

10]。用白話說,特徵就是模型活化值中的某種可辨識模式:它可能對應到一個概念或能力,讓研究者有一個可操作的把手,而不是只面對一大片難以理解的數字 [

9][

10]。

第二步:把特徵連成「電路」

更新的一步,是把這些特徵連成 computational circuits(計算電路)[9][

10]。Anthropic 表示,這能揭露 Claude 從輸入文字走向輸出文字時,部分內部路徑是如何形成的 [

9][

10]。

這點重要,是因為類似推理的行為通常不只是一個概念被標籤出來而已;它更可能牽涉一連串內部影響與計算步驟 [9]。

第三步:拿來觀察真實的 Claude 行為

在 2025 年的工作中,Anthropic 將這套工具用於 Claude 3.5 Haiku,研究一些簡單任務;這些任務代表十項重要的模型行為 [9][

10]。公司把這種方向稱為尋找「AI biology」:不是只從外部看最後答案對不對,而是試著找出能解釋模型行為的內部機制 [

9][

10]。

為什麼不能只問 Claude「你怎麼想」?

對使用者來說,最自然的方法可能是直接請 Claude 解釋。但模型的解釋仍然是輸出的一部分;Anthropic 的 circuit tracing,則是試著檢查產生答案的部分計算路徑 [9][

10]。

換句話說,這不是把表面文字說得更漂亮,而是讓研究者能更接近「提示如何被處理、哪些內部結構參與回覆」這類問題 [9][

10]。

現在看得到什麼?又看不到什麼?

這些工具可以讓 Claude 的部分內部運作變得更可讀:哪些特徵看起來相關、它們如何連成電路、哪些路徑似乎參與了某次回應 [9][

10]。

但 Anthropic 的說法仍相當謹慎。這些論文代表的是朝向「顯微鏡」的進展,能揭露部分路徑;它們還不是一個可以把 Claude 所有計算完整翻譯成人類語言的解碼器 [9][

10]。

重點一句話

Anthropic 正在做的,是把 Claude 的部分神經活動轉成可解釋的特徵,再追蹤這些特徵如何互動成電路,藉此研究具體模型行為 [9][

10]。這是一張局部的科學地圖,不是一份完整、可靠的「模型內心獨白」逐字稿 [

9][

10]。