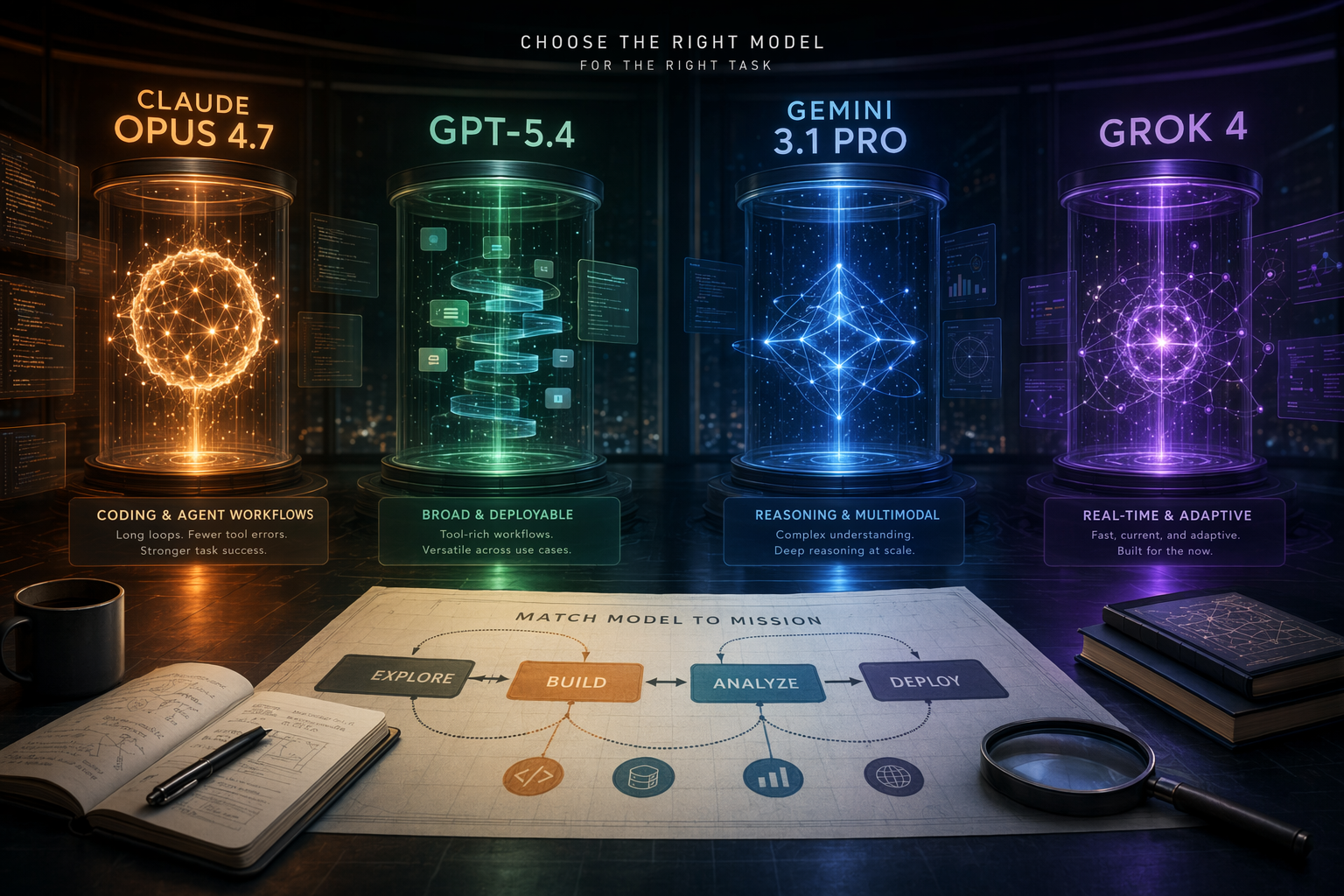

揀 Claude Opus 4.7、GPT-5.4、Gemini 3.1 Pro、Grok 4,最忌只望住一個排行榜。更實際嘅問法係:你個任務最怕模型喺邊一步跣低?第三方 LLM 選型指南嘅核心提醒係,無單一模型可以包打天下;coding、結構化推理、多模態、科學題同高難推理,各有各嘅強項。[5]

一眼睇:按任務揀 shortlist

| 你主要要做嘅事 | 先試邊個 | 目前證據 | 要留意 |

|---|---|---|---|

| 複雜 coding、改 repo、多步 agent workflow、穩定工具呼叫 | Claude Opus 4.7 | Anthropic 稱 Opus 4.7 比 Opus 4.6 在 Factory Droids 任務成功率高 10% 至 15%,工具錯誤較少、可靠性更高;Axios 亦形容它是 coding 與 vision 有升級嘅旗艦模型。[ | 這主要證明 Opus 4.7 較 Opus 4.6 有進步,不是四款模型同條件頭對頭結果。[ |

| 嚴格流程、表格規則、桌面操作、computer use | GPT-5.4 | 第三方指南稱 GPT-5.4 擅長 structured reasoning 與 computer use,並列出 OSWorld 75%。[ | 如果你有自家工具、內部系統或固定 SOP,仍要用自己流程測。 |

| 圖片、圖表、文件截圖、研究輔助、科學題 | Gemini 3.1 Pro | 第三方指南稱 Gemini 3.1 Pro 在 abstract reasoning、multimodal input 與 scientific benchmarks 上居前,並列出 GPQA 94.3%。[ | 多模態或科學 benchmark 強,不等於 coding agent 一定最穩。 |

| 高難推理題、難題 benchmark | Grok 4 | 第三方指南稱 Grok 4 在 HLE 指標領先,數值為 50.7%。[ | 單一高難推理分數,唔應該直接外推到一般企業工作流。 |

| 成本、供應商多元化、開源替代方案 | MiniMax、GLM、Kimi 等也可納入候選 | 同一指南稱 MiniMax M2.5/M2.7、GLM-5/5.1、Kimi K2.5 等新模型在 SWE-bench 類任務上已可挑戰前沿專有模型。[ | SWE-bench 接近,不代表 API 穩定性、多模態、寫作、安全或產品整合都接近。 |

Claude Opus 4.7:重點係 coding 同工具可靠性

Claude Opus 4.7 最值得留意嘅公開訊號,不是「已經全面打贏所有模型」,而是 Anthropic 對任務成功率同工具錯誤嘅講法。官方頁面稱,Opus 4.7 相比 Opus 4.6,在 Factory Droids 任務成功率提升 10% 至 15%,而且工具錯誤更少、表現更可靠。[11]

呢點對工程同 agent workflow 特別重要。長流程任務出事,往往唔係單一答案錯咁簡單,而係中途 call 錯工具、改錯檔、漏咗上下文、或者要人手不斷救火。Axios 對 Opus 4.7 嘅報道亦把它描述為 Anthropic 旗艦模型嘅有意義升級,重點包括 better coding 同 sharper vision。[12]

但要落槌話 Opus 4.7 全面勝過 GPT-5.4、Gemini 3.1 Pro 或 Grok 4,現有來源未夠。最穩陣嘅讀法係:Opus 4.7 較 Opus 4.6 有清晰升級;至於跨供應商同條件比較,仍要靠你自己實測。[11][

5]

GPT-5.4:流程型任務要同場比較

如果你嘅工作比較似嚴格規則執行、表格流程、工具編排、桌面操作或多步驟決策,GPT-5.4 應該放入第一輪。第三方 LLM 選型指南稱 GPT-5.4 在 structured reasoning 同 computer use 上突出,並列出 OSWorld 75%。[5]

換句話講,如果你最怕嘅錯誤係步驟亂咗、流程跳咗、工具操作唔穩,GPT-5.4 值得同 Opus 4.7 一齊試。這不等於它在所有任務都贏,而是它嘅強項同呢類工作失敗模式較貼近。[5]

Gemini 3.1 Pro:多模態同科學題唔好用 coding 榜決定

如果你嘅輸入包括圖片、圖表、文件截圖,或者任務偏研究輔助、科學問答,Gemini 3.1 Pro 應該優先納入候選。第三方指南稱 Gemini 3.1 Pro 在 abstract reasoning、multimodal input 同 scientific benchmarks 上居前,並列出 GPQA 94.3%。[5]

重點係:唔好用單一 coding benchmark 去決定所有模型。真實工作如果有大量視覺資料或科學內容,Gemini 3.1 Pro 嘅強項可能比純 coding 分數更有參考價值。[5]

Grok 4:高難推理有亮點,但唔好過度外推

Grok 4 在高難推理 benchmark 上有值得睇嘅地方。第三方指南稱 Grok 4 在 HLE 指標領先,數值為 50.7%。[5]

不過,高難推理分數不等於一般商務流程、內容生成、coding agent 或工具使用能力全面勝出。另一篇模型排名文章亦提醒,benchmark 有用,但日常建構體驗往往受可靠性、UI 能力同成本影響。[6]

點解唔可以淨係睇排行榜?

第一,排行榜未必係同一日、同一條件嘅比賽。Failing Fast 的 AI coding model comparison 寫明,資料來源包括 SWE-bench(2026年2月)、Aider(2025年10月)同 Arena Code(2026年2月),時間點並不完全一致。[2] 這類表格可以幫你搵方向,但唔應該當成絕對名次。

第二,官方自我比較同第三方跨模型整理,是兩種唔同證據。Anthropic 對 Opus 4.7 嘅資料,最能支持的是它相對 Opus 4.6 有提升;第三方指南可以提供跨模型選型線索,但不是 OpenAI、Google、xAI、Anthropic 共同發布嘅官方頭對頭測試。[11][

5]

第三,產品落地時,benchmark 之外嘅因素好關鍵。模型排名文章明確指出,benchmark 有用,但日常建構體驗常被可靠性、UI 能力,以及成本是否容許你反覆試 prompt 所影響。[6]

上線前,建議咁樣試

做採購、上線或者團隊標準化時,唔好只問「邊個最強」。更穩陣係用同一組真實任務,試 3 至 5 個候選模型:

- 揀 5 至 10 個每日真係會跑嘅任務,例如修 bug、加功能、重構、讀長文件、分析截圖、產出規格、呼叫工具。

- 對所有模型用相同 prompt、相同背景資料、相同成功標準。

- 記錄一次通過率、返工次數、工具錯誤、幻覺、延遲、成本同人工修正時間。

- 唔只睇最佳答案,也要睇最差答案;模型上線後,失敗模式通常比 demo 更重要。

- 如果牽涉敏感資料、合規或私隱要求,另外檢查資料保留、部署方式同企業控制功能。

最後點揀?

如果你主要做 coding、agent workflow 同工具使用,Claude Opus 4.7 應該係第一輪候選,甚至可以先試。Anthropic 指它較 Opus 4.6 在 Factory Droids 任務成功率同工具錯誤上有明確改善;Axios 亦把 Opus 4.7 描述為 coding 與 vision 有升級嘅旗艦模型。[11][

12]

但如果你問「邊個係全能第一」,目前可引用證據未足夠。更貼近實務嘅結論係:無單一模型包辦所有場景;GPT-5.4、Gemini 3.1 Pro、Grok 4,以至 MiniMax、GLM、Kimi 等新興模型,都有各自值得測嘅位置。[5]

最穩陣嘅做法係:先按任務分 shortlist,再用你自己嘅真實工作流同場比較。揀模型唔係買榜首,而係揀一個在你最常做、最怕出錯嘅任務入面,最少需要人手救火嘅系統。