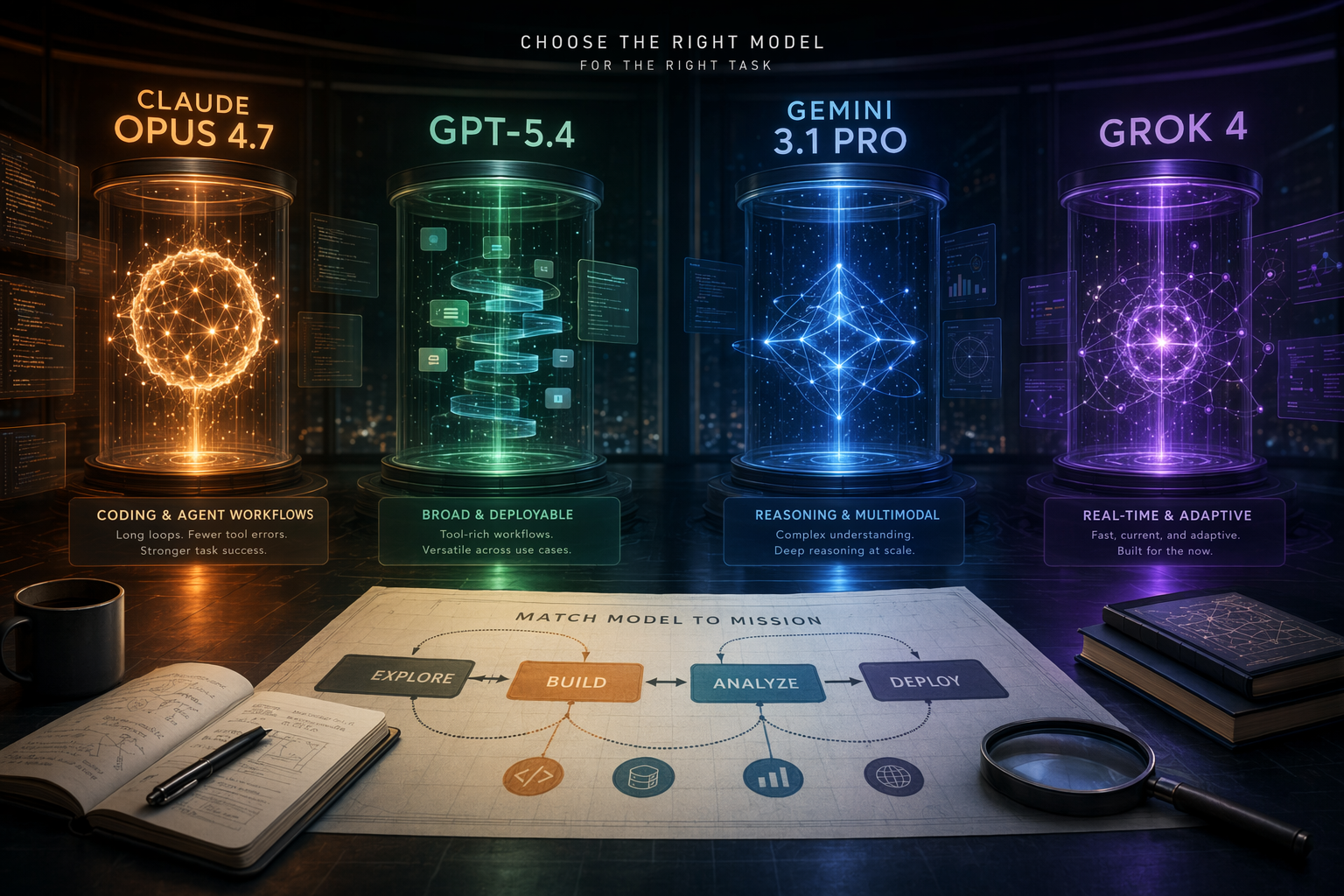

Khi đặt Claude Opus 4.7, GPT-5.4, Gemini 3.1 Pro và Grok 4 lên cùng một bàn cân, câu hỏi thực dụng nhất không phải là ai đứng số một tuyệt đối. Câu hỏi nên là: công việc của bạn dễ thất bại ở khâu nào nhất?

Một hướng dẫn chọn LLM của bên thứ ba đưa ra kết luận đáng chú ý: không có mô hình đơn lẻ nào thống trị mọi tác vụ. Mỗi mô hình có vùng mạnh riêng, từ coding, suy luận có cấu trúc, đa phương thức, bài toán khoa học cho đến các benchmark suy luận khó.[5]

Bảng chọn nhanh theo nhiệm vụ

| Nhu cầu chính của bạn | Nên thử trước | Bằng chứng hiện có | Điều cần dè chừng |

|---|---|---|---|

| Coding phức tạp, workflow dùng agent, cần gọi công cụ ổn định | Claude Opus 4.7 | Anthropic nói Opus 4.7 tăng 10% đến 15% tỷ lệ thành công trên Factory Droids so với Opus 4.6, đồng thời ít lỗi công cụ hơn và đáng tin cậy hơn; Axios cũng mô tả đây là bản nâng cấp flagship với coding tốt hơn và thị giác sắc hơn.[ | Bằng chứng này chủ yếu cho thấy Opus 4.7 cải thiện so với Opus 4.6, không phải kết luận đối đầu cùng điều kiện với cả bốn mô hình. |

| Quy trình chặt chẽ, suy luận có cấu trúc, computer use | GPT-5.4 | Hướng dẫn bên thứ ba nói GPT-5.4 mạnh ở structured reasoning và computer use, với OSWorld 75%.[ | Vẫn cần thử trên quy trình, công cụ và tiêu chuẩn lỗi của chính bạn. |

| Đầu vào đa phương thức, suy luận trừu tượng, câu hỏi khoa học hoặc hỗ trợ nghiên cứu | Gemini 3.1 Pro | Hướng dẫn bên thứ ba xếp Gemini 3.1 Pro nổi bật ở abstract reasoning, multimodal input và scientific benchmarks, với GPQA 94,3%.[ | Mạnh ở đa phương thức và khoa học không đồng nghĩa chắc chắn mạnh nhất ở coding agent hoặc chuỗi gọi công cụ dài. |

| Benchmark suy luận khó | Grok 4 | Hướng dẫn bên thứ ba nói Grok 4 dẫn ở chỉ số HLE, với 50,7%.[ | Một chỉ số suy luận khó không thể tự động suy ra mô hình thắng toàn diện trong workflow doanh nghiệp. |

| Tối ưu chi phí, đa dạng nhà cung cấp hoặc khảo sát lựa chọn mở | MiniMax, GLM, Kimi và các mô hình mới khác | Cùng hướng dẫn nói MiniMax M2.5/M2.7, GLM-5/5.1, Kimi K2.5 đã tiến gần các mô hình đóng tuyến đầu trên các tác vụ kiểu SWE-bench.[ | Gần nhau trên SWE-bench không có nghĩa API, đa phương thức, viết nội dung, an toàn hay tích hợp sản phẩm cũng ngang nhau. |

Claude Opus 4.7: đáng chú ý nhất ở coding và độ tin cậy khi gọi công cụ

Tín hiệu công khai quan trọng nhất của Claude Opus 4.7 là cách Anthropic nhấn mạnh vào tỷ lệ hoàn thành nhiệm vụ và lỗi công cụ. Trang chính thức cho biết Claude Opus 4.7 vượt Opus 4.6 với mức tăng 10% đến 15% về tỷ lệ thành công trong Factory Droids, đồng thời có ít lỗi công cụ hơn và hoạt động đáng tin cậy hơn.[11]

Điều này khiến Opus 4.7 rất đáng có mặt trong vòng đánh giá đầu tiên của các nhóm làm phần mềm hoặc xây dựng workflow dùng tác nhân AI. Với những tác vụ này, thất bại thường không chỉ là trả lời sai một câu. Nó có thể là gọi nhầm công cụ, xử lý ngữ cảnh kém, sửa sai tệp, đi lệch chuỗi bước, hoặc buộc con người phải can thiệp nhiều lần. Axios cũng mô tả Opus 4.7 là bản nâng cấp đáng kể cho mô hình flagship của Anthropic, với trọng tâm gồm coding tốt hơn và năng lực thị giác sắc hơn.[12]

Tuy vậy, cách đọc thận trọng nhất là: Opus 4.7 có nâng cấp rõ so với Opus 4.6. Nguồn hiện có trong bài chưa đủ để kết luận nó thắng toàn diện GPT-5.4, Gemini 3.1 Pro hay Grok 4 trong cùng điều kiện thử nghiệm.[11][

5]

GPT-5.4: nên đưa vào vòng thử nếu quy trình cần kỷ luật từng bước

Nếu công việc của bạn giống một quy trình có luật rõ ràng — xử lý bảng biểu, thao tác trên môi trường máy tính, điều phối công cụ, ra quyết định nhiều bước — GPT-5.4 nên được đưa vào nhóm ứng viên đầu tiên. Hướng dẫn chọn LLM của bên thứ ba nói GPT-5.4 nổi bật ở structured reasoning và computer use, đồng thời nêu chỉ số OSWorld 75%.[5]

Điều đó không có nghĩa GPT-5.4 thắng Opus 4.7 trong mọi trường hợp. Cách dùng hợp lý hơn là: nếu chi phí thất bại của bạn chủ yếu đến từ sai bước, sai điều khiển quy trình hoặc lỗi thao tác, hãy cho GPT-5.4 và Opus 4.7 chạy cùng một bộ bài kiểm tra thực tế.[5]

Gemini 3.1 Pro: ưu tiên khi dữ liệu không chỉ là văn bản

Nếu đầu vào của bạn có ảnh, biểu đồ, ảnh chụp màn hình tài liệu, bài toán khoa học hoặc câu hỏi nghiên cứu, Gemini 3.1 Pro nên nằm trong danh sách thử nghiệm sớm. Hướng dẫn bên thứ ba nói Gemini 3.1 Pro đứng nổi bật ở abstract reasoning, multimodal input và scientific benchmarks, với GPQA 94,3%.[5]

Điểm mấu chốt ở đây là dạng nhiệm vụ, không phải tên thương hiệu. Nếu workflow thật có nhiều đầu vào thị giác hoặc nội dung khoa học, việc chỉ nhìn vào benchmark coding có thể khiến bạn bỏ qua điểm mạnh chính của Gemini 3.1 Pro.[5]

Grok 4: có điểm sáng ở suy luận khó, nhưng đừng suy rộng quá nhanh

Grok 4 đáng chú ý ở một số chỉ số suy luận khó. Hướng dẫn bên thứ ba nói Grok 4 dẫn ở HLE, với mức 50,7%.[5]

Nhưng điểm HLE không nên được hiểu là chiến thắng toàn diện trong mọi bối cảnh: vận hành doanh nghiệp, chất lượng nội dung, coding agent hay gọi công cụ hằng ngày. Một bài viết xếp hạng mô hình khác cũng nhắc rằng benchmark hữu ích, nhưng trải nghiệm xây dựng sản phẩm thường bị chi phối bởi các yếu tố như độ tin cậy, năng lực UI và chi phí.[6]

Vì sao không nên chỉ nhìn bảng xếp hạng?

Thứ nhất, bảng xếp hạng thường trộn nhiều benchmark và thời điểm cập nhật khác nhau. Bảng so sánh mô hình AI cho coding của Failing Fast dùng dữ liệu từ SWE-bench, Aider và Arena Code; các nguồn này không cùng ngày, chẳng hạn SWE-bench là tháng 2/2026, Aider là tháng 10/2025 và Arena Code là tháng 2/2026.[2] Những bảng như vậy hữu ích để lấy cảm giác định hướng, nhưng không nên xem là xếp hạng tuyệt đối của mọi mô hình trong cùng một ngày, cùng một điều kiện.

Thứ hai, so sánh nội bộ của hãng và tổng hợp chéo mô hình của bên thứ ba là hai loại bằng chứng khác nhau. Dữ liệu của Anthropic về Opus 4.7 hỗ trợ tốt nhất cho kết luận rằng nó cải thiện so với Opus 4.6. Còn hướng dẫn bên thứ ba giúp gợi ý cách chọn mô hình theo tác vụ, nhưng đó không phải bài đánh giá đối đầu chính thức do OpenAI, Google, xAI và Anthropic cùng công bố.[11][

5]

Thứ ba, trải nghiệm thật trong sản phẩm chịu ảnh hưởng bởi nhiều thứ ngoài benchmark. Một bài viết xếp hạng mô hình nhấn mạnh rằng benchmark có ích, nhưng công việc xây dựng hằng ngày thường bị chi phối bởi độ tin cậy, năng lực UI và chi phí.[6]

Checklist thử nghiệm trước khi triển khai

Nếu bạn đang cân nhắc mua, đưa vào sản phẩm hoặc chuẩn hóa cho cả nhóm, đừng chỉ hỏi mô hình nào mạnh nhất. Cách chắc tay hơn là dùng cùng một bộ nhiệm vụ thật để thử 3 đến 5 mô hình ứng viên:

- Chọn 5 đến 10 nhiệm vụ chạy hằng ngày, ví dụ sửa bug, thêm tính năng, refactor, đọc tài liệu dài, phân tích ảnh chụp màn hình, viết đặc tả hoặc gọi công cụ.

- Dùng cùng prompt, cùng dữ liệu nền và cùng tiêu chuẩn hoàn thành cho mọi mô hình.

- Ghi lại tỷ lệ hoàn thành ngay lần đầu, số lần phải làm lại, lỗi gọi công cụ, ảo giác, độ trễ, chi phí và thời gian con người phải sửa.

- Đừng chỉ nhìn câu trả lời tốt nhất; hãy soi cả câu trả lời tệ nhất. Khi đưa vào vận hành, kiểu thất bại thường quan trọng hơn demo đẹp.

- Nếu tác vụ liên quan dữ liệu nhạy cảm, tuân thủ hoặc quyền riêng tư, hãy kiểm tra thêm chính sách lưu dữ liệu, cách triển khai và các tính năng kiểm soát dành cho doanh nghiệp.

Kết luận: chọn theo điểm gãy của công việc

Claude Opus 4.7 là ứng viên hàng đầu nên thử cho coding, agent workflow và các tác vụ cần gọi công cụ ổn định. Theo Anthropic, nó cải thiện rõ so với Opus 4.6 về tỷ lệ thành công trên Factory Droids và lỗi công cụ; Axios cũng mô tả Opus 4.7 là bản flagship được nâng cấp về coding và vision.[11][

12]

Nhưng nếu câu hỏi là mô hình nào vô địch mọi mặt, bằng chứng hiện có chưa đủ để chốt. Kết luận thực tế hơn từ hướng dẫn bên thứ ba là: không có một mô hình nào thống trị toàn bộ nhiệm vụ; GPT-5.4, Gemini 3.1 Pro, Grok 4 và các mô hình mới nổi đều có vùng mạnh riêng.[5]

Cách chọn an toàn nhất là xem Claude Opus 4.7 như ứng viên rất mạnh cho coding và agent, rồi đem nó thử cùng GPT-5.4, Gemini 3.1 Pro và Grok 4 trên chính workflow của bạn.