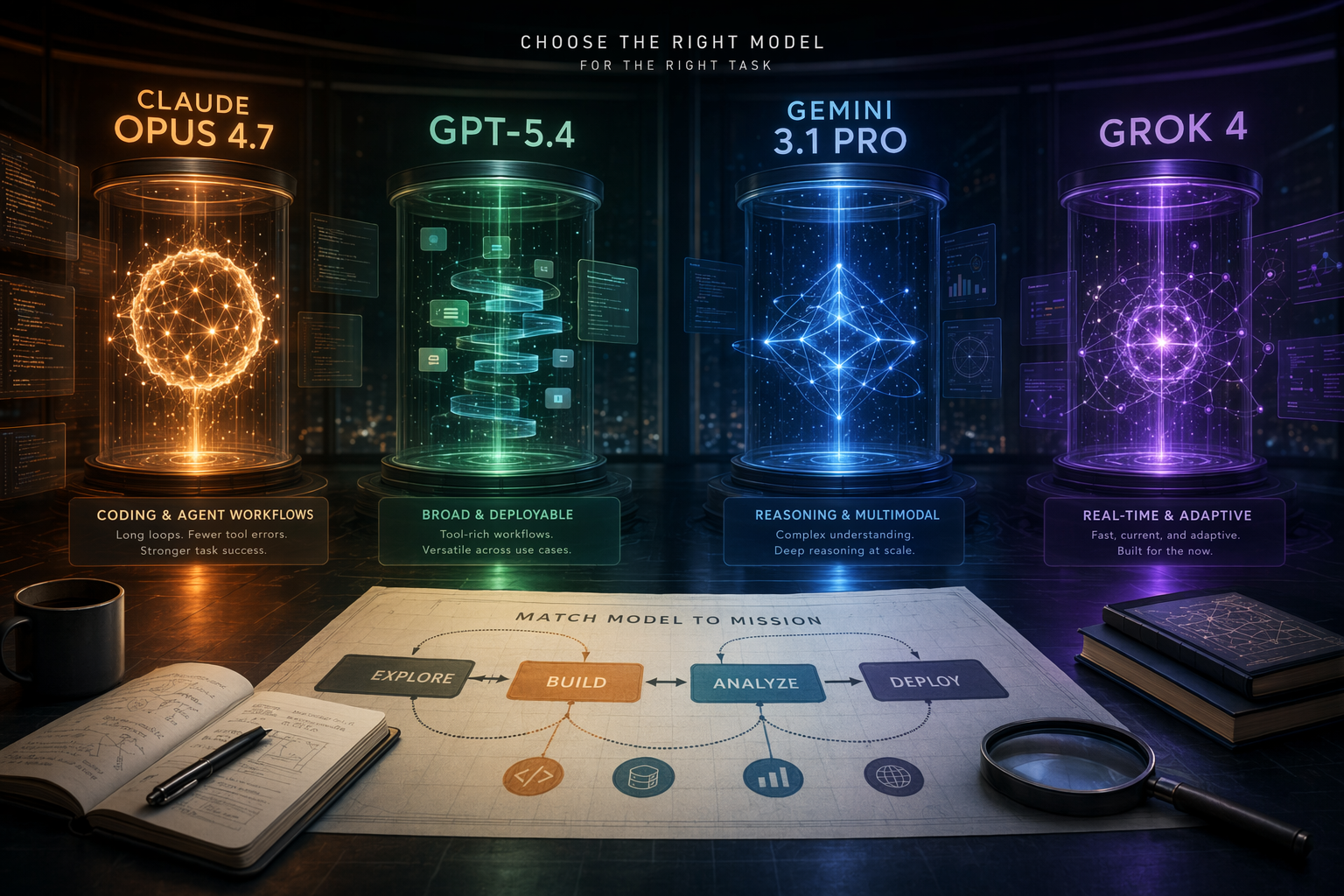

Сводить Claude Opus 4.7, GPT-5.4, Gemini 3.1 Pro и Grok 4 к вопросу «кто лучший?» удобно, но не очень полезно. В реальной работе важнее другое: где ваша задача обычно ломается — в коде, в длинной цепочке действий, в работе с изображениями, в строгом следовании правилам или в сложном рассуждении.

Стороннее руководство по выбору LLM формулирует общий принцип так: нет модели, которая доминирует во всех задачах; сильные стороны распределены между кодингом, структурированным рассуждением, мультимодальностью, научными бенчмарками и задачами высокой сложности.[5]

Быстрая матрица выбора

| Если главная задача | Кого тестировать первым | На чем основан выбор | О чем помнить |

|---|---|---|---|

| Сложная разработка, агентные рабочие процессы, стабильные вызовы инструментов | Claude Opus 4.7 | Anthropic заявляет, что Opus 4.7 по сравнению с Opus 4.6 дает прирост успешности в Factory Droids на 10–15%, а также меньше ошибок инструментов и более надежную работу; Axios описывает релиз как заметное обновление флагманской модели с улучшениями в кодинге и зрительном понимании.[ | Это прежде всего доказательство прогресса Opus 4.7 относительно Opus 4.6, а не нейтральный head-to-head всех четырех моделей. |

| Жесткие регламенты, структурированное рассуждение, computer use | GPT-5.4 | Стороннее руководство называет GPT-5.4 сильной моделью для structured reasoning и computer use и приводит показатель OSWorld 75%.[ | Все равно нужна проверка на ваших правилах, инструментах и критериях ошибок. |

| Изображения, графики, скриншоты документов, научные вопросы, исследовательские справки | Gemini 3.1 Pro | То же руководство ставит Gemini 3.1 Pro в лидеры по abstract reasoning, multimodal input и scientific benchmarks, включая GPQA 94,3%.[ | Сильные мультимодальные и научные бенчмарки не означают автоматическое лидерство в coding agent или долгих цепочках инструментов. |

| Сверхсложные задачи на рассуждение | Grok 4 | Стороннее руководство пишет, что Grok 4 лидирует по HLE с результатом 50,7%.[ | Один показатель HLE нельзя прямо переносить на обычные бизнес-процессы, качество контента или работу с инструментами. |

| Диверсификация поставщиков, проверка открытых или альтернативных моделей | MiniMax, GLM, Kimi и другие | В том же руководстве указано, что MiniMax M2.5/M2.7, GLM-5/5.1 и Kimi K2.5 по задачам класса SWE-bench уже сопоставимы с передовыми проприетарными моделями.[ | Близость в SWE-bench не доказывает такую же зрелость API, мультимодальности, безопасности, письма или продуктовых интеграций. |

Claude Opus 4.7: главный сигнал — код и надежные инструменты

Opus 4.7 наиболее интересен не просто как новый флагман, а потому что Anthropic отдельно подчеркивает успешность задач и ошибки инструментов. На странице модели сказано, что Claude Opus 4.7 превосходит Opus 4.6 на Factory Droids: успешность выше на 10–15%, ошибок инструментов меньше, а работа надежнее.[11]

Для команд разработки это важный тип улучшения. В реальном агентном процессе модель часто проваливается не на одном ответе, а на десятом шаге: теряет контекст, вызывает не тот инструмент, меняет не тот файл или требует лишней ручной правки. Поэтому Opus 4.7 выглядит сильным кандидатом для первого раунда тестов в программной инженерии и агентных сценариях. Axios также описывает Opus 4.7 как заметное обновление флагманской модели Anthropic с улучшениями в coding и vision.[12]

Но аккуратная интерпретация такая: источники уверенно говорят об апгрейде относительно Opus 4.6; они не дают достаточного основания заявить, что Opus 4.7 при одинаковых условиях побеждает GPT-5.4, Gemini 3.1 Pro и Grok 4 во всех сценариях.[11][

5]

GPT-5.4: когда важны регламент и последовательность

Если задача похожа на проверку по правилам, табличный процесс, работу с интерфейсом, цепочку инструментов или многошаговое решение, GPT-5.4 нужно включать в первый раунд сравнения. Стороннее руководство выделяет GPT-5.4 именно в structured reasoning и computer use и приводит OSWorld 75%.[5]

Это не означает, что GPT-5.4 лучше Opus 4.7 во всем. Более практичный вывод: если цена ошибки у вас связана с нарушением порядка действий, неверным применением правил или операционными задачами, сравнивайте GPT-5.4 и Opus 4.7 на одних и тех же сценариях.[5]

Gemini 3.1 Pro: мультимодальность и научный контекст

Gemini 3.1 Pro стоит тестировать рано, если входные данные не ограничиваются текстом: изображения, диаграммы, скриншоты, графики, фрагменты документов, научные вопросы или исследовательские ответы. Стороннее руководство ставит Gemini 3.1 Pro в сильную позицию по abstract reasoning, multimodal input и scientific benchmarks, включая GPQA 94,3%.[5]

Здесь важно не название бренда, а форма задачи. Если ваш реальный workflow содержит много визуальных данных или научного материала, выбор модели только по coding-бенчмарку может увести в сторону от сильных сторон Gemini 3.1 Pro.[5]

Grok 4: сильный HLE-сигнал, но не универсальный ответ

Grok 4 заслуживает внимания в задачах высокой сложности. Стороннее руководство называет Grok 4 лидером по HLE с результатом 50,7%.[5]

Но HLE не стоит превращать в единственный критерий. Высокий результат на одном сложном бенчмарке не доказывает автоматическое превосходство в бизнес-процессах, генерации контента, coding agent или надежной работе с инструментами. Другая статья о рейтингах моделей прямо напоминает: бенчмарки полезны, но ежедневный опыт разработки часто определяется надежностью, возможностями интерфейса и стоимостью итераций.[6]

Почему нельзя просто открыть лидерборд

Во-первых, таблицы часто смешивают разные бенчмарки и разные даты обновления. Например, сравнение AI coding model comparison от Failing Fast использует источники SWE-bench за февраль 2026 года, Aider за октябрь 2025 года и Arena Code за февраль 2026 года.[2] Такая таблица может дать направление, но не является абсолютным рейтингом всех моделей в один и тот же день и в одинаковых условиях.

Во-вторых, официальное сравнение с прежней версией и сторонняя межмодельная подборка — разные типы доказательств. Данные Anthropic сильнее всего подтверждают, что Opus 4.7 улучшилась относительно Opus 4.6; стороннее руководство дает полезные ориентиры по GPT-5.4, Gemini 3.1 Pro, Grok 4 и другим моделям, но это не совместный официальный head-to-head OpenAI, Google, xAI и Anthropic.[11][

5]

В-третьих, реальное качество внедрения зависит не только от баллов. Надежность, интерфейсные возможности и стоимость итераций могут влиять на ежедневный опыт сильнее, чем разница в одном benchmark-показателе.[6]

Практический тест перед запуском

Для закупки, внедрения или выбора стандартной модели в команде лучше сравнивать не лозунги, а реальные рабочие задачи. Минимальный тест может выглядеть так:

- Возьмите 5–10 задач, которые действительно выполняются каждый день: исправление бага, добавление функции, рефакторинг, чтение длинного документа, анализ скриншота, подготовка спецификации или вызов инструментов.

- Для всех моделей используйте одинаковый prompt, одинаковый контекст и одинаковые критерии готовности.

- Считайте не только лучший ответ, но и метрики процесса: прохождение с первой попытки, число возвратов на доработку, ошибки инструментов, галлюцинации, задержку, стоимость и время ручной правки.

- Обязательно смотрите на худшие ответы. После запуска в продукте именно режимы отказа обычно важнее красивых демонстраций.

- Если в задачах есть персональные данные, коммерческая тайна, регуляторные требования или внутренний код, отдельно проверьте хранение данных, варианты развертывания и корпоративные настройки контроля.

Осторожный итог

Claude Opus 4.7 — первоочередной кандидат для разработки, агентных процессов и сценариев, где критичны надежные вызовы инструментов. Anthropic заявляет о приросте успешности Factory Droids на 10–15% относительно Opus 4.6 и меньшем числе ошибок инструментов; Axios также описывает Opus 4.7 как значимое обновление флагманской модели с улучшениями в кодинге и зрительном понимании.[11][

12]

Но на вопрос «кто абсолютный победитель?» доступные источники не дают надежного ответа. Более практичный вывод из стороннего руководства такой: единой модели, которая доминирует во всех задачах, нет; GPT-5.4, Gemini 3.1 Pro, Grok 4 и новые альтернативные модели имеют разные зоны силы.[5]

Самый безопасный подход: взять Claude Opus 4.7 как одного из первых кандидатов для кода и агентных сценариев, но прогнать его на ваших реальных задачах рядом с GPT-5.4, Gemini 3.1 Pro и Grok 4.