GPT-5.5, Claude Opus 4.7, Kimi K2.6 और DeepSeek V4 के बेंचमार्क पर शोध करें और एक अच्छी शोध रिपोर्ट तैयार करें।

26 अप्रैल 2026 तक उपलब्ध आधिकारिक/प्रमुख स्रोतों के आधार पर, इन चारों मॉडलों में कोई एक “सभी बेंचमार्क में विजेता” नहीं है। GPT‑5.5 agentic coding/computer use में बहुत मजबूत दिखता है, Claude Opus 4.7 SWE Bench शैली क...

26 अप्रैल 2026 तक उपलब्ध आधिकारिक/प्रमुख स्रोतों के आधार पर, इन चारों मॉडलों में कोई एक “सभी बेंचमार्क में विजेता” नहीं है। GPT‑5.5 agentic coding/computer use में बहुत मजबूत दिखता है, Claude Opus 4.7 SWE Bench शैली के real world coding benchmarks में आगे है, Kimi K2.6 open weights coding/agent मॉडल के रूप में बहुत प्र

मुख्य निष्कर्ष

- GPT‑5.5 ने OpenAI के launch benchmarks में Terminal-Bench 2.0 पर 82.7%, OSWorld-Verified पर 78.7%, BrowseComp पर 84.4%, FrontierMath Tier 1–3 पर 51.7%, और FrontierMath Tier 4 पर 35.4% स्कोर किया; GPT‑5.5 Pro ने BrowseComp पर 90.1% और FrontierMath Tier 4 पर 39.6% दिखाया।

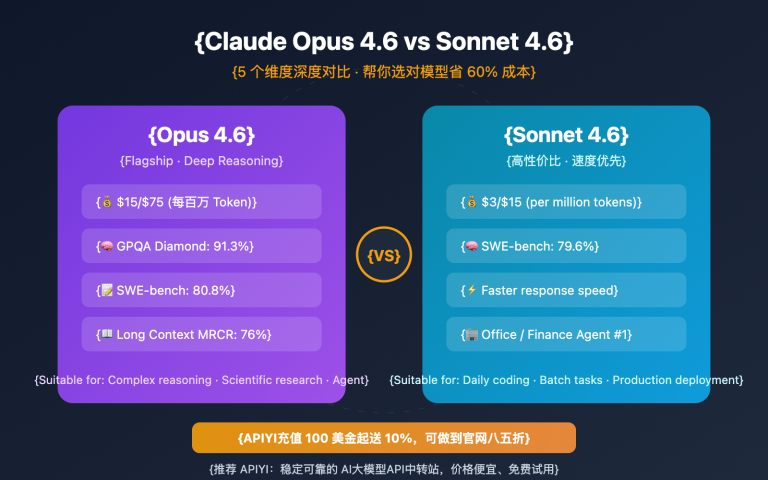

- Claude Opus 4.7 coding benchmarks में विशेष रूप से मजबूत है: Vellum के Anthropic-reported benchmark breakdown में SWE-Bench Verified 87.6%, SWE-Bench Pro 64.3%, MCP-Atlas 77.3%, OSWorld-Verified 78.0%, और GPQA Diamond 94.2% दिए गए हैं।

- Kimi K2.6 सबसे मजबूत open-weights coding contenders में है: उसके official Hugging Face model card में SWE-Bench Pro 58.6%, Terminal-Bench 2.0 66.7%, SWE-Bench Verified 80.2%, BrowseComp 83.2%, BrowseComp Agent Swarm 86.3%, और GPQA-Diamond 90.5% दिए गए हैं।

- DeepSeek V4-Pro official release में 1.6T total / 49B active parameters और 1M context बताता है; DeepSeek-V4-Flash 284B total / 13B active parameters वाला faster/economical variant है।

- 26 अप्रैल 2026 तक उपलब्ध आधिकारिक/प्रमुख स्रोतों के आधार पर, इन चारों मॉडलों में कोई एक “सभी बेंचमार्क में विजेता” नहीं है। GPT‑5.5 agentic coding/computer-use में बहुत मजबूत दिखता है, Claude Opus 4.7 SWE-Bench शैली के real-world coding benchmarks में आगे है, Kimi K2.6 open-weigh

- ## Key findings

शोध उत्तर

26 अप्रैल 2026 तक उपलब्ध आधिकारिक/प्रमुख स्रोतों के आधार पर, इन चारों मॉडलों में कोई एक “सभी बेंचमार्क में विजेता” नहीं है। GPT‑5.5 agentic coding/computer-use में बहुत मजबूत दिखता है, Claude Opus 4.7 SWE-Bench शैली के real-world coding benchmarks में आगे है, Kimi K2.6 open-weights coding/agent मॉडल के रूप में बहुत प्रतिस्पर्धी है, और DeepSeek V4-Pro/Pro-Max 1M-context open-weights विकल्प के रूप में मजबूत reasoning/coding प्रदर्शन देता है। DeepSeek V4 के लिए मैंने Pro/Pro-Max को मुख्य comparison माना है, क्योंकि official materials में V4-Flash को speed/cost variant बताया गया है। [1][

8][

9]

Key findings

-

GPT‑5.5 ने OpenAI के launch benchmarks में Terminal-Bench 2.0 पर 82.7%, OSWorld-Verified पर 78.7%, BrowseComp पर 84.4%, FrontierMath Tier 1–3 पर 51.7%, और FrontierMath Tier 4 पर 35.4% स्कोर किया; GPT‑5.5 Pro ने BrowseComp पर 90.1% और FrontierMath Tier 4 पर 39.6% दिखाया। [

1]

-

Claude Opus 4.7 coding benchmarks में विशेष रूप से मजबूत है: Vellum के Anthropic-reported benchmark breakdown में SWE-Bench Verified 87.6%, SWE-Bench Pro 64.3%, MCP-Atlas 77.3%, OSWorld-Verified 78.0%, और GPQA Diamond 94.2% दिए गए हैं। [

5]

-

Kimi K2.6 सबसे मजबूत open-weights coding contenders में है: उसके official Hugging Face model card में SWE-Bench Pro 58.6%, Terminal-Bench 2.0 66.7%, SWE-Bench Verified 80.2%, BrowseComp 83.2%, BrowseComp Agent Swarm 86.3%, और GPQA-Diamond 90.5% दिए गए हैं। [

6]

-

DeepSeek V4-Pro official release में 1.6T total / 49B active parameters और 1M context बताता है; DeepSeek-V4-Flash 284B total / 13B active parameters वाला faster/economical variant है। [

8][

9]

-

DeepSeek-V4-Pro-Max ने Hugging Face model card पर LiveCodeBench 93.5, Codeforces rating 3206, GPQA Diamond 90.1, Terminal Bench 2.0 67.9, SWE Verified 80.6, और SWE Pro 55.4 रिपोर्ट किया। [

9]

-

उपलब्ध evidence में cross-model comparisons पूरी तरह apples-to-apples नहीं हैं, क्योंकि कई results vendor-reported हैं, effort settings अलग हैं, tools/harness अलग हो सकते हैं, और कुछ competitor scores re-evaluated या self-reported हैं। [

5][

6][

9]

मॉडल प्रोफाइल

| मॉडल | स्थिति / रिलीज | मुख्य स्पेक्स | प्राथमिक ताकत |

|---|---|---|---|

| GPT‑5.5 | OpenAI ने 23 अप्रैल 2026 को GPT‑5.5 release किया और 24 अप्रैल 2026 update में API availability जोड़ी। [ | Public page में parameter count disclosed नहीं है; GPT‑5.5 Pro same underlying model का parallel test-time compute setting बताया गया है। [ | Agentic coding, computer use, tool use, long-horizon work। [ |

| Claude Opus 4.7 | Anthropic page पर Claude Opus 4.7 announcement 16 अप्रैल 2026 दिखता है। [ | 1M context window, 128k max output tokens, adaptive thinking, high-resolution image support। [ | Real-world coding, tool-calling agents, professional knowledge work। [ |

| Kimi K2.6 | Moonshot AI का open-source native multimodal agentic model। [ | MoE architecture, 1T total parameters, 32B active parameters, 256K context, Modified MIT license। [ | Open-weights coding, agent swarm, multimodal coding-driven design। [ |

| DeepSeek V4-Pro / Flash | DeepSeek-V4 Preview 24 अप्रैल 2026 को live और open-sourced बताया गया। [ | V4-Pro: 1.6T total / 49B active; V4-Flash: 284B total / 13B active; दोनों 1M context support करते हैं। [ | Long-context open-weights reasoning, coding, cost-efficient deployment। [ |

Benchmark तुलना

| Benchmark | GPT‑5.5 | Claude Opus 4.7 | Kimi K2.6 | DeepSeek V4-Pro/Pro-Max | पढ़ने का तरीका |

|---|---|---|---|---|---|

| Terminal-Bench 2.0 | 82.7% [ | 69.4% [ | 66.7% [ | 67.9% [ | GPT‑5.5 इस command-line/agentic coding benchmark में स्पष्ट रूप से आगे दिखता है। [ |

| SWE-Bench Pro | 58.6% [ | 64.3% [ | 58.6% [ | 55.4% [ | Claude Opus 4.7 इस hard software-engineering benchmark पर आगे है। [ |

| SWE-Bench Verified | उपलब्ध स्रोत में GPT‑5.5 का comparable score नहीं मिला। [ | 87.6% [ | 80.2% [ | 80.6% [ | Claude Opus 4.7 reported results में strongest है। [ |

| OSWorld-Verified | 78.7% [ | 78.0% [ | 73.1% [ | Insufficient evidence | GPT‑5.5 और Claude Opus 4.7 computer-use tasks में बहुत करीब हैं। [ |

| BrowseComp | 84.4%; Pro 90.1% [ | 79.3% [ | 83.2%; Agent Swarm 86.3% [ | Insufficient evidence | GPT‑5.5 Pro और Kimi Agent Swarm web-research/agentic search में मजबूत दिखते हैं। [ |

| GPQA Diamond | उपलब्ध OpenAI launch excerpt में comparable score नहीं मिला। [ | 94.2% [ | 90.5% [ | 90.1% [ | Claude Opus 4.7 science reasoning में reported scores के आधार पर आगे है। [ |

| HLE / hard reasoning | उपलब्ध OpenAI launch excerpt में comparable HLE score नहीं मिला। [ | HLE no-tools 46.9%, with-tools 54.7% [ | HLE-Full 34.7%, with-tools 54.0% [ | HLE 37.7% [ | Tool-augmented HLE में Claude और Kimi करीब हैं; DeepSeek का listed HLE score lower है। [ |

| Long context | public specs not disclosed in retrieved source | 1M context [ | 256K context [ | 1M context [ | Long-context deployment में Claude Opus 4.7 और DeepSeek V4 अधिक स्पष्ट रूप से positioned हैं। [ |

उपयोग-केस के अनुसार निष्कर्ष

-

अगर आपका workload terminal-heavy autonomous coding, computer-use, tool-driven workflows और general frontier-agent work है, तो GPT‑5.5 सबसे मजबूत candidate दिखता है, खासकर Terminal-Bench 2.0 82.7%, OSWorld-Verified 78.7%, Toolathlon 55.6%, और BrowseComp 84.4% के आधार पर। [

1]

-

अगर आपका लक्ष्य GitHub issue resolution, production codebase repair, और SWE-Bench-style software engineering है, तो Claude Opus 4.7 सबसे मजबूत दिखता है, क्योंकि इसका SWE-Bench Verified 87.6% और SWE-Bench Pro 64.3% है। [

5]

-

अगर आपको open-weights/self-hostable मॉडल चाहिए और coding + agentic research दोनों महत्वपूर्ण हैं, तो Kimi K2.6 बहुत मजबूत विकल्प है, क्योंकि यह 1T/32B-active MoE model है और SWE-Bench Pro 58.6%, BrowseComp 83.2%, तथा Agent Swarm BrowseComp 86.3% रिपोर्ट करता है। [

6]

-

अगर आपको 1M context, open-weights, और cost-efficient deployment चाहिए, तो DeepSeek V4-Pro/Flash रणनीतिक रूप से महत्वपूर्ण है; V4-Pro 1.6T/49B-active है और V4-Flash 284B/13B-active faster/economical variant है। [

8][

9]

-

अगर pure reasoning/math frontier आपका मुख्य लक्ष्य है, तो इस dataset में picture mixed है: Claude Opus 4.7 GPQA Diamond पर 94.2% है, Kimi K2.6 GPQA-Diamond 90.5% और AIME 2026 96.4% देता है, और DeepSeek-V4-Pro-Max GPQA Diamond 90.1%, HMMT 2026 Feb 95.2%, तथा IMOAnswerBench 89.8% दिखाता है। [

5][

6][

9]

Evidence notes

-

GPT‑5.5 के लिए strongest evidence OpenAI का official launch post और system card है, लेकिन यह vendor-reported data है। [

1][

2]

-

Claude Opus 4.7 के लिए Anthropic official product/docs pages capabilities और specs देते हैं, जबकि benchmark values के लिए Vellum ने Anthropic-reported tables का readable breakdown दिया है। [

3][

4][

5]

-

Kimi K2.6 के लिए official Hugging Face model card सबसे उपयोगी benchmark source है, क्योंकि उसमें architecture, evaluation settings, और footnotes शामिल हैं। [

6]

-

DeepSeek V4 के लिए DeepSeek API Docs release page availability/specs बताता है, और DeepSeek Hugging Face model card detailed evaluation table देता है। [

8][

9]

-

कई benchmarks में “thinking effort,” tools, max generation length, और harness अलग हैं; Kimi K2.6 card खुद बताता है कि कुछ competitor scores publicly available न होने पर re-evaluated और asterisk-marked हैं। [

6]

Limitations / uncertainty

-

Insufficient evidence: सभी चार मॉडलों को एक ही स्वतंत्र lab, एक ही harness, एक ही tool budget, और एक ही inference-effort setting में evaluate करने वाला complete public benchmark अभी उपलब्ध नहीं मिला। [

5][

6][

9]

-

GPT‑5.5 और Claude Opus 4.7 closed models हैं, इसलिए parameter count, training data, और exact inference configuration public comparison में सीमित हैं। [

1][

3]

-

DeepSeek V4 नाम के अंदर Flash, Pro, और Pro-Max/effort-mode जैसे variants हैं, इसलिए “DeepSeek V4” का benchmark score variant-specific है। [

8][

9]

-

कुछ official benchmark charts images में हैं या extracted text में partial हैं, इसलिए मैंने केवल उन numbers को शामिल किया है जो source text में स्पष्ट रूप से उपलब्ध थे। [

1][

8][

9]

Summary

कुल मिलाकर, GPT‑5.5 सबसे मजबूत all-around frontier agent model जैसा दिखता है, खासकर Terminal-Bench 2.0, OSWorld और BrowseComp में। [1] Claude Opus 4.7 coding agents के लिए सबसे भरोसेमंद दिखता है, विशेषकर SWE-Bench Verified और SWE-Bench Pro पर। [

5] Kimi K2.6 open-weights ecosystem में coding और agentic workflows के लिए सबसे मजबूत contenders में है। [

6] DeepSeek V4-Pro/Pro-Max 1M-context open-weights model के रूप में खास है और coding/reasoning में competitive है, लेकिन direct cross-model comparison अभी भी सीमित evidence पर निर्भर है। [

8][

9]

स्रोत मैप

[1] OpenAI — “Introducing GPT‑5.5”

[2] OpenAI — “GPT‑5.5 System Card”

[3] Anthropic — “Claude Opus 4.7”

[4] Anthropic Docs — “What’s new in Claude Opus 4.7”

[5] Vellum — “Claude Opus 4.7 Benchmarks Explained”

[6] Moonshot AI — “Kimi K2.6” Hugging Face model card

[7] GMI Cloud — “Kimi K2.6: Architecture, Benchmarks, and What It Means for Production AI”

[8] DeepSeek API Docs — “DeepSeek-V4 Preview Release”

[9] DeepSeek AI — “DeepSeek-V4-Pro” Hugging Face model card

सहायक दृश्य

अनुसंधान वार्तालाप

शोध प्रश्न

GPT-5.5, Claude Opus 4.7, Kimi K2.6 और DeepSeek V4 के बेंचमार्क पर शोध करें और एक अच्छी शोध रिपोर्ट तैयार करें।

उद्धृत उत्तर

26 अप्रैल 2026 तक उपलब्ध आधिकारिक/प्रमुख स्रोतों के आधार पर, इन चारों मॉडलों में कोई एक “सभी बेंचमार्क में विजेता” नहीं है। GPT‑5.5 agentic coding/computer-use में बहुत मजबूत दिखता है, Claude Opus 4.7 SWE-Bench शैली के real-world coding benchmarks में आगे है, Kimi K2.6 open-weights coding/agent मॉडल के रूप में बहुत प्रतिस्पर्धी है, और DeepSeek V4-Pro/Pro-Max 1M-context open-weights विकल्प के रूप में मजबूत reasoning/coding प्रदर्शन देता है। DeepSeek V4 के लिए मैंने Pro/Pro-Max को मुख्य comparison माना है, क्योंकि official materials में V4-Flash को speed/cost variant बताया गया है। [1][

8][

9]

Key findings

-

GPT‑5.5 ने OpenAI के launch benchmarks में Terminal-Bench 2.0 पर 82.7%, OSWorld-Verified पर 78.7%, BrowseComp पर 84.4%, FrontierMath Tier 1–3 पर 51.7%, और FrontierMath Tier 4 पर 35.4% स्कोर किया; GPT‑5.5 Pro ने BrowseComp पर 90.1% और FrontierMath Tier 4 पर 39.6% दिखाया। [

1]

-

Claude Opus 4.7 coding benchmarks में विशेष रूप से मजबूत है: Vellum के Anthropic-reported benchmark breakdown में SWE-Bench Verified 87.6%, SWE-Bench Pro 64.3%, MCP-Atlas 77.3%, OSWorld-Verified 78.0%, और GPQA Diamond 94.2% दिए गए हैं। [

5]

-

Kimi K2.6 सबसे मजबूत open-weights coding contenders में है: उसके official Hugging Face model card में SWE-Bench Pro 58.6%, Terminal-Bench 2.0 66.7%, SWE-Bench Verified 80.2%, BrowseComp 83.2%, BrowseComp Agent Swarm 86.3%, और GPQA-Diamond 90.5% दिए गए हैं। [

6]

-

DeepSeek V4-Pro official release में 1.6T total / 49B active parameters और 1M context बताता है; DeepSeek-V4-Flash 284B total / 13B active parameters वाला faster/economical variant है। [

8][

9]

-

DeepSeek-V4-Pro-Max ने Hugging Face model card पर LiveCodeBench 93.5, Codeforces rating 3206, GPQA Diamond 90.1, Terminal Bench 2.0 67.9, SWE Verified 80.6, और SWE Pro 55.4 रिपोर्ट किया। [

9]

-

उपलब्ध evidence में cross-model comparisons पूरी तरह apples-to-apples नहीं हैं, क्योंकि कई results vendor-reported हैं, effort settings अलग हैं, tools/harness अलग हो सकते हैं, और कुछ competitor scores re-evaluated या self-reported हैं। [

5][

6][

9]

मॉडल प्रोफाइल

| मॉडल | स्थिति / रिलीज | मुख्य स्पेक्स | प्राथमिक ताकत |

|---|---|---|---|

| GPT‑5.5 | OpenAI ने 23 अप्रैल 2026 को GPT‑5.5 release किया और 24 अप्रैल 2026 update में API availability जोड़ी। [ | Public page में parameter count disclosed नहीं है; GPT‑5.5 Pro same underlying model का parallel test-time compute setting बताया गया है। [ | Agentic coding, computer use, tool use, long-horizon work। [ |

| Claude Opus 4.7 | Anthropic page पर Claude Opus 4.7 announcement 16 अप्रैल 2026 दिखता है। [ | 1M context window, 128k max output tokens, adaptive thinking, high-resolution image support। [ | Real-world coding, tool-calling agents, professional knowledge work। [ |

| Kimi K2.6 | Moonshot AI का open-source native multimodal agentic model। [ | MoE architecture, 1T total parameters, 32B active parameters, 256K context, Modified MIT license। [ | Open-weights coding, agent swarm, multimodal coding-driven design। [ |

| DeepSeek V4-Pro / Flash | DeepSeek-V4 Preview 24 अप्रैल 2026 को live और open-sourced बताया गया। [ | V4-Pro: 1.6T total / 49B active; V4-Flash: 284B total / 13B active; दोनों 1M context support करते हैं। [ | Long-context open-weights reasoning, coding, cost-efficient deployment। [ |

Benchmark तुलना

| Benchmark | GPT‑5.5 | Claude Opus 4.7 | Kimi K2.6 | DeepSeek V4-Pro/Pro-Max | पढ़ने का तरीका |

|---|---|---|---|---|---|

| Terminal-Bench 2.0 | 82.7% [ | 69.4% [ | 66.7% [ | 67.9% [ | GPT‑5.5 इस command-line/agentic coding benchmark में स्पष्ट रूप से आगे दिखता है। [ |

| SWE-Bench Pro | 58.6% [ | 64.3% [ | 58.6% [ | 55.4% [ | Claude Opus 4.7 इस hard software-engineering benchmark पर आगे है। [ |

| SWE-Bench Verified | उपलब्ध स्रोत में GPT‑5.5 का comparable score नहीं मिला। [ | 87.6% [ | 80.2% [ | 80.6% [ | Claude Opus 4.7 reported results में strongest है। [ |

| OSWorld-Verified | 78.7% [ | 78.0% [ | 73.1% [ | Insufficient evidence | GPT‑5.5 और Claude Opus 4.7 computer-use tasks में बहुत करीब हैं। [ |

| BrowseComp | 84.4%; Pro 90.1% [ | 79.3% [ | 83.2%; Agent Swarm 86.3% [ | Insufficient evidence | GPT‑5.5 Pro और Kimi Agent Swarm web-research/agentic search में मजबूत दिखते हैं। [ |

| GPQA Diamond | उपलब्ध OpenAI launch excerpt में comparable score नहीं मिला। [ | 94.2% [ | 90.5% [ | 90.1% [ | Claude Opus 4.7 science reasoning में reported scores के आधार पर आगे है। [ |

| HLE / hard reasoning | उपलब्ध OpenAI launch excerpt में comparable HLE score नहीं मिला। [ | HLE no-tools 46.9%, with-tools 54.7% [ | HLE-Full 34.7%, with-tools 54.0% [ | HLE 37.7% [ | Tool-augmented HLE में Claude और Kimi करीब हैं; DeepSeek का listed HLE score lower है। [ |

| Long context | public specs not disclosed in retrieved source | 1M context [ | 256K context [ | 1M context [ | Long-context deployment में Claude Opus 4.7 और DeepSeek V4 अधिक स्पष्ट रूप से positioned हैं। [ |

उपयोग-केस के अनुसार निष्कर्ष

-

अगर आपका workload terminal-heavy autonomous coding, computer-use, tool-driven workflows और general frontier-agent work है, तो GPT‑5.5 सबसे मजबूत candidate दिखता है, खासकर Terminal-Bench 2.0 82.7%, OSWorld-Verified 78.7%, Toolathlon 55.6%, और BrowseComp 84.4% के आधार पर। [

1]

-

अगर आपका लक्ष्य GitHub issue resolution, production codebase repair, और SWE-Bench-style software engineering है, तो Claude Opus 4.7 सबसे मजबूत दिखता है, क्योंकि इसका SWE-Bench Verified 87.6% और SWE-Bench Pro 64.3% है। [

5]

-

अगर आपको open-weights/self-hostable मॉडल चाहिए और coding + agentic research दोनों महत्वपूर्ण हैं, तो Kimi K2.6 बहुत मजबूत विकल्प है, क्योंकि यह 1T/32B-active MoE model है और SWE-Bench Pro 58.6%, BrowseComp 83.2%, तथा Agent Swarm BrowseComp 86.3% रिपोर्ट करता है। [

6]

-

अगर आपको 1M context, open-weights, और cost-efficient deployment चाहिए, तो DeepSeek V4-Pro/Flash रणनीतिक रूप से महत्वपूर्ण है; V4-Pro 1.6T/49B-active है और V4-Flash 284B/13B-active faster/economical variant है। [

8][

9]

-

अगर pure reasoning/math frontier आपका मुख्य लक्ष्य है, तो इस dataset में picture mixed है: Claude Opus 4.7 GPQA Diamond पर 94.2% है, Kimi K2.6 GPQA-Diamond 90.5% और AIME 2026 96.4% देता है, और DeepSeek-V4-Pro-Max GPQA Diamond 90.1%, HMMT 2026 Feb 95.2%, तथा IMOAnswerBench 89.8% दिखाता है। [

5][

6][

9]

Evidence notes

-

GPT‑5.5 के लिए strongest evidence OpenAI का official launch post और system card है, लेकिन यह vendor-reported data है। [

1][

2]

-

Claude Opus 4.7 के लिए Anthropic official product/docs pages capabilities और specs देते हैं, जबकि benchmark values के लिए Vellum ने Anthropic-reported tables का readable breakdown दिया है। [

3][

4][

5]

-

Kimi K2.6 के लिए official Hugging Face model card सबसे उपयोगी benchmark source है, क्योंकि उसमें architecture, evaluation settings, और footnotes शामिल हैं। [

6]

-

DeepSeek V4 के लिए DeepSeek API Docs release page availability/specs बताता है, और DeepSeek Hugging Face model card detailed evaluation table देता है। [

8][

9]

-

कई benchmarks में “thinking effort,” tools, max generation length, और harness अलग हैं; Kimi K2.6 card खुद बताता है कि कुछ competitor scores publicly available न होने पर re-evaluated और asterisk-marked हैं। [

6]

Limitations / uncertainty

-

Insufficient evidence: सभी चार मॉडलों को एक ही स्वतंत्र lab, एक ही harness, एक ही tool budget, और एक ही inference-effort setting में evaluate करने वाला complete public benchmark अभी उपलब्ध नहीं मिला। [

5][

6][

9]

-

GPT‑5.5 और Claude Opus 4.7 closed models हैं, इसलिए parameter count, training data, और exact inference configuration public comparison में सीमित हैं। [

1][

3]

-

DeepSeek V4 नाम के अंदर Flash, Pro, और Pro-Max/effort-mode जैसे variants हैं, इसलिए “DeepSeek V4” का benchmark score variant-specific है। [

8][

9]

-

कुछ official benchmark charts images में हैं या extracted text में partial हैं, इसलिए मैंने केवल उन numbers को शामिल किया है जो source text में स्पष्ट रूप से उपलब्ध थे। [

1][

8][

9]

Summary

कुल मिलाकर, GPT‑5.5 सबसे मजबूत all-around frontier agent model जैसा दिखता है, खासकर Terminal-Bench 2.0, OSWorld और BrowseComp में। [1] Claude Opus 4.7 coding agents के लिए सबसे भरोसेमंद दिखता है, विशेषकर SWE-Bench Verified और SWE-Bench Pro पर। [

5] Kimi K2.6 open-weights ecosystem में coding और agentic workflows के लिए सबसे मजबूत contenders में है। [

6] DeepSeek V4-Pro/Pro-Max 1M-context open-weights model के रूप में खास है और coding/reasoning में competitive है, लेकिन direct cross-model comparison अभी भी सीमित evidence पर निर्भर है। [

8][

9]

स्रोत मैप

[1] OpenAI — “Introducing GPT‑5.5”

[2] OpenAI — “GPT‑5.5 System Card”

[3] Anthropic — “Claude Opus 4.7”

[4] Anthropic Docs — “What’s new in Claude Opus 4.7”

[5] Vellum — “Claude Opus 4.7 Benchmarks Explained”

[6] Moonshot AI — “Kimi K2.6” Hugging Face model card

[7] GMI Cloud — “Kimi K2.6: Architecture, Benchmarks, and What It Means for Production AI”

[8] DeepSeek API Docs — “DeepSeek-V4 Preview Release”

[9] DeepSeek AI — “DeepSeek-V4-Pro” Hugging Face model card

लोग पूछते भी हैं

"GPT-5.5, Claude Opus 4.7, Kimi K2.6 और DeepSeek V4 के बेंचमार्क पर शोध करें और एक अच्छी शोध रिपोर्ट तैयार करें।" का संक्षिप्त उत्तर क्या है?

GPT‑5.5 ने OpenAI के launch benchmarks में Terminal-Bench 2.0 पर 82.7%, OSWorld-Verified पर 78.7%, BrowseComp पर 84.4%, FrontierMath Tier 1–3 पर 51.7%, और FrontierMath Tier 4 पर 35.4% स्कोर किया; GPT‑5.5 Pro ने BrowseComp पर 90.1% और FrontierMath Tier 4 पर 39.6% दिखाया।

सबसे पहले सत्यापित करने योग्य मुख्य बिंदु क्या हैं?

GPT‑5.5 ने OpenAI के launch benchmarks में Terminal-Bench 2.0 पर 82.7%, OSWorld-Verified पर 78.7%, BrowseComp पर 84.4%, FrontierMath Tier 1–3 पर 51.7%, और FrontierMath Tier 4 पर 35.4% स्कोर किया; GPT‑5.5 Pro ने BrowseComp पर 90.1% और FrontierMath Tier 4 पर 39.6% दिखाया। Claude Opus 4.7 coding benchmarks में विशेष रूप से मजबूत है: Vellum के Anthropic-reported benchmark breakdown में SWE-Bench Verified 87.6%, SWE-Bench Pro 64.3%, MCP-Atlas 77.3%, OSWorld-Verified 78.0%, और GPQA Diamond 94.2% दिए गए हैं।

मुझे अभ्यास में आगे क्या करना चाहिए?

Kimi K2.6 सबसे मजबूत open-weights coding contenders में है: उसके official Hugging Face model card में SWE-Bench Pro 58.6%, Terminal-Bench 2.0 66.7%, SWE-Bench Verified 80.2%, BrowseComp 83.2%, BrowseComp Agent Swarm 86.3%, और GPQA-Diamond 90.5% दिए गए हैं।

मुझे आगे किस संबंधित विषय का पता लगाना चाहिए?

अन्य कोण और अतिरिक्त उद्धरणों के लिए "Recherchieren Sie die Benchmarks von Claude Opus 4.7, GPT-5.5, DeepSeek V4 und Kimi K2.6 und vergleichen Sie sie so umfassend wie möglich im" के साथ जारी रखें।

संबंधित पृष्ठ खोलेंमुझे इसकी तुलना किससे करनी चाहिए?

इस उत्तर को "研究 Claude Opus 4.7、GPT-5.5、DeepSeek V4、Kimi K2.6 的基准测试,并尽可能全面地进行比较。请以研究报告的格式呈现。" के सामने क्रॉस-चेक करें।

संबंधित पृष्ठ खोलेंअपना शोध जारी रखें

सूत्र

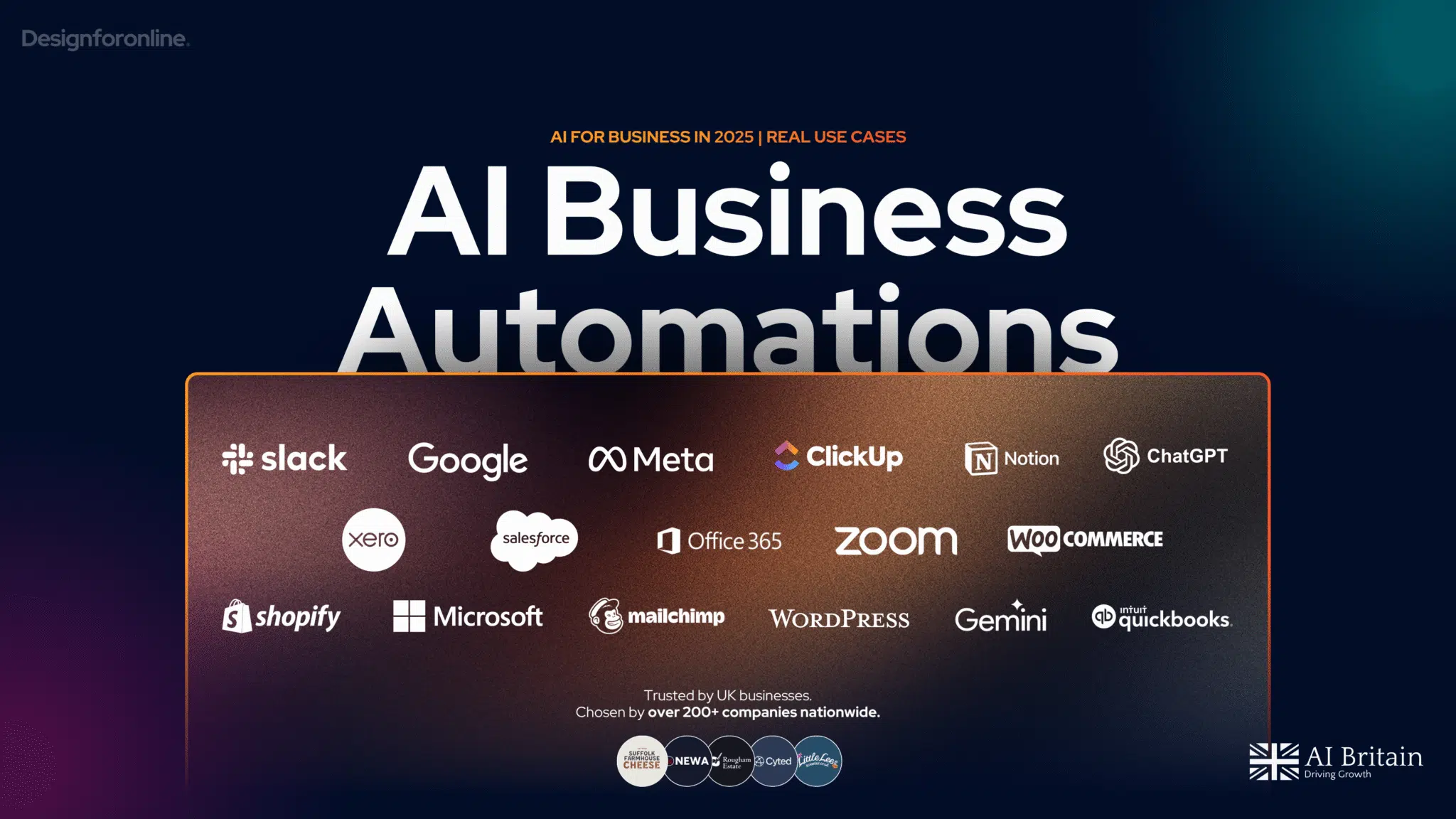

- [1] GPT-5.5 (medium) Review | Pricing, Benchmarks & Capabilities (2026)designforonline.com

Transform your business & boost efficiency with AI automation, utilising the very latest in LLMs, seamless no code automation options & MCPs Home AI Models GPT-5.5 (medium) GPT-5.5 (medium) OpenAI GPT-5.5 (medium) Analysis Summary GPT-5.5 (medium) sits in t...

- [2] GPT-5.5 Benchmark Scores | ml-news – Weights & Biases - Wandbwandb.ai

ML News GPT-5.5 Benchmark Scores OpenAI has introduced GPT 5.5 as its most capable model so far, emphasizing a shift from simple question answering toward systems that can carry out complex, multi step tasks Brett Young Share Comment Star Created on April 2...

- [3] GPT-5.5 System Card - OpenAIopenai.com

We generally treat GPT‑5.5’s safety results as strong proxies for GPT‑5.5 Pro, which is the same underlying model using a setting that makes use of parallel test time compute. As noted below, we separately evaluate GPT‑5.5 Pro in certain cases because we ju...

- [4] GPT-5.5: Pricing, Benchmarks & Performance - LLM Statsllm-stats.com

GPT-5.5: Pricing, Benchmarks & Performance Image 1: LLM Stats LogoLLM Stats Leaderboards Benchmarks Compare Playground Arenas Gateway Services Search⌘K Sign in Toggle theme NEW•NEW•NEW•NEW• Make AI phone calls with one API call CallingBox Start for free 1....

- [5] Introducing GPT-5.5 - OpenAIopenai.com

Computer use and vision EvalGPT-5.5GPT‑5.4GPT-5.5 ProGPT‑5.4 ProClaudeOpus 4.7Gemini 3.1 Pro OSWorld-Verified 78.7%75.0%--78.0%- MMMU Pro (no tools)81.2%81.2%---80.5% MMMU Pro (with tools)83.2%82.1%---- Tool use EvalGPT-5.5GPT‑5.4GPT-5.5 ProGPT‑5.4 ProClaud...

- [6] OpenAI releases GPT-5.5, bringing company one step closer to an AI ‘superapp’ - TechCrunchtechcrunch.com

San Francisco, CA October 13-15, 2026 REGISTER NOW Mark Chen, chief research officer at OpenAI, said that GPT-5.5 was better at navigating computer work than its predecessors, and also said that the model “shows meaningful gains on scientific and technical...

- [7] OpenAI's GPT-5.5 is the new leading AI model - Artificial Analysisartificialanalysis.ai

Read the latest Image 7 Kimi K2.6: The new leading open weights model Benchmarks and Analysis of Kimi K2.6 April 21, 2026Image 8 Opus 4.7: Everything you need to know Benchmarks and Analysis of Opus 4.7 April 17, 2026Image 9 Sub-32B Open Weights Benchmark a...

- [8] OpenAI’s GPT-5.5 Launches With 91.7% Benchmark Score | MEXC Newsmexc.com

Timothy Morano Apr 23, 2026 18:49 OpenAI’s GPT-5.5 debuts with enhanced legal AI capabilities, scoring 91.7% on benchmarks. Available now for ChatGPT Plus and Pro users. OpenAI has officially unveiled GPT-5.5, its latest AI model, on April 23, 2026, pushing...

- [9] Unveiling the GPT-5.5 Benchmark Results: A Deep Dive into Agentic ...skywork.ai

Outline 1. What are the GPT-5.5 Benchmark Results? 2. Top Products Integrating GPT-5.5 Capabilities 3. Comparative Analysis of Product Integrations 4. Practical Usage Guide and Real-World Applications 5. Development History and Future Trends 6. Implications...

- [10] GPT-5.5 Benchmarks 2026: Scores, Rankings & Performancebenchlm.ai

Core Rankings Specialized Use Cases Dashboards Directories Guides & Lists Tools GPT-5.5 According to BenchLM.ai, GPT-5.5 ranks 5 out of 112 models on the provisional leaderboard with an overall score of 89/100. It also ranks 2 out of 16 on the verified lead...

- [11] OpenAI GPT-5.5 Benchmark (CodeRabbit)coderabbit.ai

CodeRabbit logoCodeRabbit logo AgentEnterpriseCustomersPricingBlog Resources Docs Trust Center Contact Us FAQ Whitepapers Log InGet a free trial What changed in OpenAI GPT-5.5: Better judgment, stronger coding, better signal by Juan Pablo Flores Abhilash Ha...

- [12] AI Model Benchmarks Apr 2026 | Compare GPT-5, Claude 4.5 ...lmcouncil.ai

AI Model Benchmarks Apr 2026 18 benchmarks - the world's most-followed benchmarks, curated by AI Explained, author of SimpleBench Independently-run benchmarks by Epoch, Scale and others, so may not match self-reported scores by AI orgs. Compare Models Human...

- [13] What's new in Claude Opus 4.7platform.claude.com

Task budgets (beta) Claude Opus 4.7 introduces task budgets. A task budget gives Claude a rough estimate of how many tokens to target for a full agentic loop, including thinking, tool calls, tool results, and final output. The model sees a running countdown...

- [14] Claude Opus 4.7 - Anthropicanthropic.com

Skip to main contentSkip to footer []( Research Economic Futures Commitments Learn News Try Claude Claude Opus 4.7 Image 1: Claude Opus 4.7 Image 2: Claude Opus 4.7 Hybrid reasoning model that pushes the frontier for coding and AI agents, featuring a 1M con...

- [15] Claude Opus 4.7 Benchmark Breakdown: Vision, Coding, ...mindstudio.ai

Claude Opus 4.7 brings major coding and vision improvements over 4.6, but costs more tokens. Here's what changed and whether the upgrade is worth it. Claude Comparisons AI Development Claude Sonnet 4 and Opus 4 Deprecation: What You Need to Do Before June 1...

- [16] Claude Opus 4.7 Benchmarks Explained - Vellumvellum.ai

Apr 16, 2026•16 min•ByNicolas Zeeb Guides CONTENTS Key observations of reported benchmarks Coding capabilities SWE-bench Verified SWE-bench Pro Terminal-Bench 2.0 Agentic capabilities MCP-Atlas (Scaled tool use) Finance Agent v1.1 OSWorld-Verified (Computer...

- [17] Claude Opus 4.7 Review: Everything New in 2026app.stationx.net

Sign In MEMBERSHIP 2100 Shares Benchmark Opus 4.6 Opus 4.7 Change --- --- SWE-Bench Pro 53.4% 64.3% +10.9 SWE-Bench Verified 80.8% 87.6% +6.8 Graphwalks (multi-hop reasoning) 38.7% 58.6% +19.9 OSWorld-Verified (computer use) 72.7% 78.0% +5.3 CharXiv (vision...

- [18] Anthropic releases Claude Opus 4.7, a less risky model than Mythoscnbc.com

Published Thu, Apr 16 2026 10:35 AM EDT Updated Thu, Apr 16 2026 12:25 PM EDT Image 8: thumbnail Ashley Capoot@/in/ashley-capoot/ WATCH LIVE Share Share Article via Facebook Share Article via Twitter Share Article via LinkedIn Share Article via Email 0 seco...

- [19] Claude Opus 4.7 Benchmark Full Analysis: Empirical Data Leading ...help.apiyi.com

Q1: What is Claude Opus 4.7? Claude Opus 4.7 is the flagship Large Language Model released by Anthropic on April 16, 2026. It leads in multiple benchmarks, including coding (SWE-bench Verified 87.6%), Agent tool invocation, and scientific reasoning (GPQA Di...

- [20] Claude Opus 4.7 and Every Anthropic Model Reviewed - Web Wallahwebwallah.in

One million tokens means Claude could now process several full-length novels, an entire codebase, or years of company emails in a single conversation. Norway’s $2.2 trillion sovereign wealth fund adopted Opus 4.6 to screen its portfolio for ESG risks. Claud...

- [21] Claude Opus 4.7 Model Card | Hacker Newsnews.ycombinator.com

Claude Opus 4.7 Model Card (anthropic.com) 176 points by adocomplete 8 days ago hide past favorite 84 comments --- bachittle 8 days ago next (javascript:void(0)) So Opus 4.7 is measurably worse at long-context retrieval compared to Opus 4.6. Opus 4.6 scores...

- [22] Claude Opus 4.7medium.com

Claude Opus 4.7 Just Dropped — The Benchmarks Are Real, But Three Breaking Changes Will Catch You Off Guard by Tihomir Manushev Apr, 2026 Medium Sitemap Open in app Sign up Sign in []( Get app Write Search Sign up Sign in Image 1 Member-only story Claude Op...

- [23] Claude Opus 4.7 results: early benchmarks, real-world feedback ...boringbot.substack.com

The Production Gap Claude Opus 4.7 results: early benchmarks, real-world feedback, and is it worth upgrading? Yet another release from Anthropic Hamza Farooq Apr 21, 2026 👋 Hi everyone, I am Hamza. I have 18 years of building large scale ecosystems and I t...

- [24] Opus 4.7 Part 1: The Model Card - by Zvi Mowshowitzthezvi.substack.com

Mostly they find exactly what you would expect to find. On SHADE-Arena, Claude Opus 4.7 achieves a 1.5–2% stealth success rate with extended thinking, compared with 3.8–4.2% for Claude Mythos Preview and 0–1.5% for Claude Opus 4.6. On Minimal-LinuxBench, Cl...

- [25] Kimi 2.6 Benchmarks 2026: Scores, Rankings & Performancebenchlm.ai

Core Rankings Specialized Use Cases Dashboards Directories Guides & Lists Tools Kimi 2.6 Self-host vs API cost Estimates at 50,000 req/day · 1000 tokens/req average. According to BenchLM.ai, Kimi 2.6 ranks 12 out of 115 models on the provisional leaderboard...

- [26] Kimi K2.6vals.ai

Benchmarks Models Comparison Model Guide App Reports News About Benchmarks Models Comparison Model Guide App Reports About Release date Models 4/20/2026 Moonshot AI Kimi K2.6 4/16/2026 Anthropic Claude Opus 4.7 4/8/2026 Meta Muse Spark 4/2/2026 Google Gemma...

- [27] Kimi K2.6 on GMI Cloud: Architecture, Benchmarks & API Accessgmicloud.ai

K2.6 was equipped with search, code-interpreter, and web-browsing tools for HLE with tools, BrowseComp, DeepSearchQA, and WideSearch evaluations. Reasoning and Knowledge K2.6 is competitive with closed-source models on math and science, though GPT-5.4 and...

- [28] Kimi K2.6 on GMI Cloud: Architecture, Benchmarks & API Accessgmicloud.ai

K2.6 was equipped with search, code-interpreter, and web-browsing tools for HLE with tools, BrowseComp, DeepSearchQA, and WideSearch evaluations. Reasoning and Knowledge K2.6 is competitive with closed-source models on math and science, though GPT-5.4 and...

- [29] Kimi K2.6 Tech Blog: Advancing Open-Source Codingkimi.com

APEX-Agents 27.9 33.3 33.0 32.0 11.5 OSWorld-Verified 73.1 75.0 72.7 — 63.3 Coding Terminal-Bench 2.0 (Terminus-2) 66.7 65.4 65.4 68.5 50.8 SWE-Bench Pro 58.6 57.7 53.4 54.2 50.7 SWE-Bench Multilingual 76.7 — 77.8 76.9 73.0 SWE-Bench Verified 80.2 — 80.8 80...

- [30] Kimi K2.6 vs Claude Opus 4.6 vs GPT-5.4 - Verdent AIverdent.ai

Benchmark K2.6 Claude Opus 4.6 GPT-5.4 Notes --- --- SWE-Bench Pro 58.60% 53.40% 57.70% Moonshot in-house harness; SEAL mini-swe-agent puts GPT-5.4 at 59.1%, Opus 4.6 at 51.9% SWE-Bench Verified 80.20% 80.80% 80% Tight cluster; Opus 4.7 now leads at 87.6% T...

- [31] Kimi K2.6: Pricing, Benchmarks & Performance - LLM Statsllm-stats.com

Latency 137.00 s Throughput 27 c/s Parameters 1.0T Benchmarks Examples Playground API Benchmarks Arena Performance 65 Websites 33 3D 50 Games 42 Animations 17 SVG 46 Data Viz 14 Audio Leaderboard Rankings 3 Reasoning 3 Search 4 Coding 5 Vision 6 Math 7 Tool...

- [32] Kimi K2.6: The new leading open weights model - Artificial Analysisartificialanalysis.ai

➤ Multimodality: Kimi K2.6 supports Image and Video input and text output natively. The model’s max context length remains 256k. Kimi K2.6 has significantly higher token usage than Kimi K2.5. Kimi K2.5 scores 6 on the AA-Omniscience Index, primarily driven...

- [33] moonshotai/Kimi-K2.6 - Demo - DeepInfradeepinfra.com

OSWorld-Verified 73.1 75.0 72.7 63.3 Coding Terminal-Bench 2.0 (Terminus-2) 66.7 65.4\ 65.4 68.5 50.8 SWE-Bench Pro 58.6 57.7 53.4 54.2 50.7 SWE-Bench Multilingual 76.7 77.8 76.9\ 73.0 SWE-Bench Verified 80.2 80.8 80.6 76.8 SciCode 52.2 56.6 51.9 58.9 48.7...

- [34] moonshotai/Kimi-K2.6 - Hugging Facehuggingface.co

OSWorld-Verified 73.1 75.0 72.7 63.3 Coding Terminal-Bench 2.0 (Terminus-2) 66.7 65.4 65.4 68.5 50.8 SWE-Bench Pro 58.6 57.7 53.4 54.2 50.7 SWE-Bench Multilingual 76.7 77.8 76.9 73.0 SWE-Bench Verified 80.2 80.8 80.6 76.8 SciCode 52.2 56.6 51.9 58.9 48.7 OJ...

- [35] Kimi K2.6 Is the Open Model Release OpenClaw Users Were ...trilogyai.substack.com

Kimi K2.6 Is the Open Model Release OpenClaw Users Were Waiting For Leonardo Gonzalez Apr 20, 2026 Moonshot AI’s Kimi K2.6 arrives at a convenient moment for agent builders: it is open, it is strong on coding benchmarks, and it treats multimodality as part...

- [36] Instagraminstagram.com

6 likes, 0 comments - techoclockofficial April 21, 2026: "Moonshot AI's Kimi K2.6 Tops Open-Source Coding Benchmarks With 1

- [37] deepseek-ai/DeepSeek-V4-Pro - Hugging Facehuggingface.co

We present a preview version of DeepSeek-V4 series, including two strong Mixture-of-Experts (MoE) language models — DeepSeek-V4-Pro with 1.6T ... 2 days ago

- [38] DeepSeek V4—almost on the frontier, a fraction of the pricesimonwillison.net

They're charging $0.14/million tokens input and $0.28/million tokens output for Flash, and $1.74/million input and $3.48/million output for Pro. 2 days ago

- [39] DeepSeek V4 is here: How it compares to ChatGPT, Claude, Geminimashable.com

DeepSeek released benchmark results that indicate the new models achieve similar results as the latest frontier models from OpenAI, Google, and Anthropic.

- [40] DeepSeek V4 Benchmark Results: The Ultimate Guide to the 1T ...skywork.ai

DeepSeek V4 is a groundbreaking Mixture-of-Experts (MoE) large language model featuring approximately 1.60 trillion total parameters, with only ...

- [41] DeepSeek-V4-Pro-Max: Pricing, Benchmarks & Performancellm-stats.com

HMMT February 2026 is a math competition benchmark based on problems from the Harvard-MIT Mathematics Tournament, testing advanced mathematical ...

- [42] DeepSeek V4 Preview Releaseapi-docs.deepseek.com

News; DeepSeek-V4 Preview Release 2026/04/24. On this page. DeepSeek V4 Preview Release. DeepSeek-V4 Preview is officially live & open-sourced!

- [43] China's DeepSeek releases preview of long-awaited V4 model as AI ...cnbc.com

According to Counterpoint's principal AI analyst, Wei Sun, V4's benchmark profile suggests it could offer "excellent agent capability at ...

- [44] Deepseek v4 models are out and here are benchmarks !( 4 versions)reddit.com

Deepseek v4 models are out and here are benchmarks !( 4 versions) ; Agentic ; Terminal Bench 2.0 (Acc), 65.4, 75.1 ; SWE Verified (Resolved), 80.8 ... 2 days ago

- [45] Deepseek v4: Best Opensource Model Ever? (Fully Tested) - YouTubeyoutube.com

DeepSeek is BACK with the V4 release… but is it actually the best open-source model ever? In this video, I put DeepSeek V4 Pro and DeepSeek ... 2 days ago