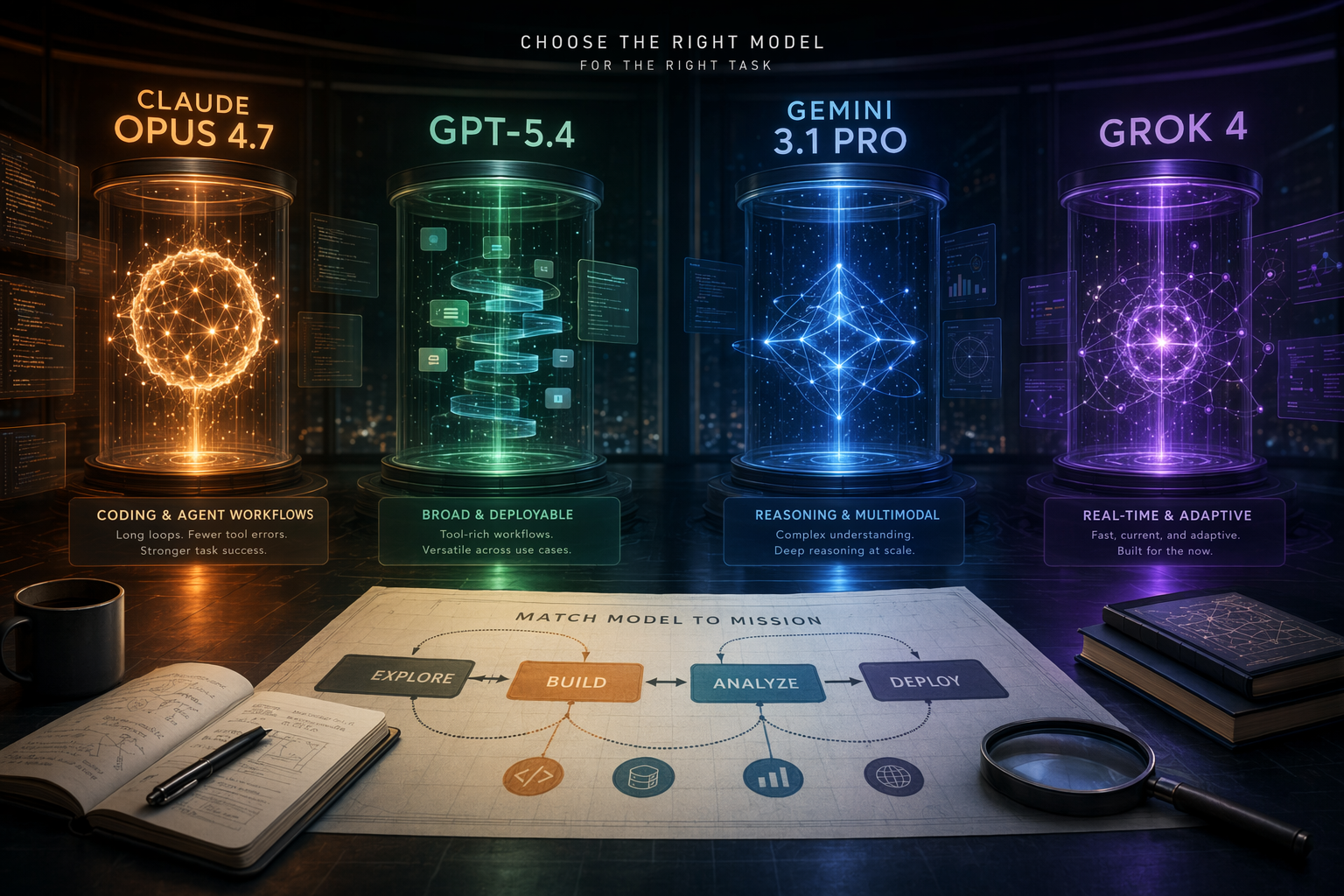

AI मॉडल चुनते समय असली सवाल यह नहीं है कि कौन सर्वश्रेष्ठ है। ज्यादा काम की बात यह है कि आपका काम किस जगह फेल होता है: कोड लिखते समय, tool calling में, लंबे workflow में, image/document समझने में, या कठिन reasoning में।

उपलब्ध third-party LLM selection guide का मुख्य निष्कर्ष यही है कि कोई एक मॉडल हर तरह के काम में सब पर हावी नहीं है। अलग-अलग मॉडल coding, structured reasoning, multimodal input, scientific benchmarks और high-difficulty reasoning में अलग-अलग मजबूत दिखाई देते हैं।[5]

जल्दी फैसला: पहले किसे टेस्ट करें?

| आपका मुख्य काम | पहले किस मॉडल को आज़माएँ | अभी उपलब्ध संकेत | जरूरी सावधानी |

|---|---|---|---|

| जटिल coding, agent workflow, भरोसेमंद tool calling | Claude Opus 4.7 | Anthropic का दावा है कि Opus 4.7, Opus 4.6 की तुलना में Factory Droids task success में 10% से 15% बेहतर है, tool errors कम हैं और reliability बेहतर है; Axios ने भी इसे better coding और sharper vision वाला flagship upgrade बताया है।[ | यह Opus 4.7 बनाम Opus 4.6 का मजबूत संकेत है, चारों कंपनियों के मॉडलों की समान शर्तों वाली आधिकारिक तुलना नहीं। |

| कड़े नियमों वाला workflow, structured reasoning, computer use | GPT-5.4 | third-party guide GPT-5.4 को structured reasoning और computer use में मजबूत बताती है और OSWorld 75% सूचीबद्ध करती है।[ | आपके tools, prompts और failure criteria पर अलग से testing जरूरी है। |

| image, chart, document screenshot, scientific Q&A, research assistance | Gemini 3.1 Pro | guide के अनुसार Gemini 3.1 Pro abstract reasoning, multimodal input और scientific benchmarks में आगे है; GPQA 94.3% भी सूचीबद्ध है।[ | multimodal या science में मजबूती का मतलब यह नहीं कि coding agent या लंबे tool workflows में भी वही सबसे अच्छा होगा। |

| बहुत कठिन reasoning benchmark | Grok 4 | guide Grok 4 को HLE indicator पर 50.7% के साथ आगे बताती है।[ | एक कठिन reasoning metric को सामान्य business workflow, content quality या coding reliability पर सीधे लागू न करें। |

| लागत, vendor diversification या open-source विकल्प | MiniMax, GLM, Kimi जैसे मॉडल भी shortlist में रखें | उसी guide के अनुसार MiniMax M2.5/M2.7, GLM-5/5.1 और Kimi K2.5 जैसे नए मॉडल SWE-bench जैसी tasks में frontier proprietary models के करीब आ रहे हैं।[ | SWE-bench में करीब आना API stability, multimodal quality, safety, writing या product integration में बराबरी का प्रमाण नहीं है। |

Claude Opus 4.7: coding और tool reliability पर सबसे साफ संकेत

Claude Opus 4.7 के पक्ष में सबसे सीधा सार्वजनिक संकेत Anthropic की अपनी तुलना से आता है। कंपनी के अनुसार Opus 4.7, Opus 4.6 के मुकाबले Factory Droids में task success 10% से 15% बढ़ाता है, tool errors कम करता है और ज्यादा reliable है।[11]

यह software engineering teams और agent workflows के लिए अहम है। ऐसे कामों में मॉडल अक्सर सिर्फ एक जवाब गलत देकर नहीं, बल्कि कई छोटे-छोटे चरणों में टूटता है: गलत file बदलना, tool call fail करना, context खो देना, या user से बार-बार correction मांगना। Axios ने भी Opus 4.7 को Anthropic के flagship model का meaningful upgrade कहा है, जिसमें better coding और sharper vision पर जोर है।[12]

फिर भी इसे सही तरीके से पढ़ना जरूरी है। यह evidence सबसे मजबूती से बताता है कि Opus 4.7, Opus 4.6 से बेहतर है। यह अभी इतना नहीं बताता कि Opus 4.7 हर काम में GPT-5.4, Gemini 3.1 Pro या Grok 4 को पीछे छोड़ देता है।[11][

5]

GPT-5.4: जब काम नियमों और चरणों पर टिका हो

अगर आपका workflow spreadsheet-like rules, desktop actions, tool orchestration या step-by-step decision process पर चलता है, तो GPT-5.4 को शुरुआती test set में जरूर रखें। third-party guide GPT-5.4 को structured reasoning और computer use में खासतौर पर मजबूत बताती है और OSWorld 75% का आंकड़ा देती है।[5]

इसका मतलब यह नहीं कि GPT-5.4 हर मामले में Opus 4.7 से बेहतर है। ज्यादा व्यावहारिक तरीका यह होगा कि जहां failure cost गलत step, गलत tool action या process control से आती है, वहां GPT-5.4 और Claude Opus 4.7 को एक ही tasks पर साथ-साथ टेस्ट किया जाए।[5]

Gemini 3.1 Pro: image, document और science-heavy कामों के लिए मजबूत उम्मीदवार

अगर आपके input में images, charts, screenshots, scanned-style documents या scientific questions ज्यादा आते हैं, तो Gemini 3.1 Pro को shortlist में ऊपर रखें। third-party guide Gemini 3.1 Pro को abstract reasoning, multimodal input और scientific benchmarks में आगे बताती है, और GPQA 94.3% सूचीबद्ध करती है।[5]

यहां मॉडल का brand नहीं, task type ज्यादा महत्वपूर्ण है। अगर असली workflow में visual context या scientific material केंद्र में है, तो सिर्फ coding benchmark देखकर model चुनना गलत दिशा दे सकता है।[5]

Grok 4: कठिन reasoning में चमक, लेकिन सीमाएं समझें

Grok 4 कुछ high-difficulty reasoning indicators पर ध्यान खींचता है। third-party guide के अनुसार Grok 4 HLE indicator पर 50.7% के साथ आगे है।[5]

लेकिन HLE जैसा एक metric यह साबित नहीं करता कि वही मॉडल सामान्य enterprise workflow, रोजमर्रा की writing, coding agent या tool use में भी सबसे अच्छा होगा। एक अलग model-ranking article भी यही याद दिलाता है कि benchmarks उपयोगी हैं, पर रोजाना build करने का अनुभव reliability, UI capability और cost जैसे पहलुओं से काफी प्रभावित होता है।[6]

सिर्फ leaderboard देखकर फैसला क्यों अधूरा है?

पहला कारण: leaderboard अलग-अलग benchmark और अलग-अलग update dates मिलाकर दिखा सकते हैं। Failing Fast की AI coding model comparison में SWE-bench, Aider और Arena Code जैसे sources शामिल हैं, जिनकी तारीखें समान नहीं हैं: SWE-bench फरवरी 2026, Aider अक्टूबर 2025 और Arena Code फरवरी 2026 के रूप में सूचीबद्ध हैं।[2] इसलिए ऐसी tables दिशा दिखा सकती हैं, लेकिन उन्हें एक ही दिन, एक ही condition में हुई अंतिम ranking नहीं मानना चाहिए।

दूसरा कारण: official self-comparison और third-party cross-model guide एक ही प्रकार का evidence नहीं हैं। Anthropic का Opus 4.7 data मुख्य रूप से Opus 4.6 के मुकाबले सुधार दिखाता है; third-party guide cross-model संकेत देती है, लेकिन यह OpenAI, Google, xAI और Anthropic की साझा official head-to-head testing नहीं है।[11][

5]

तीसरा कारण: live product में benchmark से बाहर की चीजें भी मायने रखती हैं। model-ranking article साफ कहता है कि benchmarks useful हैं, लेकिन daily building experience reliability, UI capability और cost से प्रभावित होता है।[6]

rollout से पहले आपकी testing checklist

टीम standardize करने, API budget तय करने या production workflow में model लगाने से पहले सिर्फ यह न पूछें कि कौन-सा model सबसे शक्तिशाली है। यह जांचें कि आपकी जरूरत में कौन-सा model कम टूटता है।

- रोजाना इस्तेमाल होने वाले 5 से 10 real tasks चुनें: bug fix, feature addition, refactor, long document reading, screenshot analysis, spec writing या tool calling।

- हर model को वही prompt, वही context और वही completion criteria दें।

- first-pass success rate, rework count, tool errors, hallucination, latency, cost और human correction time अलग-अलग दर्ज करें।

- सिर्फ best answer न देखें; worst answer भी देखें। live system में failure mode अक्सर demo से ज्यादा महत्वपूर्ण होता है।

- अगर sensitive data, compliance या privacy requirements हैं, तो data retention, deployment options और enterprise controls अलग से जांचें।

निचोड़

Claude Opus 4.7 coding, agent workflow और reliable tool use के लिए पहली shortlist में होना चाहिए। Anthropic के अनुसार यह Opus 4.6 की तुलना में Factory Droids task success और tool reliability में स्पष्ट सुधार लाता है, और Axios इसे better coding तथा sharper vision वाला flagship upgrade बताता है।[11][

12]

लेकिन अगर सवाल यह है कि चारों में absolute winner कौन है, तो उपलब्ध evidence से ऐसा दावा करना जल्दबाजी होगी। third-party guide का practical निष्कर्ष ज्यादा उपयोगी है: कोई एक मॉडल हर task में नहीं जीतता; GPT-5.4, Gemini 3.1 Pro, Grok 4 और नए open-source entrants अपनी-अपनी जगह मजबूत हैं।[5]

सबसे सुरक्षित चुनाव यही है: Claude Opus 4.7 को coding और agent tasks के लिए मजबूत शुरुआती उम्मीदवार मानें, लेकिन अपने असली workflow पर GPT-5.4, Gemini 3.1 Pro और Grok 4 के साथ समान testing करें।