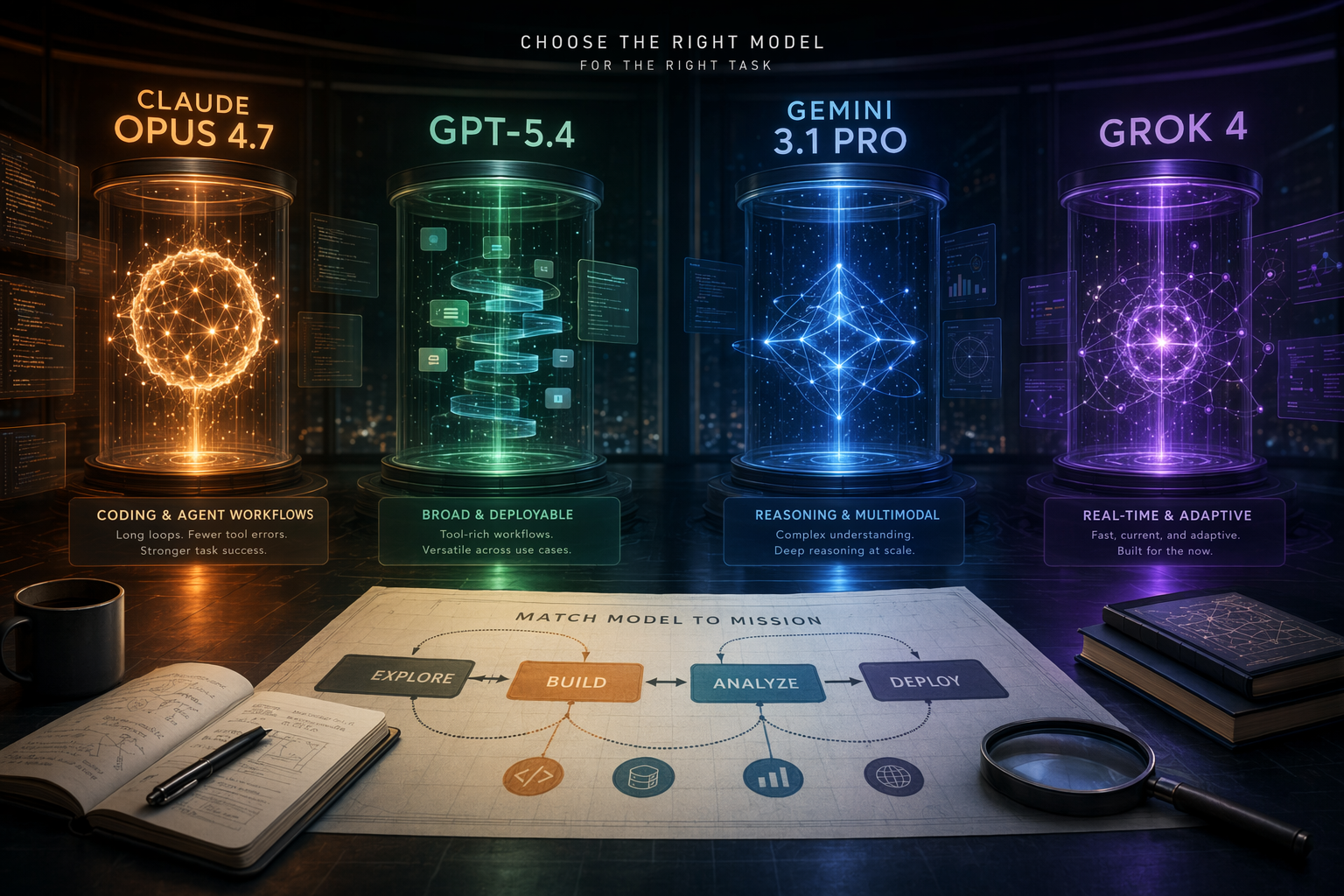

Comparar Claude Opus 4.7, GPT-5.4, Gemini 3.1 Pro y Grok 4 en una sola tabla puede tentar a buscar “el mejor” modelo. Pero, en la práctica, la pregunta más útil es otra: ¿en qué parte suele fallar tu flujo de trabajo? Una guía de selección de LLM de terceros resume bien el punto: ningún modelo domina todas las tareas; cada uno tiene fortalezas distintas en programación, razonamiento estructurado, multimodalidad, ciencia o razonamiento difícil.[5]

Guía rápida de elección

| Si tu tarea principal es… | Modelo que conviene probar primero | Qué lo respalda | Precaución clave |

|---|---|---|---|

| Programación compleja, flujos con agentes, uso estable de herramientas | Claude Opus 4.7 | Anthropic afirma que Opus 4.7 mejora entre un 10 % y un 15 % el éxito en Factory Droids frente a Opus 4.6, con menos errores de herramientas y más fiabilidad; Axios también lo describe como una mejora del modelo insignia con mejor programación y visión más afinada.[ | Esa evidencia compara sobre todo Opus 4.7 con Opus 4.6; no es una prueba directa, bajo las mismas condiciones, contra GPT-5.4, Gemini 3.1 Pro y Grok 4. |

| Procesos rígidos, razonamiento estructurado, control de interfaces o computer use | GPT-5.4 | La guía de terceros destaca GPT-5.4 en structured reasoning y computer use, y cita un 75 % en OSWorld.[ | Hay que validarlo con tus propias reglas, herramientas y criterios de error. |

| Imágenes, gráficos, capturas, documentos visuales, ciencia o apoyo a investigación | Gemini 3.1 Pro | La misma guía sitúa a Gemini 3.1 Pro entre los líderes en razonamiento abstracto, entrada multimodal y benchmarks científicos, con GPQA en 94,3 %.[ | Ser fuerte en multimodalidad o ciencia no implica ser automáticamente el mejor en agentes de programación o flujos largos con herramientas. |

| Benchmarks de razonamiento muy difícil | Grok 4 | La guía atribuye a Grok 4 liderazgo en HLE, con 50,7 %.[ | Un único indicador de razonamiento extremo no se puede extrapolar sin más a trabajo empresarial cotidiano, programación o uso de herramientas. |

| Coste, diversificación de proveedores o alternativas abiertas/emergentes | MiniMax, GLM, Kimi y otros | La guía menciona MiniMax M2.5/M2.7, GLM-5/5.1 y Kimi K2.5 como modelos que ya compiten con modelos propietarios de frontera en tareas tipo SWE-bench.[ | Acercarse en SWE-bench no significa igualar estabilidad de API, multimodalidad, escritura, seguridad o integración de producto. |

Claude Opus 4.7: fuerte candidato para programación y agentes

La señal pública más clara sobre Claude Opus 4.7 viene de Anthropic: la compañía afirma que el modelo supera a Opus 4.6 con una mejora del 10 % al 15 % en éxito de tareas en Factory Droids, además de menos errores de herramientas y un comportamiento más fiable.[11]

Eso lo convierte en un candidato natural para equipos que hacen desarrollo de software, automatización con agentes o flujos largos donde el modelo tiene que llamar herramientas, mantener contexto y no tocar archivos equivocados. En estos escenarios, el problema no suele ser solo una respuesta incorrecta: también pesan las llamadas fallidas a herramientas, los pasos omitidos, el retrabajo y la necesidad de supervisión humana.

Axios también presentó Opus 4.7 como una actualización significativa del modelo insignia de Anthropic, con mejoras en programación y visión.[12] Aun así, la lectura prudente es esta: hay evidencia clara de mejora frente a Opus 4.6, pero no suficiente para afirmar que Opus 4.7 gana en todo a GPT-5.4, Gemini 3.1 Pro o Grok 4 bajo las mismas condiciones.[

11][

5]

GPT-5.4: cuando importan las reglas y el paso a paso

Si tu trabajo depende de cumplir instrucciones estrictas, manejar tablas, tomar decisiones por etapas, operar interfaces o coordinar herramientas, GPT-5.4 debería entrar en la primera ronda de pruebas. La guía de terceros lo destaca en razonamiento estructurado y computer use, y recoge un 75 % en OSWorld.[5]

La conclusión no es que GPT-5.4 sea mejor para todo. Es más precisa: si tus fallos caros suelen venir de errores de procedimiento, control de flujo o ejecución paso a paso, merece compararlo directamente con Claude Opus 4.7 usando tus tareas reales.[5]

Gemini 3.1 Pro: multimodalidad, ciencia y razonamiento abstracto

Gemini 3.1 Pro tiene sentido como primera opción a evaluar cuando el material de entrada no es solo texto: imágenes, gráficos, capturas de pantalla, documentos visuales o preguntas técnicas y científicas. La guía de terceros lo sitúa fuerte en razonamiento abstracto, entrada multimodal y benchmarks científicos, con GPQA en 94,3 %.[5]

Aquí la clave es el tipo de trabajo, no la marca. Si tu flujo real incluye mucha información visual o científica, elegir solo a partir de benchmarks de programación puede dejar fuera una de las fortalezas principales de Gemini 3.1 Pro.[5]

Grok 4: buena señal en razonamiento difícil, con límites

Grok 4 aparece con una señal destacada en razonamiento de alta dificultad. La guía de terceros le atribuye liderazgo en HLE, con 50,7 %.[5]

Pero conviene no convertir ese dato en una conclusión universal. Un buen resultado en HLE no prueba por sí solo que el modelo sea superior en flujos de oficina, escritura, agentes de programación o uso fiable de herramientas. Otra clasificación de modelos recuerda que los benchmarks ayudan, pero la experiencia diaria al construir productos suele depender de factores como fiabilidad, capacidades de la interfaz y coste.[6]

Por qué no conviene decidir solo por rankings

Primero, porque muchos rankings mezclan benchmarks con fechas distintas. La comparativa de modelos de programación de Failing Fast cita fuentes como SWE-bench de febrero de 2026, Aider de octubre de 2025 y Arena Code de febrero de 2026.[2] Ese tipo de tabla sirve para orientarse, pero no equivale a una carrera celebrada el mismo día y bajo las mismas reglas.

Segundo, porque no todas las evidencias tienen el mismo alcance. Los datos de Anthropic sobre Opus 4.7 respaldan sobre todo una mejora respecto a Opus 4.6; una guía de terceros puede dar pistas útiles entre proveedores, pero no es una evaluación oficial conjunta de OpenAI, Google, xAI y Anthropic bajo un protocolo común.[11][

5]

Tercero, porque la experiencia de uso no se reduce al benchmark. Un modelo puede puntuar bien y aun así generar fricción si es caro para iterar, si la interfaz limita el flujo o si sus errores son difíciles de detectar. Esa advertencia aparece también en análisis de rankings: los benchmarks son útiles, pero el trabajo diario se ve muy condicionado por fiabilidad, interfaz y coste.[6]

Lista de pruebas antes de elegir

Antes de comprar, desplegar o imponer un modelo como estándar del equipo, lo más sensato es probar varios candidatos con el mismo conjunto de tareas. Una plantilla práctica:

- Elige de 5 a 10 tareas reales: corregir bugs, añadir una función, refactorizar, leer documentos largos, analizar capturas, redactar especificaciones o llamar herramientas.

- Usa el mismo prompt, el mismo contexto y el mismo criterio de éxito para todos los modelos.

- Mide tasa de acierto a la primera, número de retrabajos, errores de herramientas, alucinaciones, latencia, coste y tiempo de corrección humana.

- Revisa no solo la mejor respuesta, sino también la peor. En producción, el patrón de fallo suele importar más que la demo brillante.

- Si hay datos sensibles, requisitos legales o privacidad, revisa retención de datos, opciones de despliegue y controles empresariales.

Veredicto práctico

Claude Opus 4.7 es un candidato de primera línea para programación, flujos con agentes y uso fiable de herramientas. Anthropic afirma que mejora frente a Opus 4.6 en éxito de tareas de Factory Droids y errores de herramientas, y Axios lo describe como una actualización del modelo insignia con avances en programación y visión.[11][

12]

Pero si la pregunta es “¿cuál es el mejor modelo para todo?”, la evidencia disponible no alcanza para una respuesta seria. La lectura más útil de la guía de terceros es que no hay un modelo que domine todos los escenarios: GPT-5.4, Gemini 3.1 Pro, Grok 4 y varios modelos emergentes tienen ventajas distintas según la tarea.[5]

La decisión más segura es tratar a Claude Opus 4.7 como candidato prioritario para programación y agentes, pero probarlo junto a GPT-5.4, Gemini 3.1 Pro y Grok 4 con tus propios flujos de trabajo antes de estandarizar.