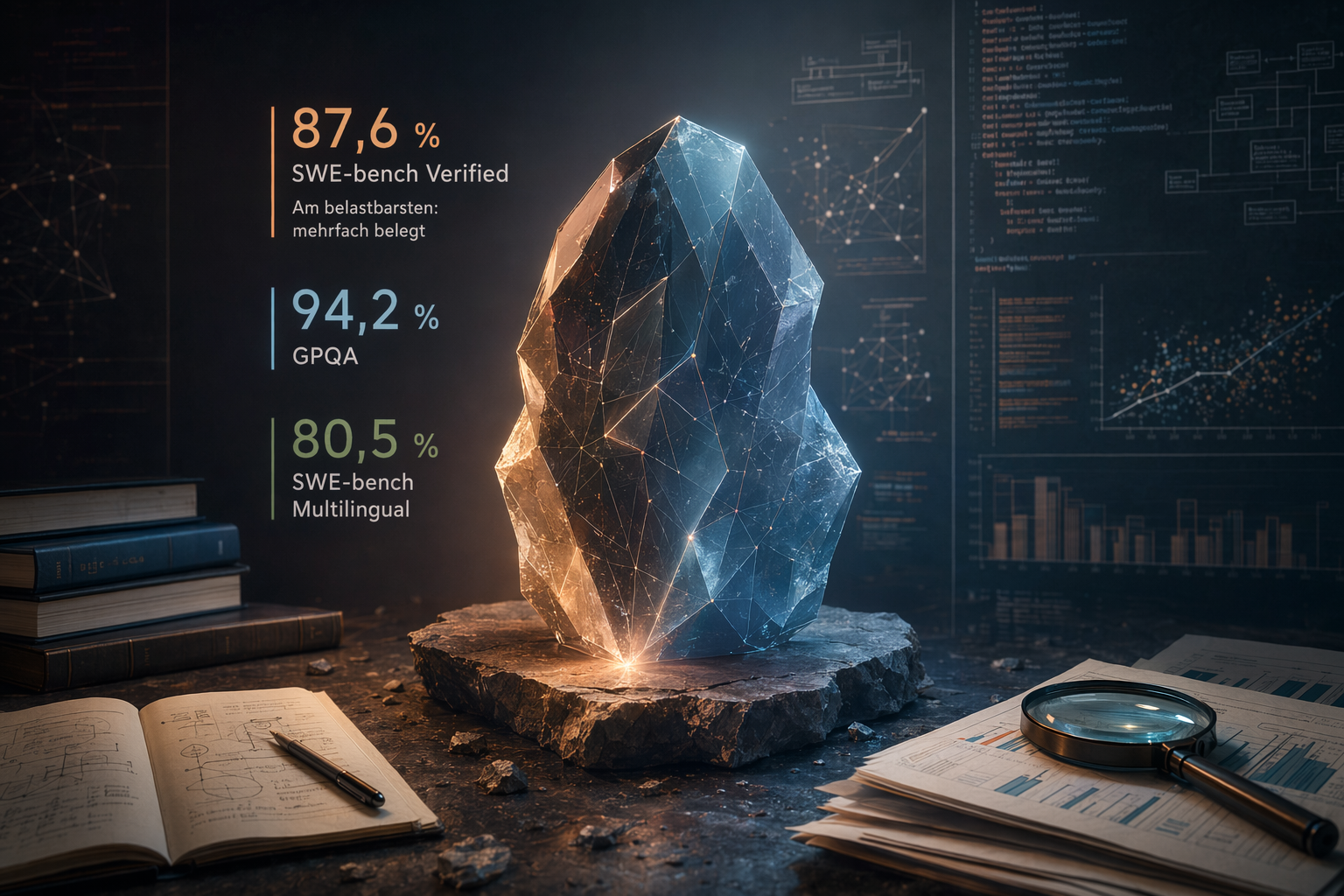

Die Benchmark-Lage zu Claude Opus 4.7 lässt sich aktuell am saubersten über drei öffentliche Werte zusammenfassen: 87,6 % auf SWE-bench Verified, 94,2 % auf GPQA und 80,5 % auf SWE-bench Multilingual. Der wichtigste Anker ist dabei SWE-bench Verified, weil der Wert in mehreren der verfügbaren Quellen explizit genannt wird. [4][

5]

Die Kernwerte im Überblick

| Benchmark | Genannter Wert für Claude Opus 4.7 | Einordnung der Quellenlage |

|---|---|---|

| SWE-bench Verified | 87,6 % | Der stärkste öffentliche Coding-Anker in dieser Quellenlage; der Wert wird mehrfach genannt. [ |

| GPQA | 94,2 % | Klar bei LLM-Stats genannt, aber im verfügbaren Anthropic-Auszug nicht als Benchmark-Zahl sichtbar. [ |

| SWE-bench Multilingual | 80,5 % | In einem weiteren Treffer genannt, dort mit Vergleich zu 77,8 % für Opus 4.6; wegen dünnerer Quellenlage vorsichtig zu gewichten. [ |

Diese Tabelle ist bewusst konservativ: Sie übernimmt nur Werte, die in den vorliegenden öffentlichen Quellen ausdrücklich auftauchen. Für Beschaffung, Migration oder produktive Modellwahl ersetzt sie keine eigene Evaluation auf realen Aufgaben.

Warum SWE-bench Verified der robusteste Wert ist

Der SWE-bench-Verified-Score von 87,6 % ist der am besten belegte Benchmark-Wert für Claude Opus 4.7 in dieser Quellenlage. Sowohl ein Migrations- und Benchmark-Artikel als auch LLM-Stats nennen denselben Wert. [4][

5]

LLM-Stats ordnet die 87,6 % außerdem als Verbesserung um 6,8 Prozentpunkte gegenüber Opus 4.6 ein. [5] ALM Corp beschreibt Opus 4.7 ebenfalls als Modell mit stärkerer Leistung bei schwierigen Coding- und Agenten-Workflows. [

6]

Für Teams mit Software-Engineering-Workloads heißt das: SWE-bench Verified ist der beste öffentliche Startpunkt für die Einordnung. Er sollte aber nur der Beginn sein — entscheidend bleibt, wie das Modell auf dem eigenen Repository, der eigenen Toolchain und den eigenen Akzeptanzkriterien abschneidet.

GPQA: starkes Signal, aber weniger breit bestätigt

Der GPQA-Wert von 94,2 % ist in der verfügbaren Quellenlage klar bei LLM-Stats genannt. [5] Der offizielle Anthropic-Treffer ist als Primärquelle wichtig, der sichtbare Auszug belegt hier jedoch vor allem, dass Entwickler

claude-opus-4-7 über die Claude API nutzen können; eine vollständig zitierbare Benchmark-Tabelle ist darin in den vorliegenden Informationen nicht sichtbar. [7]

Deshalb sollte GPQA hier als relevantes Zusatzsignal gelesen werden, aber mit mehr Vorsicht als SWE-bench Verified. Wer GPQA als Kauf- oder Migrationskriterium nutzt, sollte den Wert gegen Primärmaterial oder eigene Tests absichern. [5][

7]

SWE-bench Multilingual: interessant, aber dünner belegt

Für mehrsprachige Codebasen ist der genannte SWE-bench-Multilingual-Wert von 80,5 % besonders interessant. Ein weiterer Treffer nennt diesen Wert und stellt ihn einem Wert von 77,8 % für Opus 4.6 gegenüber. [9]

Die Einschränkung ist wichtig: Dieser Wert taucht in den verfügbaren Quellen nicht so breit auf wie SWE-bench Verified. Für internationale Codebasen, gemischte Sprachstacks oder Teams mit nicht-englischen Entwicklungsumgebungen ist er ein nützliches Indiz — aber kein Ersatz für eigene Tests.

Was Benchmarks nicht zeigen

Claude Opus 4.7 wird nicht nur über Scores positioniert. VentureBeat beschreibt die Veröffentlichung als Anthropics bislang stärkstes öffentlich veröffentlichtes großes Sprachmodell. [1] ALM Corp ordnet Opus 4.7 als allgemein verfügbares Opus-Modell für anspruchsvolle Coding-, Agenten-, Dokumenten- und Vision-Workflows ein. [

6]

Für die praktische Modellwahl können außerdem Produktmerkmale entscheidend sein, die in einer Benchmark-Tabelle leicht untergehen:

- Kontextfenster: LLM-Stats nennt ein Kontextfenster von 1 Million Tokens. [

5]

- Vision: LLM-Stats nennt 3,3-fach höher aufgelöste Vision-Verarbeitung. [

5]

- Effort-Level: LLM-Stats und ALM Corp nennen einen neuen

xhigh-Effort-Level. [5][

6]

- Tokenizer: ALM Corp weist auf einen aktualisierten Tokenizer hin, der bei gleichem Input zu höheren Token-Zahlen führen kann. [

6]

Diese Punkte können Kosten, Latenz und Ergebnisqualität mindestens so stark beeinflussen wie ein einzelner Benchmark-Wert. Besonders Tokenizer-Änderungen sollten vor einer Migration geprüft werden, weil sie Annahmen zu Tokenverbrauch und Budget verändern können. [6]

Praktische Einordnung für Teams

Für Coding-Workflows: Starte mit SWE-bench Verified als öffentlichem Vergleichspunkt. Die 87,6 % sind der am besten belegte Wert in dieser Quellenlage. [4][

5]

Für Agenten-Workflows: Berücksichtige neben SWE-bench auch die Produktpositionierung für schwierige Coding- und Agentenaufgaben sowie den neuen xhigh-Effort-Level. [5][

6]

Für allgemeines Reasoning: GPQA ist relevant, aber der konkrete Wert von 94,2 % ist hier weniger breit bestätigt als SWE-bench Verified. [5][

7]

Für mehrsprachige Codebasen: SWE-bench Multilingual mit 80,5 % ist ein hilfreicher Hinweiswert, sollte aber wegen der dünneren Quellenlage zusätzlich geprüft werden. [9]

Für Produktionsmigrationen: Teste nicht nur Benchmark-nahe Aufgaben, sondern auch Kontextlänge, Tool-Nutzung, Vision-Fälle, Tokenverbrauch und Latenz unter realen Bedingungen. Die genannten Änderungen an Kontextfenster, Vision, Effort-Level und Tokenizer können die tatsächliche Nutzung deutlich beeinflussen. [5][

6]

Fazit

Die knappste belastbare Einordnung lautet: Claude Opus 4.7 wird öffentlich mit 87,6 % auf SWE-bench Verified, 94,2 % auf GPQA und 80,5 % auf SWE-bench Multilingual genannt. [4][

5][

9] Der SWE-bench-Verified-Wert ist dabei der stärkste Anker, weil er mehrfach belegt ist. [

4][

5]

GPQA und SWE-bench Multilingual liefern wichtige Zusatzsignale, sind in dieser Quellenlage aber weniger breit abgesichert. Für ernsthafte Modellentscheidungen sollten die öffentlichen Benchmarks daher als Vorauswahl dienen — nicht als Ersatz für eigene Evaluierungen auf echten Workflows.