Die bessere Frage lautet nicht: Welches Modell ist absolut das beste? Sondern: Wo scheitert mein konkreter Workflow am ehesten?

Eine Drittanbieter-Auswahlhilfe kommt zu einem für die Praxis wichtigen Schluss: Kein einzelnes LLM dominiert jede Aufgabe. Die Stärken verteilen sich je nach Coding, strukturiertem Reasoning, multimodalen Eingaben, wissenschaftlichen Benchmarks und besonders schwierigen Reasoning-Tests.[5]

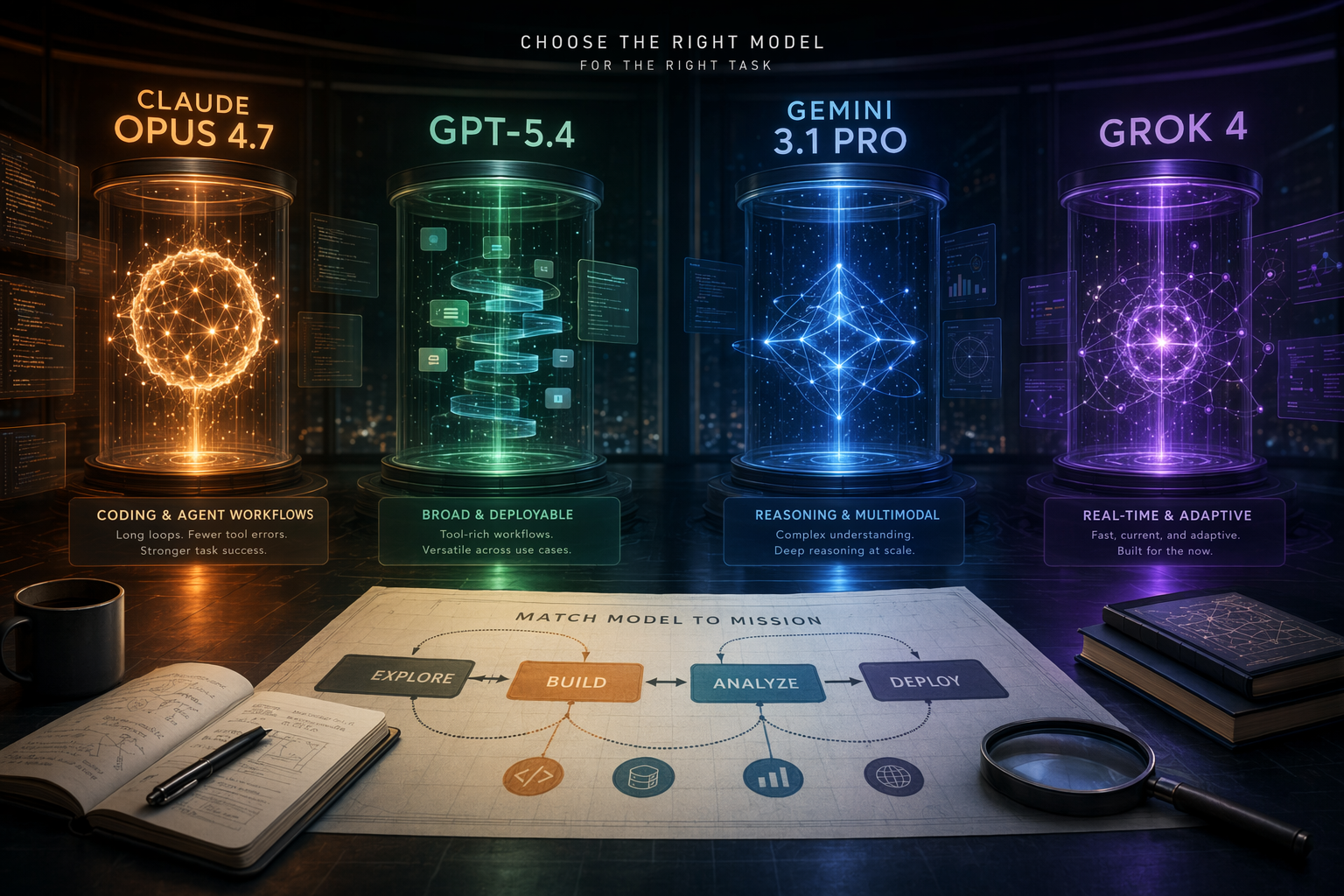

Schnellwahl: Welches Modell zuerst testen?

| Wenn Ihre Hauptaufgabe ist ... | Zuerst testen | Was die Quellen nahelegen | Wichtige Einschränkung |

|---|---|---|---|

| Komplexes Coding, Agenten-Workflows, stabile Tool-Aufrufe | Claude Opus 4.7 | Anthropic nennt gegenüber Opus 4.6 eine um 10 bis 15 % höhere Aufgaben-Erfolgsrate in Factory Droids, weniger Tool-Fehler und zuverlässigeres Verhalten. Axios beschreibt Opus 4.7 zudem als spürbares Upgrade mit besserem Coding und schärferer Vision.[ | Das belegt vor allem den Sprung von Opus 4.6 zu Opus 4.7, nicht einen direkten Vierer-Vergleich unter identischen Bedingungen. |

| Strenge Abläufe, strukturierte Entscheidungslogik, Computer Use | GPT-5.4 | Eine Drittanbieter-Auswahlhilfe nennt GPT-5.4 stark bei structured reasoning und computer use und führt OSWorld mit 75 % an.[ | Entscheidend bleibt, ob das Modell Ihre eigenen Tools, Regeln und Fehlertoleranzen gut trifft. |

| Multimodale Eingaben, abstraktes Reasoning, wissenschaftliche Fragen | Gemini 3.1 Pro | Die Auswahlhilfe sieht Gemini 3.1 Pro vorn bei abstract reasoning, multimodal input und scientific benchmarks; genannt wird GPQA mit 94,3 %.[ | Starke multimodale oder wissenschaftliche Werte bedeuten nicht automatisch, dass es der beste Coding-Agent ist. |

| Sehr schwierige Reasoning-Benchmarks | Grok 4 | Die Auswahlhilfe nennt Grok 4 führend beim HLE-Wert mit 50,7 %.[ | Ein starker HLE-Wert lässt sich nicht ohne Weiteres auf allgemeine Unternehmens-Workflows, Content-Qualität oder Tool-Nutzung übertragen. |

| Kostenkontrolle, Anbieterdiversität oder Open-Source-Alternativen | MiniMax, GLM, Kimi und ähnliche Modelle mitprüfen | Dieselbe Auswahlhilfe schreibt, dass MiniMax M2.5/M2.7, GLM-5/5.1 und Kimi K2.5 bei SWE-bench-Aufgaben an führende proprietäre Modelle heranrücken.[ | SWE-bench-Nähe sagt wenig über API-Stabilität, Multimodalität, Sicherheit, Schreibqualität oder Produktintegration aus. |

Claude Opus 4.7: der erste Kandidat für Coding und Agenten

Der wichtigste öffentliche Hinweis zu Claude Opus 4.7 ist Anthropics Betonung von Zuverlässigkeit, Tool-Nutzung und Aufgaben-Erfolg. Laut Anthropic übertrifft Claude Opus 4.7 Opus 4.6 bei Factory Droids mit einer um 10 bis 15 % höheren Aufgaben-Erfolgsrate, weniger Tool-Fehlern und insgesamt zuverlässigerem Verhalten.[11]

Genau das ist für Softwareteams und Agenten-Workflows relevant. In solchen Szenarien scheitert ein Modell oft nicht an einer einzelnen Antwort, sondern mitten in einer mehrstufigen Kette: falscher Tool-Aufruf, verlorener Kontext, Änderung an der falschen Datei, unnötige Nachfragen oder manuelle Reparatur durch Menschen. Axios ordnet Opus 4.7 ebenfalls als bedeutendes Upgrade von Anthropics Flaggschiffmodell ein und nennt besseres Coding sowie schärfere Vision als Schwerpunkte.[12]

Die saubere Lesart lautet aber: Opus 4.7 ist gegenüber Opus 4.6 klar aufgewertet. Ob es GPT-5.4, Gemini 3.1 Pro oder Grok 4 in jeder Disziplin schlägt, belegen die vorliegenden Quellen nicht.[11][

5]

GPT-5.4: wenn Prozesse streng und strukturiert sind

GPT-5.4 gehört in die erste Testgruppe, wenn Ihre Aufgaben stark regelbasiert sind: Tabellenlogik, mehrstufige Entscheidungen, Bedienung von Werkzeugen, strukturierte Datenflüsse oder Computer Use. Mit Computer Use sind hier Aufgaben gemeint, bei denen das Modell nicht nur Text erzeugt, sondern Abläufe über Werkzeuge oder Softwareumgebungen systematisch abarbeitet.

Die Drittanbieter-Auswahlhilfe beschreibt GPT-5.4 als besonders stark bei structured reasoning und computer use und nennt 75 % bei OSWorld.[5] Daraus folgt nicht, dass GPT-5.4 überall besser ist als Claude Opus 4.7. Es heißt aber: Wenn die größten Risiken in Prozessfehlern, Schrittfolgen und Bedienlogik liegen, sollten GPT-5.4 und Opus 4.7 im selben Testlauf gegeneinander antreten.[

5]

Gemini 3.1 Pro: stark, wenn nicht nur Text zählt

Gemini 3.1 Pro sollte früh auf die Shortlist, wenn Ihre Eingaben nicht nur aus Fließtext bestehen. Dazu gehören Screenshots, Diagramme, Dokumentbilder, technische Abbildungen, Forschungsfragen oder wissenschaftliche Aufgaben.

Die Auswahlhilfe nennt Gemini 3.1 Pro führend bei abstract reasoning, multimodal input und scientific benchmarks; für GPQA wird ein Wert von 94,3 % angegeben.[5] Wer also überwiegend mit visuellen Informationen, Forschungsunterlagen oder naturwissenschaftlichen Fragestellungen arbeitet, sollte nicht allein nach Coding-Benchmarks entscheiden. Genau dort könnten die Stärken von Gemini 3.1 Pro liegen.[

5]

Grok 4: interessant für harte Reasoning-Tests

Grok 4 fällt in der vorliegenden Auswahlhilfe vor allem bei besonders anspruchsvollem Reasoning auf. Dort wird Grok 4 beim HLE-Wert mit 50,7 % als führend genannt.[5]

Das ist ein wichtiger Hinweis, aber kein Freifahrtschein. Ein einzelner Spitzenwert in einem schweren Reasoning-Benchmark beweist nicht, dass ein Modell im Alltag automatisch bessere E-Mails schreibt, stabilere Agenten baut, weniger Tool-Fehler macht oder günstiger zu betreiben ist. Eine weitere Modell-Rangliste erinnert ausdrücklich daran, dass Benchmarks nützlich sind, der tägliche Bau- und Arbeitsprozess aber stark von Zuverlässigkeit, UI-Fähigkeiten und Kosten geprägt wird.[6]

Warum Ranglisten allein nicht reichen

Erstens mischen Modelltabellen oft unterschiedliche Benchmarks und unterschiedliche Aktualisierungsstände. Die Coding-Modellübersicht von Failing Fast nennt als Datenquellen unter anderem SWE-bench aus Februar 2026, Aider aus Oktober 2025 und Arena Code aus Februar 2026.[2] Solche Tabellen geben Orientierung, sind aber nicht automatisch ein perfekter Vergleich aller Modelle am selben Tag unter denselben Bedingungen.

Zweitens sind offizielle Selbstvergleiche und Drittanbieter-Rankings verschiedene Arten von Evidenz. Anthropics Angaben zu Opus 4.7 stützen vor allem die Verbesserung gegenüber Opus 4.6. Eine externe Auswahlhilfe kann Modelle verschiedener Anbieter einordnen, ersetzt aber keinen gemeinsam veröffentlichten, identisch angelegten Head-to-Head-Test von OpenAI, Google, xAI und Anthropic.[11][

5]

Drittens entscheidet im Produktivbetrieb mehr als ein Benchmark-Wert. Eine Modell-Rangliste weist darauf hin, dass Benchmarks hilfreich sind, die tägliche Erfahrung beim Bauen aber stark von Zuverlässigkeit, UI-Fähigkeiten und Kosten abhängt.[6]

Praktische Testliste vor dem Einsatz

Wer ein Modell einkauft, in ein Produkt integriert oder als Teamstandard festlegt, sollte nicht nur fragen, welches Modell in einer Tabelle oben steht. Besser ist ein kleiner, kontrollierter Praxistest mit 3 bis 5 Kandidaten.

- Wählen Sie 5 bis 10 echte Aufgaben aus dem Alltag: Bugfix, Feature-Erweiterung, Refactoring, lange Dokumentanalyse, Screenshot-Auswertung, Spezifikationserstellung oder Tool-Aufrufe.

- Nutzen Sie für alle Modelle denselben Prompt, denselben Kontext und dieselben Erfolgskriterien.

- Messen Sie nicht nur Antwortqualität, sondern auch First-Pass-Erfolg, Nacharbeit, Tool-Fehler, Halluzinationen, Latenz, Kosten und manuelle Korrekturzeit.

- Bewerten Sie nicht nur die beste Antwort, sondern auch die schlechteste. Im Produktivbetrieb sind Ausreißer oft wichtiger als Demo-Glanzstücke.

- Wenn sensible Daten, Compliance oder Datenschutz betroffen sind, prüfen Sie zusätzlich Datenaufbewahrung, Bereitstellungsoptionen, Rechteverwaltung und Enterprise-Kontrollen.

Fazit: nicht das stärkste Modell suchen, sondern das passendste

Claude Opus 4.7 ist für Coding, Agenten-Workflows und zuverlässige Tool-Nutzung ein sehr starker erster Kandidat. Anthropic nennt gegenüber Opus 4.6 eine höhere Erfolgsrate bei Factory Droids, weniger Tool-Fehler und zuverlässigeres Verhalten; Axios beschreibt Opus 4.7 ebenfalls als Upgrade mit besserem Coding und schärferer Vision.[11][

12]

Für die Frage nach dem universell besten Modell reicht die Beweislage aber nicht aus. Die praxistauglichere Schlussfolgerung der Drittanbieter-Auswahlhilfe lautet: Kein Modell dominiert jede Aufgabe. GPT-5.4, Gemini 3.1 Pro, Grok 4 und neue Alternativen haben jeweils eigene Stärken.[5]

Die robusteste Entscheidung ist daher: Claude Opus 4.7 bei Coding und Agenten-Aufgaben zuerst testen, GPT-5.4 bei strukturierten Abläufen danebenstellen, Gemini 3.1 Pro für multimodale und wissenschaftliche Workflows prüfen und Grok 4 bei sehr schwierigem Reasoning mitlaufen lassen. Gewinnen sollte am Ende nicht das Modell mit dem besten Ruf, sondern das Modell mit den wenigsten teuren Fehlern in Ihrem echten Workflow.