Marketingteams brauchen nicht nur ansprechende KI-Bilder. Sie brauchen Assets, die Produktdetails bewahren, Briefings einhalten, Pflichttexte lesbar darstellen und möglichst ohne Nacharbeit durch die Markenfreigabe kommen. Die derzeit verfügbaren Quellen tragen deshalb nur eine vorsichtige Antwort: GPT Image 2 ist dokumentiert, GPT Image 1.5 ist dokumentiert, und OpenAI beschreibt Workflows für Bildgenerierung und Bildbearbeitung. Ein Beleg dafür, dass GPT Image 2 Marketing-Varianten verlässlicher produktionsreif macht, liegt in den geprüften Quellen aber nicht vor. [30][

12][

15]

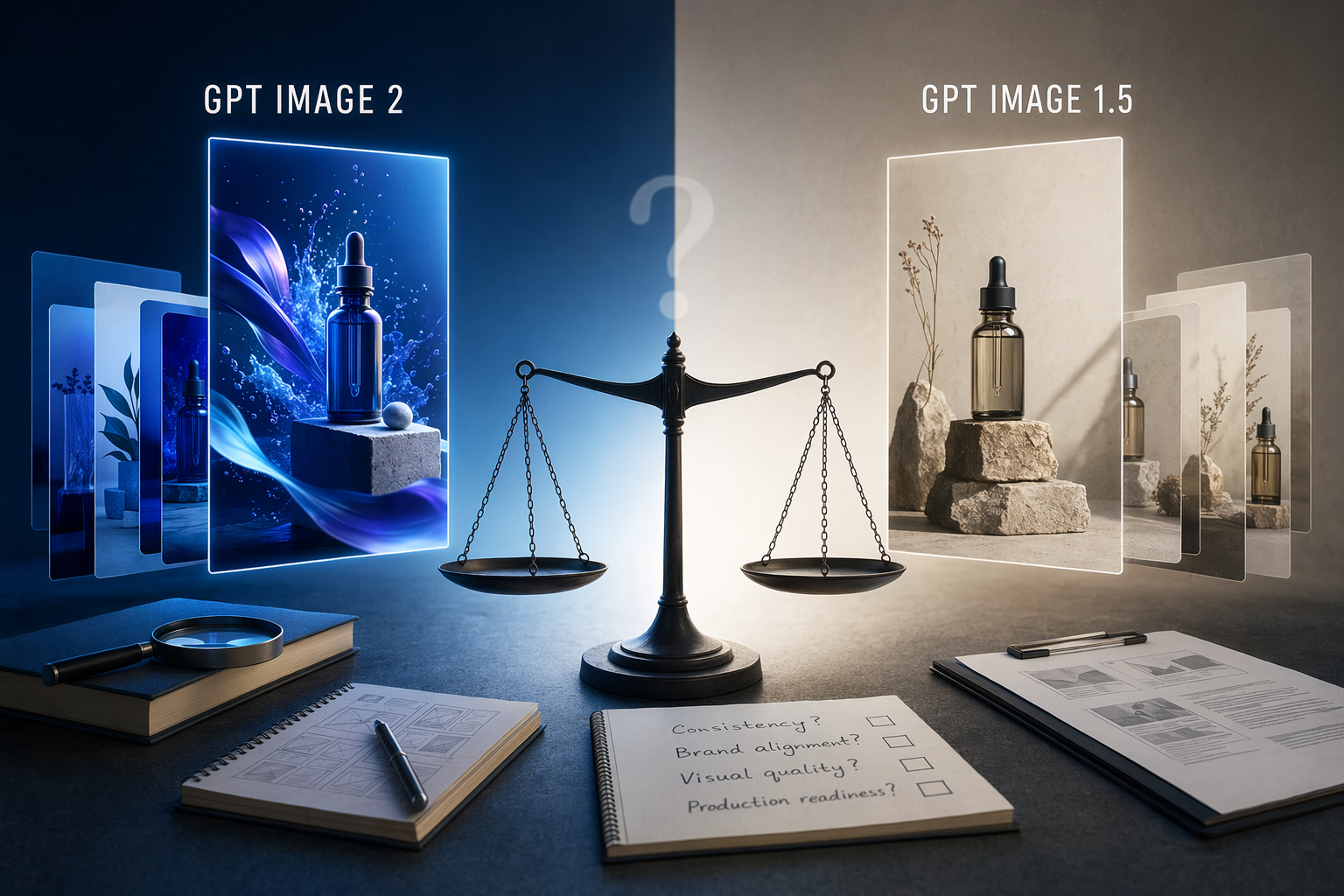

Urteil: testenswert, aber nicht bewiesen

OpenAI führt eine API-Modellseite für GPT Image 2. [30] Für GPT Image 1.5 gibt es ebenfalls eine API-Modellseite; sie beschreibt GPT Image 1.5 als Bildgenerierungsmodell mit besserer Befolgung von Anweisungen und Prompts. [

12] Der OpenAI-Leitfaden zur Bilderzeugung deckt sowohl Generierungen aus Text-Prompts als auch Bearbeitungen bestehender Bilder ab. [

15]

Damit gehören beide Modelle in dieselbe Workflow-Diskussion. Es reicht aber nicht, um zu schließen, dass GPT Image 2 für Kampagnenvarianten, Social Ads, Produktvisuals, Landingpage-Grafiken oder andere markenabgenommene Marketing-Assets zuverlässiger ist.

Was fehlt, ist ein Test mit identischen Eingaben für GPT Image 2 und GPT Image 1.5: gleiche Prompts, gleiche Quellbilder, gleiche Vorgaben, dazu eine veröffentlichte Bestehen-/Nichtbestehen-Matrix, eine Erstfreigabequote und eine Auswertung der nötigen Wiederholungen. OpenAIs Cookbook zu Image Evals ist relevant, weil es Evaluierungen für Bildgenerierung und Bildbearbeitung behandelt; die verfügbare Quelle liefert aber keinen marketing-spezifischen Direktvergleich dieser beiden Modelle. [21]

Was die OpenAI-Unterlagen tatsächlich zeigen

| Nachweis | Was er stützt | Was er nicht beweist |

|---|---|---|

| GPT-Image-2-Modellseite in der API-Dokumentation | GPT Image 2 ist ein von OpenAI dokumentiertes API-Modell. [ | Allein daraus ergeben sich keine Benchmarks zur Marketing-Zuverlässigkeit. |

| GPT-Image-1.5-Modellseite in der API-Dokumentation | OpenAI positioniert GPT Image 1.5 rund um Bildgenerierung, Befolgung von Anweisungen und Prompt-Treue. [ | Sie zeigt nicht, wie GPT Image 1.5 im Vergleich zu GPT Image 2 abschneidet. |

| Leitfaden zur Bildgenerierung | OpenAI dokumentiert das Erzeugen neuer Bilder aus Text-Prompts und das Bearbeiten bestehender Bilder. [ | Der Leitfaden vergleicht die Modelle nicht anhand von Marken- oder Asset-Freigaben. |

| Materialien zu ChatGPT Images 2.0 | OpenAI hat ChatGPT Images 2.0 vorgestellt; die FAQ nennt ChatGPT Images eine neue und verbesserte Version, die vom bislang besten Bildgenerierungsmodell des Unternehmens unterstützt werde, und die System Card behandelt Evaluierungen des Safety-Stacks. [ | Das ist kein Marketing-Readiness-Benchmark für GPT Image 2 gegen GPT Image 1.5. |

Der entscheidende Unterschied: Produktankündigungen und Modelldokumentation können einen Test rechtfertigen. Sie ersetzen aber keine belastbaren Messwerte für konkrete Aufgaben.

Warum „neuer“ nicht automatisch „marketingreif“ heißt

Ein marketingreifes Asset muss mehr leisten als gut aussehen. Für die Praxis zählen unter anderem diese Fragen:

- Hält das Bild das Kreativbriefing ein, ohne unerwünschte Elemente hinzuzufügen?

- Bleiben Pflichttexte lesbar, korrekt geschrieben und an der gewünschten Stelle?

- Werden Produktform, Farbe, Verpackung und andere Schlüsseldetails beibehalten?

- Ist der Stil über mehrere Varianten hinweg mit dem Corporate Design vereinbar?

- Verändert ein Edit nur die beauftragten Bildbereiche oder driftet das gesamte Motiv?

- Sind Varianten wirklich unterschiedlich, ohne die Marke zu verlassen?

- Kommt das Ergebnis beim ersten Durchlauf durch die menschliche Prüfung?

- Sinkt die Zahl der Korrekturschleifen bis zu einem verwendbaren Asset?

OpenAIs Prompting Guide zu GPT Image 1.5 zeigt, wie eng solche Anforderungen formuliert sein können: Beispiel-Prompts enthalten Vorgaben wie ausschließlich originales Design, keine Marken, keine Wasserzeichen, keine Logos und Verpackungstext exakt wie angegeben. [20] Das ist für Marketing-QA relevant. Es ist aber Prompting-Anleitung, kein Nachweis, dass eines der Modelle häufiger durch eine Markenprüfung kommt.

Was GPT Image 2 wirklich als zuverlässiger belegen würde

Ein glaubwürdiger Vergleich bräuchte mehr als Modellnamen oder Beispielbilder. Er sollte mindestens Folgendes enthalten:

- Identische Eingaben: dieselben Prompts, Quellbilder, Textblöcke, Seitenverhältnisse, Markenregeln und Edit-Aufgaben für beide Modelle.

- Klare Pass-/Fail-Kriterien: messbare Kriterien für Textgenauigkeit, Produkttreue, Stilkonstanz, Edit-Präzision und Freigabereife.

- Blinde Bewertung: Designerinnen, Marketer oder Brand Reviewer sollten nicht wissen, welches Modell welches Ergebnis erzeugt hat.

- Erfassung der Wiederholungen: Der Test sollte messen, ob ein Modell beim ersten Versuch, zweiten Versuch oder erst nach mehreren Anläufen ein akzeptables Ergebnis liefert.

- Auswertung nach Aufgabentyp: Textlastige Anzeigen, Produktmockups, Social-Varianten und Bild-Edits können aus unterschiedlichen Gründen scheitern.

Die geprüften Quellen dokumentieren die Modelle und verweisen auf Evaluierungskonzepte. Sie veröffentlichen aber keinen marketing-spezifischen Direktvergleich von GPT Image 2 und GPT Image 1.5. [12][

21][

30]

So sollten Teams GPT Image 2 pilotieren

Behandeln Sie GPT Image 2 als Kandidaten für eine Prüfung, nicht als automatischen Ersatz. Ein sinnvoller Pilot nutzt Aufgaben, deren Qualitätsanforderungen Ihr Team bereits kennt:

- Stellen Sie ein repräsentatives Testset zusammen: Social, Display, E-Mail, Produktgrafiken und Landingpage-Assets.

- Testen Sie sowohl reine Prompt-Generierungen als auch Edits bestehender Bilder, weil OpenAIs Bilddokumentation beide Workflows abdeckt. [

15]

- Verwenden Sie dieselben Produktreferenzen, Textbausteine, visuellen Vorgaben und Markenregeln für beide Modelle.

- Lassen Sie die Ergebnisse blind von den Personen bewerten, die normalerweise Assets freigeben.

- Erfassen Sie Erstfreigabequote, Gesamtzahl der Wiederholungen und den konkreten Ablehnungsgrund je Output.

- Entscheiden Sie nach Aufgabentyp statt nach Modellhype. Wenn ein Modell bei textlastigen Varianten besser ist, aber nicht bei Produkt-Edits, sollte auch nur dieser Teil des Workflows umgestellt werden.

Fazit

GPT Image 2 kann sich für einzelne Marketing-Workflows als besser erweisen. Die aktuell öffentlich belegbare Aussage ist jedoch enger: GPT Image 2 und GPT Image 1.5 sind dokumentiert, OpenAI beschreibt Bildgenerierung und Bildbearbeitung, und OpenAI stellt Hinweise für Image-Evaluierungen bereit. [30][

12][

15][

21] Solange kein Vergleich mit gleichen Prompts und marketing-spezifischer Bewertungsmatrix vorliegt, lautet die verantwortliche Empfehlung: erst testen, dann umstellen.