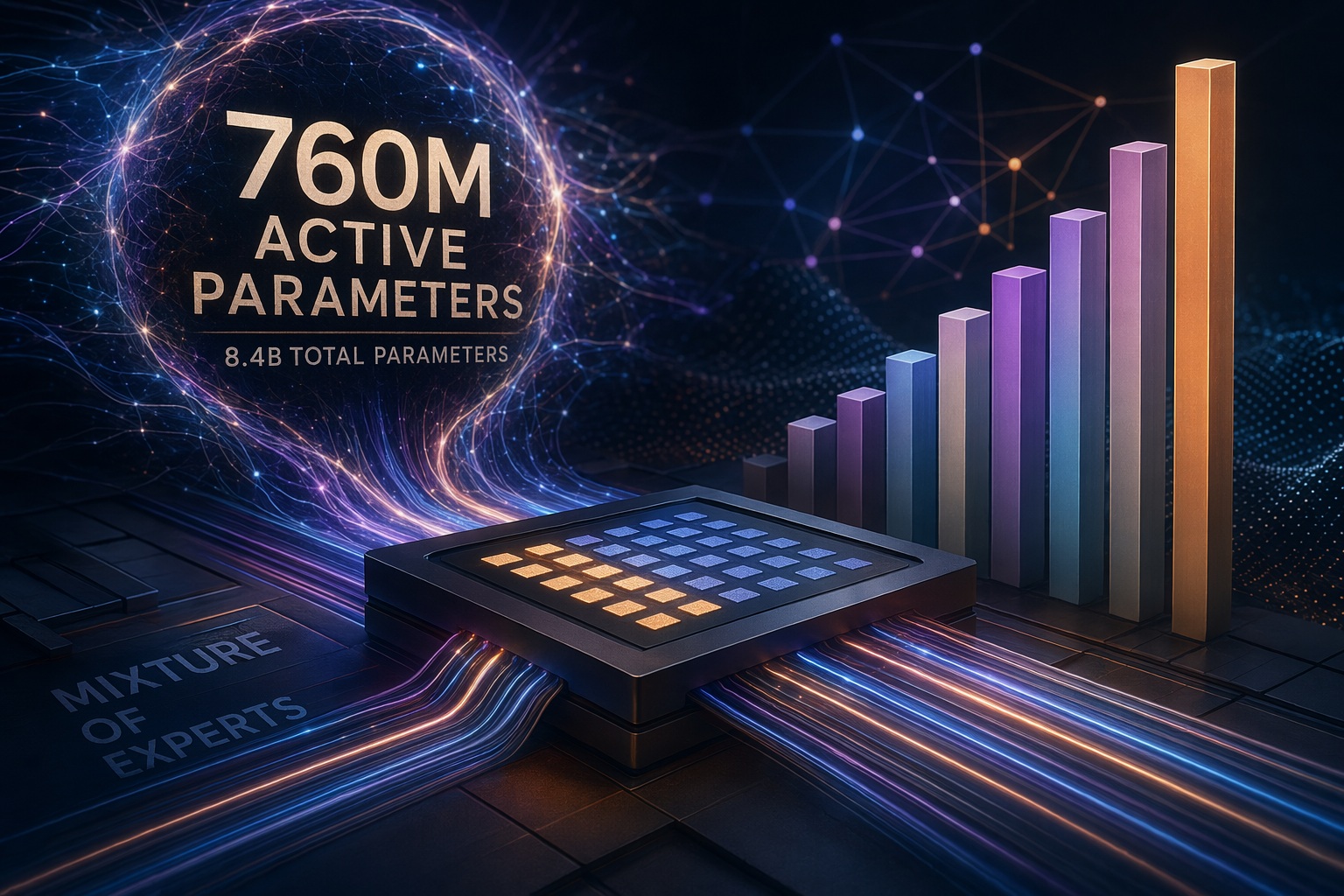

如果你一直以為 AI 模型嘅故事只係參數愈多愈有料,ZAYA1-8B 值得你停一停。Zyphra 將它形容為一個 8.4B(84億)總參數、760M(7.6億)活躍參數嘅 Mixture-of-Experts(MoE,混合專家)語言模型,並稱它在推理、數學同編程任務表現強 [1][

6]。

更準確講,ZAYA1-8B 重要之處,不是證明小模型已經全面贏過大模型,而是將焦點由模型有幾大,轉去每次實際開工嘅參數有幾有效率。

先搞清楚:84億總參數,不等於84億都一齊運算

Zyphra 在 Hugging Face 的模型卡寫明,ZAYA1-8B 是由 Zyphra 端到端訓練的小型 MoE 語言模型,總參數 8.4B、活躍參數 760M [6]。模型卡亦指,它主攻詳細長篇推理,尤其是數學同編程任務 [

6]。

MoE 可以簡化理解為:模型有一個較大的參數池,但推理時唔係每次都動用全部。ZAYA1-8B 的話題性,正在於它總規模是 8.4B,但 Zyphra 對外強調的活躍參數低於 10 億 [4][

6]。

真正賣點:不是細,而是智能密度高

Zyphra 對 ZAYA1-8B 的最強說法,並不是它在所有榜單都稱霸,而是它用較少活躍運算量交出不錯的推理能力。

Zyphra 稱 ZAYA1-8B 具備每個活躍參數的前沿智能密度,並在某些數學及編程基準上勝過大得多的開放權重模型 。公司公告亦稱,模型在複雜推理、數學、編程任務上,可追平或超越大得多的開放權重模型,同時使用少於 10 億活躍參數 。