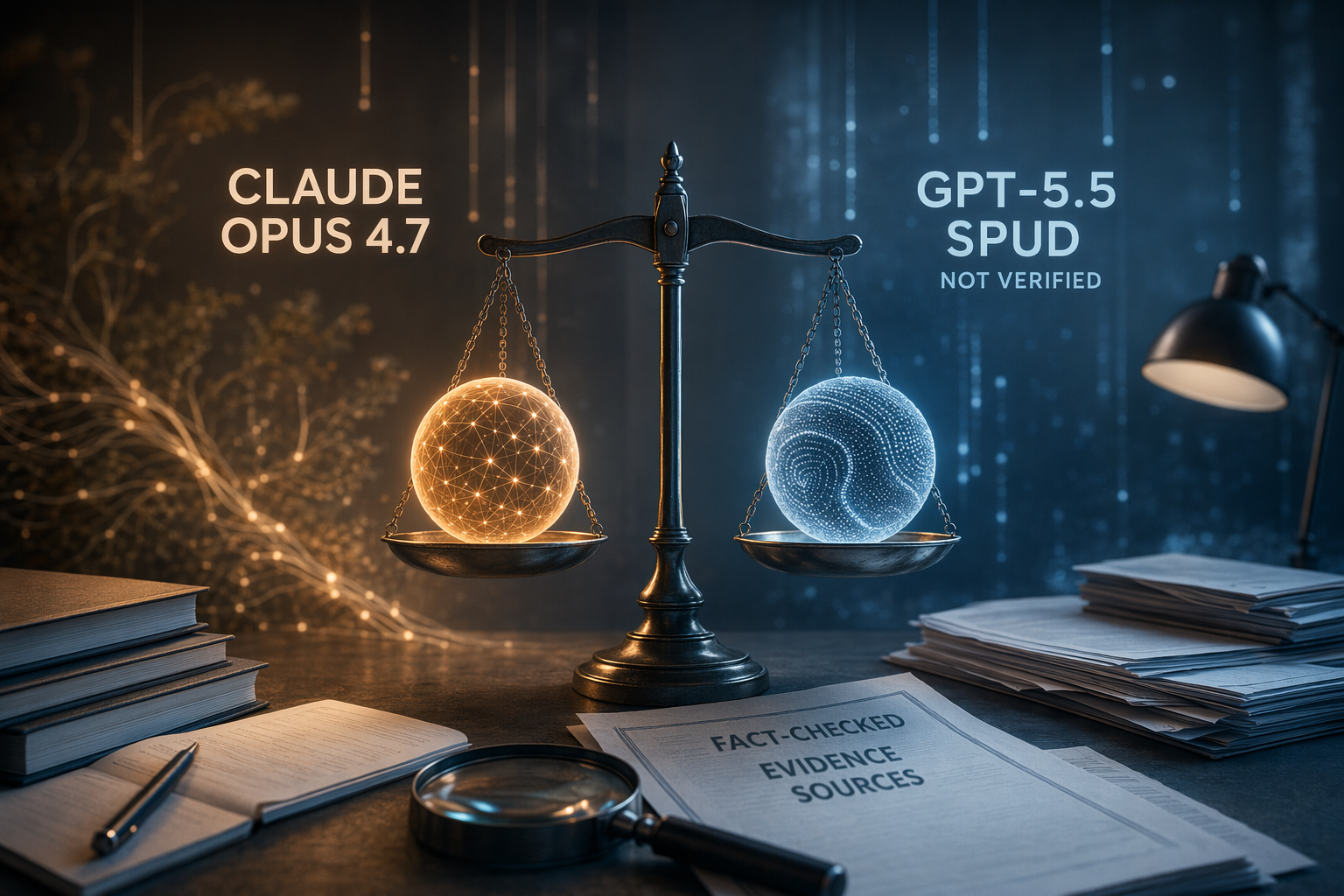

如果只问“Claude Opus 4.7 和 GPT-5.5 Spud 谁更不容易胡说”,这个问题看起来像排行榜题;但从现有资料看,第一步不是排座次,而是先确认参赛选手是谁。

Anthropic 已经公开记录了 Claude Opus 4.7,并给出 claude-opus-4-7 这个 API 标识 [12][

16]。而提供的 OpenAI 官方资料中,能看到 GPT-5、GPT-5 mini、GPT-5.2-Codex,以及 GPT-5.4 的提示词指导材料;没有可验证的公开官方模型名叫 GPT-5.5 Spud [

23][

25][

26][

29][

45]。

所以,负责任的结论不是“Claude 赢”或“Spud 赢”,而是更窄也更重要的一点:Claude Opus 4.7 可以被评测;GPT-5.5 Spud 不应被当作正式基准对象,除非它能对应到官方发布、模型页、模型卡或 API 文档。

先看证据支持的结论

| 问题 | 目前证据能支持的回答 |

|---|---|

| Claude Opus 4.7 是否可验证? | 是。Anthropic 文档记录了 Claude Opus 4.7,并称开发者可通过 Claude API 使用 claude-opus-4-7 [ |

| GPT-5.5 Spud 是否是 OpenAI 官方模型? | 在提供的 OpenAI 官方来源中,未得到验证。这些资料记录的是 GPT-5、GPT-5 mini、GPT-5.2-Codex 和 GPT-5.4 提示词指导 [ |

| Spud 这个名字出现在什么地方? | 出现在 Reddit 帖子和 OpenAI Developer Community 的功能请求帖中,而不是官方发布说明或 API 模型文档里 [ |

| 现在是否有 Claude Opus 4.7 对 GPT-5.5 Spud 的幻觉基准? | 没有。所给资料没有同任务、同评分口径的头对头测试;公平测试还应单独评估“该不该弃答”这一行为 [ |

这并不等于证明未来或内部版本中永远不会出现某个 Spud 模型。它只说明:基于当前引用的证据,不能把 GPT-5.5 Spud 当成 OpenAI 已公开验证的正式模型,也不能据此宣称谁在幻觉控制上胜出。

Claude Opus 4.7:官方存在,但不是跨厂商幻觉榜单

Claude Opus 4.7 最硬的证据来自 Anthropic 自己的产品和开发者文档。Anthropic 称开发者可以通过 Claude API 使用 claude-opus-4-7 [16];其文档还提到 Claude Opus 4.7 引入了 task budgets,即任务预算机制 [

12]。

任务预算对产品控制有意义:它关系到模型在执行任务时可使用的资源和行为边界。但它并不等同于一个公开的“校准不确定性”基准,也不能单独说明模型在面对不确定事实时会不会适时说“不知道”。

与诚实性更直接相关的信号来自二手报道。Mashable 引述 Anthropic 的 Opus 4.7 system card 称,Claude Opus 4.7 的 MASK honesty rate 为 91.7%,并且相比 Anthropic 旧模型和其他前沿 AI 模型,更不容易产生幻觉或迎合用户 [14]。这对理解模型诚实性有参考价值,但仍然不能回答“Claude 对 Spud 谁更强”,因为它不是针对一个已验证 GPT-5.5 Spud 模型的同场测试。

OpenAI 资料:没有验证 Spud,但解释了该怎么测幻觉

在提供的 OpenAI 官方材料里,可以验证的是 GPT-5、GPT-5 mini、GPT-5.2-Codex,以及 GPT-5.4 的提示词指导资料 [23][

25][

26][

29][

45]。Spud 的线索则来自 Reddit 帖子和 OpenAI Developer Community 的功能请求帖 [

7][

8][

10][

28]。

社区讨论可以提示市场期待或传闻走向,但它不能替代官方模型页、模型卡、API 标识或发布公告。换句话说,拿“Spud”去做严肃横评,目前证据基础不够稳。

更有用的是 OpenAI 对幻觉成因的解释。OpenAI 称,常见训练和评估流程会奖励“猜测”,而不是奖励“承认不确定”;模型在不确定时,应该表达不确定或请求澄清,而不是给出自信但错误的信息 [3]。

OpenAI 的 SimpleQA 例子也说明,单看准确率容易误导。该例子列出:gpt-5-thinking-mini 的弃答率为 52%、准确率为 22%、错误率为 26%;而 o4-mini 的弃答率为 1%、准确率为 24%、错误率为 75% [3]。前者回答得更少,但在这个例子中错得也少得多 [

3]。在企业、医疗、法律、金融等高风险场景里,这种“少答但少错”的取舍,往往比模型是否每题都显得很自信更关键。

真正该比较的是:模型会不会在该停的时候停

“幻觉控制”不只是让模型多拒绝。一个有用的模型应该在证据充分时回答;在问题含糊时追问;在没有足够依据时弃答。这就是所谓的校准不确定性:知道什么时候能说,什么时候该停。

研究也支持这个方向,但前提是弃答要校准得当。一项 2024 年研究称,在问答场景中,基于不确定性的弃答有助于提升正确性、减少幻觉并改善安全性 [1][

4]。I-CALM 将“认知性弃答”界定为:在有可验证答案的事实问题上,当模型不确定时选择不回答;该研究也指出,当前大语言模型仍可能在应该弃答时没有弃答 [

54]。关于行为校准强化学习的研究,同样关注如何激励模型在不确定时通过弃答来承认不确定性 [

61]。

更广泛的综述也把不确定性量化视为幻觉检测工具,并认为校准不确定性有助于用户决定何时信任、何时转交人工、何时进一步核验模型答案 [53][

55]。

但这里有一个关键限制:弃答不是越多越好。一个动不动就说“不知道”的模型可能更安全,却不好用;一个从不弃答的模型可能显得高效,却风险很高。真正的难点,是在正确回答和正确停下之间找到平衡。

如果要公平比较,应该这样设计测试

- 只使用官方模型 ID。 Claude 侧可以测试

claude-opus-4-7;OpenAI 侧应使用 GPT-5 或 GPT-5 mini 等有文档支持的模型,而不是未验证的 Spud 标签 [16][

23][

25][

29]。

- 测试集要混合。 同时包含可回答问题、信息不足的问题和本身不可回答的问题;弃答研究关注的正是模型在高不确定性或无法安全回答时是否会拒绝作答 [

1][

4]。

- 把弃答单独计分。 不只统计正确和错误,还要统计正确弃答与错误弃答。关于弃答的综述定义了弃答准确率、弃答精确率、弃答召回率等指标 [

68]。

- 区分事实不确定与安全拒答。 因为“拒绝有害请求”和“事实证据不足所以不回答”不是同一种行为;I-CALM 关注的是有可验证答案的事实问题上的认知性弃答 [

54]。

- 同时报告准确率、错误率和弃答率。 OpenAI 的 SimpleQA 例子显示,一个弃答率高得多的模型,可能准确率相近但错误率低得多 [

3]。

- 保持环境一致。 检索、联网、工具调用、上下文长度、系统提示词都会影响结果。若一个模型拿到额外证据,测试的就不只是模型本身,而是整套系统配置。

常见问题

GPT-5.5 Spud 是真的吗?

至少在这里提供的证据中,它不是一个已由 OpenAI 官方材料验证的公开模型。所引 OpenAI 官方资料记录的是 GPT-5、GPT-5 mini、GPT-5.2-Codex 和 GPT-5.4 提示词指导;Spud 则出现在 Reddit 帖子和社区功能请求帖里 [7][

8][

10][

23][

25][

26][

28][

29][

45]。

Claude Opus 4.7 是否比 GPT-5.5 Spud 更少幻觉?

不能从这些资料中严谨回答。Claude Opus 4.7 是有文档记录的模型 [12][

16],也有二手报道提到其 91.7% 的 MASK 诚实率 [

14];但没有已验证的 GPT-5.5 Spud 对象,也没有两者共享的同场基准 [

7][

8][

10][

28][

68]。

买家或开发者应该比较什么?

应把 Claude Opus 4.7 与有官方文档的 OpenAI 模型放在同一任务、同一工具、同一提示词和同一评分规则下比较。关键指标不应只有准确率,还应同时纳入错误率和弃答行为 [3][

68]。

结论

不要从当前证据中得出“Claude 赢了”或“Spud 赢了”的幻觉控制结论。能成立的说法只有三点:Claude Opus 4.7 有官方文档;GPT-5.5 Spud 没有在所引 OpenAI 官方材料中得到验证;评估幻觉控制时,最应该奖励的是校准不确定性,包括在缺乏依据时正确弃答 [3][

12][

16][

23][

25][

29][

45][

68]。