比较 GPT-5.5、Claude Opus 4.7、Kimi K2.6 和 DeepSeek V4,最容易踩的坑不是少看了某个分数,而是把不同来源、不同测试环境、不同评测口径的数字混在一起,最后得出一个看似精确、实际并不公平的总排名。

所以这篇文章不急着给“四模型总冠军”。更有用的做法是:先看哪些分数能同口径比较,再看每个数字背后的来源强度。

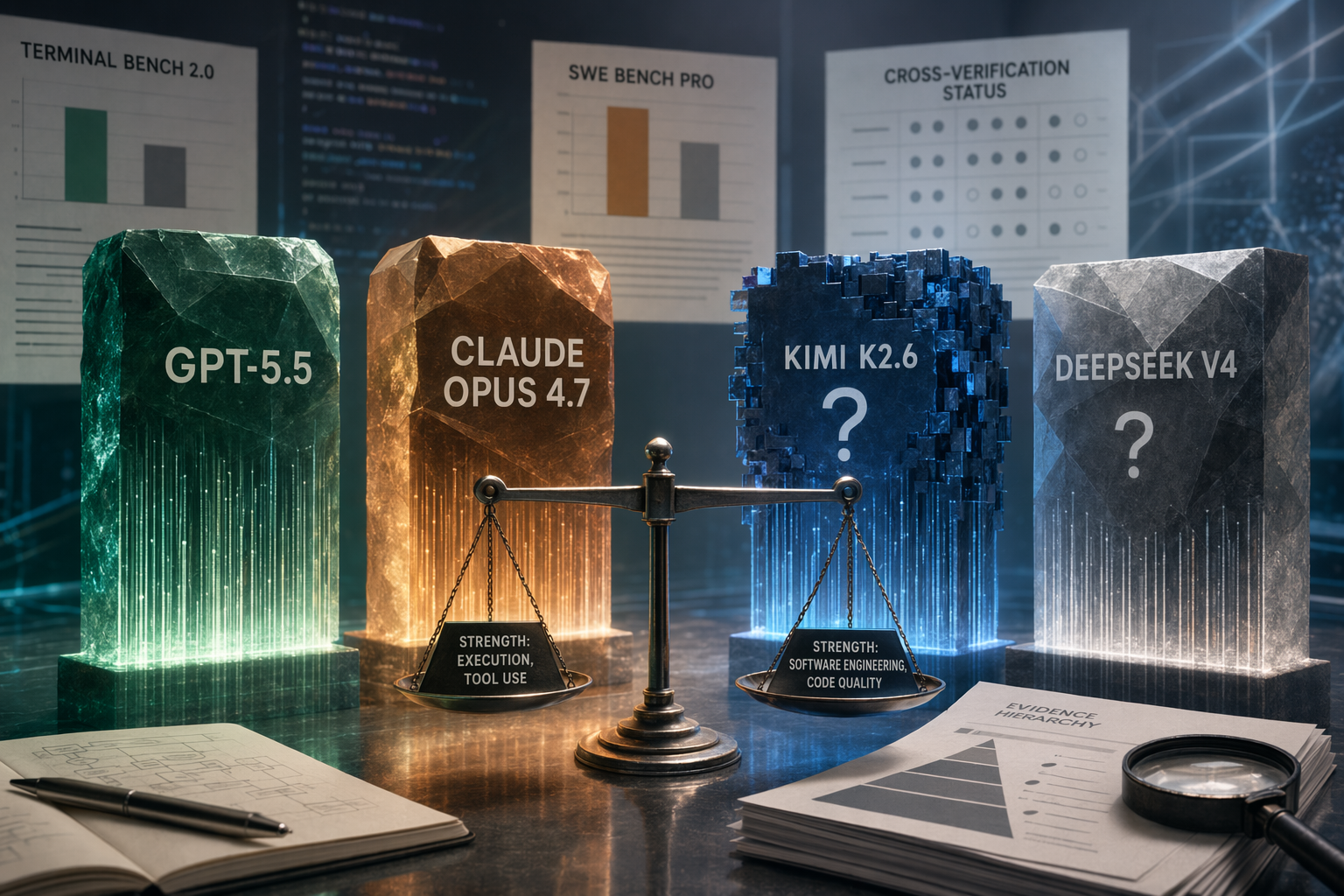

四模型基准测试对比表

表中的“—”表示本文可用来源没有可引用数字,不代表模型不能完成该类任务。尤其是大模型评测,是否同一套 harness、同一批题目、同一运行设置,都会影响结果。

| 模型 | SWE-Bench Pro | SWE-Bench Verified | Terminal-Bench 2.0 | 其他可见信息 | 证据等级与解读 |

|---|---|---|---|---|---|

| GPT-5.5 | 58.6% [ | — | 82.7% [ | Expert-SWE(Internal)73.1%;OpenAI 同页提示其他实验室在该 eval 上看到 memorization evidence。[ | A-:SWE-Bench Pro 与 Terminal-Bench 2.0 来自 OpenAI 同一张比较表,可与 Claude Opus 4.7 直接对照;Expert-SWE 是 internal eval,应保守解读。[ |

| Claude Opus 4.7 | 64.3% [ | 87.6% [ | 69.4% [ | CursorBench 70%。[ | A-/B:SWE-Bench Pro 与 Terminal-Bench 2.0 可与 GPT-5.5 同表比较;SWE-Bench Verified 与 CursorBench 主要来自第三方整理,其中 Verdent 将前者标为 Anthropic-conducted、后者标为 partner eval。[ |

| Kimi K2.6 | 58.6% [ | 80.2% [ | — | Hugging Face 页面将 Kimi K2.6 描述为 open-source、native multimodal agentic model。[ | B(有限):SWE-Bench 数字来自第三方文章;本文来源中没有看到可与 GPT-5.5、Claude Opus 4.7 同表交叉验证的官方完整 benchmark。[ |

| DeepSeek V4 | — | — | — | — | C(数据不足):本文可用来源没有可引用的 DeepSeek V4 benchmark,因此不做数值排名。 |

读表重点:谁领先,取决于你看哪类任务

1. SWE-Bench Pro:Claude Opus 4.7 领先 GPT-5.5

在 OpenAI 的 GPT-5.5 评测表中,Claude Opus 4.7 的 SWE-Bench Pro 分数是 64.3%,高于 GPT-5.5 的 58.6%。[21] 这是本文最值得直接比较的一组数字之一,因为两个模型出现在同一张表里。

SWE-Bench 系列通常被用来观察模型处理真实软件工程问题的能力,Vellum 也把这组比较放在 real GitHub issue resolution 的语境下解读。[24] 如果你的产品场景是自动修 bug、理解大型代码库、处理多文件变更,Claude Opus 4.7 应该优先进入测试名单。

Kimi K2.6 也被 Kilo AI 的第三方文章列为 SWE-Bench Pro 58.6%,看起来与 GPT-5.5 接近。[34] 但这个数字没有和 GPT-5.5、Claude Opus 4.7 出现在同一张可引用交叉表中,因此更适合作为参考信号,而不是严格胜负结论。

2. Terminal-Bench 2.0:GPT-5.5 领先 Claude Opus 4.7

同一张 OpenAI 评测表中,GPT-5.5 在 Terminal-Bench 2.0 的分数是 82.7%,Claude Opus 4.7 为 69.4%。[21]

这意味着,如果你的任务更接近命令行、终端操作、工具调用和 coding agent 的执行环境,GPT-5.5 值得优先实测。这里的结论只适用于这个 benchmark;它不等于 GPT-5.5 在所有代码任务上都更强。

目前本文来源没有 Kimi K2.6 或 DeepSeek V4 在 Terminal-Bench 2.0 上的可引用分数,因此这一栏不能做四模型完整排名。

3. SWE-Bench Verified:Claude Opus 4.7 高于 Kimi K2.6,但来源口径不同

Claude Opus 4.7 的 SWE-Bench Verified 87.6% 出现在第三方评测整理中;Verdent 的整理将该数字标注为 Anthropic-conducted,并提到 memorization screens applied。[4][

6] Kimi K2.6 的 SWE-Bench Verified 80.2% 来自 Kilo AI 的第三方文章。[

34]

这两组数字都有参考价值,但它们不像 OpenAI 同表中的 SWE-Bench Pro 与 Terminal-Bench 2.0 那样适合直接“硬碰硬”。更稳妥的读法是:Claude Opus 4.7 在已披露的 SWE-Bench Verified 数据里更高,但二者来源口径不同,最好结合自己的任务集复测。

4. Expert-SWE:可以看,但不适合作为总排名核心

GPT-5.5 在 Expert-SWE(Internal)为 73.1%,但 OpenAI 将其标为 internal eval,并提示其他实验室在该 eval 上看到 memorization evidence。[21]

简单说,这个数字可以作为 OpenAI 内部能力信号之一,但不适合拿来给四个模型排总榜。凡是带有 internal eval、memorization evidence 或缺少外部交叉验证的指标,都应降低权重。

怎么选模型:先看任务,再看分数

如果你做的是复杂软件工程、GitHub issue 修复或多文件代码改动,先测 Claude Opus 4.7。 在最可直接对照的 SWE-Bench Pro 数据中,Claude Opus 4.7 以 64.3% 高于 GPT-5.5 的 58.6%。[21]

如果你的工作流更像终端里的 coding agent,先测 GPT-5.5。 GPT-5.5 在 Terminal-Bench 2.0 上为 82.7%,高于 Claude Opus 4.7 的 69.4%。[21]

如果你需要开放模型候选,Kimi K2.6 可以进入 shortlist。 Hugging Face 页面将 Kimi K2.6 描述为 open-source、native multimodal agentic model;Kilo AI 第三方文章列出它在 SWE-Bench Pro 为 58.6%、SWE-Bench Verified 为 80.2%。[32][

34] 但这些分数没有与 GPT-5.5、Claude Opus 4.7 出现在同一张官方交叉表中,实际选型时仍应重跑自己的任务集。

如果你正在评估 DeepSeek V4,最稳妥的做法是等待可引用 benchmark 或自行复测。 本文可用来源没有 DeepSeek V4 的可核验分数。把它强行放入数值榜单,反而比留白更容易误导。

为什么不排一个“总冠军”?

大模型 benchmark 的常见误区,是把不同来源、不同任务、不同设置下的数字直接相加。本文采用三层证据来读:

- 同表共享 benchmark:例如 GPT-5.5 与 Claude Opus 4.7 在 OpenAI 表中的 SWE-Bench Pro 和 Terminal-Bench 2.0,这是本文最适合直接比较的数据。[

21]

- 第三方整理的 vendor 或 partner eval:例如 Claude Opus 4.7 的 SWE-Bench Verified 与 CursorBench,仍有参考价值,但要注意测试来源与口径。[

4][

6]

- 缺少交叉验证或可引用数字的数据:例如 Kimi K2.6 目前主要依赖第三方文章列出的 SWE-Bench 数字,而 DeepSeek V4 在本文来源中没有足够 benchmark 可引用。[

32][

34]

按这个标准,当前最清楚的结论是:Claude Opus 4.7 在 SWE-Bench Pro 领先 GPT-5.5,GPT-5.5 在 Terminal-Bench 2.0 领先 Claude Opus 4.7;Kimi K2.6 的 SWE-Bench 数字有看点但证据等级较低;DeepSeek V4 暂列为数据不足。[21][

32][

34]

真正的模型选型不应停在榜单。把这张表当作初筛之后,下一步应在自己的 repo、编程语言、测试环境、工具链、成本预算、延迟要求和失败恢复机制下重测。这样得到的结果,通常比一个“四模型总排名”更接近真实生产表现。