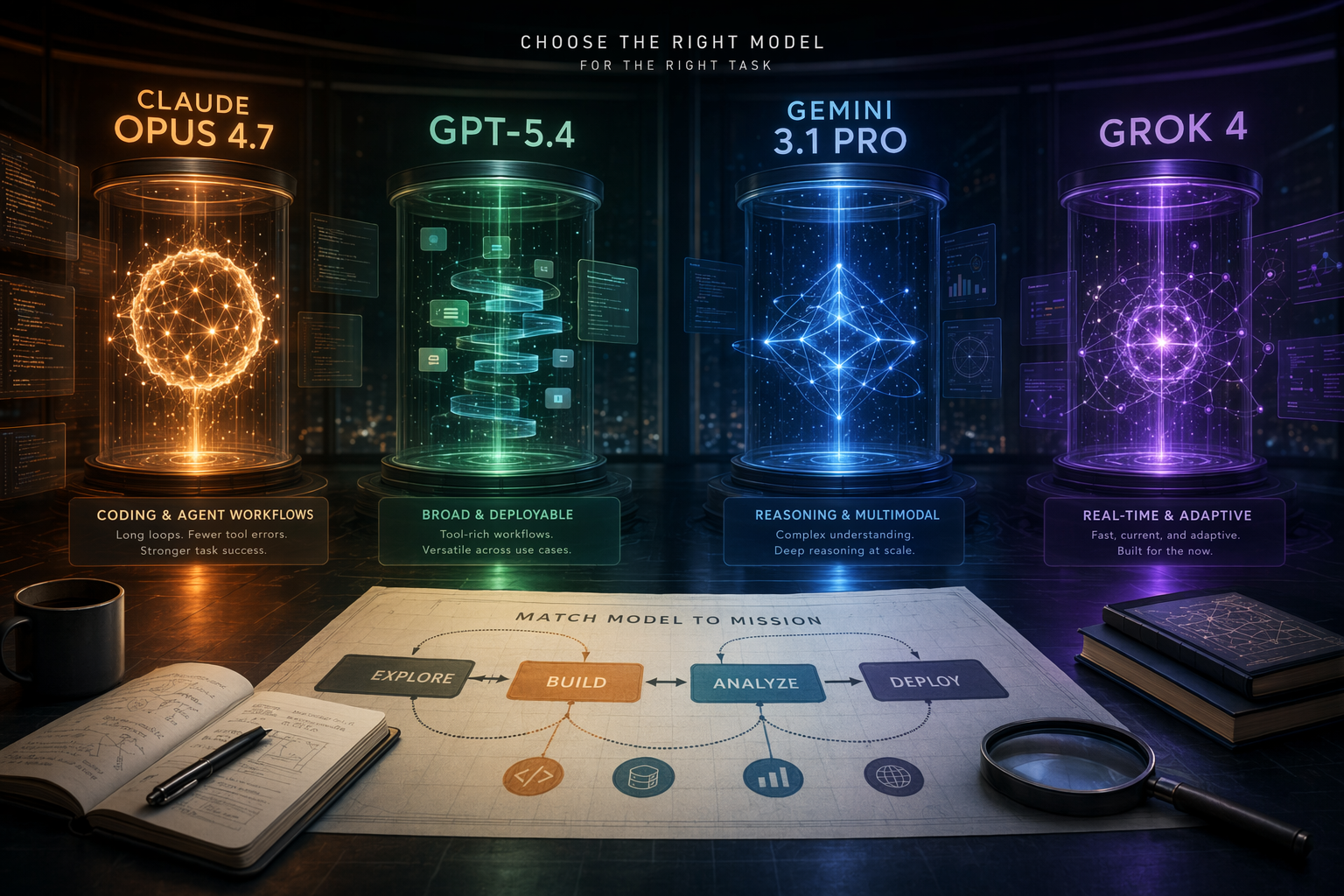

把 Claude Opus 4.7、GPT-5.4、Gemini 3.1 Pro、Grok 4 摆在一起时,最有用的问题不是“谁绝对第一”,而是:你的任务最容易在哪一步翻车?

第三方大语言模型(LLM)选型指南给出的核心判断是:没有单一模型能统治所有任务。不同模型在编程、结构化推理、多模态输入、科学题和高难推理上各有优势。[5] 对团队来说,这意味着选型不能只看排行榜名次,而要看真实工作流里的失败模式。

快速选型表

| 你的主要任务 | 建议优先测试 | 现有证据 | 需要保留的判断 |

|---|---|---|---|

| 复杂编程、智能体(agent)工作流、稳定工具调用 | Claude Opus 4.7 | Anthropic 称 Opus 4.7 相比 Opus 4.6,在 Factory Droids 任务成功率上提升 10% 至 15%,工具错误更少、可靠性更高;Axios 也将其描述为编程和视觉能力升级的旗舰模型。[ | 这些证据主要说明 Opus 4.7 相比 Opus 4.6 有升级,并不能直接证明它在同条件下全面胜过另外三家模型。 |

| 严格流程、结构化推理、电脑操作类任务 | GPT-5.4 | 第三方指南称 GPT-5.4 擅长 structured reasoning 和 computer use,并列出 OSWorld 75%。[ | 仍需用你的工具链、流程和错误标准实测。 |

| 多模态输入、抽象推理、科学题、研究辅助 | Gemini 3.1 Pro | 第三方指南称 Gemini 3.1 Pro 在 abstract reasoning、多模态输入和科学基准上领先,并列出 GPQA 94.3%。[ | 多模态和科学基准强,不等于编程智能体或长流程工具使用一定最强。 |

| 高难推理基准 | Grok 4 | 第三方指南称 Grok 4 在 HLE 指标领先,数值为 50.7%。[ | 单一高难推理指标不能直接外推为一般企业工作流全面胜出。 |

| 成本控制、供应商多元化、开源或准开源替代探索 | MiniMax、GLM、Kimi 等也可列入备选 | 同一指南称 MiniMax M2.5/M2.7、GLM-5/5.1、Kimi K2.5 等新模型在 SWE-bench 类任务上已接近前沿专有模型。[ | SWE-bench 接近,不代表 API 稳定性、多模态、写作、安全和产品集成都接近。 |

Claude Opus 4.7:重点看编程和工具可靠性

Claude Opus 4.7 最值得关注的公开信号,是 Anthropic 对“任务成功率”和“工具错误”的强调。Anthropic 官方页面称,Claude Opus 4.7 相比 Opus 4.6,在 Factory Droids 的任务成功率上提升 10% 至 15%,并且工具错误更少、表现更可靠。[11]

这让 Opus 4.7 很适合进入软件工程和智能体工作流的第一轮评估。此类任务的失败,往往不是某一道题答错,而是多步骤过程中工具调用不稳、上下文处理出错、改错文件,或者需要人反复介入返工。Axios 对 Opus 4.7 的报道也把它描述为 Anthropic 旗舰模型的一次有意义升级,重点包括更好的编程能力和更清晰的视觉能力。[12]

但要注意,最稳妥的解读是:Opus 4.7 相对 Opus 4.6 有明确升级。至于它是否全面胜过 GPT-5.4、Gemini 3.1 Pro 或 Grok 4,现有可引用来源不足以下这个结论。[11][

5]

GPT-5.4:适合先测结构化推理和 computer use

如果你的任务更像是按规则走流程、处理表格、执行桌面操作、编排工具或做多步骤决策,GPT-5.4 应进入第一轮比较。第三方 LLM 选型指南称,GPT-5.4 在 structured reasoning 和 computer use 上表现突出,并列出 OSWorld 75%。[5]

这并不意味着 GPT-5.4 在所有任务中都胜过 Opus 4.7。更合理的用法是:如果你的失败成本主要来自步骤错误、流程控制错误或操作型任务,就把 GPT-5.4 和 Opus 4.7 放在同一批真实任务里测试。[5]

Gemini 3.1 Pro:多模态、抽象推理和科学题优先

如果你的输入经常包含图片、图表、文档截图、科研材料或科学题,Gemini 3.1 Pro 应优先纳入候选。第三方指南称,Gemini 3.1 Pro 在 abstract reasoning、多模态输入和科学基准上居前,并列出 GPQA 94.3%。[5]

这里的关键不是品牌,而是任务形态。若真实工作流里有大量视觉输入或科学内容,只用编程基准来选模型,可能会错过 Gemini 3.1 Pro 的主要优势。[5]

Grok 4:高难推理有亮点,但别过度外推

Grok 4 在部分高难推理指标上值得关注。第三方指南称,Grok 4 在 HLE 指标上领先,数值为 50.7%。[5]

不过,HLE 这类成绩不应直接等同于一般商务工作流、内容质量、编程智能体或工具使用能力的全面胜利。另一篇模型排名文章也提醒:基准测试有用,但日常构建体验往往会被可靠性、UI 能力和成本影响。[6]

为什么不能只看排行榜?

第一,排行榜经常混合不同基准和不同更新时间。 Failing Fast 的 AI coding model comparison 列出的数据来源包括 SWE-bench、Aider 和 Arena Code,而且来源日期并不完全一致,例如 SWE-bench 为 2026 年 2 月,Aider 为 2025 年 10 月,Arena Code 为 2026 年 2 月。[2] 这类表格适合提供方向感,但不应被当作所有模型在同一天、同条件下的绝对排名。

第二,官方自我比较和第三方跨模型整理不是同一种证据。 Anthropic 的 Opus 4.7 资料最能支持的是它相对 Opus 4.6 的提升;第三方指南能提供跨模型选型线索,但它不是 OpenAI、Google、xAI 和 Anthropic 共同发布的官方头对头评测。[11][

5]

第三,真实产品体验会被基准之外的因素左右。 模型排名文章明确提醒,benchmark 有用,但日常构建体验常受可靠性、UI 能力和成本影响。[6]

上线前的实测清单

做采购、上线或团队标准化时,不要只问“哪个模型最强”。更稳妥的做法,是用同一组真实任务测试 3 到 5 个候选模型:

- 选 5 到 10 个每天真的会跑的任务,例如修 bug、加功能、重构、阅读长文档、分析截图、产出规格说明或调用工具。

- 对所有模型使用相同 prompt、相同背景资料和相同完成标准。

- 记录一次通过率、返工次数、工具错误、幻觉、延迟、成本和人工修正时间。

- 不只看最佳答案,也要看最差答案;模型上线后,失败模式通常比演示案例更重要。

- 如果任务涉及敏感数据、合规或隐私要求,还要单独检查数据保留、部署方式和企业控制能力。

最终判断

Claude Opus 4.7 是编程、智能体工作流和可靠工具使用场景里的第一轮候选。Anthropic 的官方说法显示,它相较 Opus 4.6 在 Factory Droids 任务成功率和工具错误上有明确改善;Axios 也把 Opus 4.7 描述为在编程和视觉能力上升级的旗舰模型。[11][

12]

但如果问题是“谁是全能第一”,目前可引用证据并不够。第三方指南给出的结论更接近实际选型:没有单一模型能在所有任务上全面主宰;GPT-5.4、Gemini 3.1 Pro、Grok 4 以及新兴模型都有各自强项。[5]

最稳妥的做法是:把 Claude Opus 4.7 作为编程和智能体任务的优先候选,但用你的真实工作流,把它和 GPT-5.4、Gemini 3.1 Pro、Grok 4 放在同一套标准下测试。