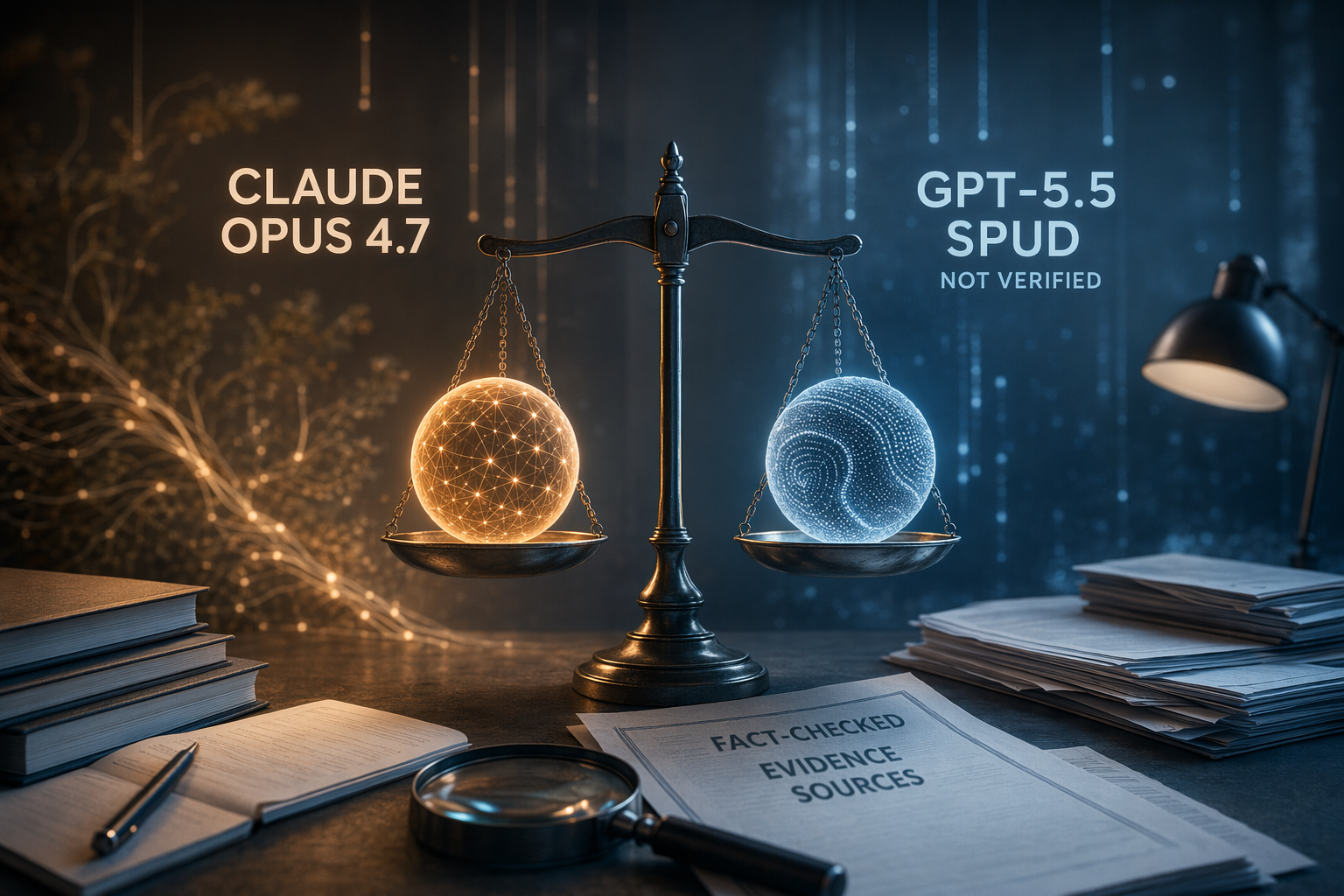

Cuộc so găng Claude Opus 4.7 với GPT-5.5 Spud nghe giống một câu hỏi bảng xếp hạng: model nào ít “ảo giác” hơn? Nhưng trước khi chấm điểm, cần kiểm tra một bước cơ bản hơn: cả hai cái tên có đều được xác minh không?

Với bằng chứng hiện có, Claude Opus 4.7 là model được Anthropic công bố và có mã API claude-opus-4-7. Trong khi đó, các nguồn OpenAI chính thức được cung cấp xác nhận GPT-5, GPT-5 mini, GPT-5.2-Codex và hướng dẫn prompt cho GPT-5.4, chứ không xác nhận một model công khai tên GPT-5.5 Spud [12][

16][

23][

25][

26][

29][

45]. Vì vậy, kết luận có trách nhiệm không phải là “Claude thắng” hay “Spud thắng”, mà là: Claude Opus 4.7 có thể đem ra đánh giá; còn GPT-5.5 Spud không nên được dùng làm mục tiêu benchmark nếu chưa gắn với tài liệu phát hành, model card hoặc API chính thức.

Kết luận có thể nói chắc

| Câu hỏi | Trả lời dựa trên bằng chứng |

|---|---|

| Claude Opus 4.7 có được xác minh không? | Có. Anthropic có tài liệu về Claude Opus 4.7 và thông báo rằng lập trình viên có thể dùng claude-opus-4-7 qua Claude API [ |

| GPT-5.5 Spud có được xác minh là model OpenAI chính thức không? | Chưa, trong các nguồn OpenAI chính thức được cung cấp. Các nguồn này nói về GPT-5, GPT-5 mini, GPT-5.2-Codex và hướng dẫn prompt cho GPT-5.4 [ |

| Spud xuất hiện ở đâu trong bộ nguồn này? | Chủ yếu trong bài đăng Reddit và một luồng feature request trên OpenAI Developer Community, không phải trong release note hay tài liệu model API [ |

| Có benchmark hallucination trực tiếp giữa Claude Opus 4.7 và GPT-5.5 Spud không? | Không có nguồn nào được cung cấp đưa ra bài test cùng nhiệm vụ, cùng cách chấm điểm cho hai tên này. Một bài test công bằng cũng phải chấm riêng hành vi từ chối trả lời khi thiếu cơ sở, thay vì gộp chung với lỗi factual [ |

Điều này không chứng minh rằng một model Spud trong tương lai hoặc nội bộ chắc chắn không tồn tại. Nó chỉ nói rằng bằng chứng hiện được dẫn không đủ để coi GPT-5.5 Spud là model OpenAI chính thức, càng không đủ để tuyên bố model nào “ít hallucination hơn”.

Claude Opus 4.7: có thật, nhưng bằng chứng chưa phải là một cuộc đối đầu

Nguồn mạnh nhất về Claude Opus 4.7 là tài liệu sản phẩm của Anthropic. Anthropic cho biết lập trình viên có thể dùng claude-opus-4-7 qua Claude API [16], còn tài liệu của hãng nói Claude Opus 4.7 bổ sung task budgets, tức cơ chế ngân sách cho tác vụ [

12]. Đây là thông tin quan trọng với người xây sản phẩm, nhưng task budgets không tự động tương đương với một benchmark công khai về khả năng “biết khi nào nên nói không biết”.

Có một tín hiệu đáng chú ý liên quan đến tính trung thực. Mashable, dẫn system card của Anthropic, đưa tin Claude Opus 4.7 đạt 91,7% MASK honesty rate và ít có xu hướng hallucinate hoặc xu nịnh người dùng hơn các model Anthropic trước đó cũng như một số model frontier khác [14]. Tuy vậy, đây vẫn không trả lời được câu hỏi Claude-versus-Spud, vì nó không phải một benchmark đối sánh trực tiếp với một model GPT-5.5 Spud đã được xác minh.

Dấu vết của Spud chưa đủ để làm chuẩn so sánh

Trong bộ nguồn này, các tài liệu OpenAI xác nhận nhiều mốc trong họ GPT-5: GPT-5, GPT-5 mini, GPT-5.2-Codex và hướng dẫn prompt cho GPT-5.4 [23][

25][

26][

29][

45]. Còn “Spud” xuất hiện trong các bài Reddit và một luồng yêu cầu tính năng trên OpenAI Developer Community [

7][

8][

10][

28].

Với người không theo sát hệ sinh thái developer, điểm này rất quan trọng: một diễn đàn cộng đồng hoặc bài đăng Reddit có thể là tín hiệu thảo luận, nhưng không tương đương với trang model chính thức, model card, mã API hay thông báo phát hành. Nếu benchmark dùng một nhãn chưa xác minh, kết quả sẽ dễ biến thành so sánh giữa tin đồn và tài liệu chính thức.

OpenAI cho thấy vấn đề nằm ở cách đo, không chỉ ở tên model

Tài liệu giải thích hallucination của OpenAI hữu ích hơn cho thiết kế đánh giá. OpenAI lập luận rằng nhiều quy trình huấn luyện và đánh giá phổ biến đang thưởng cho việc đoán, thay vì thưởng cho việc thừa nhận không chắc chắn. Theo OpenAI, model nên thể hiện sự không chắc chắn hoặc hỏi lại để làm rõ, thay vì đưa ra thông tin sai nhưng nói với giọng tự tin [3].

Ví dụ SimpleQA của OpenAI cho thấy vì sao chỉ nhìn accuracy có thể gây hiểu nhầm. OpenAI liệt kê gpt-5-thinking-mini với 52% abstention, 22% accuracy và 26% error; trong khi o4-mini có 1% abstention, 24% accuracy và 75% error [3]. Model đầu trả lời ít hơn, nhưng sai ít hơn rất nhiều trong ví dụ đó [

3]. Với sản phẩm thực tế, đặc biệt ở nơi câu trả lời sai có thể gây hậu quả, khác biệt giữa “không đủ dữ kiện” và “tự tin nói sai” là rất lớn.

Thước đo đúng hơn: biết nói “không biết” đúng lúc

Kiểm soát hallucination không có nghĩa là model từ chối mọi thứ. Một model hữu ích cần trả lời khi bằng chứng đủ mạnh, hỏi lại khi yêu cầu mơ hồ, và từ chối hoặc nói chưa đủ cơ sở khi câu trả lời không thể được hỗ trợ. Đó là ý nghĩa thực tế của calibrated uncertainty — độ bất định được hiệu chỉnh.

Nghiên cứu ủng hộ cách nhìn này, dù vẫn còn nhiều giới hạn. Một nghiên cứu năm 2024 cho biết abstention dựa trên bất định có thể cải thiện độ đúng, giảm hallucination và tăng an toàn trong bối cảnh hỏi đáp [1][

4]. I-CALM mô tả epistemic abstention là việc từ chối trả lời các câu hỏi factual có đáp án kiểm chứng được, đồng thời lưu ý rằng LLM hiện nay vẫn có thể không từ chối khi đáng lẽ nên từ chối [

54]. Một hướng khác, behaviorally calibrated reinforcement learning, nghiên cứu cách khuyến khích model thừa nhận bất định bằng cách abstain khi phù hợp [

61].

Các tổng quan rộng hơn cũng xem uncertainty quantification là công cụ phát hiện hallucination, và coi calibrated uncertainty là yếu tố giúp người dùng quyết định khi nào nên tin, chuyển cho người khác xử lý, hoặc kiểm chứng thêm câu trả lời của model [53][

55]. Nhưng điểm mấu chốt là phải hiệu chỉnh đúng: model nói “không biết” quá nhiều thì an toàn nhưng kém hữu ích; model không bao giờ abstain thì tiện lợi nhưng rủi ro.

Nếu muốn benchmark nghiêm túc, nên làm thế nào?

- Dùng model ID chính thức. Với Claude, có thể kiểm tra

claude-opus-4-7; với OpenAI, hãy chọn model đã có tài liệu như GPT-5 hoặc GPT-5 mini, thay vì nhãn Spud chưa được xác minh [16][

23][

25][

29].

- Tạo tập câu hỏi pha trộn. Nên có câu hỏi trả lời được, yêu cầu còn thiếu thông tin và câu hỏi không thể trả lời. Nghiên cứu về abstention tập trung chính vào giá trị của việc từ chối khi độ bất định cao hoặc câu hỏi không thể trả lời an toàn [

1][

4].

- Chấm abstention riêng. Đừng chỉ có đúng/sai. Hãy theo dõi câu trả lời đúng, câu trả lời sai, từ chối đúng và từ chối sai. Khảo sát về abstention nêu các chỉ số riêng như abstention accuracy, precision và recall [

68].

- Tách bất định factual khỏi từ chối vì an toàn. Từ chối nội dung nguy hiểm không giống với việc nói “không đủ bằng chứng” cho một câu hỏi factual. I-CALM tập trung vào epistemic abstention đối với câu hỏi có đáp án kiểm chứng được [

54].

- Báo cáo accuracy, error rate và abstention rate cùng lúc. Ví dụ SimpleQA của OpenAI cho thấy một model abstain nhiều hơn có thể có accuracy tương tự nhưng error rate thấp hơn đáng kể [

3].

- Giữ môi trường thử nghiệm như nhau. Retrieval, duyệt web, quyền dùng công cụ, độ dài ngữ cảnh và system instructions đều có thể làm thay đổi kết quả. Nếu một model được cấp thêm bằng chứng còn model kia thì không, benchmark đang đo cả thiết lập hệ thống chứ không chỉ đo model.

Câu hỏi thường gặp

GPT-5.5 Spud có thật không?

Trong các bằng chứng được cung cấp ở đây, GPT-5.5 Spud chưa được xác minh là model OpenAI chính thức. Các nguồn OpenAI chính thức được dẫn nói về GPT-5, GPT-5 mini, GPT-5.2-Codex và hướng dẫn prompt cho GPT-5.4; còn Spud xuất hiện trong Reddit và một luồng feature request cộng đồng [7][

8][

10][

23][

25][

26][

28][

29][

45].

Claude Opus 4.7 có ít hallucination hơn GPT-5.5 Spud không?

Không thể trả lời nghiêm ngặt từ các nguồn này. Claude Opus 4.7 có tài liệu chính thức [12][

16], và có nguồn thứ cấp đưa tin về 91,7% MASK honesty rate [

14]. Nhưng chưa có mục tiêu GPT-5.5 Spud đã được xác minh và cũng chưa có benchmark chung cho hai tên này [

7][

8][

10][

28][

68].

Người mua API hoặc đội xây sản phẩm nên so sánh gì?

Hãy so Claude Opus 4.7 với các model OpenAI đã có tài liệu, trên cùng nhiệm vụ, cùng công cụ, cùng prompt và cùng quy tắc chấm điểm. Bộ chỉ số nên gồm accuracy, error rate và hành vi abstention, thay vì chỉ nhìn một con số accuracy [3][

68].

Chốt lại

Đừng rút ra kết luận “Claude thắng” hay “Spud thắng” về hallucination từ bộ bằng chứng này. Kết luận có thể bảo vệ là: Claude Opus 4.7 được Anthropic tài liệu hóa chính thức; GPT-5.5 Spud chưa được xác minh trong các tài liệu OpenAI chính thức được dẫn; và cách đánh giá kiểm soát hallucination tốt hơn là thưởng cho calibrated uncertainty, bao gồm việc abstain đúng khi một khẳng định không có đủ cơ sở [3][

12][

16][

23][

25][

29][

45][

68].