ZAYA1-8B nên được đọc như một câu chuyện về hiệu quả, không phải như một tuyên bố rằng một mô hình nhỏ đã hạ bệ mọi hệ thống AI tuyến đầu. Điểm khiến nó đáng chú ý là Zyphra báo cáo kết quả suy luận, toán và lập trình mạnh từ một mô hình Mixture-of-Experts có phần đang hoạt động rất nhỏ: 8,4 tỷ tham số tổng và 760 triệu tham số đang hoạt động [1][

6].

Trong cuộc đua AI, người ta thường nhìn vào quy mô: mô hình lớn hơn, nhiều tham số hơn, cụm phần cứng đồ sộ hơn. ZAYA1-8B đặt câu hỏi khác: nếu kiến trúc, dữ liệu huấn luyện và hậu huấn luyện đủ tốt, một mô hình có “dấu chân” tính toán nhỏ hơn có thể đi xa đến đâu?

ZAYA1-8B là gì?

ZAYA1-8B là một mô hình ngôn ngữ nhỏ theo kiến trúc Mixture-of-Experts, thường viết tắt là MoE, do Zyphra xây dựng. Model card trên Hugging Face liệt kê mô hình này có 8,4 tỷ tham số tổng, 760 triệu tham số đang hoạt động và được Zyphra huấn luyện end-to-end [6].

Điểm “tổng” so với “đang hoạt động” là chìa khóa. Với MoE, có thể hiểu nôm na mô hình gồm nhiều nhóm chuyên gia, nhưng mỗi bước xử lý chỉ kích hoạt một phần trong số đó. Vì vậy, kích thước được ghi trên nhãn và lượng tính toán thực sự dùng khi suy luận không nhất thiết trùng nhau. Zyphra và thông báo của hãng mô tả ZAYA1-8B là mô hình có dưới 1 tỷ tham số hoạt động dù tổng tham số là 8,4 tỷ [4][

6].

Zyphra cho rằng hiệu quả của ZAYA1-8B đến từ sự kết hợp giữa kiến trúc, tiền huấn luyện và hậu huấn luyện. Model card cũng nói mô hình được tập trung cho suy luận dài, chi tiết, đặc biệt trong các bài toán toán học và lập trình [6].

So sánh đúng: năng lực trên mỗi tham số hoạt động

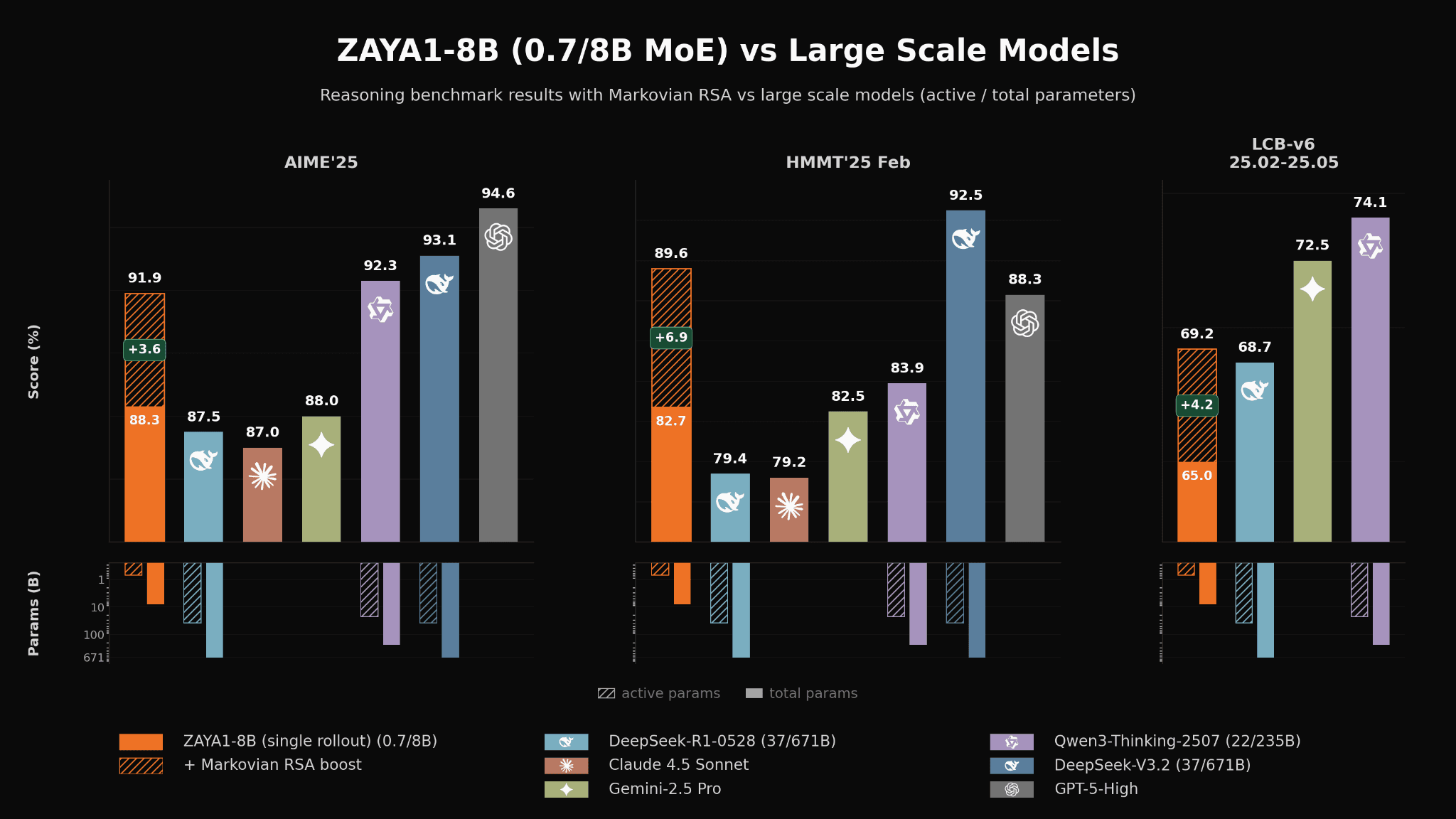

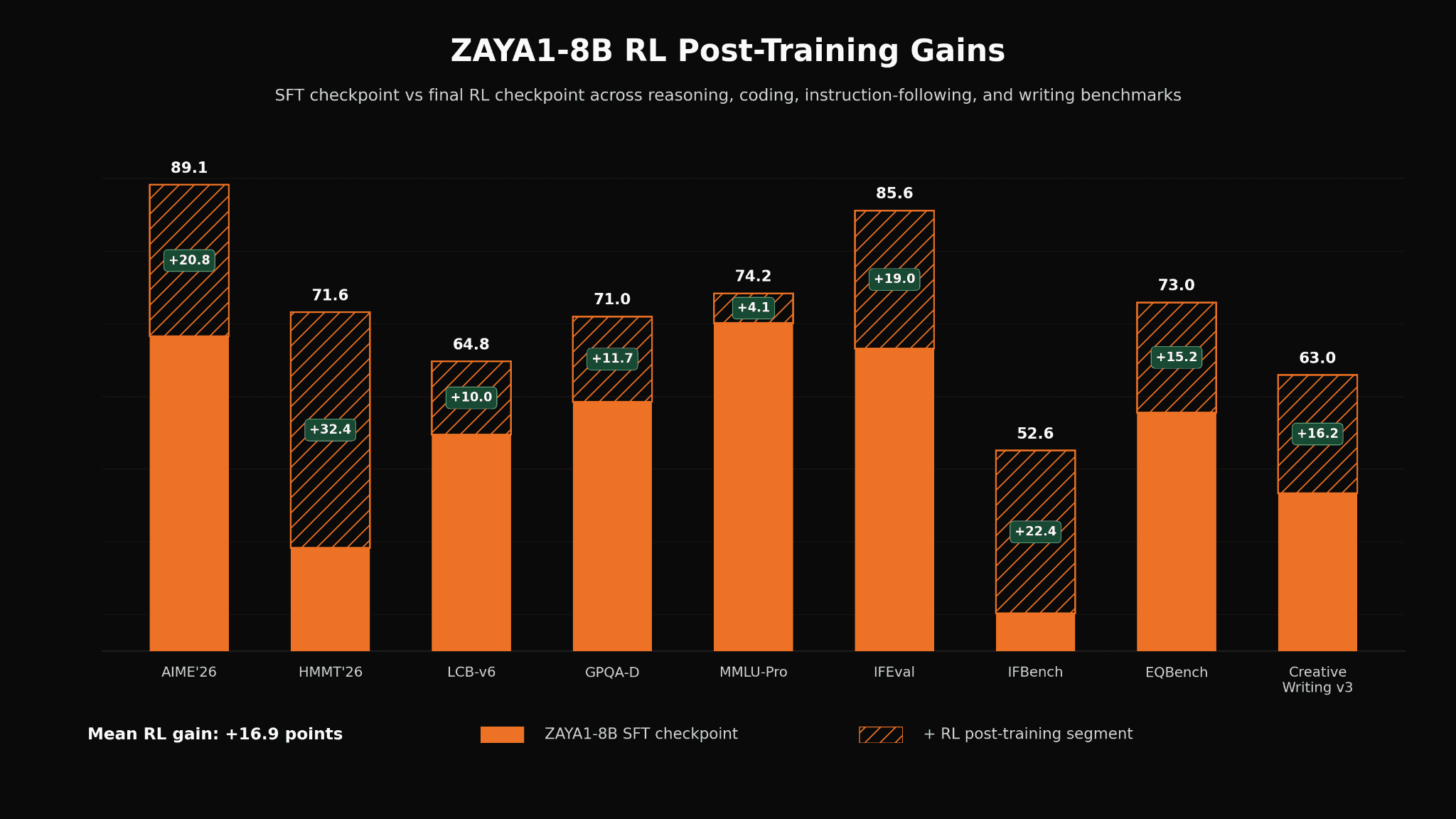

Cách đọc hợp lý nhất về ZAYA1-8B không phải là tìm xem nó có đứng đầu mọi bảng xếp hạng hay không. Luận điểm mạnh hơn là “mật độ năng lực”: với phần tham số đang hoạt động nhỏ như vậy, mô hình có thể tạo ra bao nhiêu năng lực suy luận hữu ích?

Zyphra nói ZAYA1-8B thể hiện tốt ở các nhiệm vụ suy luận phức tạp, toán học và lập trình, đồng thời vượt các mô hình trọng số mở lớn hơn đáng kể trên một số benchmark toán và coding [1]. Thông báo của công ty cũng nói mô hình có thể ngang bằng hoặc vượt các mô hình trọng số mở lớn hơn nhiều lần ở suy luận phức tạp, toán và lập trình trong khi dùng dưới 1 tỷ tham số hoạt động [

4].

Đó là lý do ZAYA1-8B được đặt cạnh các mô hình lớn hơn. Nếu các kết quả được tái lập rộng rãi, thông điệp ở đây là năng lực kiểu frontier không chỉ phụ thuộc vào tổng số tham số. Với những bối cảnh phải suy luận nhiều lượt, phần tham số hoạt động nhỏ hơn có thể là lợi thế đáng kể. Model card của Zyphra cũng nhấn mạnh hiệu quả suy luận và kích thước nhỏ là lý do mô hình có thể hữu ích trong các cơ chế tăng tính toán ở thời điểm suy luận, hay test-time compute harnesses [6].

Vì sao câu chuyện huấn luyện trên AMD đáng chú ý

ZAYA1-8B còn gây chú ý vì cách nó được huấn luyện. Zyphra nói đây là mô hình MoE đầu tiên được tiền huấn luyện, midtraining và tinh chỉnh có giám sát trên ngăn xếp AMD Instinct MI300 [1]. Thông báo của công ty mô tả mô hình được huấn luyện trên hạ tầng AMD toàn stack [

4].

Một số bài viết thứ cấp cũng nhấn mạnh rằng ZAYA1-8B được xây dựng trên silicon AMD thay vì phần cứng Nvidia [3]. Kết luận thận trọng không phải là AMD “đánh bại” Nvidia trong mọi trường hợp. Điểm được nguồn tin hỗ trợ là Zyphra đang đưa ra một ca huấn luyện MoE cao cấp có vẻ đáng chú ý trên một ngăn xếp tăng tốc thay thế [

1][

3][

4].

Nhà phát triển có thể kiểm tra gì?

ZAYA1-8B đã có trang trên Hugging Face, nơi nhà phát triển có thể đọc model card và xem chi tiết phát hành [6]. Một bài viết thứ cấp cho biết mô hình có sẵn trên Hugging Face theo giấy phép Apache 2.0 và cũng có dạng endpoint serverless trên Zyphra Cloud [

5].

Điều này quan trọng vì các tuyên bố về hiệu quả sẽ có giá trị hơn khi cộng đồng có thể tự chạy thử, benchmark hoặc tích hợp mô hình vào quy trình của mình. Dù vậy, một model card công khai không đồng nghĩa với việc mô hình đã được kiểm chứng độc lập trên đủ loại tải công việc thực tế.

Điều ZAYA1-8B chưa chứng minh

ZAYA1-8B nên được xem là một kết quả hiệu quả đầy hứa hẹn, không phải phán quyết cuối cùng cho cuộc đua mô hình frontier. Nhiều tuyên bố hiện có đến từ bài nghiên cứu, model card, thông báo của Zyphra hoặc các bài viết thứ cấp [1][

4][

5][

6][

9].

Các nguồn hiện nhấn mạnh toán, lập trình và suy luận dài; chúng không chứng minh mô hình vượt trội trên mọi nhiệm vụ [1][

6]. VentureBeat viết rằng ZAYA1-8B có hiệu năng cạnh tranh trên các benchmark của bên thứ ba so với GPT-5-High và DeepSeek-V3.2, nhưng đó vẫn là so sánh benchmark, chưa phải bằng chứng rằng nó là mô hình tổng quát tốt hơn trong mọi môi trường sản xuất [

9].

Cách đọc công bằng hơn là: ZAYA1-8B dường như đẩy được năng lực suy luận được báo cáo lên mức cao bất thường so với một mô hình có dưới 1 tỷ tham số hoạt động. Điều đó đáng chú ý, ngay cả khi nó chưa trả lời mọi câu hỏi về hiệu năng thực tế trước các hệ thống lớn hơn.

Kết luận

ZAYA1-8B quan trọng vì nó biến hiệu quả thành điểm chính. Với 8,4 tỷ tham số tổng, 760 triệu tham số hoạt động, kết quả suy luận/toán/lập trình được Zyphra báo cáo là mạnh và quá trình huấn luyện end-to-end trên AMD, mô hình này thách thức giả định rằng năng lực suy luận hữu ích kiểu frontier luôn cần ngân sách tham số hoạt động khổng lồ [1][

4][

6].

Nhận định an toàn lúc này là: đáng kể, đủ đáng tin để theo dõi sát, nhưng chưa phải kết luận đã được độc lập xác lập rộng rãi. Nếu các kết quả được tái lập trên nhiều môi trường, ZAYA1-8B sẽ là một tín hiệu rằng cuộc đua AI không chỉ nằm ở kích thước mô hình, mà còn ở kiến trúc, công thức huấn luyện, hậu huấn luyện và sự đa dạng của hạ tầng phần cứng [1][

6].