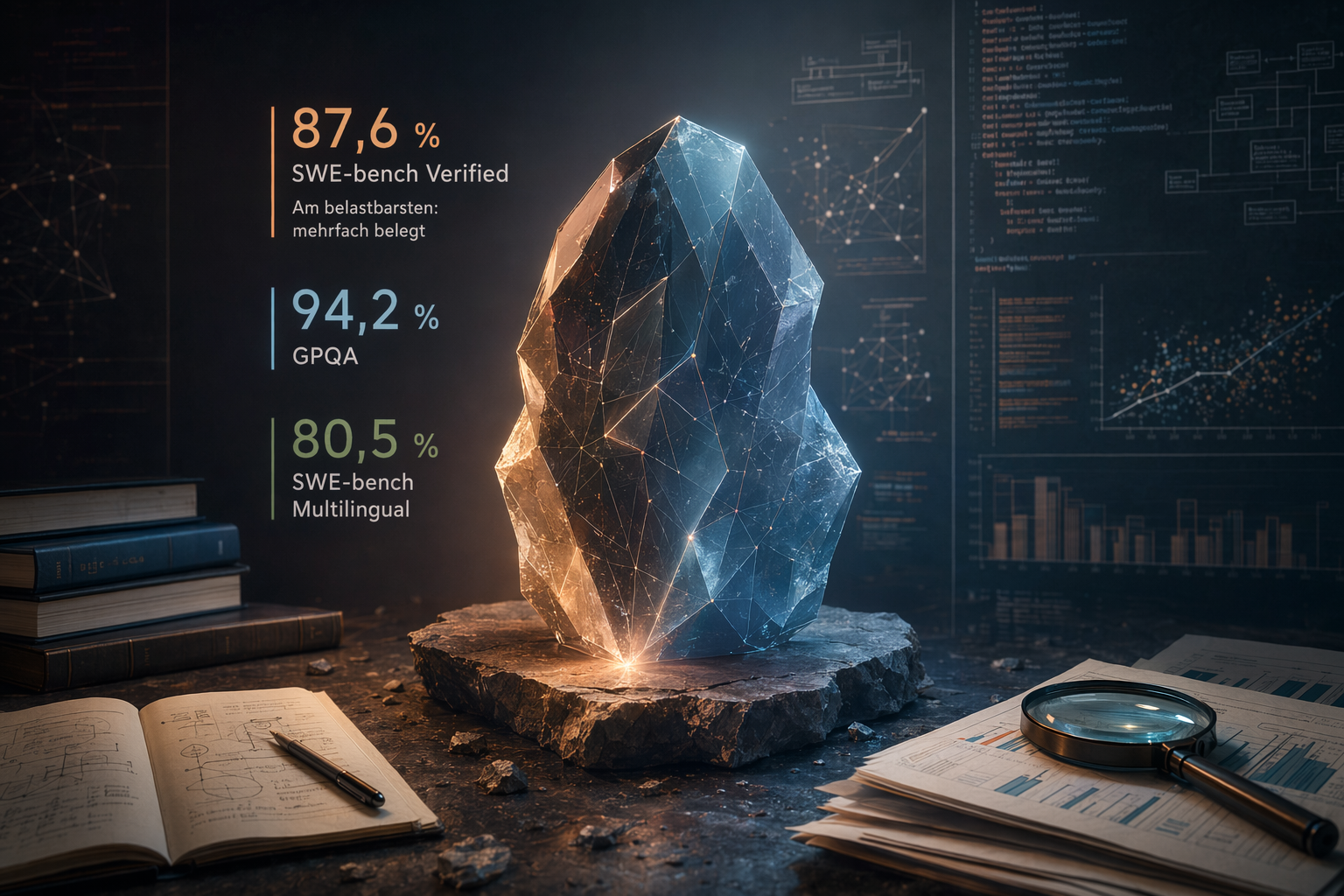

Nếu chỉ cần một bản tóm tắt gọn: Claude Opus 4.7 hiện được nhắc đến với 87,6% trên SWE-bench Verified, 94,2% trên GPQA và 80,5% trên SWE-bench Multilingual. Trong đó, SWE-bench Verified là mốc chắc tay nhất trong bộ nguồn hiện có, vì cùng một con số 87,6% được nhiều nguồn công khai nêu lại. [4][

5]

Ba con số chính, đọc sao cho đúng

| Benchmark | Điểm được nêu cho Claude Opus 4.7 | Cách nên hiểu |

|---|---|---|

| SWE-bench Verified | 87,6% | Mốc công khai mạnh nhất cho năng lực coding trong các nguồn hiện có; điểm này được nhắc ở nhiều nguồn. [ |

| GPQA | 94,2% | LLM-Stats nêu rõ con số này, nhưng đoạn trích Anthropic hiện có không hiển thị một bảng benchmark đầy đủ để đối chiếu trực tiếp. [ |

| SWE-bench Multilingual | 80,5% | Một nguồn khác nêu 80,5%, đồng thời so với 77,8% của Opus 4.6; nên xem là tín hiệu hữu ích nhưng cần kiểm chứng thêm. [ |

Bảng trên cố ý giữ cách đọc thận trọng: chỉ lấy các con số đã xuất hiện rõ trong những nguồn được cung cấp. Với việc mua dịch vụ, tích hợp API hoặc chuyển đổi mô hình trong hệ thống đang chạy, benchmark công khai chỉ nên là bước sàng lọc ban đầu, không thay thế đánh giá trên dữ liệu và quy trình thật.

Vì sao SWE-bench Verified là mốc đáng tin hơn cả

Điểm 87,6% trên SWE-bench Verified là con số được củng cố tốt nhất cho Claude Opus 4.7 trong các nguồn hiện có. Cả một bài viết về benchmark và migration lẫn LLM-Stats đều nêu cùng mức điểm này. [4][

5]

LLM-Stats còn mô tả 87,6% là mức tăng 6,8 điểm phần trăm so với Opus 4.6. [5] ALM Corp cũng xếp Opus 4.7 vào nhóm mô hình có hiệu năng mạnh hơn ở các workflow coding khó và workflow kiểu agent. [

6]

Với đội ngũ kỹ thuật phần mềm, cách dùng hợp lý là xem SWE-bench Verified như “điểm neo” công khai để so sánh ban đầu. Nhưng câu hỏi quan trọng hơn vẫn là: mô hình xử lý ra sao trên kho mã của chính bạn, với bộ test, quy tắc review, toolchain và tiêu chí chấp nhận thật của nhóm?

GPQA: tín hiệu mạnh, nhưng chưa nên đọc như bằng chứng duy nhất

Con số 94,2% trên GPQA được LLM-Stats nêu rõ trong phần thông tin về Claude Opus 4.7. [5] Nguồn chính thức từ Anthropic vẫn quan trọng vì xác nhận nhà phát triển có thể dùng

claude-opus-4-7 qua Claude API, nhưng phần trích dẫn hiện có không cho thấy đầy đủ một bảng benchmark có thể đối chiếu trực tiếp với con số GPQA. [7]

Vì vậy, GPQA nên được xem là một tín hiệu bổ sung đáng chú ý cho năng lực reasoning, nhưng cần cân nhắc thận trọng hơn so với SWE-bench Verified. Nếu GPQA là tiêu chí then chốt cho quyết định mua, migrate hoặc chọn mô hình, nhóm nên kiểm tra lại bằng tài liệu gốc đầy đủ hoặc bằng bộ đánh giá nội bộ. [5][

7]

SWE-bench Multilingual: đáng quan tâm cho codebase đa ngôn ngữ

Với các dự án có nhiều ngôn ngữ lập trình, nhiều stack khác nhau hoặc môi trường phát triển không chỉ xoay quanh tiếng Anh, điểm 80,5% trên SWE-bench Multilingual là một chỉ dấu đáng chú ý. Một nguồn nêu điểm này và đặt cạnh mức 77,8% của Opus 4.6. [9]

Tuy nhiên, mức độ xác nhận của con số này mỏng hơn so với SWE-bench Verified. Vì thế, nó nên được dùng như một gợi ý để đưa vào danh sách kiểm thử, không phải kết luận cuối cùng rằng mô hình sẽ chắc chắn tốt hơn trên mọi codebase đa ngôn ngữ.

Benchmark chưa nói hết câu chuyện

Claude Opus 4.7 không chỉ được giới thiệu bằng điểm số. VentureBeat mô tả đây là mô hình ngôn ngữ lớn mạnh nhất mà Anthropic công khai phát hành ở thời điểm đó. [1] ALM Corp gọi Opus 4.7 là mẫu Opus đã được cung cấp rộng rãi, hướng tới các workflow coding nâng cao, tác vụ agent chạy dài, xử lý tài liệu, thị giác độ phân giải cao và công việc chuyên nghiệp. [

6]

Khi đưa vào sản phẩm thật, một vài yếu tố ngoài benchmark có thể ảnh hưởng trực tiếp đến chất lượng, độ trễ và chi phí:

- Cửa sổ ngữ cảnh: LLM-Stats nêu cửa sổ ngữ cảnh 1 triệu token. [

5]

- Xử lý hình ảnh: LLM-Stats nêu khả năng xử lý vision độ phân giải cao hơn 3,3 lần. [

5]

- Mức effort mới: LLM-Stats và ALM Corp đều nhắc đến mức

xhigh. [5][

6]

- Tokenizer mới: ALM Corp lưu ý tokenizer được cập nhật có thể làm số token tăng lên với cùng một đầu vào. [

6]

Điểm cuối đặc biệt đáng kiểm tra trước khi migrate. Nếu cùng một prompt hoặc cùng một tài liệu bị tính nhiều token hơn, ngân sách, giới hạn ngữ cảnh và độ trễ thực tế đều có thể thay đổi. [6]

Gợi ý thực tế cho nhóm kỹ thuật

Nếu trọng tâm là coding: Hãy bắt đầu từ SWE-bench Verified. Trong các nguồn hiện có, 87,6% là con số được chống đỡ tốt nhất. [4][

5]

Nếu trọng tâm là workflow agent: Không nên chỉ nhìn một benchmark. Cần xét thêm cách Opus 4.7 được định vị cho tác vụ coding khó, agent chạy dài và mức xhigh. [5][

6]

Nếu trọng tâm là reasoning tổng quát: GPQA 94,2% là tín hiệu đáng chú ý, nhưng trong bộ nguồn này chưa được xác nhận rộng như SWE-bench Verified. [5][

7]

Nếu có codebase đa ngôn ngữ: SWE-bench Multilingual 80,5% là một điểm tham khảo tốt, nhưng nên được kiểm chứng trên chính stack, repo và quy trình kiểm thử của nhóm. [9]

Nếu chuẩn bị đưa vào production: Hãy chạy thử với các kịch bản thật: refactor code, đọc tài liệu dài, gọi tool, xử lý hình ảnh, kiểm soát chi phí token và đo độ trễ. Những thay đổi về cửa sổ ngữ cảnh, vision, effort level và tokenizer có thể tác động mạnh không kém một điểm benchmark. [5][

6]

Kết luận

Cách đọc ngắn gọn và thận trọng nhất là: Claude Opus 4.7 đang được nêu với 87,6% trên SWE-bench Verified, 94,2% trên GPQA và 80,5% trên SWE-bench Multilingual. [4][

5][

9] Trong ba con số này, SWE-bench Verified 87,6% là mốc vững nhất vì được nhiều nguồn nhắc lại. [

4][

5]

GPQA và SWE-bench Multilingual vẫn quan trọng, nhất là khi đánh giá reasoning hoặc codebase đa ngôn ngữ. Nhưng với quyết định nghiêm túc về mô hình, hãy xem benchmark công khai là bản đồ định hướng — còn bài kiểm tra quyết định phải nằm trên workflow thật của bạn.