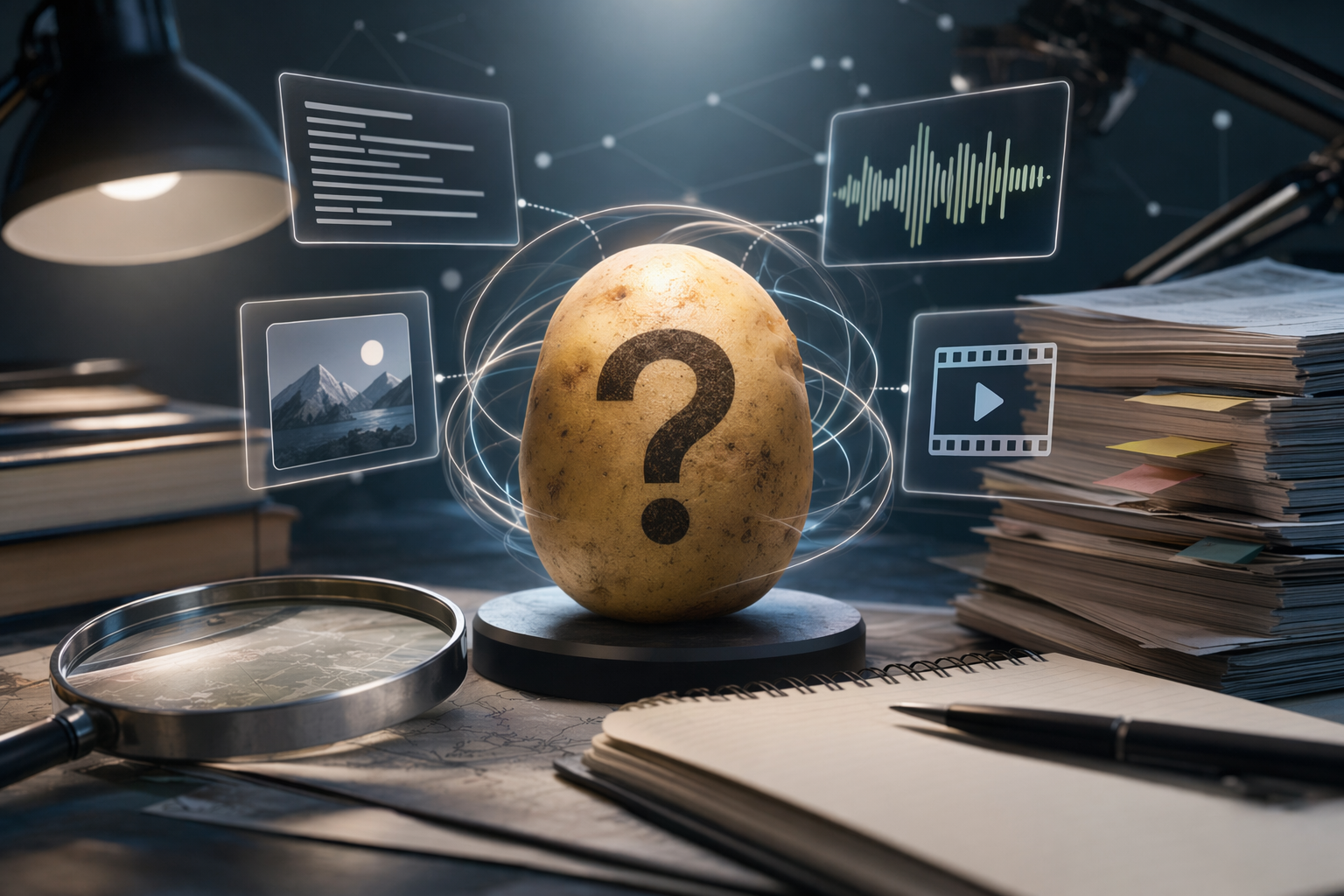

Điểm cần giữ bình tĩnh ở đây không phải là OpenAI có đi theo hướng đa phương thức hay không. Bằng chứng chính thức cho thấy hãng đã có sản phẩm và tài liệu liên quan đến văn bản, hình ảnh, âm thanh/giọng nói và video. Câu hỏi cần kiểm chứng là: các năng lực đó đã được OpenAI xác nhận là nằm trong một mô hình chính thức tên GPT-5.5 Spud hay chưa. Với các nguồn hiện có, câu trả lời là chưa: Spud chủ yếu xuất hiện trong bài viết không chính thức và bài đăng cộng đồng, còn tài liệu chính thức dẫn về GPT-4o, 4o Image Generation, Realtime API và Sora.[1][

2][

5][

6][

7][

9][

10][

11][

12][

15][

18][

20][

21][

23]

Kết luận kiểm chứng: hướng đa phương thức là thật, tên Spud chưa được xác nhận

Nếu hiểu “toàn mô thức” là một mô hình chính thức có thể xử lý nguyên sinh văn bản, hình ảnh, âm thanh/giọng nói và video trong cùng một hệ thống, thì hiện chưa nên viết GPT-5.5 Spud như một sản phẩm đã ra mắt hoặc đã được xác nhận. Cách diễn đạt chính xác hơn là: OpenAI đã công bố nhiều năng lực omni hoặc đa phương thức, nhưng các bằng chứng đó thuộc về GPT-4o, 4o Image Generation, Realtime API và Sora — không phải Spud.[12][

15][

18][

20][

21][

23]

| Điểm cần kiểm chứng | Hiện có thể nói gì | Chưa thể kết luận gì |

|---|---|---|

| Tên Spud và việc ra mắt | Các tuyên bố về Spud chủ yếu xuất hiện trong bài viết tin đồn, Threads, Reddit, YouTube, X và LinkedIn; một số nguồn cũng tự mô tả là rumors hoặc unconfirmed leaks.[ | Chưa đủ cơ sở để nói OpenAI đã phát hành GPT-5.5 Spud. |

| Mô hình omni/đa phương thức | GPT-4o System Card gọi GPT-4o là autoregressive omni model và nói mô hình có thể nhận mọi tổ hợp đầu vào gồm văn bản, âm thanh, hình ảnh và video.[ | Đây là bằng chứng chính thức cho GPT-4o, không phải cho Spud. |

| Tạo hình ảnh | OpenAI mô tả 4o Image Generation là được hỗ trợ bởi natively multimodal model và nói tạo hình ảnh nên là một năng lực chính của mô hình ngôn ngữ.[ | Không thể từ đó suy ra Spud đã kế thừa năng lực tạo hình ảnh. |

| Giọng nói và tương tác thời gian thực | Realtime API được giới thiệu để xây dựng trải nghiệm đa phương thức độ trễ thấp; bản cập nhật gpt-realtime nhắc đến mô hình speech-to-speech tiên tiến hơn và image input.[ | Không thể dùng điều này để khẳng định Spud đã thống nhất tương tác bằng giọng nói. |

| Tạo video | Tài liệu video chính thức của OpenAI hiện chỉ rõ về Sora, Sora API và ứng dụng mẫu Sora.[ | Chưa có bằng chứng Spud thay thế hoặc tích hợp Sora. |

| Hiểu video | Bài giới thiệu GPT-4.1 API nhắc đến Video-MME, một chuẩn đánh giá multimodal long context understanding, với điểm 72,0% ở hạng mục long, no subtitles và mức tăng 6,7 điểm phần trăm so với GPT-4o.[ | Đánh giá năng lực hiểu video không đồng nghĩa với việc công bố Spud. |

Vì sao tin đồn Spud dễ nghe có lý

Tin đồn về Spud dễ tạo cảm giác “có thể đúng” vì nó bám vào một hướng đi mà OpenAI đã công khai. GPT-4o System Card đã dùng ngôn ngữ “omni model”; 4o Image Generation được gắn với mô hình nguyên sinh đa phương thức; Realtime API đưa giọng nói, đầu vào hình ảnh và tương tác độ trễ thấp vào câu chuyện sản phẩm chính thức.[15][

18][

21][

23]

Với video, bức tranh cũng tương tự. Trang Sora của OpenAI giới thiệu Sora 2 là công cụ biến ý tưởng thành video có chuyển động và âm thanh; tài liệu API có mục Video generation with Sora; ứng dụng mẫu Sora cho phép tạo và remix video ngắn từ prompt văn bản và ảnh tham chiếu.[12][

13][

20] Những dữ kiện này chứng minh OpenAI có tuyến sản phẩm video, nhưng không chứng minh video đã được một mô hình GPT-5.5 Spud thống nhất đảm nhận.

Nói cách khác: việc OpenAI tiếp tục gom nhiều dạng dữ liệu vào trải nghiệm AI là suy đoán hợp lý. Nhưng lấy năng lực của GPT-4o, Realtime API và Sora rồi gán toàn bộ cho một mô hình Spud chưa được xác nhận là một bước nhảy vượt quá bằng chứng hiện có.

Tài liệu chính thức thực sự chứng minh điều gì?

GPT-4o: căn cứ “omni” rõ nhất hiện nay

GPT-4o là một trong những bằng chứng chính thức gần nhất với cuộc thảo luận về “toàn mô thức”. GPT-4o System Card của OpenAI gọi GPT-4o là autoregressive omni model và nói mô hình có thể nhận đầu vào gồm văn bản, âm thanh, hình ảnh và video.[21] Điều này ủng hộ nhận định rằng OpenAI đã có năng lực mô hình theo hướng omni, nhưng không chứng minh GPT-5.5 Spud tồn tại.

4o Image Generation: hình ảnh đã có câu chuyện sản phẩm riêng

Trong bài giới thiệu 4o Image Generation, OpenAI gọi tạo hình ảnh là một năng lực chính của mô hình ngôn ngữ và liên hệ năng lực này với natively multimodal model.[15] Đây là bằng chứng chính thức cho năng lực tạo hình ảnh, nhưng vẫn không phải bằng chứng phát hành Spud.

Realtime API: giọng nói và đa phương thức thời gian thực đã được sản phẩm hóa

Tài liệu Realtime API của OpenAI cho biết nhà phát triển có thể xây dựng trải nghiệm đa phương thức độ trễ thấp; bản cập nhật gpt-realtime nhắc đến mô hình speech-to-speech tiên tiến hơn và image input.[18][

23] Vì vậy, giọng nói và tương tác thời gian thực là năng lực sản phẩm đã được công bố. Điều chưa thể làm là viết chúng thành năng lực tích hợp sẵn của Spud.

Sora: video vẫn là một tuyến chính thức riêng biệt

Nếu câu hỏi là OpenAI có năng lực tạo video hay không, câu trả lời là có: tài liệu và trang sản phẩm chính thức chỉ rõ Sora, Sora API và ứng dụng mẫu Sora.[12][

13][

20] Nhưng nếu câu hỏi đổi thành liệu tạo video đã được GPT-5.5 Spud tiếp quản hay chưa, hiện chưa có đủ bằng chứng chính thức.

Những câu không nên viết như thể đã chắc chắn

- “GPT-5.5 Spud đã được phát hành”: các dấu vết có thể kiểm tra hiện chủ yếu đến từ mạng xã hội hoặc nội dung do người dùng tạo, không phải thông cáo chính thức của OpenAI.[

6][

10][

11]

- “Spud là mô hình fully multimodal/omnimodal”: X và một số nguồn không chính thức có mô tả kiểu này, nhưng đó vẫn là tuyên bố chưa được xác thực.[

2][

9][

10]

- “Spud sẽ tích hợp hoặc thay thế Sora”: tài liệu tạo video chính thức hiện vẫn trình bày theo tuyến Sora, Sora API và ứng dụng mẫu Sora.[

12][

13][

20]

- “OpenAI đã xác nhận Spud thống nhất văn bản, hình ảnh, giọng nói và video”: bằng chứng chính thức hiện chỉ đủ để nói về GPT-4o, 4o Image Generation, Realtime API và Sora, không phải một model ID tên Spud.[

12][

15][

18][

20][

21][

23]

Cách đọc tin này nếu bạn đang làm sản phẩm hoặc phát triển ứng dụng

Nếu đang lập kế hoạch sản phẩm, đừng đặt GPT-5.5 Spud như một phụ thuộc đã chắc chắn. Cách an toàn hơn là chia nhu cầu theo các tuyến đã phát hành: văn bản và hình ảnh thì xem GPT-4o cùng 4o Image Generation; voice agent hoặc tương tác giọng nói thời gian thực thì xem Realtime API/gpt-realtime; tạo hoặc remix video thì xem Sora và Sora API.[12][

13][

15][

18][

20][

21][

23]

Nếu sau này Spud thật sự trở thành mô hình chính thức, các tín hiệu đáng tin sẽ là trang công bố của OpenAI, system card hoặc model card, model ID rõ ràng trong tài liệu API, cùng mô tả cụ thể về năng lực và an toàn. Đó cũng là lý do GPT-4o, Realtime API và Sora có thể được kiểm chứng hiện nay: chúng có trang chính thức, system card hoặc tài liệu dành cho nhà phát triển để đối chiếu.[12][

18][

20][

21][

23]

Điểm chốt: OpenAI có bằng chứng chính thức cho hướng đa phương thức; GPT-5.5 Spud thì chưa có bằng chứng chính thức cho việc ra mắt như một mô hình toàn mô thức. Cho đến khi OpenAI công bố tài liệu hoặc thông cáo rõ ràng, Spud nên được xem là tin đồn, không phải nền tảng đã xác nhận để ra quyết định sản phẩm.[1][

2][

9][

10][

11][

12][

15][

18][

20][

21]