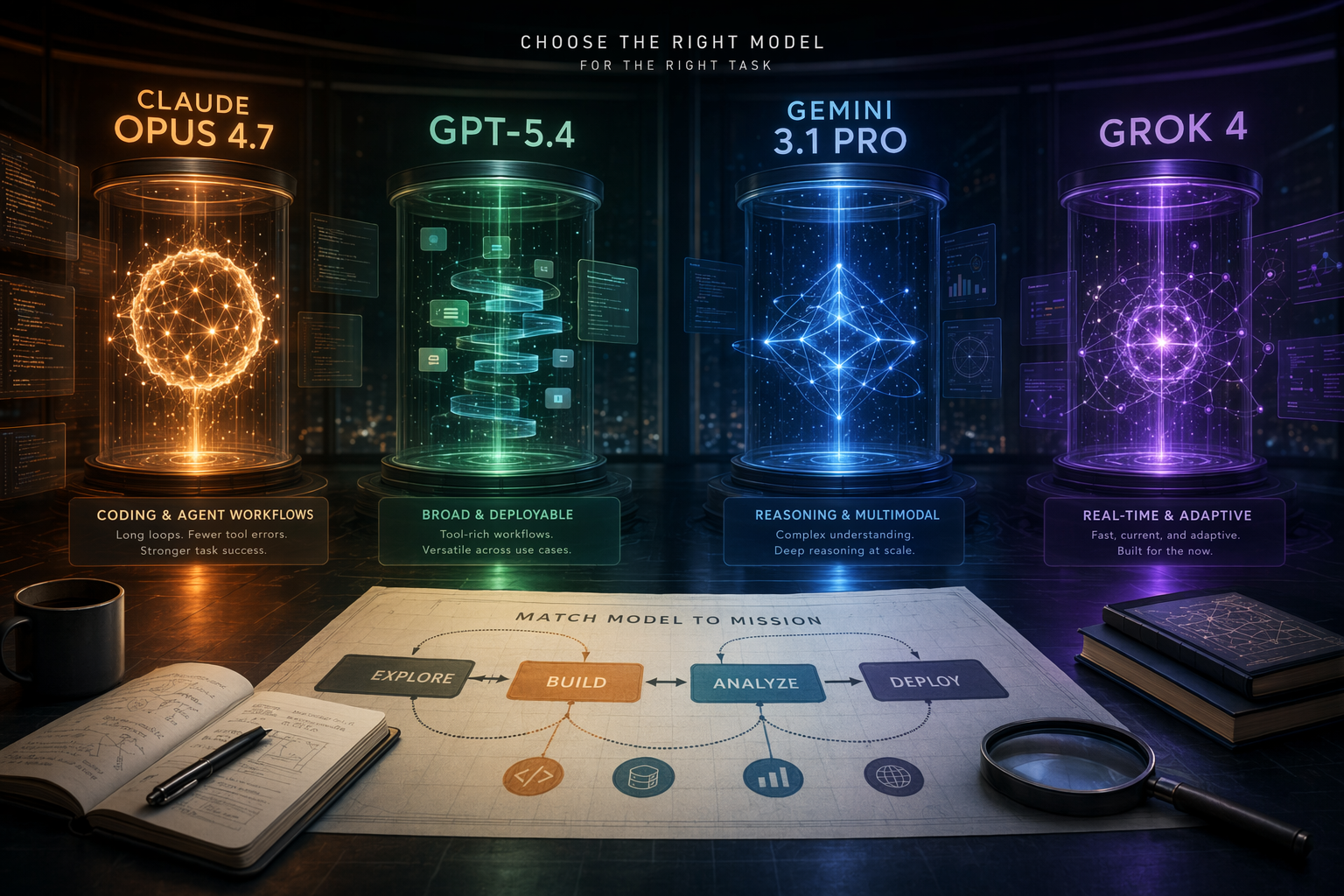

เวลาเทียบ Claude Opus 4.7 กับ GPT-5.4, Gemini 3.1 Pro และ Grok 4 คำถามที่ใช้ได้จริงไม่ใช่ ใครเก่งที่สุดแบบเด็ดขาด แต่คือ งานของคุณมักพังตรงไหนมากกว่า คู่มือเลือกโมเดล LLM จากบุคคลที่สามสรุปไว้ชัดว่า ไม่มีโมเดลเดียวที่ครองทุกงาน แต่ละตัวมีจุดแข็งต่างกัน ทั้ง coding, structured reasoning, multimodal input, งานวิทยาศาสตร์ และ benchmark เหตุผลขั้นยาก [5]

เลือกแบบเร็วตามงาน

| งานหลักของคุณ | ควรลองก่อน | หลักฐานที่มี | ต้องระวังอะไร |

|---|---|---|---|

| โค้ดซับซ้อน, agent workflow, การเรียกใช้เครื่องมือหลายขั้น | Claude Opus 4.7 | Anthropic ระบุว่า Opus 4.7 เมื่อเทียบกับ Opus 4.6 ทำงาน Factory Droids สำเร็จเพิ่มขึ้น 10% ถึง 15% มี tool errors น้อยลง และน่าเชื่อถือขึ้น; Axios อธิบายว่าเป็นการอัปเกรดเรือธงที่ดีขึ้นด้าน coding และ vision [ | หลักฐานนี้หนักไปทางการอัปเกรดจาก Opus 4.6 ไม่ใช่ผลวัดแบบ head-to-head กับอีก 3 โมเดลในเงื่อนไขเดียวกัน |

| งานที่ต้องทำตามขั้นตอนเข้ม, structured reasoning, computer use | GPT-5.4 | คู่มือบุคคลที่สามระบุว่า GPT-5.4 เด่นด้าน structured reasoning และ computer use พร้อมตัวเลข OSWorld 75% [ | ยังต้องทดสอบกับ workflow, prompt, เครื่องมือ และเกณฑ์ผิดถูกของคุณเอง |

| อินพุตหลายรูปแบบ, รูปภาพ, แผนภูมิ, งานวิจัยหรือโจทย์วิทยาศาสตร์ | Gemini 3.1 Pro | คู่มือเดียวกันระบุว่า Gemini 3.1 Pro อยู่แถวหน้าด้าน abstract reasoning, multimodal input และ scientific benchmarks พร้อมค่า GPQA 94.3% [ | เก่งด้านมัลติโหมดและวิทยาศาสตร์ ไม่ได้แปลว่าจะเป็น coding agent ที่ดีที่สุดเสมอไป |

| benchmark เหตุผลขั้นยาก | Grok 4 | คู่มือระบุว่า Grok 4 นำในตัวชี้วัด HLE ที่ 50.7% [ | คะแนน HLE ตัวเดียวไม่ควรถูกขยายความว่าเหนือกว่าทุกงานธุรกิจหรือทุก workflow |

| ต้องการทางเลือกเพิ่มเติมนอกกลุ่มโมเดลเจ้าตลาด | MiniMax, GLM, Kimi และรุ่นใกล้เคียง | คู่มือระบุว่า MiniMax M2.5/M2.7, GLM-5/5.1 และ Kimi K2.5 เข้าใกล้ frontier proprietary models ในงานแบบ SWE-bench [ | SWE-bench ใกล้เคียงไม่ได้แปลว่า API stability, มัลติโหมด, งานเขียน, ความปลอดภัย หรือ integration จะใกล้เคียงทั้งหมด |

Claude Opus 4.7: เด่นเมื่อ AI ต้องเขียนโค้ดและใช้เครื่องมือให้ไม่หลุด

สัญญาณที่ชัดที่สุดของ Claude Opus 4.7 คือ Anthropic เน้นเรื่อง task success และความผิดพลาดของการใช้เครื่องมือ หน้าอย่างเป็นทางการระบุว่า Claude Opus 4.7 ทำได้ดีกว่า Opus 4.6 โดยมี task success ใน Factory Droids เพิ่มขึ้น 10% ถึง 15% พร้อม tool errors ที่น้อยลงและความน่าเชื่อถือที่สูงขึ้น [11]

นี่ทำให้ Opus 4.7 เหมาะจะอยู่ในชุดทดสอบแรกของทีมซอฟต์แวร์หรือทีมที่ใช้ agent workflow เพราะความล้มเหลวของงานแบบนี้มักไม่ได้เกิดจากตอบผิดข้อเดียว แต่เกิดจากการทำงานหลายขั้นแล้วเรียกเครื่องมือพลาด แก้ไฟล์ผิด จัดการบริบทไม่ดี หรือทำให้คนต้องกลับมาแก้งานซ้ำ Axios ก็อธิบาย Opus 4.7 ว่าเป็นการอัปเกรดสำคัญของโมเดลเรือธงของ Anthropic โดยชูเรื่อง better coding และ sharper vision [12]

อย่างไรก็ตาม ควรอ่านหลักฐานให้ถูกชั้น ข้อมูลที่แข็งที่สุดตอนนี้สนับสนุนว่า Opus 4.7 ดีขึ้นเมื่อเทียบกับ Opus 4.6 แต่ยังไม่พอจะสรุปว่าเหนือกว่า GPT-5.4, Gemini 3.1 Pro หรือ Grok 4 ในทุกงานและทุกเงื่อนไข [11][

5]

GPT-5.4: เมื่อโจทย์คือขั้นตอน กฎ และการใช้คอมพิวเตอร์

ถ้างานของคุณคล้ายการทำตามกฎธุรกิจ ตารางขั้นตอน งานบนเดสก์ท็อป การสั่งเครื่องมือหลายตัว หรือการตัดสินใจหลายขั้น GPT-5.4 ควรถูกนำมาเทียบตั้งแต่รอบแรก คู่มือเลือก LLM จากบุคคลที่สามระบุว่า GPT-5.4 เด่นด้าน structured reasoning และ computer use พร้อมค่า OSWorld 75% [5]

ประเด็นนี้ไม่ได้แปลว่า GPT-5.4 ชนะ Opus 4.7 ทุกกรณี แต่ถ้าความเสียหายหลักของงานเกิดจากการทำผิดขั้นตอน คุม flow ไม่อยู่ หรือใช้งานเครื่องมือผิดลำดับ การทดสอบ GPT-5.4 เทียบกับ Opus 4.7 ด้วยงานจริงของคุณจะให้คำตอบที่น่าเชื่อกว่าการดูอันดับรวม [5]

Gemini 3.1 Pro: ให้ความสำคัญกับมัลติโหมดและโจทย์วิทยาศาสตร์

ถ้าข้อมูลของคุณมีรูปภาพ แผนภูมิ screenshot เอกสาร งานวิจัย หรือคำถามเชิงวิทยาศาสตร์ Gemini 3.1 Pro เป็นตัวเลือกที่ควรอยู่ใน shortlist คู่มือบุคคลที่สามระบุว่า Gemini 3.1 Pro อยู่แถวหน้าด้าน abstract reasoning, multimodal input และ scientific benchmarks พร้อมค่า GPQA 94.3% [5]

นี่คือเหตุผลที่ไม่ควรเลือกโมเดลจาก coding benchmark เพียงอย่างเดียว หาก workflow จริงต้องอ่านภาพ ทำความเข้าใจเอกสารหลายรูปแบบ หรือช่วยงานวิจัย จุดแข็งของ Gemini 3.1 Pro อาจตรงกับโจทย์มากกว่าโมเดลที่เด่นด้าน agent coding [5]

Grok 4: คะแนนเหตุผลขั้นยากน่าสนใจ แต่อย่าแปลผลเกินตัวเลข

Grok 4 มีจุดที่ควรจับตาใน benchmark เหตุผลขั้นยาก คู่มือเดียวกันระบุว่า Grok 4 นำในตัวชี้วัด HLE ด้วยค่า 50.7% [5]

แต่คะแนนลักษณะนี้ไม่ควรถูกแปลงเป็นข้อสรุปว่า Grok 4 จะดีที่สุดในงานธุรกิจทั่วไป งาน content, coding agent หรือการใช้เครื่องมือทุกแบบ อีกบทความจัดอันดับโมเดลก็เตือนว่า benchmark มีประโยชน์ แต่ประสบการณ์ใช้งานจริงในการสร้างงานมักถูกกำหนดโดย reliability, UI capability และต้นทุนด้วย [6]

ทำไมดูแค่ตารางอันดับยังไม่พอ

อย่างแรก ตารางอันดับมักรวม benchmark หลายชุดที่ไม่ได้อัปเดตวันเดียวกัน ตัวอย่างเช่นตาราง AI coding model comparison ของ Failing Fast ระบุแหล่งข้อมูลจาก SWE-bench เดือนกุมภาพันธ์ 2026, Aider เดือนตุลาคม 2025 และ Arena Code เดือนกุมภาพันธ์ 2026 [2] ตารางแบบนี้ช่วยบอกทิศทางได้ดี แต่ไม่ควรถูกอ่านเป็นผลจัดอันดับเด็ดขาดภายใต้เงื่อนไขเดียวกันทั้งหมด

อย่างที่สอง การเทียบตัวเองของผู้พัฒนาโมเดลกับการสรุปข้ามค่ายของบุคคลที่สามเป็นหลักฐานคนละประเภท ข้อมูลของ Anthropic เกี่ยวกับ Opus 4.7 สนับสนุนการพัฒนาจาก Opus 4.6 ได้ชัดกว่า ส่วนคู่มือบุคคลที่สามช่วยให้เห็นภาพเปรียบเทียบข้าม GPT, Gemini, Grok และ Claude แต่ไม่ใช่การทดสอบทางการที่ทั้ง OpenAI, Google, xAI และ Anthropic ร่วมกันกำหนดเงื่อนไข [11][

5]

อย่างที่สาม ประสบการณ์ใช้งานจริงมีปัจจัยนอกเหนือจากคะแนน benchmark บทความจัดอันดับโมเดลอีกแหล่งชี้ว่า benchmark มีประโยชน์ แต่การสร้างงานจริงในชีวิตประจำวันมักขึ้นกับ reliability, UI capability และต้นทุนที่ทำให้ทีมกล้าทดลองซ้ำได้หรือไม่ [6]

เช็กลิสต์ก่อนเลือกใช้จริง

ก่อนซื้อ ใช้เป็นมาตรฐานทีม หรือเอาเข้าระบบ production อย่าถามแค่โมเดลไหนแรงที่สุด ให้ทดสอบ 3 ถึง 5 ตัวเลือกด้วยงานจริงชุดเดียวกันแทน

- เลือกงานจริง 5 ถึง 10 งานที่ทีมทำบ่อย เช่น แก้ bug, เพิ่ม feature, refactor, อ่านเอกสารยาว, วิเคราะห์ screenshot, เขียน spec หรือเรียกใช้เครื่องมือ

- ใช้ prompt, ข้อมูลพื้นหลัง และเกณฑ์ผ่านไม่ผ่านชุดเดียวกันกับทุกโมเดล

- บันทึก first-pass pass rate, จำนวนรอบที่ต้องแก้ซ้ำ, tool errors, hallucination, latency, cost และเวลาที่มนุษย์ต้องใช้ตรวจแก้

- อย่าดูแค่คำตอบที่ดีที่สุด ให้ดูคำตอบที่แย่ที่สุดด้วย เพราะเมื่อใช้งานจริง failure mode มักสำคัญกว่าตัวอย่างเดโม

- ถ้างานเกี่ยวข้องกับข้อมูลอ่อนไหว ความเป็นส่วนตัว หรือข้อกำกับดูแล ให้ตรวจนโยบาย data retention, วิธี deploy และเครื่องมือควบคุมระดับองค์กรแยกต่างหาก

ข้อสรุป

ถ้างานหลักคือ coding, agent workflow และการใช้เครื่องมือให้เสถียร Claude Opus 4.7 ควรเป็นหนึ่งในตัวเลือกแรกที่นำมาทดสอบ Anthropic ระบุว่ามันดีขึ้นจาก Opus 4.6 ทั้งด้าน Factory Droids task success และ tool errors ส่วน Axios ก็อธิบายว่า Opus 4.7 เป็นเรือธงที่อัปเกรดด้าน coding และ vision [11][

12]

แต่ถ้าถามว่าใครเป็นอันดับหนึ่งแบบครอบจักรวาล หลักฐานที่มีตอนนี้ยังไม่พอ คู่มือบุคคลที่สามให้ข้อสรุปที่เหมาะกับการใช้งานจริงมากกว่า นั่นคือไม่มีโมเดลเดียวที่ชนะทุกงาน และ GPT-5.4, Gemini 3.1 Pro, Grok 4 รวมถึงโมเดลทางเลือกใหม่ ๆ ต่างมีพื้นที่ที่เด่นของตัวเอง [5]

วิธีเลือกที่ปลอดภัยที่สุดคือ ใช้ Claude Opus 4.7 เป็นตัวเต็งสำหรับงานโค้ดและ agent แต่ให้ทดสอบร่วมกับ GPT-5.4, Gemini 3.1 Pro และ Grok 4 ด้วย workflow จริงของคุณเองก่อนตัดสินใจ