ในโลก AI ช่วงหลัง ตัวเลขขนาดโมเดลมักถูกใช้เป็นสัญลักษณ์ของความเก่ง ยิ่งพารามิเตอร์มากก็ยิ่งดูน่าเกรงขาม แต่ ZAYA1-8B ของ Zyphra น่าสนใจเพราะเดินคนละทาง: ไม่ได้พยายามขายความ “ใหญ่กว่า” แต่ชูประเด็นว่าโมเดลที่ใช้พารามิเตอร์จริงน้อยมากอาจยังทำงานเหตุผล คณิตศาสตร์ และเขียนโค้ดได้อย่างแข็งแรง

Zyphra ระบุว่า ZAYA1-8B มีพารามิเตอร์รวม 8.4 พันล้านตัว แต่มีพารามิเตอร์ที่ทำงานจริง 760 ล้านตัว ในสถาปัตยกรรมแบบ Mixture-of-Experts หรือ MoE [1][

6] นี่คือหัวใจของเรื่องทั้งหมด เพราะมันทำให้การเปรียบเทียบกับโมเดลขนาดยักษ์ไม่ได้อยู่ที่ “ใครตัวใหญ่กว่า” แต่อยู่ที่ “ได้ความสามารถเท่าไรต่อการคำนวณที่ใช้จริง”

ZAYA1-8B คืออะไร

ZAYA1-8B เป็นโมเดลภาษาแบบ Mixture-of-Experts ขนาดเล็กจาก Zyphra โดย model card บน Hugging Face ระบุว่ามีพารามิเตอร์รวม 8.4 พันล้านตัว ใช้งานจริง 760 ล้านพารามิเตอร์ และถูกฝึกแบบ end-to-end โดย Zyphra [6]

สำหรับผู้อ่านที่ไม่คุ้นกับ MoE ให้คิดแบบง่าย ๆ ว่าโมเดลมี “ผู้เชี่ยวชาญ” หลายส่วนอยู่ข้างใน แต่ไม่ได้เรียกใช้ทุกส่วนตลอดเวลา ในแต่ละงานหรือแต่ละช่วงของการประมวลผล ระบบจะเปิดใช้เพียงบางส่วนที่เกี่ยวข้อง ดังนั้นขนาดรวมของโมเดลกับปริมาณการคำนวณที่ใช้จริงจึงไม่เท่ากันเสมอไป Zyphra และประกาศของบริษัทอธิบาย ZAYA1-8B ว่าเป็นโมเดลที่มีพารามิเตอร์รวม 8.4 พันล้าน แต่ทำงานด้วยพารามิเตอร์ active น้อยกว่า 1 พันล้าน [4][

6]

Zyphra วางตำแหน่งโมเดลนี้เป็นก้าวด้าน “ประสิทธิภาพของความฉลาดต่อจำนวนพารามิเตอร์” โดยให้เครดิตกับสถาปัตยกรรม วิธี pretraining และ post-training ที่ใช้ [6] model card ยังระบุว่า ZAYA1-8B เน้นงานให้เหตุผลแบบยาว งานคณิตศาสตร์ และงานเขียนโค้ดเป็นพิเศษ [

6]

ประเด็นสำคัญ: ไม่ใช่แค่คะแนนสูง แต่คือความหนาแน่นของความสามารถ

คำกล่าวอ้างที่น่าสนใจที่สุดของ ZAYA1-8B ไม่ใช่ว่าโมเดลนี้เอาชนะระบบ AI แนวหน้าทั้งหมดได้เด็ดขาด แต่คือแนวคิดเรื่อง “intelligence density” หรือความสามารถที่อัดอยู่ในพารามิเตอร์ active จำนวนน้อย

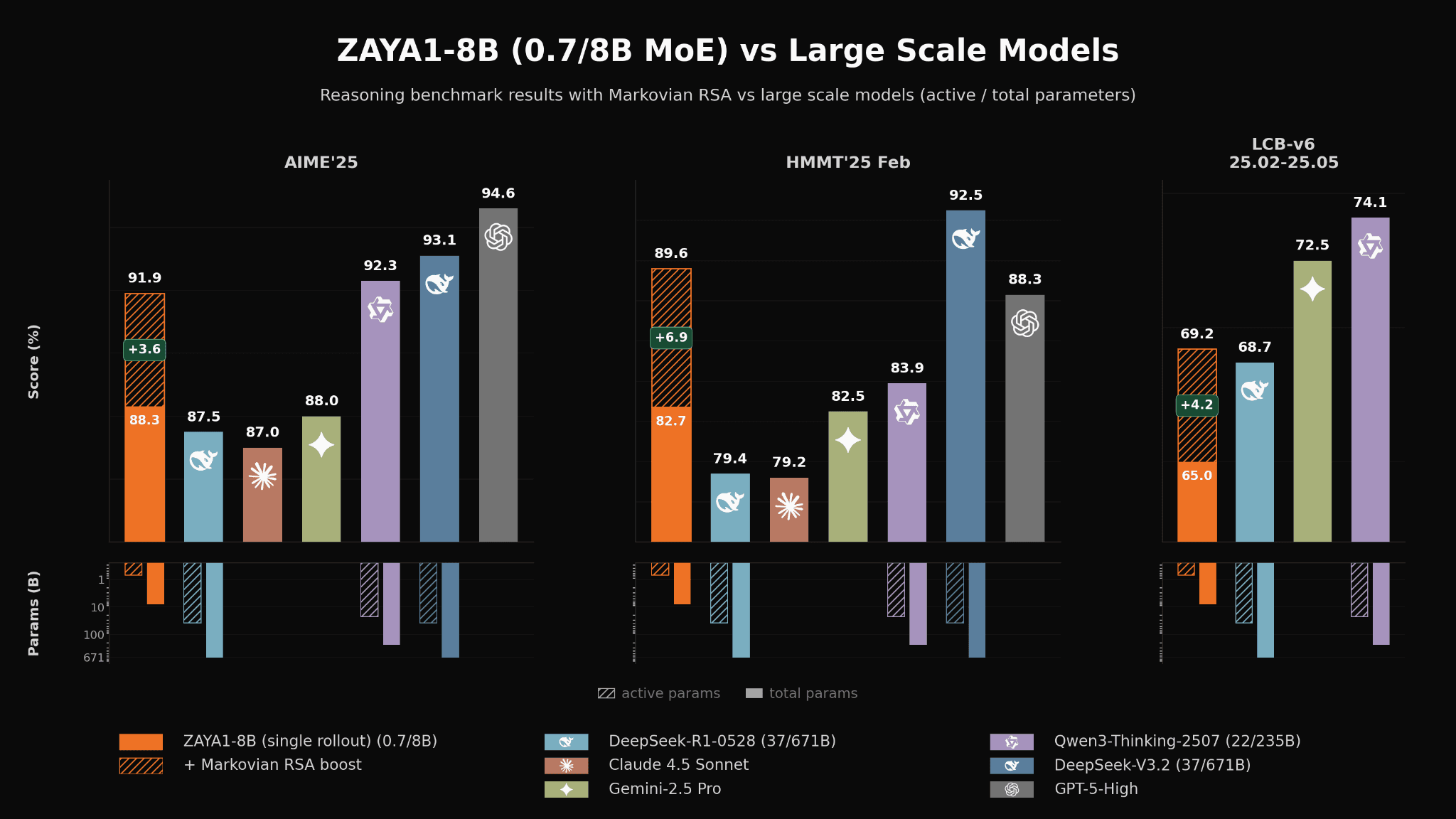

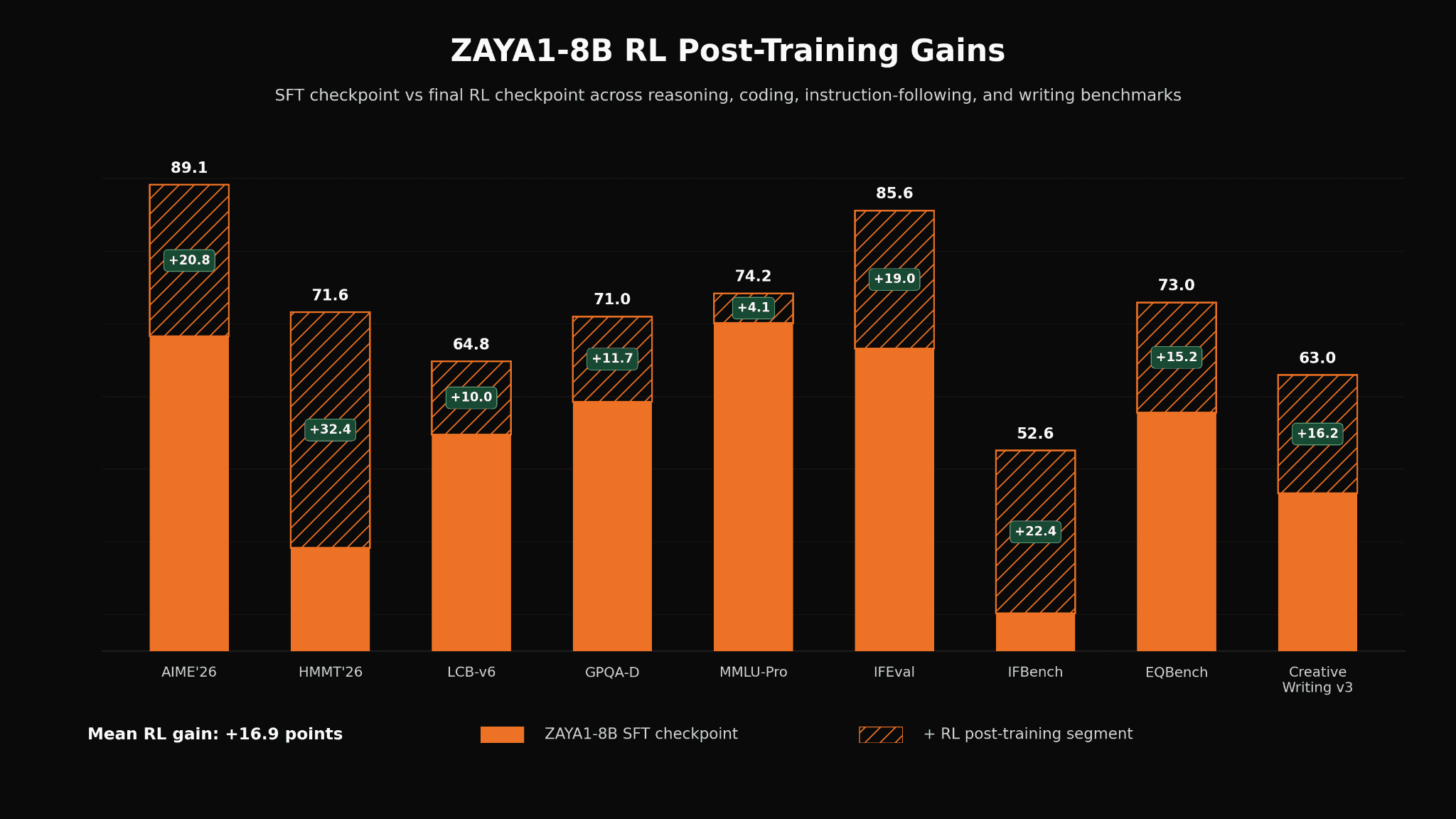

Zyphra ระบุว่า ZAYA1-8B ทำผลงานได้ดีในงานเหตุผลซับซ้อน คณิตศาสตร์ และโค้ด และทำได้ดีกว่าโมเดล open-weight ที่มีขนาดใหญ่กว่ามากใน benchmark ด้านคณิตศาสตร์และโค้ดบางชุด [1] ประกาศของบริษัทก็ระบุในทำนองเดียวกันว่าโมเดลนี้ทำผลงานเทียบเท่าหรือเหนือกว่า open-weight models ที่ใหญ่กว่ามากในงานเหตุผล คณิตศาสตร์ และโค้ด โดยใช้พารามิเตอร์ active น้อยกว่า 1 พันล้าน [

4]

นี่คือเหตุผลที่ ZAYA1-8B ถูกนำไปเทียบกับโมเดลที่ใหญ่กว่าหลายเท่า หากผลที่รายงานไว้ยืนหยัดได้ในการทดสอบที่กว้างขึ้น ก็จะเป็นสัญญาณว่า “ความสามารถแบบโมเดลแนวหน้า” ไม่ได้ขึ้นกับจำนวนพารามิเตอร์รวมเพียงอย่างเดียว รอยเท้าการประมวลผลที่เล็กลงอาจสำคัญมากในงาน inference หรือการให้โมเดลตอบคำถามจำนวนมาก และ model card ของ Zyphra ก็ชี้ว่าขนาดเล็กกับประสิทธิภาพด้าน inference อาจทำให้โมเดลเหมาะกับ test-time compute harnesses [6]

พูดให้ตรงขึ้น ZAYA1-8B ไม่ได้บอกว่าโลกไม่ต้องการโมเดลใหญ่แล้ว แต่กำลังบอกว่า “ขนาดที่ใหญ่ที่สุด” อาจไม่ใช่คำตอบเดียวของการแข่งขัน AI

ทำไมเรื่องการฝึกบน AMD จึงถูกพูดถึงมาก

อีกมุมที่ทำให้ ZAYA1-8B ได้รับความสนใจคือฮาร์ดแวร์ที่ใช้ฝึก Zyphra ระบุว่า ZAYA1-8B เป็นโมเดล MoE ตัวแรกที่ถูก pretrained, midtrained และ supervised fine-tuned บนสแต็ก AMD Instinct MI300 [1] ส่วนประกาศของบริษัทอธิบายว่าโมเดลนี้ฝึกบนโครงสร้างพื้นฐาน AMD แบบ full-stack [

4]

สื่อรองยังเน้นด้วยว่า ZAYA1-8B ถูกสร้างบนซิลิคอนของ AMD แทนที่จะเป็นฮาร์ดแวร์ Nvidia [3] อย่างไรก็ตาม ข้อสรุปที่ควรระวังคือ นี่ไม่ได้พิสูจน์ว่า AMD เหนือกว่า Nvidia ในทุกกรณี สิ่งที่พูดได้จากข้อมูลที่มีคือ Zyphra กำลังนำเสนอกรณีใช้งานจริงของการฝึกโมเดล MoE ระดับสูงบนสแต็ก accelerator ทางเลือกที่ไม่ใช่แนวทางกระแสหลักเดิม [

1][

3][

4]

สำหรับอุตสาหกรรม AI เรื่องนี้มีน้ำหนัก เพราะการแข่งขันไม่ได้อยู่แค่ที่โมเดล แต่รวมถึงระบบฮาร์ดแวร์ ซอฟต์แวร์ และกระบวนการฝึกทั้งหมดด้วย

นักพัฒนาตรวจสอบอะไรได้บ้าง

ZAYA1-8B มีรายการอยู่บน Hugging Face ซึ่งทำให้นักพัฒนาสามารถดู model card และรายละเอียดการเผยแพร่ได้โดยตรง [6] รายงานรองยังระบุว่าโมเดลนี้มีให้ใช้งานบน Hugging Face ภายใต้ไลเซนส์ Apache 2.0 และมีให้เรียกใช้เป็น serverless endpoint บน Zyphra Cloud [

5]

การเปิดให้เข้าถึงเช่นนี้สำคัญ เพราะคำกล่าวอ้างเรื่องประสิทธิภาพจะมีน้ำหนักขึ้นเมื่อผู้พัฒนาภายนอกสามารถนำไปทดลอง วัดผล หรือเปรียบเทียบกับงานของตนเองได้ แต่ก็ต้องแยกให้ออกว่า “มี model card” ไม่เท่ากับ “ผ่านการยืนยันอิสระในทุก workload จริงแล้ว”

ยังพิสูจน์อะไรไม่ได้บ้าง

ควรมอง ZAYA1-8B เป็นผลลัพธ์ด้านประสิทธิภาพที่น่าจับตา ไม่ใช่คำตัดสินสุดท้ายของการแข่งขันโมเดลแนวหน้า ข้อมูลจำนวนมากที่มีอยู่ตอนนี้มาจากโพสต์วิจัยของ Zyphra, model card, ประกาศของบริษัท และรายงานจากสื่อรอง [1][

4][

5][

6][

9]

แหล่งข้อมูลเน้นงานคณิตศาสตร์ โค้ด และการให้เหตุผลแบบยาวเป็นหลัก จึงยังไม่ควรตีความว่าโมเดลนี้เหนือกว่าทุกระบบในทุกงาน [1][

6] VentureBeat รายงานว่า ZAYA1-8B มีผลการแข่งขันบน third-party benchmarks ที่สู้ได้กับ GPT-5-High และ DeepSeek-V3.2 แต่การเทียบ benchmark ยังไม่ใช่หลักฐานว่าโมเดลนี้ดีกว่าในฐานะระบบใช้งานทั่วไปทุกสถานการณ์ [

9]

การอ่านที่เป็นธรรมกว่าคือ ZAYA1-8B อาจผลักความสามารถด้านเหตุผลในระดับสูงให้มาอยู่ในโมเดลที่ใช้พารามิเตอร์ active ต่ำกว่า 1 พันล้านได้อย่างน่าสนใจ และนั่นสำคัญพอ แม้ยังไม่ได้ตอบคำถามทั้งหมดว่าเมื่อนำไปใช้จริงในวงกว้างจะสู้โมเดลขนาดใหญ่อย่างไร

สรุป

ZAYA1-8B สำคัญเพราะทำให้ “ประสิทธิภาพ” กลายเป็นหัวข่าวหลัก โมเดลนี้มีพารามิเตอร์รวม 8.4 พันล้านตัว ใช้งานจริง 760 ล้านพารามิเตอร์ มีผลที่ Zyphra รายงานว่าแข็งแรงในงานเหตุผล คณิตศาสตร์ และโค้ด และถูกฝึก end-to-end บนโครงสร้างพื้นฐาน AMD [1][

4][

6]

คำตัดสินที่ปลอดภัยที่สุดในตอนนี้คือ: นี่เป็นโมเดลที่มีนัยสำคัญและควรจับตาอย่างใกล้ชิด แต่ยังไม่ใช่ข้อพิสูจน์สุดท้าย หากผลลัพธ์ถูกทำซ้ำและยืนยันได้ในวงกว้าง ZAYA1-8B จะช่วยชี้ว่าอนาคตของ AI อาจไม่ได้ตัดสินกันด้วยขนาดโมเดลเพียงอย่างเดียว แต่ขึ้นกับสถาปัตยกรรม สูตรการฝึก post-training และความหลากหลายของฮาร์ดแวร์ด้วย [1][

6]