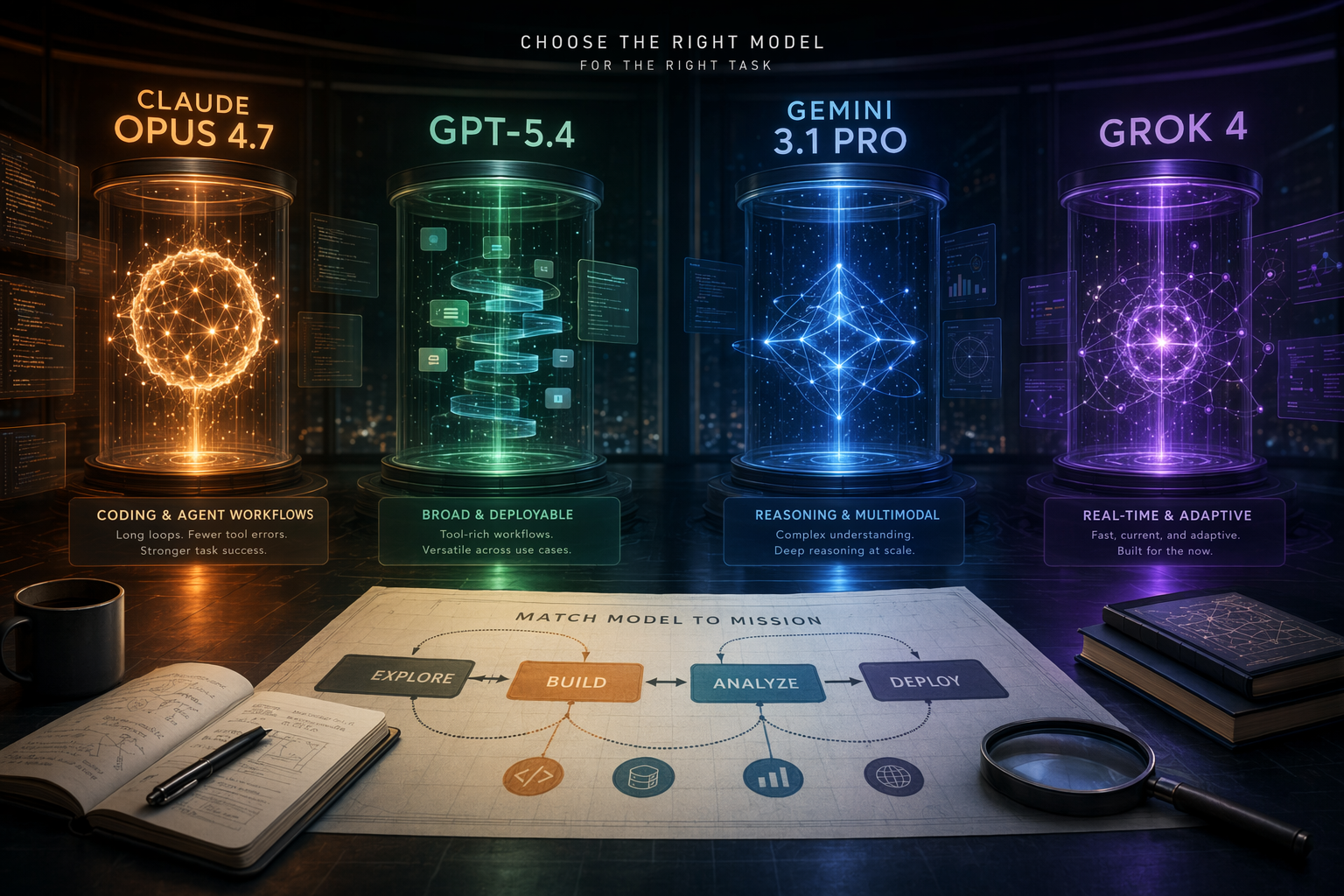

Claude Opus 4.7, GPT-5.4, Gemini 3.1 Pro, Grok 4를 한 줄로 세우면 자연스럽게 1등 모델을 묻게 됩니다. 하지만 실무에서는 질문을 조금 바꾸는 편이 낫습니다. 내 업무가 가장 자주 실패하는 지점이 코딩인지, 도구 호출인지, 표와 규칙 처리인지, 이미지·문서 이해인지, 고난도 추론인지부터 봐야 합니다.

한 제3자 LLM 선택 가이드는 단일 모델이 모든 작업을 지배하지는 않으며, 코딩·구조화 추론·멀티모달 입력·과학 벤치마크·고난도 추론에서 모델별 강점이 갈린다고 정리합니다.[5] 즉, 정답은 하나의 왕좌가 아니라 업무별 후보군입니다.

빠른 선택표

| 주된 업무 | 먼저 테스트할 모델 | 현재 근거 | 주의할 점 |

|---|---|---|---|

| 복잡한 코딩, 에이전트 워크플로, 안정적인 도구 호출 | Claude Opus 4.7 | Anthropic은 Opus 4.7이 Opus 4.6보다 Factory Droids 작업 성공률이 10~15% 높고, 도구 오류가 더 적으며 더 안정적이라고 밝혔다.[ | 이 근거는 주로 Opus 4.7이 Opus 4.6보다 개선됐다는 내용이다. 네 모델을 같은 조건에서 맞붙인 공식 결론은 아니다.[ |

| 엄격한 절차, 구조화 추론, computer use | GPT-5.4 | 제3자 가이드는 GPT-5.4가 structured reasoning과 computer use에서 강하고 OSWorld 75%를 기록했다고 정리했다.[ | 실제 프롬프트, 도구, 실패 기준으로 따로 검증해야 한다. |

| 이미지·차트·문서 스크린샷, 추상 추론, 과학형 질문 | Gemini 3.1 Pro | 같은 가이드는 Gemini 3.1 Pro가 abstract reasoning, multimodal input, scientific benchmarks에서 앞서며 GPQA 94.3%를 기록했다고 설명했다.[ | 멀티모달과 과학 벤치마크가 강하다고 해서 코딩 에이전트나 장기 도구 사용에서도 항상 최강이라는 뜻은 아니다. |

| 고난도 추론 벤치마크 | Grok 4 | 같은 가이드는 Grok 4가 HLE 지표에서 50.7%로 앞선다고 정리했다.[ | 단일 고난도 추론 지표를 일반 사무·개발·콘텐츠 워크플로 전체 우위로 확대 해석하면 위험하다. |

| 비용 절감, 공급사 다변화, 오픈소스 대안 탐색 | MiniMax, GLM, Kimi 계열도 후보 | 같은 가이드는 MiniMax M2.5/M2.7, GLM-5/5.1, Kimi K2.5 같은 신규 모델이 SWE-bench 계열 작업에서 선두권 독점 모델과 경쟁할 수준에 이르렀다고 평가했다.[ | SWE-bench에서 경쟁력이 있다는 말이 API 안정성, 멀티모달, 글쓰기, 안전성, 제품 통합까지 모두 같다는 뜻은 아니다. |

Claude Opus 4.7: 코딩과 도구 신뢰도를 먼저 본다

Opus 4.7에서 가장 구체적인 공개 신호는 Anthropic이 작업 성공률과 도구 오류를 전면에 내세웠다는 점입니다. Anthropic은 Claude Opus 4.7이 Opus 4.6보다 Factory Droids 작업 성공률이 10~15% 높고, 도구 오류가 더 적으며 더 안정적이라고 설명했습니다.[11]

이런 개선은 소프트웨어 개발과 에이전트 워크플로에서 특히 중요합니다. 이 영역의 실패는 단순히 한 문제를 틀리는 수준에서 끝나지 않습니다. 여러 파일을 건드리다 엉뚱한 곳을 수정하거나, 도구 호출 순서가 꼬이거나, 앞 단계의 가정을 잘못 물고 가면서 사람이 계속 되돌려야 하는 일이 생깁니다. Axios도 Opus 4.7을 Anthropic의 플래그십 AI 모델에 대한 의미 있는 업그레이드로 설명하며, 더 나은 코딩과 더 선명한 비전 성능을 언급했습니다.[12]

다만 안전한 해석은 여기까지입니다. 공개 자료가 강하게 뒷받침하는 것은 Opus 4.7이 Opus 4.6보다 개선됐다는 점입니다.[11] 이 자료만으로 Opus 4.7이 GPT-5.4, Gemini 3.1 Pro, Grok 4를 모든 조건에서 앞선다고 결론내리기는 어렵습니다.[

5]

GPT-5.4: 규칙과 절차가 빡빡한 업무라면 후보에 넣기

업무가 표준 절차, 엄격한 규칙, 표 기반 판단, 데스크톱 조작, 도구 편성처럼 단계 관리가 중요한 쪽이라면 GPT-5.4를 1차 후보에 넣을 만합니다. 제3자 LLM 선택 가이드는 GPT-5.4가 structured reasoning과 computer use에서 강점이 있으며 OSWorld 75%를 기록했다고 정리했습니다.[5]

여기서 핵심은 브랜드가 아니라 실패 유형입니다. 결과가 틀리는 이유가 창의성 부족이 아니라 절차 누락, 규칙 오해, 도구 선택 오류, 중간 단계 관리 실패라면 GPT-5.4와 Claude Opus 4.7을 같은 과제로 비교하는 편이 합리적입니다.[5]

Gemini 3.1 Pro: 이미지·문서·과학형 업무가 많을 때

입력 데이터가 텍스트만이 아니라 이미지, 차트, 문서 캡처, 실험 자료, 과학형 질의응답까지 포함한다면 Gemini 3.1 Pro를 빼놓기 어렵습니다. 제3자 가이드는 Gemini 3.1 Pro가 abstract reasoning, multimodal input, scientific benchmarks에서 앞서며 GPQA 94.3%를 기록했다고 설명했습니다.[5]

따라서 실제 워크플로에 시각 자료와 연구형 질문이 많다면 코딩 벤치마크만 보고 모델을 고르면 안 됩니다. 그런 방식은 Gemini 3.1 Pro의 주요 강점을 놓칠 수 있습니다.[5]

Grok 4: 고난도 추론 지표는 강하지만, 과대 해석은 금물

Grok 4는 고난도 추론 지표에서 눈에 띄는 후보입니다. 같은 제3자 가이드는 Grok 4가 HLE 지표에서 50.7%로 앞선다고 정리했습니다.[5]

하지만 HLE 같은 지표 하나가 일반 기업 업무, 콘텐츠 품질, 코딩 에이전트, 장기 도구 사용까지 모두 설명해주지는 않습니다. 또 다른 모델 순위 글도 벤치마크는 유용하지만 실제 구축 경험은 신뢰성, UI 기능, 비용 같은 요소에 크게 좌우된다고 지적합니다.[6]

왜 순위표만 보면 안 될까

첫째, 순위표는 서로 다른 벤치마크와 갱신 시점을 한 표에 섞는 경우가 많습니다. Failing Fast의 AI coding model comparison은 데이터 출처로 SWE-bench 2026년 2월, Aider 2025년 10월, Arena Code 2026년 2월을 함께 제시합니다.[2] 이런 표는 방향을 잡는 데 유용하지만, 모든 모델이 같은 날 같은 조건에서 평가된 절대 순위로 읽으면 곤란합니다.

둘째, 공식 자기 비교와 제3자 교차 비교는 증거의 성격이 다릅니다. Anthropic의 Opus 4.7 자료는 Opus 4.6 대비 개선을 보여주는 데 가장 강합니다.[11] 반면 제3자 가이드는 여러 모델을 고르는 데 필요한 단서를 주지만, OpenAI·Google·xAI·Anthropic이 공동으로 낸 동일 조건 공식 맞대결 평가는 아닙니다.[

5]

셋째, 제품에 올려 쓰는 경험은 벤치마크 밖에서 갈립니다. 모델 순위 글은 벤치마크가 유용하더라도 일상적인 구축 경험은 신뢰성, UI 기능, 비용의 영향을 크게 받는다고 설명합니다.[6]

도입 전 실전 테스트 체크리스트

구매, 사내 표준화, 제품 적용을 앞두고 있다면 가장 강한 모델을 묻기보다 같은 실제 과제로 3~5개 후보를 비교해보는 편이 안전합니다.

- 매일 실제로 수행하는 작업 5~10개를 고릅니다. 예를 들어 버그 수정, 기능 추가, 리팩터링, 긴 문서 읽기, 스크린샷 분석, 요구사항 문서 작성, 도구 호출형 작업이 될 수 있습니다.

- 모든 모델에 같은 프롬프트, 같은 배경 자료, 같은 완료 기준을 적용합니다.

- 한 번에 통과한 비율, 재작업 횟수, 도구 오류, 환각, 지연시간, 비용, 사람이 고친 시간을 기록합니다.

- 최고 답변만 보지 말고 최악의 답변도 봅니다. 운영에 들어가면 데모보다 실패 패턴이 더 중요합니다.

- 민감 데이터, 규제, 개인정보가 걸려 있다면 데이터 보관 정책, 배포 방식, 기업용 제어 기능을 별도로 확인합니다.

결론

Claude Opus 4.7은 코딩, 에이전트 워크플로, 안정적인 도구 사용이 중요한 업무에서 1차 후보로 올릴 만합니다. Anthropic은 Opus 4.7이 Opus 4.6 대비 Factory Droids 작업 성공률과 도구 오류 측면에서 개선됐다고 밝혔고, Axios도 코딩과 비전이 좋아진 플래그십 업그레이드로 설명했습니다.[11][

12]

다만 전능한 1위 모델을 찾는 질문에는 현재 공개 근거만으로 답하기 어렵습니다. 제3자 가이드의 결론은 더 실무적입니다. 단일 모델이 모든 작업을 지배하지 않으며, GPT-5.4, Gemini 3.1 Pro, Grok 4, 그리고 일부 신흥 모델은 각자 다른 강점을 갖고 있습니다.[5]

따라서 가장 안전한 선택은 이렇습니다. 코딩과 에이전트 업무라면 Claude Opus 4.7을 우선 후보로 놓되, 실제 업무 샘플로 GPT-5.4, Gemini 3.1 Pro, Grok 4와 나란히 테스트하십시오. 순위표보다 중요한 것은 당신의 워크플로에서 덜 틀리고, 덜 되돌리게 만들고, 비용 안에서 꾸준히 작동하는 모델입니다.