AI 모델 뉴스는 대개 더 많은 파라미터, 더 큰 클러스터, 더 비싼 학습 규모에 초점이 맞춰진다. 그런데 Zyphra의 ZAYA1-8B는 조금 다른 방향에서 주목받는다. 이 모델이 중요한 이유는 모든 대형 프런티어 시스템을 확실히 이겼기 때문이 아니라, 8.4B 전체 파라미터와 760M 활성 파라미터라는 작은 활성 계산 규모로 강한 추론·수학·코딩 성능을 보고했기 때문이다 [1][

6].

즉 ZAYA1-8B의 이야기는 ‘최대 규모’가 아니라 ‘효율’에 가깝다.

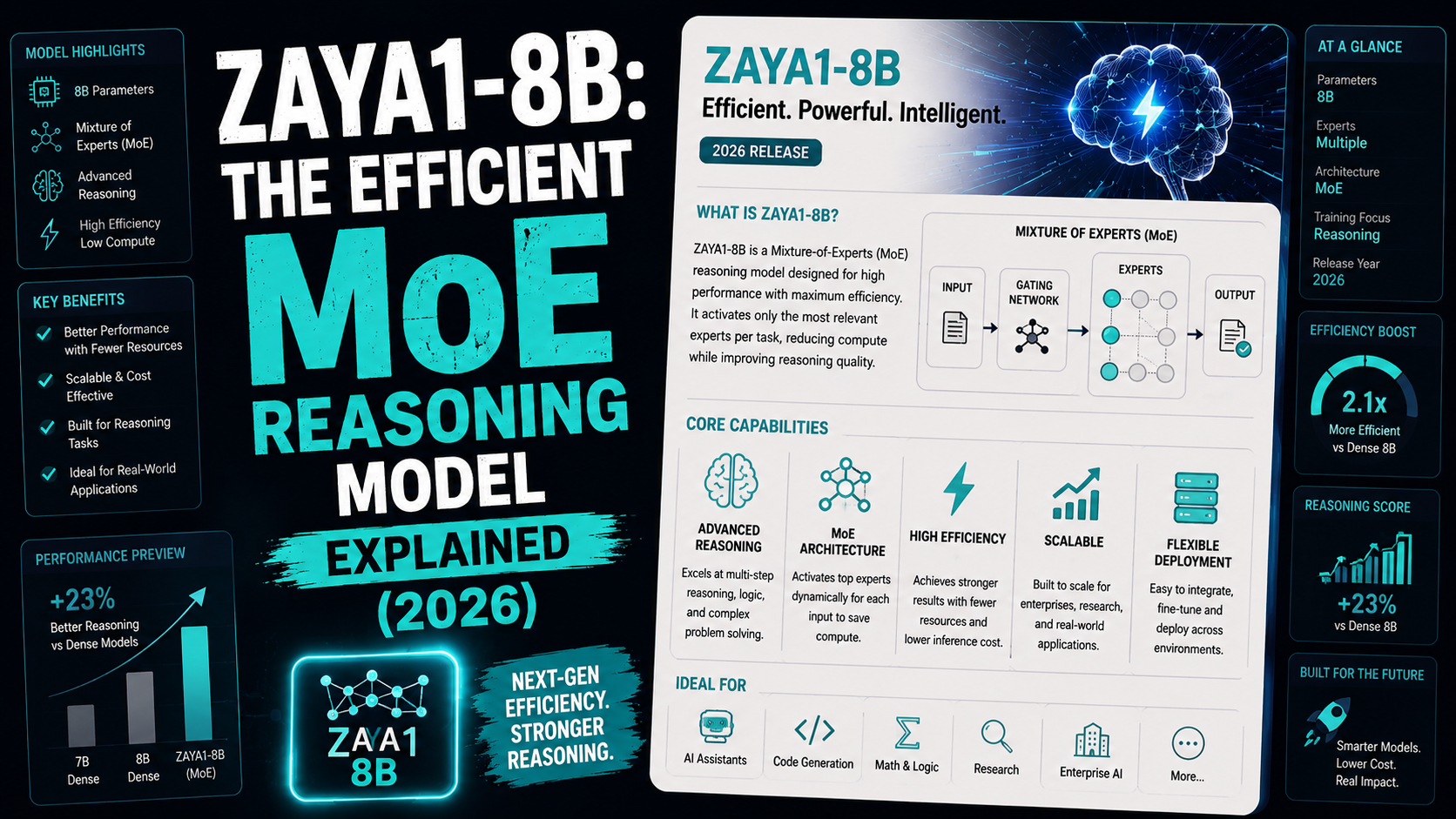

ZAYA1-8B는 어떤 모델인가

ZAYA1-8B는 Zyphra가 만든 작은 Mixture-of-Experts, 즉 MoE 언어 모델이다. Hugging Face 모델 카드에는 전체 파라미터 8.4B, 활성 파라미터 760M, 그리고 Zyphra가 엔드투엔드로 학습했다는 설명이 올라와 있다 [6].

여기서 중요한 것은 전체 파라미터와 활성 파라미터의 차이다. MoE 모델은 여러 ‘전문가’ 모듈 중 일부만 선택적으로 쓰는 구조이기 때문에, 모델이 보유한 전체 파라미터 수와 실제 추론 때 활성화되는 계산량이 같지 않을 수 있다. Zyphra와 발표 자료는 ZAYA1-8B가 8.4B 전체 파라미터를 갖고도 1B 미만의 활성 파라미터로 동작한다고 설명한다 [4][

6].

Zyphra는 이 모델이 구조, 사전학습, 후학습 선택의 조합을 통해 파라미터 수 대비 높은 지능 효율을 보인다고 주장한다 [6]. 모델 카드 역시 ZAYA1-8B가 긴 형식의 세밀한 추론, 특히 수학과 코딩 작업에 초점을 맞춘다고 설명한다 [

6].

진짜 비교 기준은 ‘전체 크기’가 아니라 ‘활성 파라미터당 성능’

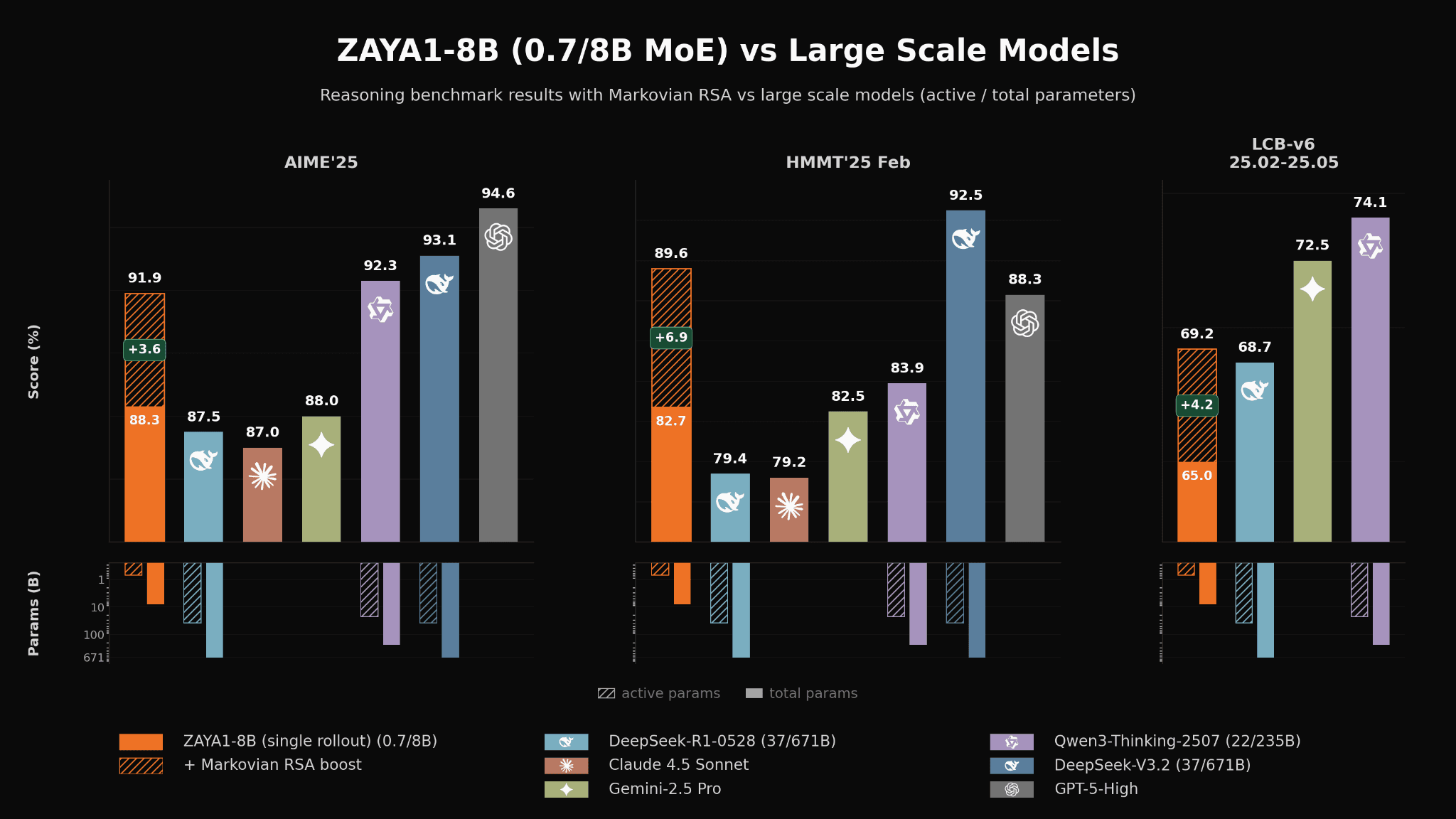

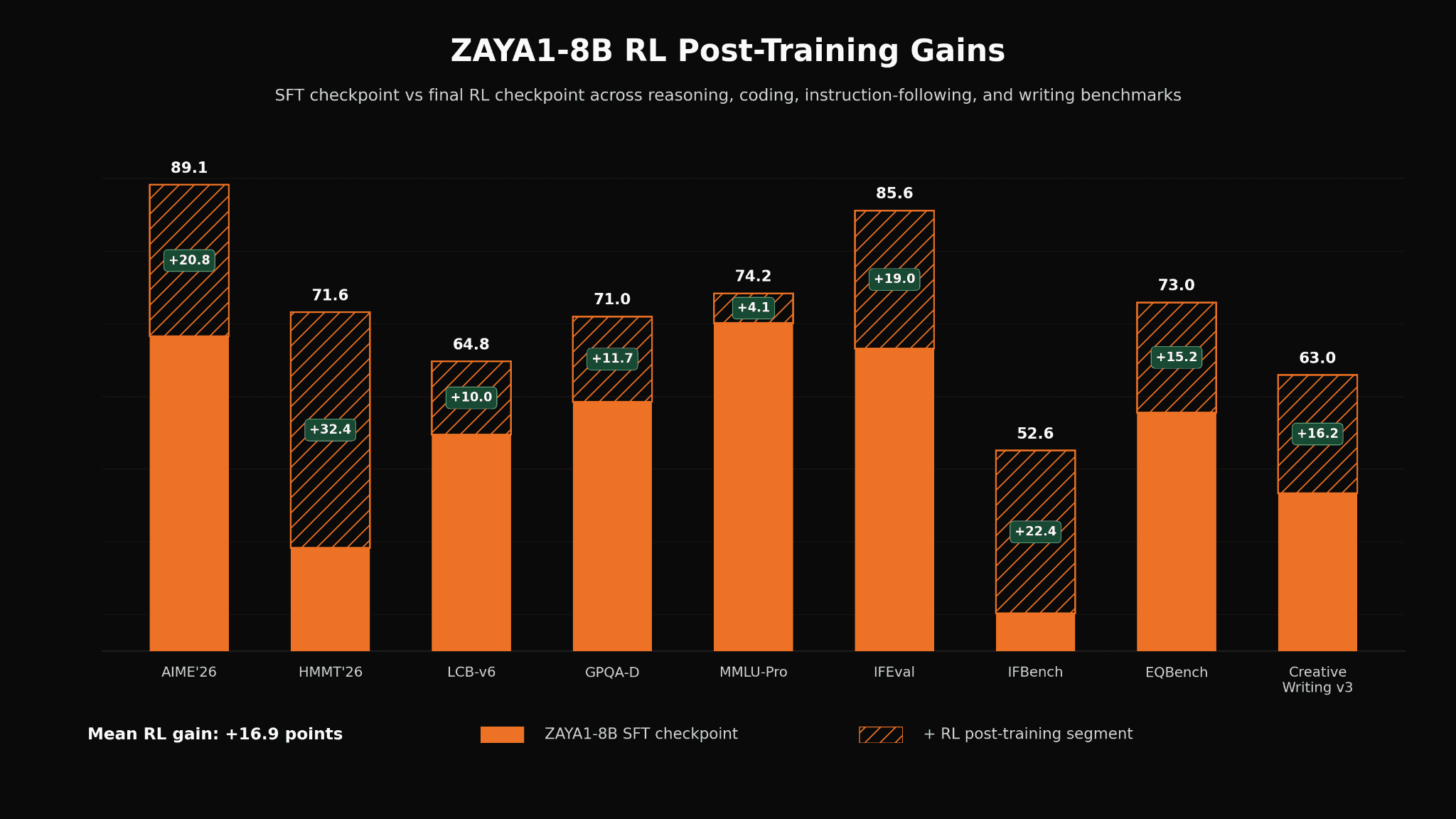

ZAYA1-8B를 둘러싼 가장 강한 주장은 절대적인 벤치마크 왕좌가 아니다. 더 정확히는 ‘활성 파라미터당 얼마나 많은 추론 능력을 담을 수 있는가’라는 지능 밀도다.

Zyphra는 ZAYA1-8B가 복잡한 추론, 수학, 코딩 작업에서 강한 성능을 보이며, 일부 수학·코딩 벤치마크에서는 훨씬 큰 오픈웨이트 모델을 앞선다고 밝혔다 [1]. 회사 발표 역시 ZAYA1-8B가 1B 미만의 활성 파라미터를 사용하면서 복잡한 추론, 수학, 코딩 작업에서 상당히 큰 오픈웨이트 모델과 맞먹거나 넘어선다고 설명한다 [

4].

이 점 때문에 ZAYA1-8B는 훨씬 큰 모델들과 나란히 비교된다. 보고된 결과가 더 넓게 재현된다면, 프런티어급 추론 능력이 단순히 전체 파라미터 수만의 함수는 아닐 수 있음을 보여준다. 특히 추론 시점에 여러 번 계산하거나 검증 절차를 붙이는 test-time compute 방식에서는 작은 크기와 추론 효율이 강점이 될 수 있다고 Zyphra의 모델 카드는 설명한다 [6].

AMD에서 학습했다는 점도 관전 포인트다

ZAYA1-8B가 눈길을 끄는 또 다른 이유는 학습 인프라다. Zyphra는 이 모델이 AMD Instinct MI300 스택에서 사전학습, 중간학습, 감독 미세조정까지 진행된 첫 MoE 모델이라고 밝혔다 [1]. 회사 발표도 ZAYA1-8B가 풀스택 AMD 인프라에서 학습됐다고 설명한다 [

4].

2차 보도 역시 이 모델이 Nvidia 하드웨어가 아니라 AMD 실리콘에서 구축됐다는 점을 강조했다 [3]. 다만 여기서 끌어낼 수 있는 결론은 ‘AMD가 언제나 Nvidia를 이긴다’가 아니다. 더 신중한 해석은 Zyphra가 대안 가속기 스택에서도 고급 MoE 학습 사례를 제시했다는 것이다 [

1][

3][

4].

개발자가 직접 확인할 수 있는 부분

ZAYA1-8B는 Hugging Face에 올라와 있어 개발자들이 모델 카드와 공개 정보를 직접 확인할 수 있다 [6]. 2차 보도에 따르면 이 모델은 Hugging Face에서 Apache 2.0 라이선스로 제공되며, Zyphra Cloud의 서버리스 엔드포인트로도 사용할 수 있다 [

5].

이 공개성은 중요하다. 효율성 주장은 실제로 돌려보고 비교할 수 있을 때 훨씬 설득력이 커진다. 다만 모델 카드가 존재한다는 사실만으로 다양한 실제 업무 환경에서의 성능이 독립적으로 검증됐다는 뜻은 아니다.

아직 증명되지 않은 것들

ZAYA1-8B는 흥미로운 효율성 결과로 보는 것이 적절하다. 하지만 프런티어 모델 경쟁의 결론으로 보기에는 이르다. 현재 확인 가능한 많은 주장은 Zyphra의 연구 글, 모델 카드, 발표 자료 또는 2차 보도에 기반한다 [1][

4][

5][

6][

9].

또한 자료들이 강조하는 영역은 수학, 코딩, 긴 형식의 추론이다. 이것이 모든 작업에서의 일반적 우위를 뜻하지는 않는다 [1][

6]. VentureBeat는 ZAYA1-8B가 GPT-5-High와 DeepSeek-V3.2를 상대로 한 서드파티 벤치마크에서 경쟁력 있는 성능을 유지했다고 전했지만, 벤치마크 비교는 어디까지나 특정 조건의 비교이지 범용 모델로서 더 낫다는 최종 증거는 아니다 [

9].

따라서 지금 가장 공정한 평가는 좁지만 의미 있다. ZAYA1-8B는 1B 미만의 활성 파라미터에 이례적으로 높은 것으로 보고된 추론 능력을 밀어 넣은 사례로 보인다. 그것만으로도 중요하지만, 모든 대형 프런티어 시스템을 실사용 환경에서 능가한다고 말하기에는 아직 검증이 더 필요하다.

결론: 크기의 경쟁에서 효율의 경쟁으로

ZAYA1-8B가 중요한 이유는 효율을 전면에 세웠기 때문이다. 8.4B 전체 파라미터, 760M 활성 파라미터, 강한 것으로 보고된 추론·수학·코딩 성능, 그리고 엔드투엔드 AMD 학습이라는 조합은 유용한 프런티어식 추론이 항상 훨씬 큰 활성 파라미터 예산을 필요로 한다는 가정을 흔든다 [1][

4][

6].

현재로서 가장 안전한 결론은 이렇다. ZAYA1-8B는 충분히 주목할 만하지만, 독립 검증이 완전히 끝난 결과는 아니다. 만약 보고된 성능이 폭넓게 재현된다면, 앞으로의 AI 경쟁은 단순한 모델 크기뿐 아니라 구조, 학습 레시피, 후학습 전략, 하드웨어 선택의 다양성이 함께 좌우하는 방향으로 더 빠르게 이동할 수 있다 [1][

6].