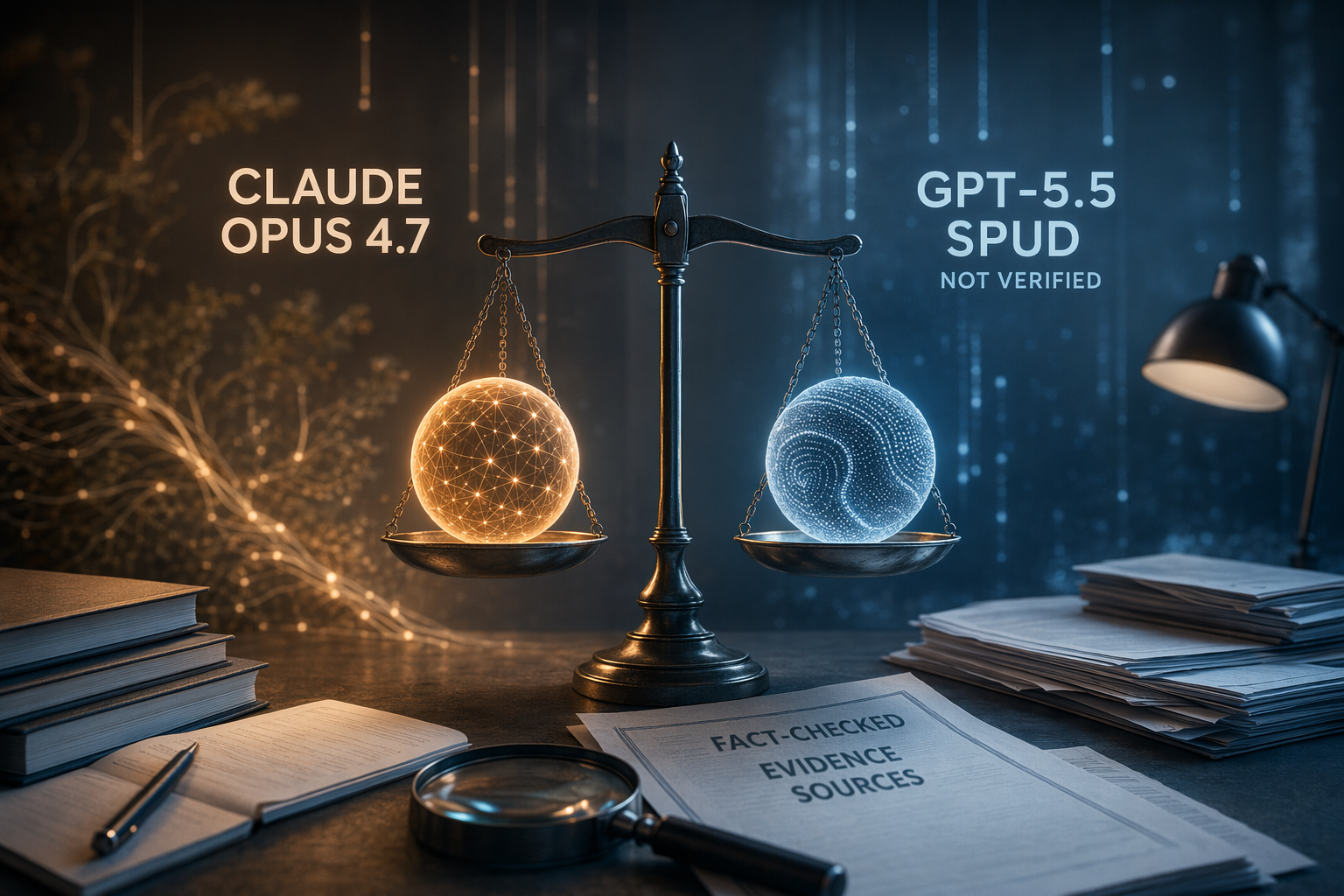

Claude Opus 4.7とGPT-5.5 Spudのどちらがハルシネーション、つまり事実らしく見える誤情報を出しにくいのか。この問いは一見、モデル同士のランキング比較に見えます。ですが、まず確認すべきなのはモデル名です。

AnthropicはClaude Opus 4.7とAPI識別子claude-opus-4-7を文書化しています。一方、提供されたOpenAIの公式資料で確認できるのはGPT-5、GPT-5 mini、GPT-5.2-Codex、GPT-5.4のプロンプトガイダンスであり、GPT-5.5 Spudという公開モデルではありません [12][

16][

23][

25][

26][

29][

45]。そのため、現時点で言えるのは勝敗ではなく、Claude Opus 4.7は評価対象にできるが、GPT-5.5 Spudは公式リリース、モデルカード、API文書などに結び付かない限り、ベンチマーク対象として扱うべきではない、ということです。

まず結論:勝者はまだ決められない

| 論点 | 根拠に基づく答え |

|---|---|

| Claude Opus 4.7は確認済みか | はい。AnthropicはClaude Opus 4.7を文書化し、開発者がClaude APIでclaude-opus-4-7を使えると説明しています [ |

| GPT-5.5 SpudはOpenAIの公式モデルとして確認済みか | 提供されたOpenAI公式資料では確認できません。そこにあるのはGPT-5、GPT-5 mini、GPT-5.2-Codex、GPT-5.4のプロンプトガイダンスです [ |

| Spudという名前はどこに出てくるか | Reddit投稿とOpenAI Developer Communityの機能要望スレッドに出てきますが、リリースノートやAPIのモデル文書ではありません [ |

| Claude対Spudの幻覚ベンチマークはあるか | 提供された資料には、同一タスク・同一採点の直接比較はありません。公平な評価では、誤答だけでなく棄権、つまり答えない判断も別に採点すべきです [ |

これは、将来または非公開のSpudモデルが存在し得ないと証明するものではありません。あくまで、現在の引用資料からはGPT-5.5 SpudをOpenAIの公式モデルとして扱えず、幻覚の少なさでClaudeと勝敗を付ける根拠もない、という意味です。

Claude Opus 4.7について確認できること

Claude Opus 4.7について最も強い根拠は、横並びの幻覚ランキングではなくAnthropicの製品資料です。Anthropicは開発者がclaude-opus-4-7をClaude API経由で使えると説明し [16]、ドキュメントではClaude Opus 4.7にタスク予算が導入されたとしています [

12]。

タスク予算は、モデルにどれだけ作業させるかを制御するうえでは重要です。ただし、それだけでモデルが不確かな事実主張をいつ控えるか、つまり較正された不確実性をどれほど備えているかを示す公開ベンチマークにはなりません。

誠実性に関する注目材料はあります。MashableはAnthropicのOpus 4.7システムカードを引用し、Claude Opus 4.7のMASK honesty rateが91.7%で、従来のAnthropicモデルや他のフロンティアAIモデルよりハルシネーションや過度な同調が少ないと報じました [14]。これは有用な情報ですが、検証済みのGPT-5.5 Spudモデルとの同一条件比較ではないため、Claude対Spudの答えにはなりません。

OpenAIの資料で確認できること

提供されたOpenAI資料で確認できるのは、GPT-5、GPT-5 mini、GPT-5.2-Codex、GPT-5.4のプロンプトガイダンスです [23][

25][

26][

29][

45]。この資料群でSpudという名前が出てくるのは、Reddit投稿とOpenAI Developer Communityの機能要望スレッドです [

7][

8][

10][

28]。

コミュニティ投稿は、噂や関心の所在を知る手掛かりにはなります。しかし、公式のモデルページ、モデルカード、API識別子、リリース告知と同じ重みでは扱えません。

一方で、OpenAIのハルシネーション解説は、評価設計の参考になります。OpenAIは、一般的な訓練や評価の仕組みが不確実性を認めるよりも推測を報いるため、モデルが自信ありげに間違う方向へ誘導されると説明しています。また、確信を持って誤情報を出すより、不確実性を示す、または確認のために質問する方がよいとも述べています [3]。

OpenAIのSimpleQA例は、正答率だけでは実態を見誤ることを示しています。そこではgpt-5-thinking-miniが棄権52%、正答22%、誤答26%とされる一方、o4-miniは棄権1%、正答24%、誤答75%とされています [3]。前者は答える回数が少ないものの、誤答は大幅に少ない例です [

3]。医療、法務、金融、企業の意思決定支援のように誤答コストが高い場面では、この差が単なる正答率以上に重要になります。

本当に見るべき指標は較正された不確実性

ハルシネーション対策は、何でも拒否することではありません。使えるAIは、根拠が十分なら答え、質問が曖昧なら確認し、根拠を持てないなら答えを控える必要があります。このバランスが、較正された不確実性です。

研究面でも、この見方は支持されています。ただし、万能薬ではありません。2024年の研究は、質問応答の場面で不確実性に基づく棄権が正確性、ハルシネーション、安全性を改善すると報告しています [1][

4]。I-CALMは、検証可能な答えを持つ事実質問におけるエピステミックな棄権を扱い、現在のLLMは棄権すべき場面でも棄権に失敗し得ると指摘しています [

54]。行動的に較正された強化学習の研究も、モデルが不確実性を認めて棄権するよう促す方法を検討しています [

61]。

より広いレビューでも、不確実性の定量化はハルシネーション検出の道具とされ、較正された不確実性はモデルの回答を信頼するか、人に回すか、追加検証するかを判断する助けになると説明されています [53][

55]。

ただし、棄権は多ければよいわけではありません。分かりませんばかりのモデルは安全でも役に立たず、逆に一切棄権しないモデルは便利に見えても危険です。重要なのは、答えるべき場面で答え、答えるべきでない場面で止まることです。

実務で比較するならこう測る

- 公式モデルIDを使う。 Claude側は

claude-opus-4-7を使い、OpenAI側は未確認のSpudラベルではなく、GPT-5やGPT-5 miniなど文書化されたモデルを使います [16][

23][

25][

29]。

- 問題セットを混ぜる。 答えられる質問、条件が足りない依頼、答えようがない質問を入れます。不確実性が高いときや安全に答えられないときに控える価値は、棄権研究の中心的な論点です [

1][

4]。

- 棄権を別に採点する。 正答、誤答、正しい棄権、誤った棄権を分けて記録します。棄権に関する調査では、棄権精度、適合率、再現率などの指標が整理されています [

68]。

- 事実の不確実性と安全上の拒否を分ける。 有害な依頼を拒むことと、根拠不足のため事実回答を控えることは同じではありません。I-CALMが扱うのは、検証可能な事実質問に対するエピステミックな棄権です [

54]。

- 正答率、誤答率、棄権率を一緒に出す。 OpenAIのSimpleQA例が示すように、棄権率が高いモデルは正答率が同程度でも誤答率が大きく下がることがあります [

3]。

- 環境条件をそろえる。 検索、RAG、ブラウジング、ツールアクセス、コンテキスト長、システム指示が違えば、結果はモデル本体だけでなく評価環境の差を反映してしまいます。

FAQ

GPT-5.5 Spudは実在するのか

少なくとも、この資料群の範囲ではOpenAIの公式モデルとしては確認できません。引用されたOpenAI公式資料はGPT-5、GPT-5 mini、GPT-5.2-Codex、GPT-5.4のプロンプトガイダンスを確認しており、SpudはReddit投稿とコミュニティの機能要望スレッドに出てくるだけです [7][

8][

10][

23][

25][

26][

28][

29][

45]。

Claude Opus 4.7はGPT-5.5 Spudよりハルシネーションが少ないのか

この資料だけでは厳密には答えられません。Claude Opus 4.7は公式に文書化されており [12][

16]、MASK honesty rate 91.7%という二次報道もあります [

14]。しかし、検証済みのGPT-5.5 Spudという比較対象がなく、両者を同じ条件で採点したベンチマークも提示されていません [

7][

8][

10][

28][

68]。

企業や開発者は何を比べればいいのか

Claude Opus 4.7と、GPT-5やGPT-5 miniなど文書化されたOpenAIモデルを、同じタスク、同じツール、同じプロンプト、同じ採点基準で比較すべきです。見るべき指標は正答率だけでなく、誤答率と棄権の質を含めたセットです [3][

68]。

最後に

この証拠から、Claudeが勝った、あるいはSpudが勝ったとは言えません。支持できる結論はもっと限定的です。Claude Opus 4.7は公式に文書化されている。GPT-5.5 Spudは、引用されたOpenAI公式資料では確認されていない。そしてハルシネーション制御を評価するなら、根拠のない主張を避ける正しい棄権を含め、較正された不確実性を評価軸に入れる必要があります [3][

12][

16][

23][

25][

29][

45][

68]。