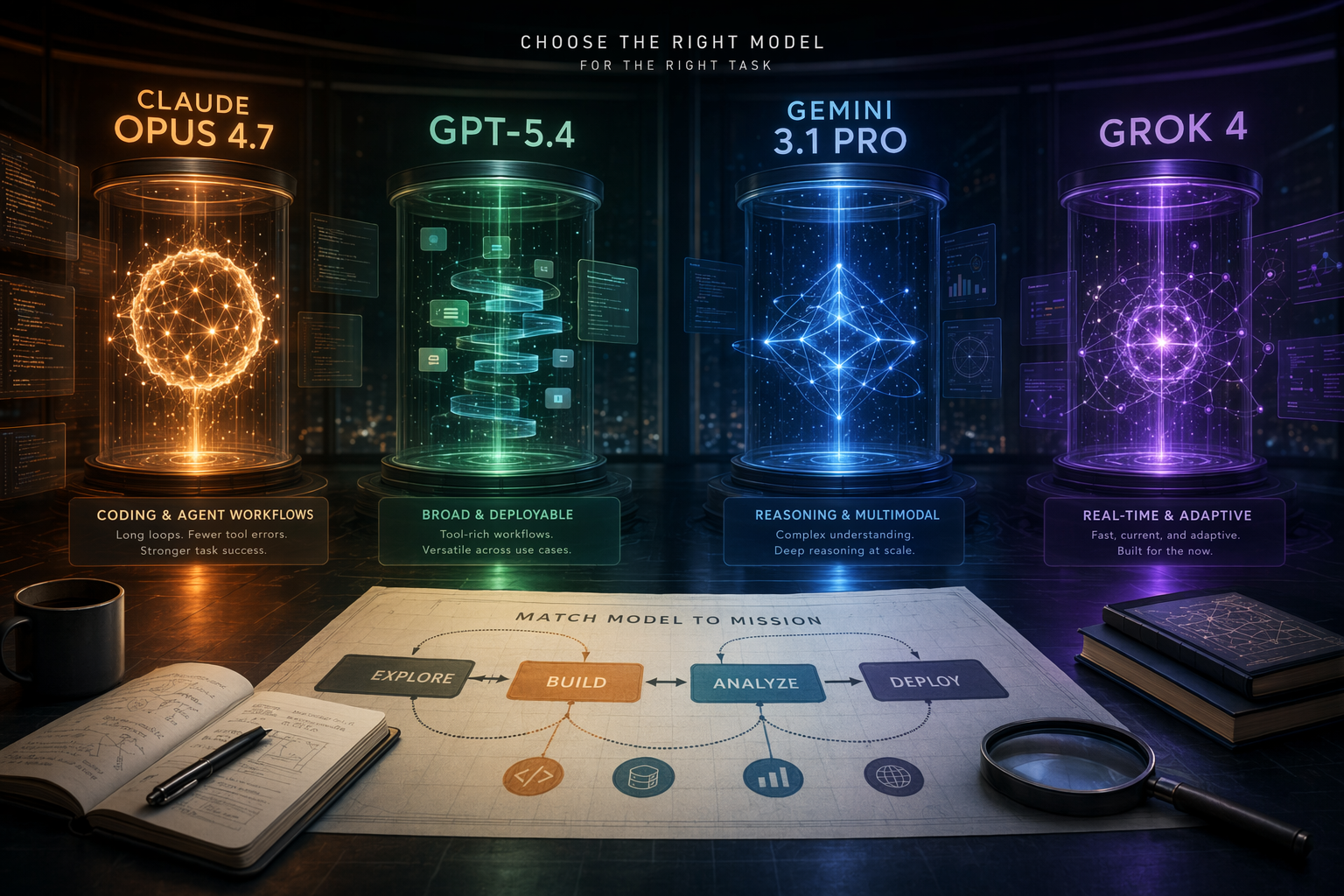

AIモデル選びで最初に捨てたい発想は、「結局どれが一番強いのか」という一問一答です。Claude Opus 4.7、GPT-5.4、Gemini 3.1 Pro、Grok 4はいずれも強力ですが、失敗しやすい場面が違います。第三者によるLLM選定ガイドも、単一のモデルがすべてのタスクを支配しているわけではなく、coding、構造化推論、多モーダル、科学系タスク、高難度推論で強みが分かれると整理しています。[5]

まずは用途別に見る:早見表

| 主な用途 | 最初に試したいモデル | 根拠として見えるもの | 注意点 |

|---|---|---|---|

| 複雑なcoding、エージェント型ワークフロー、安定したツール呼び出し | Claude Opus 4.7 | Anthropicは、Opus 4.7がOpus 4.6に比べてFactory Droidsのタスク成功率を10〜15%押し上げ、ツールエラーも少なく、より信頼性が高いと説明しています。Axiosも、codingとvisionを強化した旗艦モデルのアップグレードとして報じています。[ | 主にOpus 4.6比の改善を示す情報であり、4モデルを同条件で横並び比較した結論ではありません。 |

| 厳密な手順実行、構造化推論、computer use | GPT-5.4 | 第三者ガイドは、GPT-5.4がstructured reasoningとcomputer useに強く、OSWorld 75%を挙げています。[ | 実際の業務フロー、連携ツール、エラー許容度で検証が必要です。 |

| 画像・図表・スクリーンショット、抽象推論、科学系の調査補助 | Gemini 3.1 Pro | 第三者ガイドは、Gemini 3.1 Proがabstract reasoning、multimodal input、scientific benchmarksで上位にあり、GPQA 94.3%を挙げています。[ | 多モーダルや科学系に強いことは、coding agentや長いツール実行でも常に最強という意味ではありません。 |

| 高難度推論ベンチマーク | Grok 4 | 第三者ガイドは、Grok 4がHLE指標で50.7%とリードしているとしています。[ | 単一の高難度推論指標を、一般的な業務ワークフロー全体の優位性にそのまま広げるのは危険です。 |

| コスト、ベンダー分散、オープンソース系の選択肢 | MiniMax、GLM、Kimiなども候補 | 同じガイドは、MiniMax M2.5/M2.7、GLM-5/5.1、Kimi K2.5などがSWE-bench系タスクで最前線のプロプライエタリモデルに近づいているとしています。[ | SWE-benchで接近していても、APIの安定性、多モーダル、文章品質、安全機能、製品統合まで同等とは限りません。 |

Claude Opus 4.7:codingとツール信頼性が評価の中心

Claude Opus 4.7で最も注目すべき公開情報は、Anthropicが「タスク成功率」と「ツールエラーの少なさ」を前面に出している点です。公式ページでは、Claude Opus 4.7はOpus 4.6を上回り、Factory Droidsでのタスク成功率が10〜15%向上し、ツールエラーが少なく、より信頼性が高いとされています。[11]

これは、ソフトウェア開発やエージェント型ワークフローで特に重要です。こうしたタスクでは、単発の質問に正解できるかよりも、複数ステップを進める途中でツール呼び出しに失敗しないか、関係ないファイルを編集しないか、文脈を保ったまま修正を続けられるかが効いてきます。AxiosもOpus 4.7を、codingとvisionを改善したAnthropicの旗艦モデルの有意義なアップグレードとして報じています。[12]

ただし、ここで言えるのはあくまで「Opus 4.7はOpus 4.6から明確に強化されている」ということです。GPT-5.4、Gemini 3.1 Pro、Grok 4を含む同条件の公式な横比較で全面的に勝っている、とまでは言えません。[11][

5]

GPT-5.4:構造化推論とcomputer useを重視するなら候補

業務が、ルールに沿った判断、表形式の処理、操作手順の実行、ツールの組み合わせ、多段階の意思決定に寄っているなら、GPT-5.4は最初の比較対象に入れるべきです。第三者のLLM選定ガイドは、GPT-5.4がstructured reasoningとcomputer useで目立ち、OSWorld 75%を記録しているとしています。[5]

ここで大切なのは、GPT-5.4がすべての面でClaude Opus 4.7より上だと決めつけないことです。失敗コストが「手順を飛ばす」「操作を間違える」「ツール連携の順序を崩す」といった部分にあるなら、GPT-5.4とOpus 4.7を同じ業務条件で並べて試す価値が高い、という見方が現実的です。[5]

Gemini 3.1 Pro:多モーダル、抽象推論、科学系タスクで見る

入力に画像、図表、資料のスクリーンショット、研究論文的な内容、科学系の設問が多いなら、Gemini 3.1 Proを候補から外すべきではありません。第三者ガイドは、Gemini 3.1 Proがabstract reasoning、multimodal input、scientific benchmarksで強く、GPQA 94.3%を挙げています。[5]

つまり、モデル選定では「どのブランドが好きか」ではなく「入力と評価軸が何か」を先に決める必要があります。実際のワークフローに視覚情報や科学的な内容が多いのに、codingベンチマークだけで選んでしまうと、Gemini 3.1 Proの強みを見落とす可能性があります。[5]

Grok 4:高難度推論の指標は強いが、過大解釈は禁物

Grok 4は、高難度推論ベンチマークを見るなら注目に値します。第三者ガイドは、Grok 4がHLE指標で50.7%とリードしているとしています。[5]

ただし、HLEのような指標での強さを、一般的な社内業務、コンテンツ制作、coding agent、ツール利用能力の全面的な優位にそのまま置き換えるのは避けたいところです。別のモデルランキング記事も、ベンチマークは有用だが、日常的な開発体験は信頼性、UIの使いやすさ、コストによって大きく左右されると指摘しています。[6]

ランキングだけで決めないほうがいい理由

第一に、ランキング表は異なるベンチマークと異なる更新時点のデータを混ぜていることがあります。Failing FastのAI coding model comparisonでは、データソースとしてSWE-benchは2026年2月、Aiderは2025年10月、Arena Codeは2026年2月と示されており、すべてが同じ日付・同じ条件の比較ではありません。[2] こうした表は方向感をつかむには便利ですが、全モデルの絶対順位として扱うのは危ういです。

第二に、公式の自己比較と第三者の横断比較は、証拠の性質が違います。AnthropicのOpus 4.7情報が最も強く示しているのは、Opus 4.6からの改善です。一方、第三者ガイドはモデル選定の手がかりにはなりますが、OpenAI、Google、xAI、Anthropicが共同で出した公式な頭脳戦の結果ではありません。[11][

5]

第三に、実務での使い勝手はベンチマーク以外にも左右されます。モデルランキング記事が指摘するように、ベンチマークは役立つ一方で、日々の構築体験は信頼性、UI能力、コストに大きく依存します。[6]

導入前にやるべき実測チェックリスト

調達、社内標準化、本番導入を考えるなら、「どのモデルが最強か」ではなく「自社の失敗パターンを減らせるか」を測るべきです。実務では、次のように3〜5個の候補モデルを同じ条件で比べるのが安全です。

- 毎日または毎週本当に発生するタスクを5〜10個選ぶ。例:バグ修正、機能追加、リファクタリング、長文資料の読解、スクリーンショット分析、仕様書作成、外部ツール呼び出し。

- すべてのモデルに同じプロンプト、同じ背景資料、同じ合格基準を使う。

- 一次通過率、返工回数、ツールエラー、幻覚、遅延、コスト、人間による修正時間を記録する。

- 最高の回答だけでなく、最悪の回答を見る。本番環境では、デモの成功例より失敗モードのほうが重要です。

- 機密情報、規制対応、プライバシー要件がある場合は、データ保持、デプロイ形態、管理者向け制御機能も別途確認する。

結論:Claude Opus 4.7は有力候補。ただし「万能の一位」とは限らない

Claude Opus 4.7は、coding、エージェント型ワークフロー、ツールを使う長い作業で最初に試す価値が高いモデルです。Anthropicの公式情報では、Opus 4.6に比べてFactory Droidsのタスク成功率とツールエラー面で改善が示されており、Axiosもcodingとvisionを強化した旗艦モデルとして報じています。[11][

12]

一方で、「どのモデルが全用途で一番か」と聞かれると、現時点で引用できる証拠だけでは断定できません。第三者ガイドの結論に近い見方をするなら、単一のモデルがすべてのタスクを支配しているわけではなく、GPT-5.4、Gemini 3.1 Pro、Grok 4、さらに新興モデルにもそれぞれ強みがあります。[5]

実務的には、Claude Opus 4.7をcodingとagentタスクの第一候補に置きつつ、GPT-5.4、Gemini 3.1 Pro、Grok 4を同じ業務タスクで比較するのが最も堅実です。