ReportsPublished7 sources

GPT-5.5, Claude Opus 4.7, DeepSeek V4 và Kimi K2.6: so sánh benchmark theo từng tác vụ

Không có “vua benchmark” duy nhất: Claude Opus 4.7 dẫn GPQA Diamond 94.2% và HLE không tool 46.9%, GPT 5.5 Pro dẫn HLE có tool 57.2% và BrowseComp 90.1%, còn GPT 5.5 dẫn Terminal Bench 2.0 với 82.7%; Kimi K2.6 thiếu m... DeepSeek V4 Pro Max không dẫn các hàng benchmark trực tiếp trong bảng VentureBeat, nhưng được mô...

319K0

AI Prompt

openai.comCreate a landscape editorial hero image for this Studio Global article: GPT-5.5 vs Claude Opus 4.7 vs DeepSeek V4 vs Kimi K2.6: Benchmark 2026. Article summary: Không có mô hình thắng tuyệt đối: Claude Opus 4.7 dẫn GPQA Diamond ở 94.2% và HLE không tool, GPT 5.5 Pro dẫn HLE có tool ở 57.2%, còn GPT 5.5 dẫn Terminal Bench 2.0 ở 82.7%.. Topic tags: ai, llm benchmarks, openai, anthropic, deepseek. Reference image context from search candidates: Reference image 1: visual subject "# 2026年4月最新四大模型横评:Kimi K2.6 vs Claude Opus 4.7 vs GPT-5.5 vs DeepSeek V4,差距到底有多大?. # 同周发布四大旗舰,差距到底有多大?Kimi K2.6 / Claude Opus 4.7 / GPT-5.5 / DeepSeek V4 深度横评. **2026 年 4 月的第三周,AI" source context "2026年4月最新四大模型横评:Kimi K2.6 vs Claude Opus 4.7 vs GPT-5.5 vs DeepSeek V4,差距到底有多大? - 七牛云行业应用 - 博客园" Reference image 2: visual subject "[Kimi K2 vs Claude Opus 4.7 vs GPT 5.5 Comparison](https://www.youtube.com/watch?v=M90iB4h

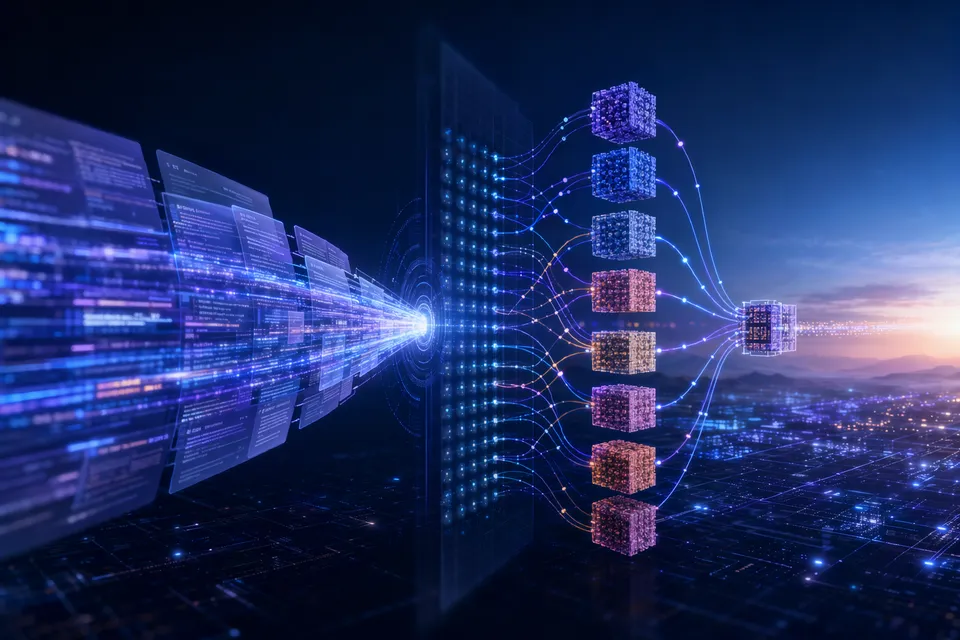

Benchmark AI năm 2026 nên được đọc như bản đồ năng lực, không phải một bảng xếp hạng tổng lực. Với các nguồn hiện có, kết luận đáng tin nhất là chọn mô hình theo tác vụ: Claude Opus 4.7 mạnh ở reasoning không dùng tool và SWE-Bench Pro; GPT-5.5 Pro nổi bật ở tool use và browsing; GPT-5.5 có tín hiệu tốt nhất trên terminal; DeepSeek V4 đáng chú ý về chi phí/hiệu năng nhưng có cảnh báo hallucination; còn Kimi K2.6 có một số điểm riêng lẻ nhưng chưa có ma trận so sánh đồng nhất với đầy đủ các đối thủ [1][

2][

3][

8][

9].

Bảng so sánh benchmark chính

Dấu “—” trong bảng nghĩa là nguồn được trích không cung cấp số liệu đối chiếu trực tiếp cho mô hình đó trên cùng benchmark, không phải điểm bằng 0.

| Benchmark | GPT-5.5 |

|---|

Studio Global AI

Search, cite, and publish your own answer

Use this topic as a starting point for a fresh source-backed answer, then compare citations before you share it.

Key takeaways

- Không có “vua benchmark” duy nhất: Claude Opus 4.7 dẫn GPQA Diamond 94.2% và HLE không tool 46.9%, GPT 5.5 Pro dẫn HLE có tool 57.2% và BrowseComp 90.1%, còn GPT 5.5 dẫn Terminal Bench 2.0 với 82.7%; Kimi K2.6 thiếu m...

- DeepSeek V4 Pro Max không dẫn các hàng benchmark trực tiếp trong bảng VentureBeat, nhưng được mô tả là gần state of the art với chi phí khoảng 1/6 so với Opus 4.7 và GPT 5.5; cần kiểm thử riêng vì Artificial Analysis...

- Cách chọn thực dụng: Claude cho reasoning khó và SWE Bench Pro; GPT 5.5 Pro cho tool, browsing và web research; GPT 5.5 cho workflow terminal; DeepSeek cho bài toán chi phí; Kimi khi các benchmark riêng như GPQA, SWE...

People also ask

Câu trả lời ngắn gọn cho "GPT-5.5, Claude Opus 4.7, DeepSeek V4 và Kimi K2.6: so sánh benchmark theo từng tác vụ" là gì?

Không có “vua benchmark” duy nhất: Claude Opus 4.7 dẫn GPQA Diamond 94.2% và HLE không tool 46.9%, GPT 5.5 Pro dẫn HLE có tool 57.2% và BrowseComp 90.1%, còn GPT 5.5 dẫn Terminal Bench 2.0 với 82.7%; Kimi K2.6 thiếu m...

Những điểm chính cần xác nhận đầu tiên là gì?

Không có “vua benchmark” duy nhất: Claude Opus 4.7 dẫn GPQA Diamond 94.2% và HLE không tool 46.9%, GPT 5.5 Pro dẫn HLE có tool 57.2% và BrowseComp 90.1%, còn GPT 5.5 dẫn Terminal Bench 2.0 với 82.7%; Kimi K2.6 thiếu m... DeepSeek V4 Pro Max không dẫn các hàng benchmark trực tiếp trong bảng VentureBeat, nhưng được mô tả là gần state of the art với chi phí khoảng 1/6 so với Opus 4.7 và GPT 5.5; cần kiểm thử riêng vì Artificial Analysis...

Tôi nên làm gì tiếp theo trong thực tế?

Cách chọn thực dụng: Claude cho reasoning khó và SWE Bench Pro; GPT 5.5 Pro cho tool, browsing và web research; GPT 5.5 cho workflow terminal; DeepSeek cho bài toán chi phí; Kimi khi các benchmark riêng như GPQA, SWE...

Tôi nên khám phá chủ đề liên quan nào tiếp theo?

Tiếp tục với "Ôn thi cảnh sát Hong Kong: ICAC, quyền lực cảnh sát và trách nhiệm giải trình" để có góc nhìn khác và trích dẫn bổ sung.

Open related pageTôi nên so sánh điều này với cái gì?

Kiểm tra chéo câu trả lời này với "Claude Opus 4.7, GPT-5.5, DeepSeek V4 và Kimi K2.6: benchmark 2026 nói gì?".

Open related pageContinue your research

Sources

- [1] DeepSeek is back among the leading open weights models with V4 ...artificialanalysis.ai

Gains in knowledge but an increase in hallucination rate: DeepSeek V4 Pro (Max) scores -10 on AA-Omniscience, an 11 point improvement over V3.2 (Reasoning, -21), driven primarily by higher accuracy. V4 Flash (Max) scores -23, broadly in line with V3.2. V4 P...

- [2] DeepSeek-V4 arrives with near state-of-the-art intelligence at 1/6th ...venturebeat.com

BenchmarkDeepSeek-V4-Pro-MaxGPT-5.5GPT-5.5 Pro, where shownClaude Opus 4.7Best result among these GPQA Diamond90.1%93.6%—94.2%Claude Opus 4.7 Humanity’s Last Exam, no tools37.7%41.4%43.1%46.9%Claude Opus 4.7 Humanity’s Last Exam, with tools48.2%52.2%57.2%54...

- [3] DeepSeek-V4-Pro-Max: Pricing, Benchmarks & Performancellm-stats.com

SWE-Bench ProView → 11 of 11 Image 35: LLM Stats Logo SWE-Bench Pro is an advanced version of SWE-Bench that evaluates language models on complex, real-world software engineering tasks requiring extended reasoning and multi-step problem solving. More 1Image...

- [5] GPT-5.5: The Complete Guide (2026) - o-mega | AIo-mega.ai

Terminal-Bench 2.0 measures the ability to complete real CLI workflows: multi-step tasks involving file manipulation, script execution, debugging, and tool coordination. GPT-5.5's 82.7% score is the highest ever recorded, though the margin over Claude Mytho...