ReportsPublished5 sources

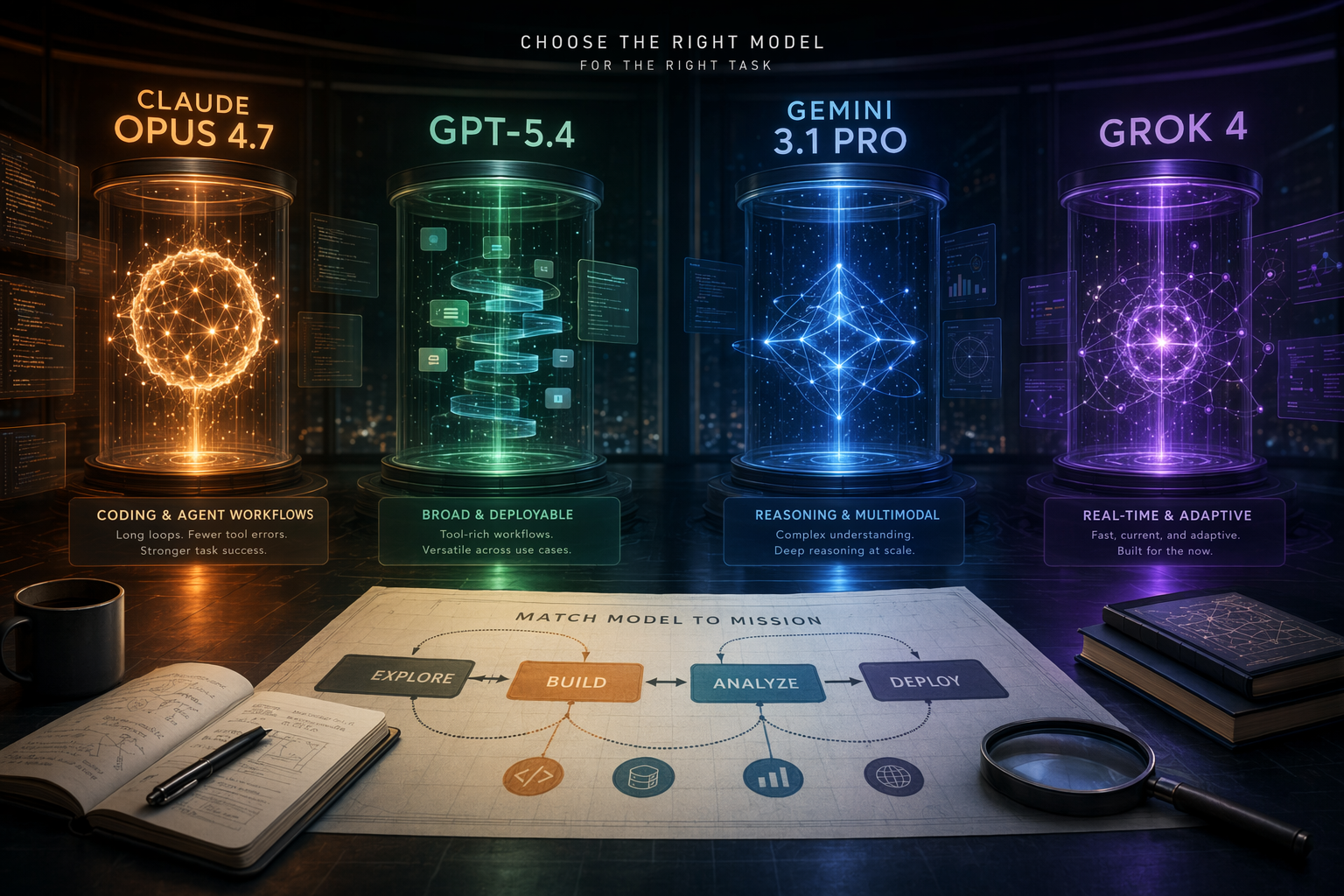

Claude Opus 4.7 與 GPT-5.4、Gemini 3.1 Pro、Grok 4 怎麼選?

如果主戰場是 coding 與 agent workflow,Claude Opus 4.7 最值得先測:Anthropic 稱它相較 Opus 4.6 在 Factory Droids 任務成功率提高 10% 至 15%、工具錯誤更少;但這不是對 GPT 5.4、Gemini 3.1 Pro、Grok 4 的同條件頭對頭評測。[11][5] GPT 5.4 適合優先測結構化推理與 computer use;Gemini 3.1 Pro 偏多模態、抽象推理與科學基準;Grok 4 則在 HLE 高難推理指標有亮點。[5] 採購或上線前,應用 5 到 10 個真實任務比較一次通過率、工具錯誤、返工、延遲與成本;排行榜資料日期可能...

103K0

AI Prompt

openai.comCreate a landscape editorial hero image for this Studio Global article: Claude Opus 4.7 vs GPT-5.4、Gemini 3.1 Pro、Grok 4:按任務選模型. Article summary: Claude Opus 4.7 應先用在 coding 與 agent workflow:Anthropic 稱它相較 Opus 4.6 在 Factory Droids 任務成功率提升 10% 至 15%、工具錯誤更少;但這不是對 GPT 5.4、Gemini 3.1 Pro、Grok 4 的同條件頭對頭證明。[11][5]. Topic tags: ai, llm, claude, chatgpt, gemini. Reference image context from search candidates: Reference image 1: visual subject "Start with Claude Opus 4.7 for premium coding and long agent loops, GPT-5.4 for the broadest deployable tool-rich workflows, and Gemini 3.1" source context "Claude Opus 4.7 vs GPT-5.4 vs Gemini 3.1 Pro: Which Model Should You Test First? | LaoZhang AI Blog" Reference image 2: visual subject "Claude Opus 4.7 vs GPT-5.4 vs Gemini 3.1 Pro Benchmarks" source context "Claude Opus 4.7 vs GPT-5.4 vs Gemini 3.1 — I Tested Them for 48 Hours (Here’s What Actually W

把 Claude Opus 4.7、GPT-5.4、Gemini 3.1 Pro、Grok 4 放在同一張表上時,最實用的問題不是誰是絕對第一,而是你的任務最容易在哪裡失敗。第三方 LLM 選型指南的核心結論是:沒有單一模型能主宰所有任務;不同模型在 coding、結構化推理、多模態、科學題或高難推理上各有強項。[5]

快速選型表

| 你的主要任務 | 最值得先測 | 目前證據 | 主要保留 |

|---|---|---|---|

| 複雜 coding、agent workflow、需要穩定工具呼叫 | Claude Opus 4.7 | Anthropic 稱 Opus 4.7 相較 Opus 4.6,在 Factory Droids 任務成功率提升 10% 至 15%,且工具錯誤更少、可靠性更高;Axios 也把它描述為 coding 與 vision 升級的旗艦模型。[ | 這主要支持 Opus 4.7 相對 Opus 4.6 的升級,不是四家模型同條件頭對頭結論。 |

| 嚴格流程、結構化推理、computer use | GPT-5.4 | 第三方指南稱 GPT-5.4 擅長 structured reasoning 與 computer use,並列出 OSWorld 75%。[ | 仍需要用你的流程、工具與錯誤標準實測。 |

| 多模態輸入、抽象推理、科學題與研究輔助 | Gemini 3.1 Pro | 第三方指南稱 Gemini 3.1 Pro 在 abstract reasoning、multimodal input 與 scientific benchmarks 上居前,並列出 GPQA 94.3%。[ | 多模態與科學基準強,不等於 coding agent 或長流程工具使用一定最強。 |

Studio Global AI

Search, cite, and publish your own answer

Use this topic as a starting point for a fresh source-backed answer, then compare citations before you share it.

Key takeaways

- 如果主戰場是 coding 與 agent workflow,Claude Opus 4.7 最值得先測:Anthropic 稱它相較 Opus 4.6 在 Factory Droids 任務成功率提高 10% 至 15%、工具錯誤更少;但這不是對 GPT 5.4、Gemini 3.1 Pro、Grok 4 的同條件頭對頭評測。[11][5]

- GPT 5.4 適合優先測結構化推理與 computer use;Gemini 3.1 Pro 偏多模態、抽象推理與科學基準;Grok 4 則在 HLE 高難推理指標有亮點。[5]

- 採購或上線前,應用 5 到 10 個真實任務比較一次通過率、工具錯誤、返工、延遲與成本;排行榜資料日期可能不一致,日常體驗也會受可靠性、UI 能力與成本影響。[2][6]

People also ask

「Claude Opus 4.7 與 GPT-5.4、Gemini 3.1 Pro、Grok 4 怎麼選?」的簡短答案是什麼?

如果主戰場是 coding 與 agent workflow,Claude Opus 4.7 最值得先測:Anthropic 稱它相較 Opus 4.6 在 Factory Droids 任務成功率提高 10% 至 15%、工具錯誤更少;但這不是對 GPT 5.4、Gemini 3.1 Pro、Grok 4 的同條件頭對頭評測。[11][5]

最值得優先驗證的重點是什麼?

如果主戰場是 coding 與 agent workflow,Claude Opus 4.7 最值得先測:Anthropic 稱它相較 Opus 4.6 在 Factory Droids 任務成功率提高 10% 至 15%、工具錯誤更少;但這不是對 GPT 5.4、Gemini 3.1 Pro、Grok 4 的同條件頭對頭評測。[11][5] GPT 5.4 適合優先測結構化推理與 computer use;Gemini 3.1 Pro 偏多模態、抽象推理與科學基準;Grok 4 則在 HLE 高難推理指標有亮點。[5]

接下來在實務上該怎麼做?

採購或上線前,應用 5 到 10 個真實任務比較一次通過率、工具錯誤、返工、延遲與成本;排行榜資料日期可能不一致,日常體驗也會受可靠性、UI 能力與成本影響。[2][6]

下一步適合探索哪個相關主題?

繼續閱讀「香港警務考試溫習指南:ICAC、警權與問責三條主線」,從另一個角度查看更多引用來源。

Open related page我應該拿這個和什麼比較?

將這個答案與「Claude Opus 4.7、GPT-5.5、DeepSeek V4、Kimi K2.6 基準比較:2026 年誰最值得信?」交叉比對。

Open related pageContinue your research

Sources

- [2] AI coding model comparison - Failing Fastfailingfast.io

GPT-5.4 OpenAI 1× $0.28 - - - 80.3 . GPT-5.2 high reasoning OpenAI 1× $0.23 72.8% 88.0% 1470 74.8 . GPT-5.2 OpenAI 1× $0.23 72.8% 88.0% 1432 48.9 . GPT-5 OpenAI 1× $0.16 65.0% 88.0% 1407 70.5 . GPT-5 mini OpenAI 0× $0.03 56.2% 50.2% 1145 - . GPT-5.1 OpenAI...

- [5] The Definitive LLM Selection & Benchmarks Guideiternal.ai

No single model dominates every task. Claude Opus 4.6 leads on coding (Arena code Elo 1548) and nuanced writing, GPT-5.4 excels at structured reasoning and computer use (75% OSWorld, surpassing human expert baseline), Gemini 3.1 Pro wins on abstract reasoni...

- [6] AI Labs LLM Rankings 2026: Claude vs GPT-5 vs Gemini 3 vs Grokadam.holter.com

Claude vs GPT-5 vs Gemini 3 vs Grok vs GLM: Which AI Model Is Best in 2026? Benchmarks are useful, but the daily experience of building is dominated by traits like reliability, UI capability, and whether the cost lets you iterate without second-guessing eve...

- [11] Claude Opus 4.7 - Anthropicanthropic.com

Claude Opus 4.7 is very strong and outperforms Opus 4.6 with a 10% to 15% lift in task success for Factory Droids, with fewer tool errors and more reliable ... 21 hours ago

- [12] Anthropic releases Claude Opus 4.7, concedes it trails ... - Axios