Zyphra ZAYA1-8B importa menos por ser “otro modelo nuevo” y más por la pregunta que plantea: ¿cuánta capacidad de razonamiento puede comprimirse en una huella de cómputo realmente pequeña?

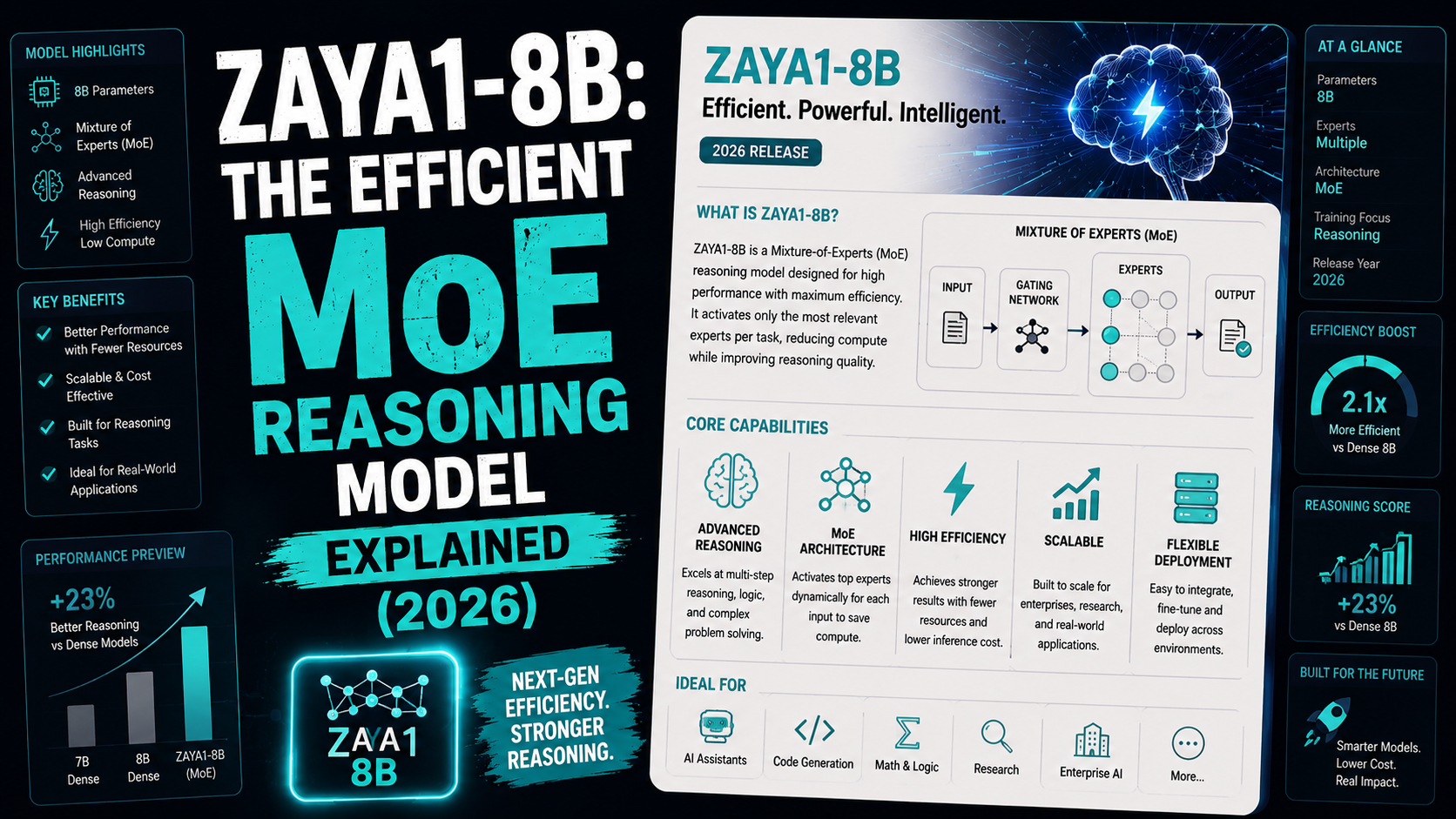

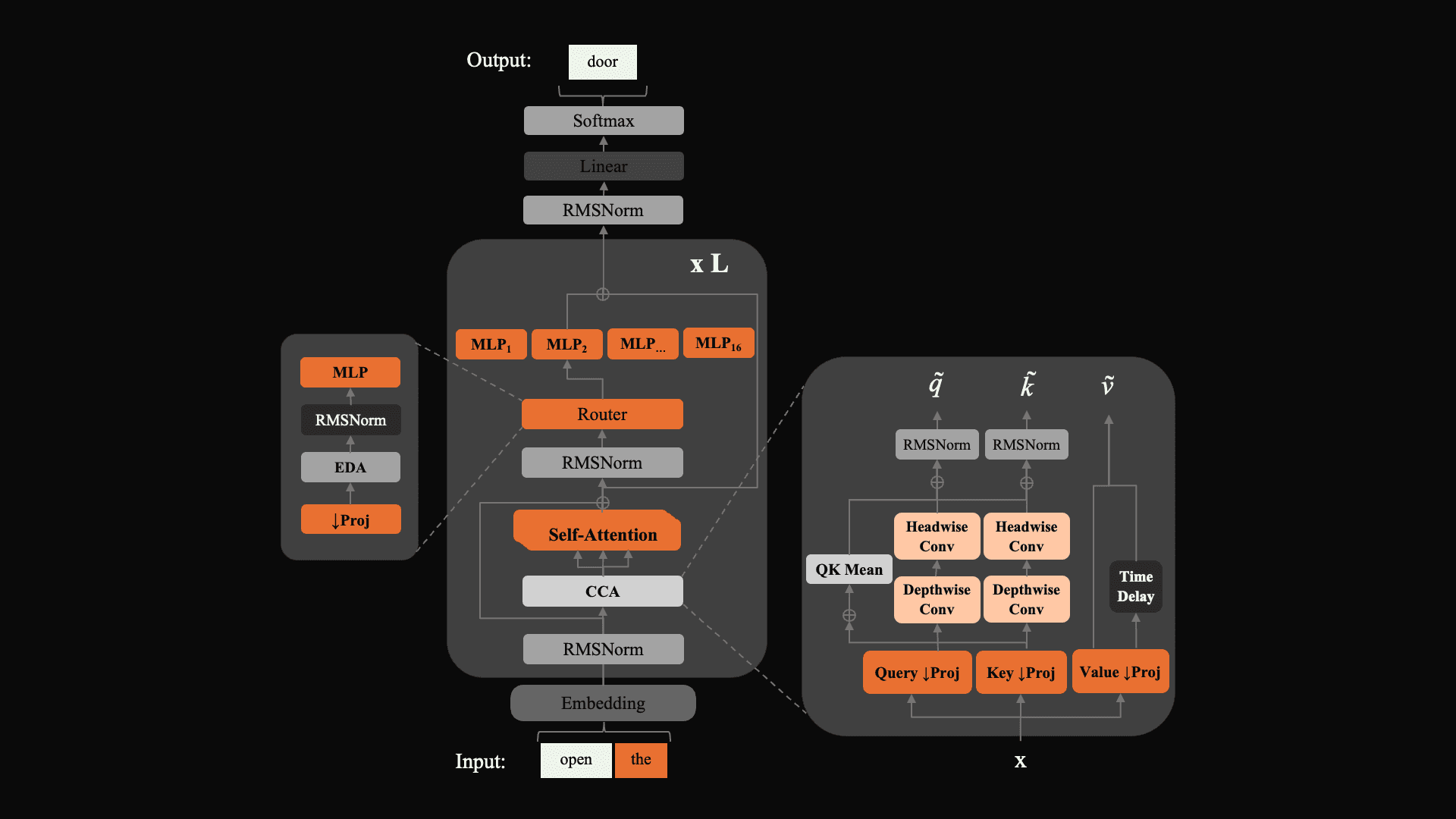

Según Zyphra, ZAYA1-8B es un modelo de lenguaje Mixture-of-Experts, o MoE, con 8.400 millones de parámetros totales y 760 millones de parámetros activos [1][

6]. Esa diferencia es la clave. En un MoE, no todo el modelo se usa a la vez: para cada tarea o token se activan solo ciertas partes, como si el sistema eligiera a qué “expertos” consultar.

Por eso la comparación con modelos mucho más grandes no va solo de tamaño bruto. Va de densidad: cuánto rendimiento útil se obtiene por cada parámetro activo.

Qué es ZAYA1-8B

ZAYA1-8B es un modelo de lenguaje pequeño de tipo Mixture-of-Experts desarrollado por Zyphra. Su ficha en Hugging Face indica que tiene 8.400 millones de parámetros totales, 760 millones de parámetros activos y que fue entrenado de punta a punta por Zyphra [6].

La distinción entre parámetros totales y parámetros activos no es un detalle técnico menor. Zyphra y su anuncio describen ZAYA1-8B como un modelo que opera con menos de 1.000 millones de parámetros activos, aunque su tamaño total sea de 8.400 millones [4][

6].

La compañía lo presenta como un avance en eficiencia de inteligencia para su escala, apoyado en decisiones de arquitectura, preentrenamiento y postentrenamiento [6]. La ficha del modelo señala además que ZAYA1-8B está especialmente orientado al razonamiento largo y detallado, a tareas matemáticas y a programación [

6].

La comparación que de verdad importa

La tesis fuerte de ZAYA1-8B no es “hemos ganado a todos los modelos de frontera”. Es más precisa: Zyphra sostiene que el modelo ofrece una alta densidad de inteligencia, es decir, bastante capacidad de razonamiento concentrada en una parte activa muy pequeña del modelo.

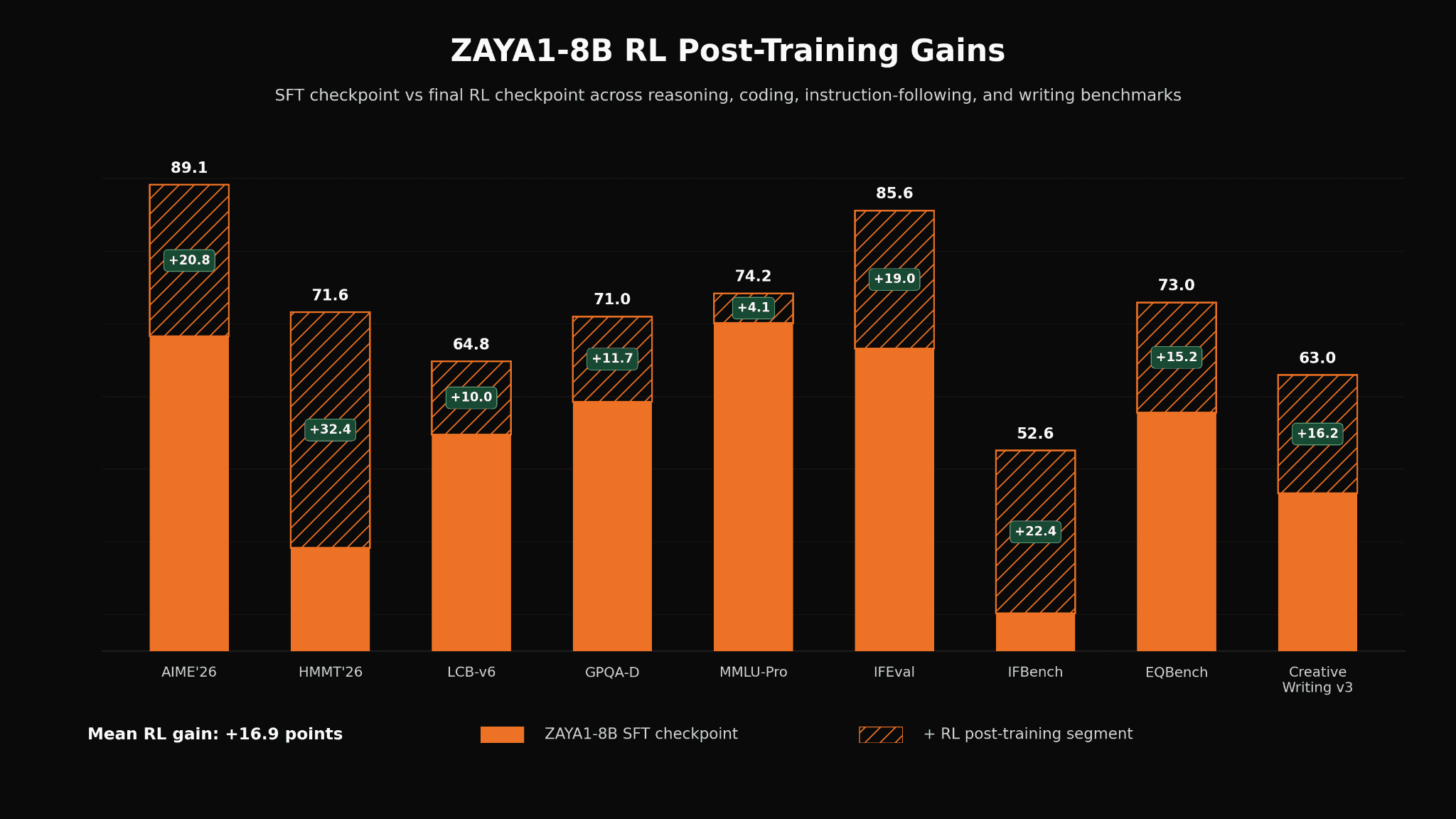

Zyphra afirma que ZAYA1-8B rinde bien en razonamiento complejo, matemáticas y programación, y que supera a modelos abiertos bastante más grandes en ciertos benchmarks de matemáticas y código [1]. El anuncio de la compañía también dice que el modelo iguala o supera a modelos abiertos sustancialmente mayores en razonamiento complejo, matemáticas y programación, usando menos de 1.000 millones de parámetros activos [

4].

Si esos resultados se confirman de forma amplia, el mensaje sería importante: el rendimiento de estilo frontera no dependería únicamente de aumentar el número total de parámetros. En escenarios donde la inferencia pesa mucho —por coste, latencia o despliegue— una huella activa pequeña puede marcar la diferencia. La propia ficha de Zyphra destaca la eficiencia de inferencia y el tamaño reducido del modelo como razones por las que podría funcionar bien en esquemas de cómputo en tiempo de prueba, o test-time compute [6].

Por qué el entrenamiento en AMD llama la atención

ZAYA1-8B también es relevante por cómo fue entrenado. Zyphra dice que es el primer modelo MoE preentrenado, midtrained y ajustado mediante supervised fine-tuning en una pila AMD Instinct MI300 [1]. El anuncio de la empresa lo describe como entrenado en infraestructura AMD de extremo a extremo [

4].

La cobertura secundaria también subrayó que ZAYA1-8B se construyó sobre silicio de AMD y no sobre hardware de Nvidia [3]. La lectura prudente no es que AMD “derrote” a Nvidia en general. Lo que sí puede decirse con respaldo es que Zyphra está presentando una ejecución creíble de entrenamiento MoE avanzado sobre una pila alternativa de aceleradores [

1][

3][

4].

En un mercado donde buena parte de la conversación sobre IA avanzada gira alrededor de la disponibilidad de GPU, esa diversidad de hardware es relevante. No resuelve por sí sola los cuellos de botella de la industria, pero sí muestra que el terreno competitivo puede ser más amplio que una sola ruta tecnológica.

Qué pueden comprobar los desarrolladores

ZAYA1-8B está listado en Hugging Face, lo que ofrece a desarrolladores e investigadores un punto directo para revisar la ficha del modelo y evaluar los detalles de la publicación [6]. Cobertura secundaria indica que el modelo está disponible bajo licencia Apache 2.0 en Hugging Face y también como endpoint serverless en Zyphra Cloud [

5].

Esa disponibilidad importa porque las afirmaciones de eficiencia son más útiles cuando la comunidad puede probar, ejecutar o comparar el modelo por su cuenta. Aun así, una ficha pública no equivale automáticamente a validación independiente y extensa en cargas de trabajo reales.

Lo que todavía no demuestra

Conviene leer ZAYA1-8B como un resultado prometedor de eficiencia, no como un veredicto definitivo sobre la carrera de los modelos de frontera. Muchas de las afirmaciones disponibles proceden de la publicación de investigación de Zyphra, su ficha del modelo, su anuncio o coberturas secundarias [1][

4][

5][

6][

9].

Las fuentes enfatizan matemáticas, programación y razonamiento largo; no prueban superioridad general en todas las tareas [1][

6]. VentureBeat informó que ZAYA1-8B muestra rendimiento competitivo en benchmarks de terceros frente a GPT-5-High y DeepSeek-V3.2, pero eso sigue siendo una comparación de benchmarks, no una demostración de que sea mejor como modelo general en cualquier uso real [

9].

La conclusión más justa es más estrecha, pero también más interesante: ZAYA1-8B parece concentrar una capacidad de razonamiento inusualmente alta en un modelo con menos de 1.000 millones de parámetros activos. Eso ya es significativo, incluso si todavía no decide cómo se comportará frente a todos los sistemas de frontera más grandes en producción.

En resumen

ZAYA1-8B importa porque cambia el foco de la conversación: del tamaño absoluto a la eficiencia. Con 8.400 millones de parámetros totales, 760 millones activos, resultados reportados sólidos en razonamiento, matemáticas y programación, y entrenamiento de extremo a extremo en AMD, el modelo cuestiona la idea de que el razonamiento útil de estilo frontera siempre requiera presupuestos activos mucho mayores [1][

4][

6].

Por ahora, el diagnóstico prudente es: relevante, suficientemente creíble como para seguirlo de cerca, pero aún pendiente de una validación independiente más amplia. Si sus resultados se reproducen en más entornos, ZAYA1-8B apuntaría a una carrera de IA donde la arquitectura, las recetas de entrenamiento, el postentrenamiento y la diversidad de hardware importan tanto como el tamaño bruto del modelo [1][

6].