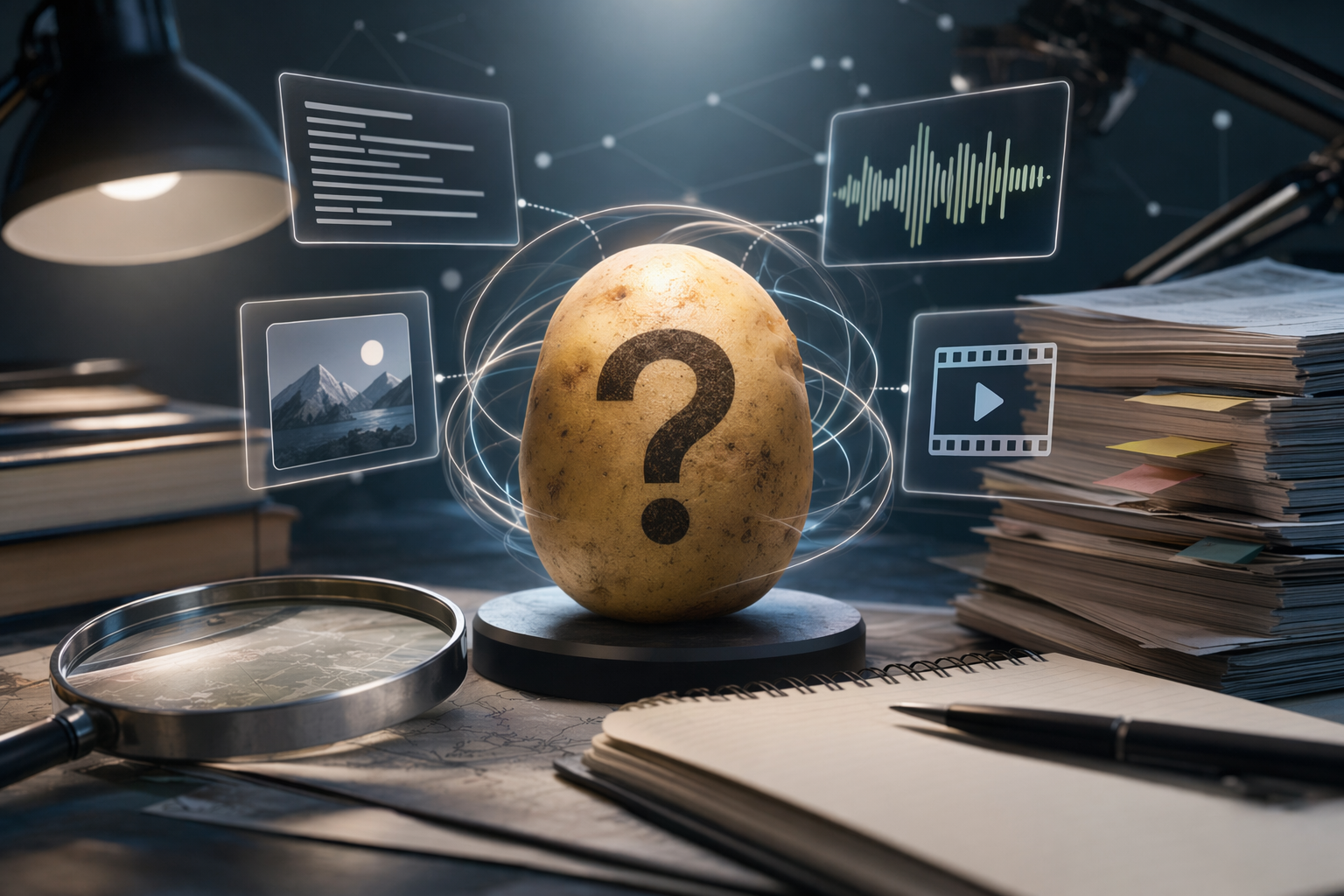

La pregunta no es si OpenAI va hacia modelos capaces de trabajar con varias modalidades. Eso ya está en sus documentos y productos. La pregunta importante es otra: si esas capacidades de texto, imagen, voz y vídeo han sido confirmadas oficialmente dentro de un modelo concreto llamado GPT-5.5 Spud. Con la evidencia pública disponible, la respuesta es no: Spud sigue en el terreno del rumor, no en el de un lanzamiento verificado por OpenAI.[1][

2][

5][

7][

9][

10][

11][

12][

15][

18][

20][

21][

23]

Veredicto: la dirección multimodal es real; Spud no está confirmado

Si por modelo omnimodal entendemos un único modelo oficial capaz de procesar de forma nativa texto, imágenes, audio/voz y vídeo, GPT-5.5 Spud no puede tratarse hoy como algo confirmado. Lo prudente es decir que OpenAI ya ha publicado varias capacidades multimodales, pero las pruebas disponibles las vinculan a GPT-4o, 4o image generation, Realtime API y Sora, no a Spud.[12][

15][

18][

20][

21][

23]

| Punto a verificar | Lo que sí se puede decir | Lo que no se puede concluir |

|---|---|---|

| Nombre y lanzamiento de Spud | Las afirmaciones sobre Spud aparecen sobre todo en artículos no oficiales, Threads, Reddit, YouTube, X y LinkedIn. Algunas incluso hablan en términos de rumores o filtraciones no confirmadas.[ | Eso no demuestra que OpenAI haya lanzado GPT-5.5 Spud. |

| Modelo omni o multimodal | La System Card de GPT-4o describe GPT-4o como un autoregressive omni model y afirma que puede aceptar cualquier combinación de texto, audio, imagen y vídeo como entrada.[ | Esa es evidencia oficial sobre GPT-4o, no sobre Spud. |

| Generación de imágenes | OpenAI presenta 4o image generation como una capacidad impulsada por un modelo nativamente multimodal y sostiene que la generación de imágenes debería ser una capacidad principal de los modelos de lenguaje.[ | No permite afirmar que Spud ya herede o concentre esa función. |

| Voz e interacción en tiempo real | Realtime API permite crear experiencias multimodales de baja latencia; la actualización gpt-realtime menciona un modelo speech-to-speech más avanzado e image input.[ | No prueba que Spud haya unificado la interacción por voz. |

| Generación de vídeo | La documentación oficial de vídeo apunta a Sora, Sora API y una app de ejemplo de Sora para generar o remezclar vídeos.[ | No demuestra que Spud sustituya o integre Sora. |

| Comprensión de vídeo | En la presentación de GPT-4.1 para la API, OpenAI menciona Video-MME como benchmark de comprensión multimodal de contexto largo y cita un 72,0 % en la categoría long, no subtitles, con una mejora de 6,7 puntos porcentuales frente a GPT-4o.[ | Evaluar comprensión de vídeo no equivale a anunciar Spud. |

Por qué el rumor resulta verosímil

El rumor de Spud suena plausible porque encaja con una trayectoria real de OpenAI. GPT-4o ya aparece descrito oficialmente con lenguaje de modelo omni; 4o image generation se presenta como generación de imágenes basada en un modelo nativamente multimodal; y Realtime API lleva la voz, la entrada de imagen y la baja latencia al terreno de productos para desarrolladores.[15][

18][

21][

23]

Con el vídeo ocurre algo parecido. OpenAI presenta Sora 2 como una herramienta para convertir ideas en vídeos con movimiento y sonido; su documentación de API incluye generación de vídeo con Sora; y la app de ejemplo de Sora permite generar y remezclar vídeos cortos a partir de prompts de texto e imágenes de referencia.[12][

13][

20] Todo eso demuestra que OpenAI tiene una línea de producto para vídeo. No demuestra que esa línea haya sido absorbida por GPT-5.5 Spud.

Dicho de otro modo: es razonable pensar que OpenAI seguirá integrando modalidades. Lo que no es razonable, todavía, es atribuir a un nombre no confirmado todas las capacidades que hoy están documentadas bajo GPT-4o, Realtime API y Sora.

Lo que los documentos oficiales sí prueban

GPT-4o: la referencia oficial más cercana al concepto omni

La prueba más sólida para hablar de una estrategia omnimodal no viene de Spud, sino de GPT-4o. La System Card de OpenAI lo llama autoregressive omni model y señala que acepta texto, audio, imagen y vídeo como entrada.[21] Eso permite afirmar que OpenAI ya trabaja con modelos de enfoque omni. No permite afirmar que GPT-5.5 Spud exista como producto oficial.

4o image generation: la imagen ya forma parte del relato oficial

OpenAI ha presentado 4o image generation como una capacidad útil y valiosa, apoyada por un modelo nativamente multimodal, con énfasis en salidas precisas, fotorealistas y capaces de seguir instrucciones.[15] Es una señal fuerte de integración entre lenguaje e imagen. Pero, de nuevo, la atribución oficial es a 4o image generation, no a Spud.

Realtime API: voz y multimodalidad de baja latencia ya están productizadas

La Realtime API está pensada para que desarrolladores creen experiencias multimodales de baja latencia; además, la actualización gpt-realtime habla de un modelo speech-to-speech más avanzado, image input y funciones orientadas a agentes de voz en producción.[18][

23] Por tanto, la voz y la interacción en tiempo real sí son capacidades publicadas por OpenAI. Lo que falta es una base oficial para llamarlas capacidades internas de GPT-5.5 Spud.

Sora: el vídeo sigue apareciendo como una línea propia

Si la duda es si OpenAI tiene generación de vídeo, la respuesta es sí. La evidencia oficial apunta a Sora, a la documentación de Video generation with Sora y a la app de ejemplo de Sora para generar y remezclar vídeos.[12][

13][

20] Si la duda es si GPT-5.5 Spud ya asumió esa función, la respuesta cambia: no hay evidencia oficial suficiente.

Afirmaciones que conviene no dar por hechas

- GPT-5.5 Spud ya fue lanzado: las pistas disponibles proceden principalmente de redes, vídeos o contenido generado por usuarios, no de una página oficial de OpenAI.[

6][

10][

11]

- Spud es fully multimodal u omnimodal: algunas publicaciones en X y otras fuentes no oficiales lo describen así, pero siguen siendo afirmaciones no verificadas.[

2][

9][

10]

- Spud integrará o reemplazará Sora: la documentación oficial de vídeo sigue presentando Sora, Sora API y la app de ejemplo de Sora como la ruta clara para vídeo.[

12][

13][

20]

- OpenAI confirmó que Spud unifica texto, imagen, voz y vídeo: la evidencia oficial permite hablar de GPT-4o, 4o image generation, Realtime API y Sora, no de un modelo Spud confirmado.[

12][

15][

18][

20][

21][

23]

Qué deberían hacer equipos de producto y desarrollo

Si estás preparando una hoja de ruta, una demo o una integración comercial, no conviene tratar GPT-5.5 Spud como una dependencia segura. La opción más sólida es separar necesidades según las líneas ya publicadas: GPT-4o y 4o image generation para texto e imagen; Realtime API o gpt-realtime para agentes de voz e interacción en tiempo real; y Sora o Sora API para generación y remix de vídeo.[12][

13][

15][

18][

20][

21][

23]

Si Spud llegara a convertirse en un modelo oficial, las señales fiables deberían ser claras: una página de anuncio de OpenAI, una system card o model card, documentación de API con un identificador de modelo formal y una descripción explícita de capacidades y medidas de seguridad. Esa es precisamente la diferencia entre un rumor viral y productos que sí pueden verificarse: GPT-4o, Realtime API y Sora cuentan con documentación oficial consultable.[12][

18][

20][

21][

23]

La línea de fondo es sencilla: la estrategia multimodal de OpenAI tiene respaldo documental; el lanzamiento de GPT-5.5 Spud como modelo omnimodal, no. Hasta que OpenAI publique documentación formal, Spud debe leerse como rumor, no como una base fiable para decisiones de producto.[1][

2][

9][

10][

11][

12][

15][

18][

20][

21]