Eine einfache Siegerliste wäre hier irreführend. Die verfügbaren Quellen prüfen GPT-5.5, Claude Opus 4.7, DeepSeek V4 und Kimi K2.6 nicht in einem einheitlichen unabhängigen Testlauf, sondern liefern Ausschnitte aus verschiedenen Benchmarks, Modellvarianten und Anbieter- oder Sekundäranalysen [2][

3][

7][

21]. Trotzdem ergibt sich ein brauchbares Muster: GPT-5.5 hat die stärkste belegte Gesamtposition, Claude Opus 4.7 gewinnt mehrere wichtige Coding- und Wissenswerte, DeepSeek V4 ist preislich auffällig stark und Kimi K2.6 bleibt mangels direkter Vergleichswerte schwer zu ranken [

1][

2][

3][

7][

22][

24].

Das faire Kurzurteil

GPT-5.5 ist der stärkste belegte Allrounder. Im verfügbaren Artificial-Analysis-Ausschnitt steht GPT-5.5 in der xhigh-Konfiguration mit 60 Punkten vor GPT-5.5 high mit 59 Punkten und Claude Opus 4.7 mit 57 Punkten [2]. Bei BrowseComp erreicht GPT-5.5 84,4 %, während DeepSeek V4 mit 83,4 % knapp dahinter und Claude Opus 4.7 mit 79,3 % dahinter liegt [

3].

Claude Opus 4.7 ist besonders stark bei Software und Wissen. Claude liegt bei SWE-Bench Pro mit 64,3 % vor GPT-5.5 mit 58,6 % und bei GPQA Diamond mit 94,2 % knapp vor GPT-5.5 mit 93,6 % [22][

24]. Gleichzeitig führt GPT-5.5 bei Terminal-Bench 2.0 deutlich mit 82,7 % gegenüber 69,4 % für Claude Opus 4.7 [

22][

24].

DeepSeek V4 ist der Preis-Leistungs-Angreifer. VentureBeat nennt für DeepSeek V4 83,4 % bei BrowseComp, nur einen Prozentpunkt unter GPT-5.5 und über Claude Opus 4.7 [3]. Mashable nennt zugleich API-Preise von 1,74 US-Dollar pro 1 Mio. Input-Tokens und 3,48 US-Dollar pro 1 Mio. Output-Tokens für DeepSeek V4, gegenüber 5/30 US-Dollar bei GPT-5.5 und 5/25 US-Dollar bei Claude Opus 4.7 [

1].

Kimi K2.6 ist technisch interessant, aber in dieser Datenlage nicht fair zu ranken. DocsBot beschreibt Kimi K2.6 als open-source, nativ multimodales, agentisches Modell mit 1T-Parameter-MoE-Architektur, 32B aktivierten Parametern und 256K Kontext [7]. In den bereitgestellten Quellen fehlen jedoch genügend direkte Benchmarkwerte gegen GPT-5.5, Claude Opus 4.7 und DeepSeek V4, um Kimi sauber in dieselbe Rangliste zu setzen [

7].

Vergleich auf einen Blick

| Modell | Stärkste belegte Aussage | Wichtige Werte aus den Quellen | Praktische Einordnung |

|---|---|---|---|

| GPT-5.5 | Führt den verfügbaren Artificial-Analysis-Index-Ausschnitt an [ | Intelligence Index: 60 xhigh, 59 high [ | Bester belegter Allround-Startpunkt, aber kein Sieger in jeder Einzeldisziplin |

| Claude Opus 4.7 | Sehr stark bei SWE-Bench, GPQA und einzelnen agentischen Aufgaben [ | Intelligence Index: 57 [ | Besonders interessant für Coding, Review, Wissens- und Finanzaufgaben |

| DeepSeek V4 | Kommt bei BrowseComp fast an GPT-5.5 heran [ | BrowseComp: 83,4 % [ | Starker Kandidat, wenn Kosten und Web-/Rechercheleistung wichtiger sind als ein vollständiger Benchmark-Sieg |

| Kimi K2.6 | Als offenes, multimodales, agentisches Modell mit langem Kontext beschrieben [ | 1T-Parameter-MoE, 32B aktivierte Parameter, 256K Kontext laut DocsBot [ | Technisch prüfenswert, aber anhand dieser Quellen nicht sauber numerisch vergleichbar |

Warum diese Zahlen nicht wie eine Sporttabelle funktionieren

Die wichtigste Einschränkung ist die Datenlage. DataCamp weist in einem verwandten Frontier-Modellvergleich darauf hin, dass Benchmarkwerte teils vendor-reported sind und unterschiedliche Harness-Konfigurationen nutzen können [21]. Das gilt als Warnsignal für jede harte Rangliste: Ein Modell kann in einer Konfiguration vorn liegen und in einer anderen zurückfallen.

Auch die Modellvarianten sind nicht immer identisch. Artificial Analysis nennt GPT-5.5 xhigh, GPT-5.5 high und Claude Opus 4.7 mit Adaptive Reasoning und Max Effort [2]. VentureBeat bezieht sich bei DeepSeek auf DeepSeek-V4-Pro-Max [

3]. Solche Unterschiede können Benchmarks beeinflussen, insbesondere bei Reasoning-, Coding- und Agentenaufgaben, bei denen Tool-Nutzung, Denkaufwand und Testharness viel ausmachen.

Deshalb ist die bessere Frage nicht nur: Welches Modell ist Nummer eins? Sondern: Für welchen Workload ist welches Modell am besten belegt?

Gesamtleistung: GPT-5.5 führt im verfügbaren Intelligence Index

Der klarste Gesamtindikator in den Quellen ist der Artificial-Analysis-Intelligence-Index-Ausschnitt. Dort steht GPT-5.5 xhigh mit 60 Punkten auf Rang 1, GPT-5.5 high mit 59 Punkten auf Rang 2 und Claude Opus 4.7 mit Adaptive Reasoning und Max Effort mit 57 Punkten auf Rang 3 [2].

Dieser Ausschnitt stützt einen leichten, aber sichtbaren Vorsprung von GPT-5.5 gegenüber Claude Opus 4.7 in diesem Index [2]. Für DeepSeek V4 und Kimi K2.6 liefert derselbe verfügbare Ausschnitt jedoch keine vollständigen, direkt zitierbaren Indexwerte für einen sauberen Vierer-Vergleich [

2][

7].

BrowseComp: DeepSeek V4 ist fast auf GPT-5.5-Niveau

BrowseComp ist der stärkste direkt zitierbare Dreiervergleich zwischen GPT-5.5, Claude Opus 4.7 und DeepSeek V4. VentureBeat nennt 90,1 % für GPT-5.5 Pro, 84,4 % für GPT-5.5, 83,4 % für DeepSeek V4 und 79,3 % für Claude Opus 4.7 [3].

| Modell oder Variante | BrowseComp-Wert | Einordnung |

|---|---|---|

| GPT-5.5 Pro | 90,1 % | Klar vorn in diesem Ausschnitt [ |

| GPT-5.5 | 84,4 % | Knapp vor DeepSeek V4 [ |

| DeepSeek V4 | 83,4 % | Nur 1,0 Prozentpunkt hinter GPT-5.5 [ |

| Claude Opus 4.7 | 79,3 % | Hinter GPT-5.5 und DeepSeek V4 [ |

| Kimi K2.6 | Kein direkt vergleichbarer Wert in den bereitgestellten Quellen | Nicht fair rankbar [ |

VentureBeat bewertet DeepSeek-V4-Pro-Max trotz dieses starken Werts nicht als Modell, das GPT-5.5 oder Claude Opus 4.7 auf den direkt vergleichbaren Benchmarks insgesamt entthront [3]. Die bessere Lesart lautet daher: DeepSeek V4 ist bei BrowseComp sehr nah an GPT-5.5, aber aus diesem einen starken Benchmark folgt kein Gesamtsieg [

3].

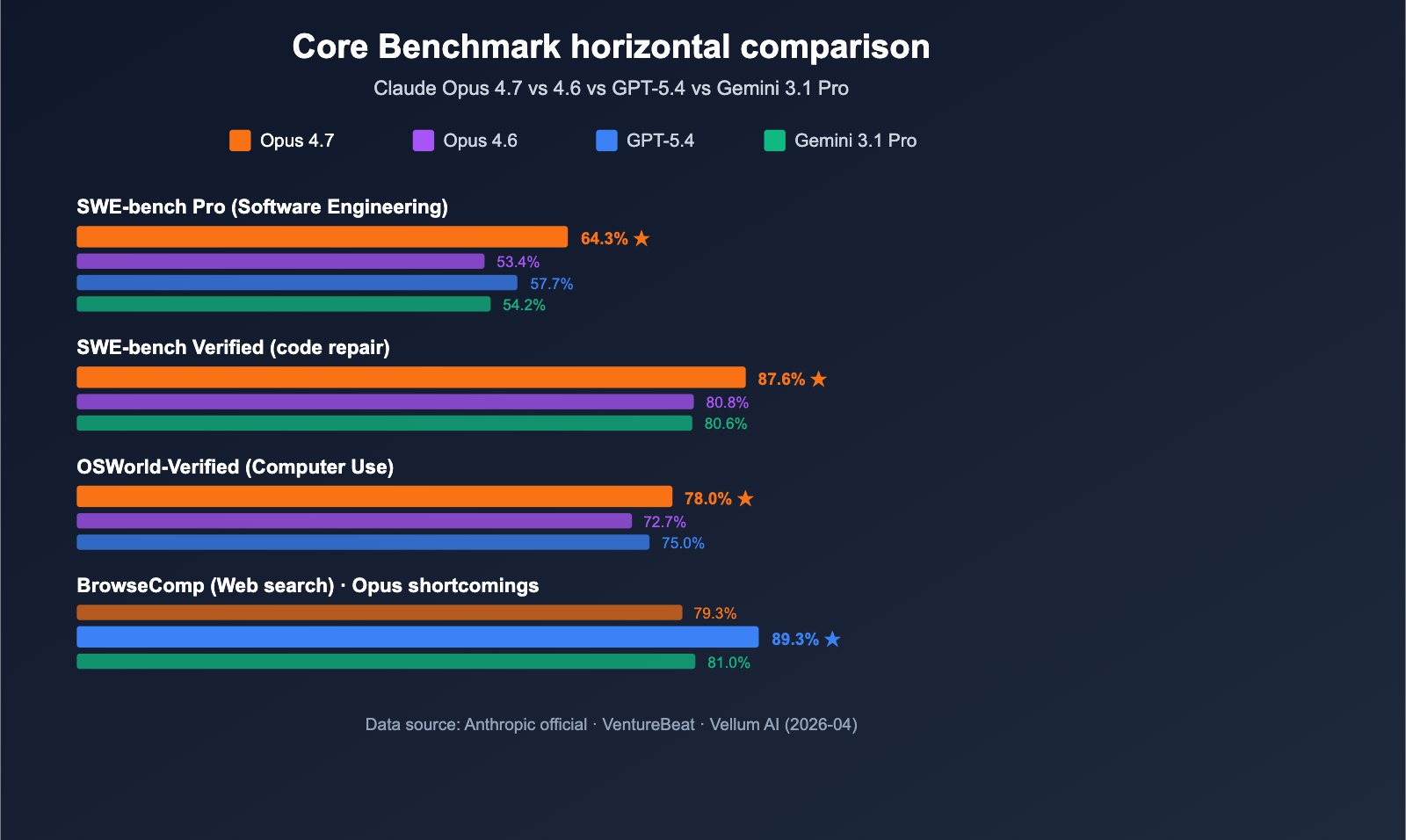

Coding und Software Engineering: Claude gewinnt SWE, GPT gewinnt Terminal

Bei Coding-Benchmarks gibt es keinen eindeutigen Gesamtsieger. Claude Opus 4.7 liegt bei SWE-Bench Pro mit 64,3 % vor GPT-5.5 mit 58,6 % [22][

24]. Vellum nennt außerdem 87,6 % für Claude Opus 4.7 auf SWE-Bench Verified [

20]. Bei Terminal-Bench 2.0 dreht sich das Bild: GPT-5.5 erreicht 82,7 %, Claude Opus 4.7 69,4 % [

22][

24].

| Benchmark | GPT-5.5 | Claude Opus 4.7 | Aussage |

|---|---|---|---|

| SWE-Bench Pro | 58,6 % | 64,3 % | Claude vorn [ |

| SWE-Bench Verified | Kein direkt zitierter GPT-5.5-Wert in den bereitgestellten Quellen | 87,6 % | Starker Claude-Wert, aber kein vollständiger Vierer-Vergleich [ |

| Terminal-Bench 2.0 | 82,7 % | 69,4 % | GPT-5.5 deutlich vorn [ |

Für DeepSeek V4 und Kimi K2.6 reichen die bereitgestellten Quellen in diesem Bereich nicht für dieselbe tabellarische Einordnung. VentureBeat sagt zwar, DeepSeek V4 komme auf mehreren direkt vergleichbaren Benchmarks nahe an die Spitzenmodelle heran, nennt im verfügbaren Ausschnitt aber die klarsten Zahlen für BrowseComp [3]. Für Kimi K2.6 liefert DocsBot vor allem Modell- und Architekturangaben, nicht die vollständige Vergleichsmatrix gegen alle drei anderen Modelle [

7].

Reasoning, Wissen und professionelle Aufgaben: wechselnde Führung

Bei Wissens- und Reasoning-Tests liegen GPT-5.5 und Claude Opus 4.7 eng beieinander, aber die Führung hängt vom Benchmark und Tool-Setup ab. Bei GPQA Diamond nennt Vellum 93,6 % für GPT-5.5 und 94,2 % für Claude Opus 4.7 [22]. Mashable nennt dieselben GPQA-Diamond-Werte und ergänzt Humanity’s Last Exam: ohne Tools liegt GPT-5.5 mit 40,6 % vor Claude Opus 4.7 mit 31,2 %, mit Tools liegt Claude Opus 4.7 mit 54,7 % knapp vor GPT-5.5 mit 52,2 % [

8].

| Benchmark | GPT-5.5 | Claude Opus 4.7 | Sieger in den verfügbaren Zahlen |

|---|---|---|---|

| GPQA Diamond | 93,6 % | 94,2 % | Claude Opus 4.7 knapp [ |

| Humanity’s Last Exam | 40,6 % | 31,2 % | GPT-5.5 [ |

| Humanity’s Last Exam mit Tools | 52,2 % | 54,7 % | Claude Opus 4.7 knapp [ |

Bei professionellen und agentischen Benchmarks ist das Bild ebenfalls gemischt. Vellum nennt GPT-5.5 mit 84,9 % bei GDPval gegenüber 80,3 % für Claude Opus 4.7, 78,7 % bei OSWorld-Verified gegenüber 78,0 % und 75,3 % bei MCP Atlas gegenüber 79,1 % für Claude [22]. OpenAI nennt für FinanceAgent v1.1 60,0 % bei GPT-5.5 und 64,4 % bei Claude Opus 4.7 [

24].

| Benchmark | GPT-5.5 | Claude Opus 4.7 | Aussage |

|---|---|---|---|

| GDPval | 84,9 % | 80,3 % | GPT-5.5 vorn [ |

| OSWorld-Verified | 78,7 % | 78,0 % | GPT-5.5 knapp vorn [ |

| MCP Atlas | 75,3 % | 79,1 % | Claude Opus 4.7 vorn [ |

| FinanceAgent v1.1 | 60,0 % | 64,4 % | Claude Opus 4.7 vorn [ |

Anthropic verweist zusätzlich auf einen internen Research-Agent-Benchmark, in dem Claude Opus 4.7 laut Anthropic bei sechs Modulen den höchsten Gesamtscore von 0,715 teilte und im Modul General Finance 0,813 gegenüber 0,767 bei Opus 4.6 erreichte [6]. Da dieser Benchmark intern ist und die bereitgestellten Angaben nicht alle vier Modelle gleich abdecken, ist er eher ein Hinweis auf Claudes agentische Stärke als eine unabhängige Vierer-Rangliste [

6].

Preis und Kontext: DeepSeek V4 fällt am stärksten auf

Für produktive Nutzung zählt nicht nur ein Benchmarkpunkt mehr oder weniger. Mashable nennt für DeepSeek V4 1,74 US-Dollar pro 1 Mio. Input-Tokens und 3,48 US-Dollar pro 1 Mio. Output-Tokens bei einem Kontextfenster von 1 Mio. Tokens [1]. Für GPT-5.5 nennt dieselbe Quelle 5 US-Dollar pro 1 Mio. Input-Tokens und 30 US-Dollar pro 1 Mio. Output-Tokens; für Claude Opus 4.7 5 US-Dollar Input und 25 US-Dollar Output pro 1 Mio. Tokens, jeweils ebenfalls mit 1 Mio. Kontext-Tokens [

1].

| Modell | Input-Preis pro 1 Mio. Tokens | Output-Preis pro 1 Mio. Tokens | Kontextangabe in der Quelle |

|---|---|---|---|

| DeepSeek V4 | 1,74 US-Dollar | 3,48 US-Dollar | 1 Mio. Tokens [ |

| GPT-5.5 | 5 US-Dollar | 30 US-Dollar | 1 Mio. Tokens [ |

| Claude Opus 4.7 | 5 US-Dollar | 25 US-Dollar | 1 Mio. Tokens [ |

| Kimi K2.6 | Keine belastbare Preisangabe in den bereitgestellten Quellen | Keine belastbare Preisangabe in den bereitgestellten Quellen | 256K Tokens laut DocsBot [ |

Kimi K2.6 ist hier ein Sonderfall. DocsBot beschreibt das Modell mit 256K Kontext, 1T-Parameter-MoE-Architektur, 32B aktivierten Parametern und agentischer Orchestrierung bis zu 300 Sub-Agenten und 4.000 koordinierten Schritten [7]. Das sind relevante technische Eckdaten, ersetzen aber keine direkten Benchmark- und Preiswerte gegen GPT-5.5, Claude Opus 4.7 und DeepSeek V4 [

7].

Welche Modellwahl ergibt sich daraus?

| Wenn der Schwerpunkt ist … | Wahrscheinlich bester Startpunkt | Warum |

|---|---|---|

| Stärkste belegte Gesamtleistung | GPT-5.5 | Führt den verfügbaren Intelligence-Index-Ausschnitt an und liegt bei BrowseComp vor Claude Opus 4.7 und knapp vor DeepSeek V4 [ |

| SWE-Bench-orientiertes Software Engineering | Claude Opus 4.7 | Liegt bei SWE-Bench Pro vor GPT-5.5 und wird mit 87,6 % auf SWE-Bench Verified genannt [ |

| Terminal-, Computer- und agentische Ausführung | GPT-5.5 | Führt bei Terminal-Bench 2.0 deutlich und liegt bei GDPval sowie OSWorld-Verified vor Claude Opus 4.7 [ |

| Web-Recherche und niedrige API-Kosten | DeepSeek V4 | Erreicht 83,4 % bei BrowseComp und hat in den zitierten Angaben deutlich niedrigere API-Preise [ |

| Test eines offenen multimodalen Agentenmodells | Kimi K2.6 | Wird als open-source, nativ multimodales, agentisches Modell mit 256K Kontext beschrieben, hat aber keine vollständige direkte Vergleichsbasis in den bereitgestellten Quellen [ |

Fazit

Der stärkste Befund ist nicht, dass ein Modell alles gewinnt. GPT-5.5 ist in den verfügbaren Quellen der beste belegte Allrounder, weil es den Artificial-Analysis-Ausschnitt anführt und bei BrowseComp sowie mehreren professionellen Benchmarks stark abschneidet [2][

3][

22][

24]. Claude Opus 4.7 bleibt ein Spitzenmodell, besonders bei SWE-Bench Pro, SWE-Bench Verified, GPQA Diamond und einzelnen agentischen Finanzaufgaben [

20][

22][

24]. DeepSeek V4 ist der auffälligste Preis-Leistungs-Kandidat, weil es bei BrowseComp fast GPT-5.5 erreicht und in den zitierten API-Preisen deutlich günstiger ist [

1][

3]. Kimi K2.6 sollte anhand dieser Quellen weder auf- noch abgewertet werden: Es braucht für eine faire Einordnung direkte, vergleichbare Benchmark- und Preiswerte [

7].