Suche & Faktencheck: Wie schütze ich mich vor Fehlern, Missbrauch und Betrug durch KI?

Der beste Schutz ist, KI weder als Identitätsnachweis noch als Wahrheitsbeweis zu behandeln: Verifiziere Personen, Forderungen und Inhalte immer über einen zweiten, unabhängigen Kanal, und nutze KI Antworten höchstens...

Der beste Schutz ist, KI weder als Identitätsnachweis noch als Wahrheitsbeweis zu behandeln: Verifiziere Personen, Forderungen und Inhalte immer über einen zweiten, unabhängigen Kanal, und nutze KI Antworten höchstens als Entwurf, bis du Originalquellen geprüft hast [1][3][4][5][6][8]. Das ist gut begründet, weil US Be

Wichtige Erkenntnisse

- Vertraue Stimme, Video, Screenshot oder Chat nicht als Echtheitsbeweis; FTC und FCC behandeln KI-Imitationen sowie KI-generierte Anrufe/Nachrichten als reales Verbraucherproblem.

- Gib keine Einmalcodes, Passwörter oder Zahlungsfreigaben frei, wenn die Aufforderung nur aus einem Anruf, Chat, Video oder einer Sprachnachricht kommt; rufe über eine dir bereits bekannte Nummer zurück oder öffne die offizielle Website selbst.

- Sei besonders skeptisch bei Dringlichkeit, Autoritätsdruck und emotionalen Geschichten, weil generative KI Betrügern hilft, überzeugendere Scams schneller zu bauen.

- Behandle „AI-powered“, „KI-Trading“, „mit KI Geld verdienen“ oder ähnliche Versprechen nicht als Qualitätsnachweis; die FTC ist 2024 ausdrücklich gegen täuschende KI-Behauptungen und KI-Schemes vorgegangen.

- Der beste Schutz ist, KI weder als Identitätsnachweis noch als Wahrheitsbeweis zu behandeln: Verifiziere Personen, Forderungen und Inhalte immer über einen zweiten, unabhängigen Kanal, und nutze KI-Antworten höchstens als Entwurf, bis du Originalquellen geprüft hast.

- Der beste Schutz ist, KI weder als Identitätsnachweis noch als Wahrheitsbeweis zu behandeln: Verifiziere Personen, Forderungen und Inhalte immer über einen zweiten, unabhängigen Kanal, und nutze KI-Antworten höchstens als Entwurf, bis du Originalquellen geprüft hast [1][3][4][5][

- Kernpunkte

Forschungsantwort

Der beste Schutz ist, KI weder als Identitätsnachweis noch als Wahrheitsbeweis zu behandeln: Verifiziere Personen, Forderungen und Inhalte immer über einen zweiten, unabhängigen Kanal, und nutze KI-Antworten höchstens als Entwurf, bis du Originalquellen geprüft hast [1][

3][

4][

5][

6][

8]. Das ist gut begründet, weil US-Behörden 2024/2025 ausdrücklich vor KI-Imitationen, KI-generierten Anrufen/Nachrichten, überzeugenderen Betrugsmaschen und täuschenden KI-Versprechen warnen oder dagegen vorgehen [

1][

3][

4][

5][

6][

8].

Kernpunkte

- Vertraue Stimme, Video, Screenshot oder Chat nicht als Echtheitsbeweis; FTC und FCC behandeln KI-Imitationen sowie KI-generierte Anrufe/Nachrichten als reales Verbraucherproblem [

1][

3][

5][

8].

- Praktische Regel: Gib keine Einmalcodes, Passwörter oder Zahlungsfreigaben frei, wenn die Aufforderung nur aus einem Anruf, Chat, Video oder einer Sprachnachricht kommt; rufe über eine dir bereits bekannte Nummer zurück oder öffne die offizielle Website selbst [

1][

3][

5][

6][

8].

- Sei besonders skeptisch bei Dringlichkeit, Autoritätsdruck und emotionalen Geschichten, weil generative KI Betrügern hilft, überzeugendere Scams schneller zu bauen [

6][

8].

- Behandle „AI-powered“, „KI-Trading“, „mit KI Geld verdienen“ oder ähnliche Versprechen nicht als Qualitätsnachweis; die FTC ist 2024 ausdrücklich gegen täuschende KI-Behauptungen und KI-Schemes vorgegangen [

4].

- Für Familie und Arbeit ist ein festes Rückruf- oder Codewort-Verfahren sinnvoll, weil genau Identitätsbetrug per künstlich erzeugter Stimme oder Nachricht regulatorisch adressiert wird [

1][

3][

5][

8].

- Für Fehler der KI selbst gilt als sichere Arbeitsregel: Nutze sie für Entwürfe, Zusammenfassungen und Ideen, aber nicht allein für Rechts-, Medizin-, Sicherheits- oder Finanzentscheidungen; dort sollte vor jeder Handlung immer eine menschliche Prüfung plus Primärquelle stehen [

4][

6].

- Wenn du selbst KI-Inhalte erzeugst oder weiterleitest, markiere sie klar als KI-unterstützt und teile keine unbestätigten Behauptungen weiter; das senkt das Risiko, selbst zum Verstärker von Täuschung oder Betrug zu werden [

1][

4][

6].

Evidenzhinweise

- [

1] FCC, 2024 Report of the Consumer Advisory Committee: behandelt KI-generierte Anrufe und Texte ausdrücklich als regulatorisches Thema [

1].

- [

3] FTC, 2025 Blog zur „Impersonation Rule“: zeigt, dass Identitätsbetrug und Imitation aktiv verfolgt werden [

3].

- [

4] FTC, 2024 „Crackdown on Deceptive AI Claims and Schemes“: belegt, dass täuschende KI-Versprechen und KI-Scams real sind [

4].

- [

5] FTC, 2025 „Actions to Protect Consumers from Impersonation Scams“: bestätigt anhaltende Schutzmaßnahmen gegen Imitationsbetrug [

5].

- [

6] CFTC, 2025 Advisory: warnt, dass generative KI überzeugende Betrugsmaschen erleichtert [

6].

- [

8] FTC, 2024 zu KI-Impersonation von Personen: ordnet Deepfakes und KI-Imitationen klar als Verbraucherproblem ein [

8].

Einschränkungen / Unsicherheit

- Diese Kurzrecherche stützt sich vor allem auf offizielle US-Quellen. Die Kernaussagen zu Betrug, Imitation und täuschenden KI-Versprechen sind stark belegt [

1][

3][

4][

5][

6][

8], aber deutsche oder EU-spezifische Meldewege und Rechtsfolgen habe ich in diesem Schritt nicht separat verifiziert.

- Der Teil „Betrug/Missbrauch durch KI“ ist deutlich besser belegt als der Teil „allgemeine Fehlerquoten von KI im Alltag“. Insufficient evidence.

Zusammenfassung

Wenn du nur drei Regeln mitnimmst: 1) nie wegen eines Anrufs, Chats oder Videos sofort handeln, 2) immer separat zurückrufen oder gegenprüfen, 3) KI-Ausgaben nie ungeprüft für Geld, Identität oder wichtige Entscheidungen verwenden [1][

3][

4][

5][

6][

8]. Wenn du willst, mache ich dir als Nächstes eine kurze DE/EU-Checkliste oder einen 30-Sekunden-Notfallablauf für Familie oder Firma.

Unterstützende Visuals

Forschungsgespräch

Forschungsfrage

Suche & Faktencheck: Wie schütze ich mich vor Fehlern, Missbrauch und Betrug durch KI?

Zitierte Antwort

Der beste Schutz ist, KI weder als Identitätsnachweis noch als Wahrheitsbeweis zu behandeln: Verifiziere Personen, Forderungen und Inhalte immer über einen zweiten, unabhängigen Kanal, und nutze KI-Antworten höchstens als Entwurf, bis du Originalquellen geprüft hast [1][

3][

4][

5][

6][

8]. Das ist gut begründet, weil US-Behörden 2024/2025 ausdrücklich vor KI-Imitationen, KI-generierten Anrufen/Nachrichten, überzeugenderen Betrugsmaschen und täuschenden KI-Versprechen warnen oder dagegen vorgehen [

1][

3][

4][

5][

6][

8].

Kernpunkte

- Vertraue Stimme, Video, Screenshot oder Chat nicht als Echtheitsbeweis; FTC und FCC behandeln KI-Imitationen sowie KI-generierte Anrufe/Nachrichten als reales Verbraucherproblem [

1][

3][

5][

8].

- Praktische Regel: Gib keine Einmalcodes, Passwörter oder Zahlungsfreigaben frei, wenn die Aufforderung nur aus einem Anruf, Chat, Video oder einer Sprachnachricht kommt; rufe über eine dir bereits bekannte Nummer zurück oder öffne die offizielle Website selbst [

1][

3][

5][

6][

8].

- Sei besonders skeptisch bei Dringlichkeit, Autoritätsdruck und emotionalen Geschichten, weil generative KI Betrügern hilft, überzeugendere Scams schneller zu bauen [

6][

8].

- Behandle „AI-powered“, „KI-Trading“, „mit KI Geld verdienen“ oder ähnliche Versprechen nicht als Qualitätsnachweis; die FTC ist 2024 ausdrücklich gegen täuschende KI-Behauptungen und KI-Schemes vorgegangen [

4].

- Für Familie und Arbeit ist ein festes Rückruf- oder Codewort-Verfahren sinnvoll, weil genau Identitätsbetrug per künstlich erzeugter Stimme oder Nachricht regulatorisch adressiert wird [

1][

3][

5][

8].

- Für Fehler der KI selbst gilt als sichere Arbeitsregel: Nutze sie für Entwürfe, Zusammenfassungen und Ideen, aber nicht allein für Rechts-, Medizin-, Sicherheits- oder Finanzentscheidungen; dort sollte vor jeder Handlung immer eine menschliche Prüfung plus Primärquelle stehen [

4][

6].

- Wenn du selbst KI-Inhalte erzeugst oder weiterleitest, markiere sie klar als KI-unterstützt und teile keine unbestätigten Behauptungen weiter; das senkt das Risiko, selbst zum Verstärker von Täuschung oder Betrug zu werden [

1][

4][

6].

Evidenzhinweise

- [

1] FCC, 2024 Report of the Consumer Advisory Committee: behandelt KI-generierte Anrufe und Texte ausdrücklich als regulatorisches Thema [

1].

- [

3] FTC, 2025 Blog zur „Impersonation Rule“: zeigt, dass Identitätsbetrug und Imitation aktiv verfolgt werden [

3].

- [

4] FTC, 2024 „Crackdown on Deceptive AI Claims and Schemes“: belegt, dass täuschende KI-Versprechen und KI-Scams real sind [

4].

- [

5] FTC, 2025 „Actions to Protect Consumers from Impersonation Scams“: bestätigt anhaltende Schutzmaßnahmen gegen Imitationsbetrug [

5].

- [

6] CFTC, 2025 Advisory: warnt, dass generative KI überzeugende Betrugsmaschen erleichtert [

6].

- [

8] FTC, 2024 zu KI-Impersonation von Personen: ordnet Deepfakes und KI-Imitationen klar als Verbraucherproblem ein [

8].

Einschränkungen / Unsicherheit

- Diese Kurzrecherche stützt sich vor allem auf offizielle US-Quellen. Die Kernaussagen zu Betrug, Imitation und täuschenden KI-Versprechen sind stark belegt [

1][

3][

4][

5][

6][

8], aber deutsche oder EU-spezifische Meldewege und Rechtsfolgen habe ich in diesem Schritt nicht separat verifiziert.

- Der Teil „Betrug/Missbrauch durch KI“ ist deutlich besser belegt als der Teil „allgemeine Fehlerquoten von KI im Alltag“. Insufficient evidence.

Zusammenfassung

Wenn du nur drei Regeln mitnimmst: 1) nie wegen eines Anrufs, Chats oder Videos sofort handeln, 2) immer separat zurückrufen oder gegenprüfen, 3) KI-Ausgaben nie ungeprüft für Geld, Identität oder wichtige Entscheidungen verwenden [1][

3][

4][

5][

6][

8]. Wenn du willst, mache ich dir als Nächstes eine kurze DE/EU-Checkliste oder einen 30-Sekunden-Notfallablauf für Familie oder Firma.

Die Leute fragen auch

Wie lautet die kurze Antwort auf „Suche & Faktencheck: Wie schütze ich mich vor Fehlern, Missbrauch und Betrug durch KI?“?

Vertraue Stimme, Video, Screenshot oder Chat nicht als Echtheitsbeweis; FTC und FCC behandeln KI-Imitationen sowie KI-generierte Anrufe/Nachrichten als reales Verbraucherproblem.

Was sind die wichtigsten Punkte, die zuerst validiert werden müssen?

Vertraue Stimme, Video, Screenshot oder Chat nicht als Echtheitsbeweis; FTC und FCC behandeln KI-Imitationen sowie KI-generierte Anrufe/Nachrichten als reales Verbraucherproblem. Gib keine Einmalcodes, Passwörter oder Zahlungsfreigaben frei, wenn die Aufforderung nur aus einem Anruf, Chat, Video oder einer Sprachnachricht kommt; rufe über eine dir bereits bekannte Nummer zurück oder öffne die offizielle Website selbst.

Was soll ich als nächstes in der Praxis tun?

Sei besonders skeptisch bei Dringlichkeit, Autoritätsdruck und emotionalen Geschichten, weil generative KI Betrügern hilft, überzeugendere Scams schneller zu bauen.

Welches verwandte Thema sollte ich als nächstes untersuchen?

Fahren Sie mit „Suche & Faktencheck: Kann KI mir bei der Steuer helfen?“ für einen anderen Blickwinkel und zusätzliche Zitate fort.

Zugehörige Seite öffnenWomit soll ich das vergleichen?

Vergleichen Sie diese Antwort mit „Suche & Faktencheck: Darf ich KI im Studium oder im Beruf überhaupt verwenden?“.

Zugehörige Seite öffnenSetzen Sie Ihre Recherche fort

Quellen

- [1] 2024 Report of the Federal Communications Commission Consumer Advisory Committeefcc.gov

The Commission has proposed to define an AI-generated call or text as “a call that uses any technology or tool to artificially generate a voice or text using computational technology or other machine learning, including predictive algorithms and large language models, to process natural language and produce voice or text content to communicate with a called party over an outbound telephone call.” 3. The Committee recommends that the Commission engage in a public education campaign to help consumers understand when robocalls and robotexts received are generated by AI. Once education and campai…

- [2] Artificial Intelligence | Federal Trade Commissionftc.gov

. ## Enforcement. * Cases and Proceedings. * Competition and Consumer Protection Guidance Documents. ## Policy. * Reports. * Testimony. * Find refund cases. ## Consumer Advice. * [Scams…

- [3] FTC Announces Crackdown on Deceptive AI Claims and Schemes | Federal Trade Commissionftc.gov

Consumer Advice. * Scams. The FTC has filed a lawsuit against an online business opportunity scheme that it alleges has falsely claimed its “cutting edge” AI-powered tools would help consumers quickly earn thousands of dollars a month in passive income by opening online storefronts. In June, the FTC took action against a business opportunity scheme that alleged…

- [4] CFTC’s Office of Customer Education and Outreach Releases New Advisory on Fraud Using Generative AI | CFTCcftc.gov

CFTC’s Office of Customer Education and Outreach Releases New Advisory on Fraud Using Generative AI. WASHINGTON, D.C.— A new Commodity Futures Trading Commission customer advisory says generative artificial intelligence is making it increasingly easier for fraudsters to create convincing scams. According to the latest Office of Customer Education and Outreach customer advisory, Criminals Increasing Use of Generative AI to Commit Fraud*,*crooks are using AI to create fake images, voices, videos, live-streaming video chats, social media profiles, and malicious websites designed to look…

- [5] FTC Proposes New Protections to Combat AI Impersonation of Individuals | Federal Trade Commissionftc.gov

As scammers find new ways to defraud consumers, including through AI-generated deepfakes, this proposal will help the agency deter fraud and

- [6] Consumer Cyber Risks in 2026 Focus on AI-Driven Scams, Not Hacks - gHacks Tech Newsghacks.net

Consumer Cyber Risks in 2026 Focus on AI-Driven Scams, Not Hacks. Criminals increasingly rely on realistic AI-generated media and social engineering to pressure people into acting quickly, often before they have time to verify what is happening. In practice, most successful scams exploit one of three weaknesses: urgency, account access, or oversharing. Oversharing increasingly happens through AI chatbots, where users paste sensitive details assuming privacy that may not fully exist. AI-driven scams succeed by speeding people up. Save my name, email, and website in this browser for the next…

- [7] FTC Takes Aim Against Deceptive AI Practices - Lexologylexology.com

The FTC warns companies to consider the following four issues if they plan to develop a generative AI product capable of creating synthetic

- [8] AI, Deepfakes and Cyber Break-ins Lead List of 2026 Fraud Threatsnacmnc.org

According to FTC data, consumers lost more than $12.5 billion to fraud in 2024. Experian data found nearly 60% of companies reported an

- [9] WEF Warns Generative AI Will Supercharge Fraud andenterpriseitworld.com

Generative AI will be the dominant accelerant of cybercrime in 2026, fueling a surge in fraud, impersonation, and social‑engineering attacks

- [10] FTC Releases New Guidance Amid Adoption of Generative AIthefashionlaw.com

The FTC released new guidance on Monday that focuses on potentially harmful/deceptive uses of generative AI tools.

- [11] FTC Updates Rules to Address AI Deepfake Threats to ... - YouTubeyoutube.com

The US Federal Trade Commission (FTC) proposed making new updates on an artificial intelligence (AI) deepfake rule on February 16.

- [12] Celebrating the Impersonation Rule that helps the FTC fight scams | Federal Trade Commissionftc.gov

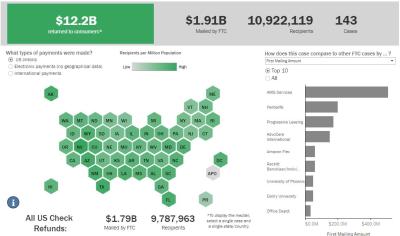

We enforce federal competition and consumer protection laws that prevent anticompetitive, deceptive, and unfair business practices. ### Learn how the FTC protects free enterprise and consumers. Visualization of FTC Refunds to Consumers. ### FTC Refunds to Consumers. ## About the FTC. # Celebrating the Impersonation Rule that helps the FTC fight scams. April also marks the one-year anniversary of the FTC’s Impersonation Rule, which gives the FTC more tools to fight impersonation scams that cost nearly $3 billion in reported losses during 2024. Here’s what the FTC is doing to fight these scams.…

- [13] FTC Highlights Actions to Protect Consumers from Impersonation Scams | Federal Trade Commissionftc.gov

We enforce federal competition and consumer protection laws that prevent anticompetitive, deceptive, and unfair business practices. # FTC Highlights Actions to Protect Consumers from Impersonation Scams. The Federal Trade Commission today highlighted actions taken to protect consumers from impersonations scams since the Government and Business Impersonation Rule took effect in April 2024. Scams impersonating businesses and government are consistently among the top frauds reported to the FTC; these scams resulted in $2.95 billion in consumer losses in 2024. Over the past year, the FTC has brou…

- [14] Artificial Intelligence Compliance Plan - Federal Trade Commissionftc.gov

We enforce federal competition and consumer protection laws that prevent anticompetitive, deceptive, and unfair business practices. ## Policy and Notices Menu. We work to advance government policies that protect consumers and promote competition. Find the resources you need to understand how consumer protection law impacts your business. ### Learn how the FTC protects free enterprise and consumers. Learn about the FTC's notable video game cases and what our agency is doing to keep the public safe. Visualization of FTC Refunds to Consumers. ### FTC Refunds to Consumers. ## About the FTC. Our m…

- [15] AI and the New Face of Fraud: How to Protect Your Identity and Finances in 2026 | JMB Financial Managersjmbfinmgrs.com

- AI and the New Face of Fraud: How to Protect Your Identity and Finances in 2026. Last year saw a surge in AI-generated scams, impersonation fraud, and synthetic identity theft that show no signs of abating as bad actors perfect the use of the evolving technology.1 For high-net-worth individuals and families, these risks are especially acute because of their public visibility and complex digital footprint. * Affluent families face heightened exposure: Public visibility and large digital footprints make them preferred targets for AI-driven phishing, ransomware, and social-engineering attacks…

- [16] Customer Service Scams: Safeguarding Yourself In The Era of AI Fraud - edhatedhat.com

Customer Service Scams: Safeguarding Yourself In The Era of AI Fraud. Lifeguard") gathered data from leading sources including the Federal Trade Commission, Wells Fargo, and more to help you stay protected in the rising era of AI fraud. Traditional phishing emails and spoofed websites, which are still valuable tools of the scamming trade, have now been joined by scams where AI itself is being used to assist the fraudsters. 1. **Seeding fake numbers to appear on search engines:**One method scammers are using to leverage AI for their scams is to publish fake customer support numbers. 3. **Set…

- [17] FTC AI Impersonation Rule Summary 2026: An Easy Guide to Compliance & Penalties - Webheads Unitedwebheadsunited.com

FTC AI Impersonation Rule Summary 2026: An Easy Guide to Compliance & Penalties. Rule summary of ai impersonation. The 2026 rule says that if a company helps these scammers on purpose, or if they should have known their tools were being used for ai impersonation, they can get into big trouble. Before this rule, it was very hard for people to get their money back after being tricked by ai impersonation. If a company builds a tool that makes it easy to do ai impersonation, they have to be careful. In 2026, the FTC is cracking down on companies that use ai impersonation in their ads. They must…

- [18] The FTC Prohibits AI-Generated Impersonation Fraud | Inside Global Techinsideglobaltech.com

The new rule makes “the impersonation of government, businesses, and their officials or agents in interstate commerce” an unfair or deceptive act or practice.

- [19] FTC Evaluating Deceptive Artificial Intelligence Claims | Insights | Holland & Knighthklaw.com

The FTC will increase its scrutiny of AI systems that collect or use biometric data, especially where deception or lack of consent is involved.

- [20] FTC Guidance on Using Artificial Intelligence and Algorithmsstip.oecd.org

To summarise the FTC's recommendations and guidance on the use of AI technologies and algorithms to make decisions about consumers, and how

- [21] Deepfakes and AI Fraud: Practical Controls After the FCC’s Robocall Ruling | DirSecdirsec.com

In February 2024, the FCC issued a declaratory ruling confirming that AI-generated voices count as “artificial or prerecorded” under the