Zyphras ZAYA1-8B ist vor allem eine Geschichte über Effizienz. Das Modell ist nicht deshalb interessant, weil es endgültig beweisen würde, dass kleinere KI-Systeme die großen Frontier-Modelle überholt haben. Interessant ist, dass Zyphra starke Ergebnisse bei Reasoning, Mathematik und Programmieraufgaben für ein Mixture-of-Experts-Modell mit nur 760 Mio. aktiven Parametern und 8,4 Mrd. Gesamtparametern meldet [1][

6].

Anders gesagt: Hier geht es weniger um „größer ist besser“ als um die Frage, wie viel brauchbare Intelligenz pro aktiv genutztem Parameter möglich ist.

Was ZAYA1-8B eigentlich ist

ZAYA1-8B ist ein kleines Mixture-of-Experts-Sprachmodell des KI-Unternehmens Zyphra. Die Modellkarte auf Hugging Face nennt 8,4 Mrd. Gesamtparameter, 760 Mio. aktive Parameter und beschreibt das Modell als end-to-end von Zyphra trainiert [6].

Der Unterschied zwischen Gesamtparametern und aktiven Parametern ist hier entscheidend. Bei einem Mixture-of-Experts-Modell — kurz MoE — werden nicht bei jeder Berechnung alle Modellteile gleichermaßen aktiviert. Deshalb kann ein Modell zwar insgesamt deutlich größer sein, pro Anfrage aber nur einen kleineren Teil seiner Parameter tatsächlich nutzen. Zyphra und die Ankündigung zu ZAYA1-8B beschreiben das Modell entsprechend als System mit weniger als 1 Mrd. aktiven Parametern, obwohl es insgesamt 8,4 Mrd. Parameter umfasst [4][

6].

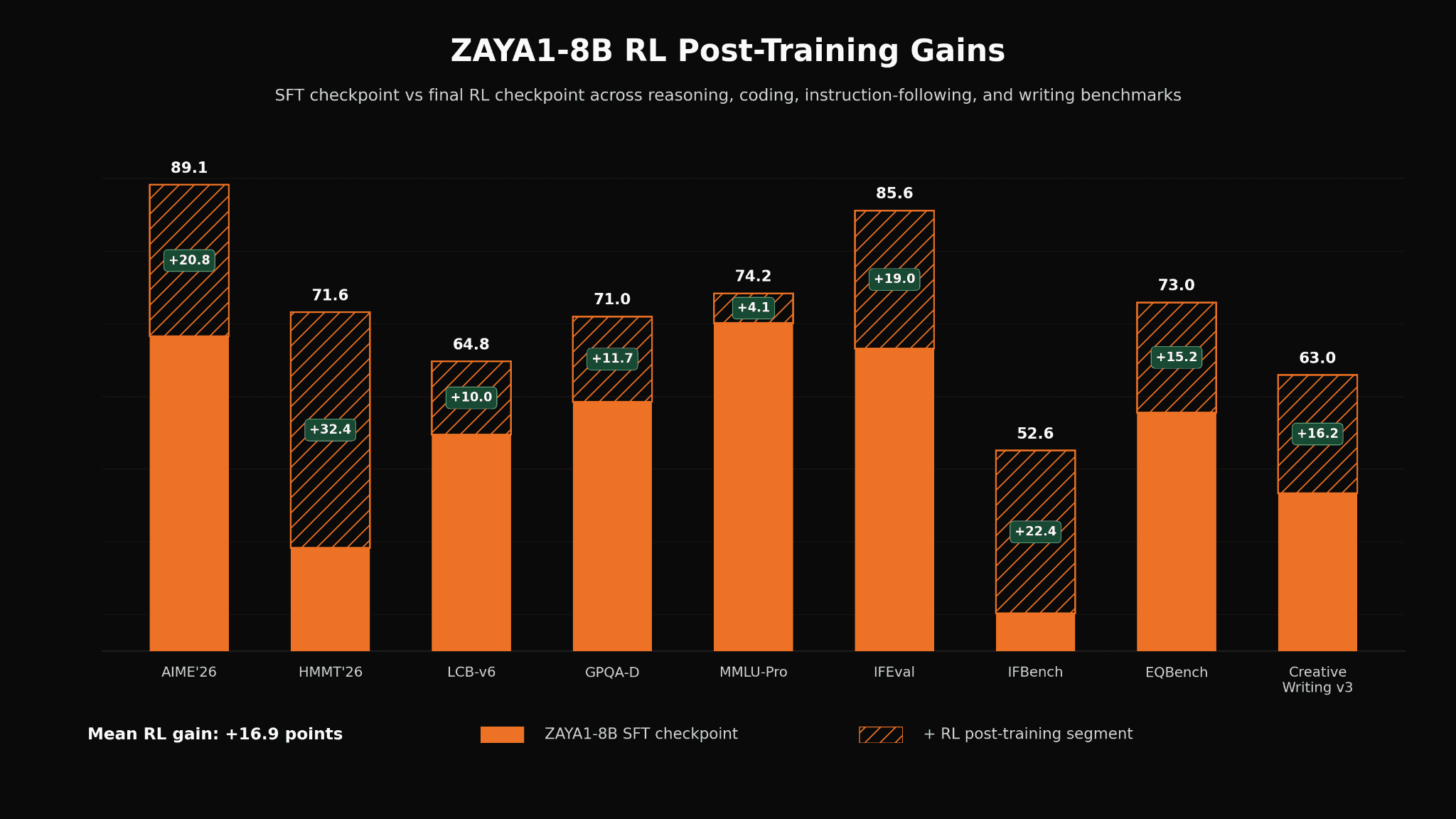

Zyphra stellt ZAYA1-8B als Fortschritt bei der „Intelligenz-Effizienz“ für diese Größenklasse dar und verweist auf eine Kombination aus Architektur, Pretraining und Post-Training [6]. Laut Modellkarte ist ZAYA1-8B besonders auf ausführliches, langes Reasoning sowie Mathematik- und Coding-Aufgaben ausgerichtet [

6].

Der eigentliche Vergleich: Leistung pro aktivem Parameter

Die stärkste These rund um ZAYA1-8B lautet nicht: Dieses Modell schlägt alles. Die stärkere und vorsichtigere Lesart lautet: Es könnte ungewöhnlich viel Reasoning-Leistung in einem sehr kleinen aktiven Modellteil bündeln.

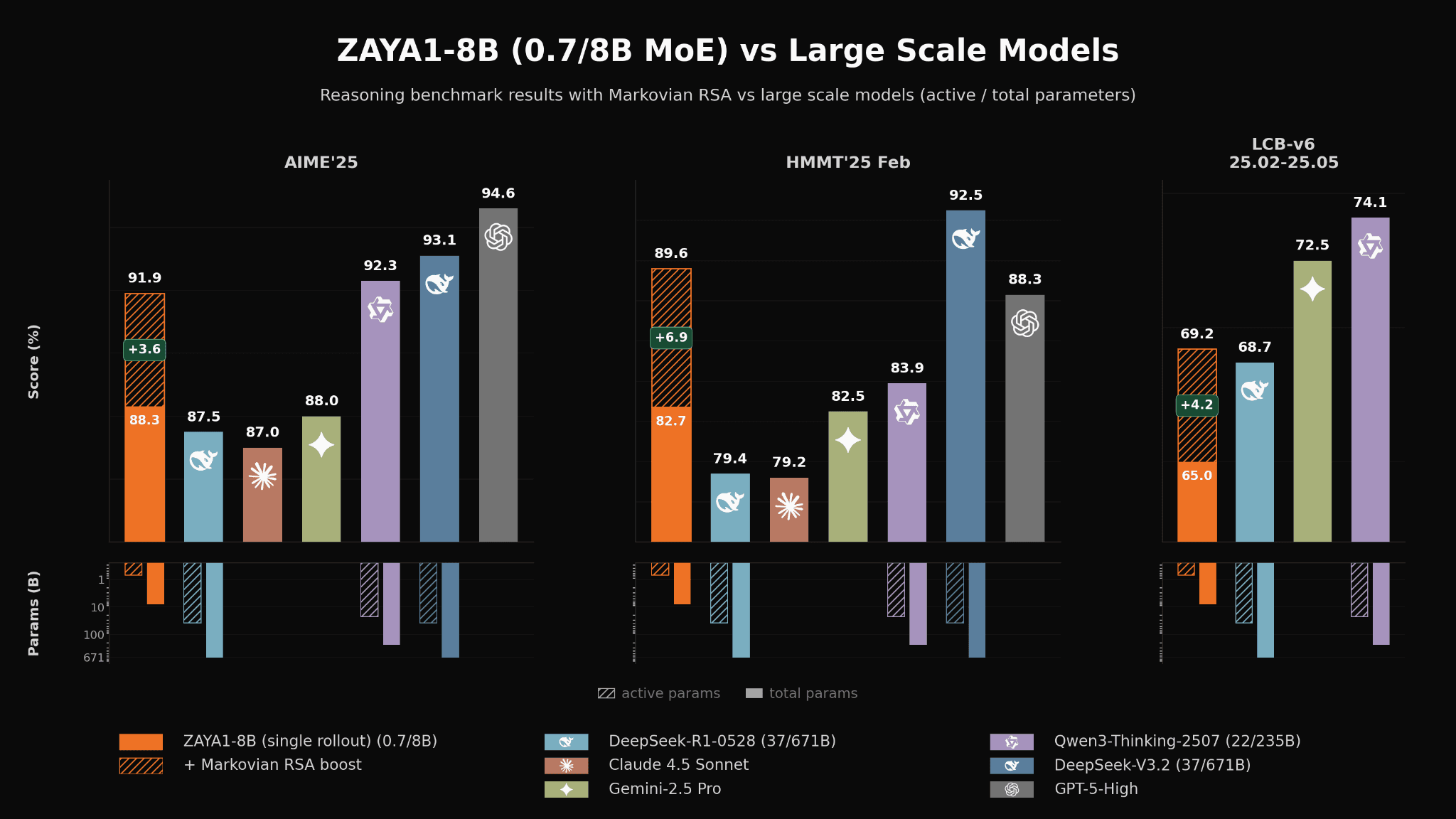

Zyphra sagt, ZAYA1-8B schneide bei komplexem Reasoning, Mathematik und Coding stark ab und übertreffe auf bestimmten Mathematik- und Coding-Benchmarks deutlich größere Open-Weight-Modelle [1]. In der Unternehmensankündigung heißt es ebenfalls, das Modell erreiche oder übertreffe wesentlich größere Open-Weight-Modelle bei komplexem Reasoning, Mathematik und Coding, während es weniger als 1 Mrd. aktive Parameter nutzt [

4].

Genau deshalb wird ZAYA1-8B überhaupt neben deutlich größeren Systemen diskutiert. Wenn sich die gemeldeten Ergebnisse in breiteren unabhängigen Tests bestätigen, wäre das ein Hinweis darauf, dass frontier-nahe Reasoning-Fähigkeiten nicht nur eine Frage der Gesamtgröße sind. Für Anwendungen mit vielen Inferenzläufen kann der aktive Rechenfußabdruck entscheidend sein. Die Modellkarte verweist ausdrücklich auf die Inferenz-Effizienz und die kleine Modellgröße als Gründe, warum ZAYA1-8B in Test-Time-Compute-Setups nützlich sein kann [6].

Warum die AMD-Trainingsgeschichte wichtig ist

ZAYA1-8B fällt auch wegen seiner Trainingsinfrastruktur auf. Zyphra sagt, es sei das erste MoE-Modell, das auf einem AMD-Instinct-MI300-Stack pretrained, midtrained und supervised fine-tuned wurde [1]. Die Unternehmensankündigung beschreibt das Modell als auf einer vollständigen AMD-Infrastruktur trainiert [

4].

Auch Sekundärberichte hoben hervor, dass ZAYA1-8B auf AMD-Silizium statt auf Nvidia-Hardware aufgebaut wurde [3]. Daraus folgt nicht, dass AMD Nvidia grundsätzlich überlegen wäre. Der belastbare Punkt ist enger: Zyphra präsentiert einen ernstzunehmenden High-End-MoE-Trainingslauf auf einem alternativen Beschleuniger-Stack [

1][

3][

4].

Das ist für den KI-Markt relevant, weil große Modelltrainings stark mit Nvidia-Ökosystemen verbunden sind. ZAYA1-8B zeigt zumindest, dass leistungsfähige MoE-Experimente nicht zwingend an eine einzige Hardware-Erzählung gebunden sein müssen — auch wenn daraus noch kein allgemeiner Sieger im Hardware-Wettbewerb folgt.

Was Entwicklerinnen und Entwickler prüfen können

ZAYA1-8B ist auf Hugging Face gelistet. Das gibt Entwicklerinnen, Forschern und Teams einen direkten Ort, um die Modellkarte und die Release-Details zu prüfen [6]. Sekundärberichte nennen außerdem eine Verfügbarkeit unter Apache-2.0-Lizenz auf Hugging Face sowie einen serverlosen Endpoint in der Zyphra Cloud [

5].

Das ist wichtig, weil Effizienzbehauptungen leichter überprüfbar sind, wenn ein Modell praktisch zugänglich ist. Wer selbst Benchmarks fährt, kann sehen, ob die Stärken auch in den eigenen Aufgaben auftauchen — etwa bei mathematischem Schließen, Code-Generierung oder längeren Problemlöseketten.

Trotzdem ersetzt eine Modellkarte keine breite unabhängige Validierung. Ob ZAYA1-8B in realen Produktionsumgebungen ähnlich überzeugend ist wie in ausgewählten Benchmarks, muss sich erst zeigen.

Was ZAYA1-8B noch nicht beweist

ZAYA1-8B sollte als vielversprechendes Effizienzsignal gelesen werden, nicht als endgültiges Urteil über das Rennen der Frontier-Modelle. Ein großer Teil der verfügbaren Aussagen stammt aus Zyphras eigenem Forschungsbeitrag, der Modellkarte, der Unternehmensankündigung oder Sekundärberichten [1][

4][

5][

6][

9].

Die Quellen betonen vor allem Mathematik, Coding und langes Reasoning. Sie belegen keine allgemeine Überlegenheit über alle Aufgaben hinweg [1][

6]. Sekundärberichterstattung schreibt ZAYA1-8B eine konkurrenzfähige Leistung auf Third-Party-Benchmarks gegenüber GPT-5-High und DeepSeek-V3.2 zu; auch das bleibt aber ein Benchmark-Vergleich und kein Nachweis, dass ZAYA1-8B das bessere Allzweckmodell ist [

9].

Die faire Einordnung ist daher enger — und gerade deshalb interessant: ZAYA1-8B scheint nach den bisher gemeldeten Daten ungewöhnlich viel Reasoning-Fähigkeit in ein Modell mit weniger als 1 Mrd. aktiven Parametern zu bringen. Das wäre bedeutsam, selbst wenn es nicht jede größere KI in jeder produktiven Aufgabe schlägt.

Fazit

ZAYA1-8B ist wichtig, weil es Effizienz in den Mittelpunkt rückt. Mit 8,4 Mrd. Gesamtparametern, 760 Mio. aktiven Parametern, stark berichteter Leistung bei Reasoning, Mathematik und Coding sowie einem End-to-End-Training auf AMD-Infrastruktur stellt es die Annahme infrage, dass nützliches frontier-nahes Reasoning immer sehr große aktive Parameterbudgets braucht [1][

4][

6].

Das vorsichtige Urteil lautet: beachtlich, glaubwürdig genug für genaue Beobachtung, aber noch nicht unabhängig abschließend geklärt. Wenn die gemeldeten Ergebnisse breit reproduziert werden, deutet ZAYA1-8B auf einen KI-Wettlauf hin, in dem Architektur, Trainingsrezepte, Post-Training und Hardware-Vielfalt genauso wichtig werden können wie reine Modellgröße [1][

6].