Suche & Faktencheck: Wie erkenne ich Fake News mit oder über KI?

Am zuverlässigsten erkennst du Fake News mit oder über KI nicht an einem einzelnen „KI Merkmal“, sondern indem du die Behauptung, die Quelle und den Kontext prüfst. Reine Sichtprüfung reicht oft nicht, weil Generative...

Am zuverlässigsten erkennst du Fake News mit oder über KI nicht an einem einzelnen „KI Merkmal“, sondern indem du die Behauptung, die Quelle und den Kontext prüfst. Reine Sichtprüfung reicht oft nicht, weil Generative KI gezielt darauf optimiert wird, menschlich zu wirken und glaubwürdige Narrative zu erzeugen, während

Wichtige Erkenntnisse

- Am zuverlässigsten erkennst du Fake News mit oder über KI nicht an einem einzelnen „KI-Merkmal“, sondern indem du die Behauptung, die Quelle und den Kontext prüfst. Reine Sichtprüfung reicht oft nicht, weil Generative KI gezielt darauf optimiert wird, menschlich zu wirken und gla

- Prüfe zuerst die Kernfrage: Was genau wird behauptet, und wo ist die Primärquelle? Wenn ein Post kein Originalvideo, kein vollständiges Zitat, kein Dokument oder keinen belastbaren Link zeigt, ist das ein Warnsignal.

Forschungsantwort

Am zuverlässigsten erkennst du Fake News mit oder über KI nicht an einem einzelnen „KI-Merkmal“, sondern indem du die Behauptung, die Quelle und den Kontext prüfst. Reine Sichtprüfung reicht oft nicht, weil Generative KI gezielt darauf optimiert wird, menschlich zu wirken und glaubwürdige Narrative zu erzeugen, während UNESCO und ein von Reuters zitierter UN-Bericht vor wachsenden Risiken durch Deepfakes, Desinformation, Wahlbeeinflussung und Betrug warnen.[1][

3][

4]

-

Prüfe zuerst die Kernfrage: Was genau wird behauptet, und wo ist die Primärquelle? Wenn ein Post kein Originalvideo, kein vollständiges Zitat, kein Dokument oder keinen belastbaren Link zeigt, ist das ein Warnsignal.

-

Trenne immer zwei Dinge:

- Ist das Medium echt?

- Ist die Aussage wahr? Ein echtes Video kann falsch betextet sein, und ein KI-generiertes Bild kann mit einer wahren Behauptung kombiniert werden.

-

Für Fake News mit KI:

- Suche nach dem Original: vollständiges Video, längere Tonspur, Ursprungs-Upload, Pressemitteilung, Behörden- oder Medienarchiv.

- Prüfe, ob Bild, Ton und Text zusammenpassen: Datum, Ort, Sprache, Lippenbewegung, Schatten, Schnitte, Logo, Hintergrund.

- Nutze Gegenchecks wie Rückwärtssuche für Bilder und einzelne Video-Frames. Auffälligkeiten sind aber nur Hinweise, kein Beweis.

-

Für Fake News über KI:

- Misstraue extremen Formulierungen wie „KI denkt jetzt wie ein Mensch“, „100 % genau“, „bewiesen“, „revolutionär“ oder „ersetzt alle Jobs ab sofort“.

- Suche nach dem Originalpaper, der Produktankündigung oder der offiziellen Doku statt nach Sekundärzitaten in Social Posts oder Screenshots.

- Frage: Wer profitiert von der Behauptung — Reichweite, Werbung, Aktienkurs, politische Wirkung?

-

Achte auf typische Warnzeichen:

- nur Screenshot statt Link

- abgeschnittenes Zitat

- fehlender Autor oder fehlendes Datum

- starker Zeitdruck („sofort teilen“)

- nur eine Quelle

- emotionalisierte Sprache statt überprüfbarer Fakten

-

Wichtigster Faktencheck-Grundsatz: Verifiziere nicht „ob es nach KI aussieht“, sondern ob unabhängige, belastbare Quellen dieselbe Behauptung bestätigen. Gerade weil GenAI-Systeme darauf getestet werden, von menschlichem Schreiben schwer unterscheidbar zu sein und glaubwürdige Narrative zu produzieren, ist „klingt plausibel“ ein schwacher Prüfmaßstab.[

1]

-

Kurzregel für den Alltag:

- Originalquelle suchen.

- Kontext prüfen.

- Zweite unabhängige Quelle suchen.

- Erst dann glauben oder teilen.

Wenn du willst, kann ich dir als Nächstes entweder eine 7-Punkte-Checkliste für den Alltag machen oder einen konkreten Post/Artikel Schritt für Schritt faktenchecken.

Unterstützende Visuals

Forschungsgespräch

Forschungsfrage

Suche & Faktencheck: Wie erkenne ich Fake News mit oder über KI?

Zitierte Antwort

Am zuverlässigsten erkennst du Fake News mit oder über KI nicht an einem einzelnen „KI-Merkmal“, sondern indem du die Behauptung, die Quelle und den Kontext prüfst. Reine Sichtprüfung reicht oft nicht, weil Generative KI gezielt darauf optimiert wird, menschlich zu wirken und glaubwürdige Narrative zu erzeugen, während UNESCO und ein von Reuters zitierter UN-Bericht vor wachsenden Risiken durch Deepfakes, Desinformation, Wahlbeeinflussung und Betrug warnen.[1][

3][

4]

-

Prüfe zuerst die Kernfrage: Was genau wird behauptet, und wo ist die Primärquelle? Wenn ein Post kein Originalvideo, kein vollständiges Zitat, kein Dokument oder keinen belastbaren Link zeigt, ist das ein Warnsignal.

-

Trenne immer zwei Dinge:

- Ist das Medium echt?

- Ist die Aussage wahr? Ein echtes Video kann falsch betextet sein, und ein KI-generiertes Bild kann mit einer wahren Behauptung kombiniert werden.

-

Für Fake News mit KI:

- Suche nach dem Original: vollständiges Video, längere Tonspur, Ursprungs-Upload, Pressemitteilung, Behörden- oder Medienarchiv.

- Prüfe, ob Bild, Ton und Text zusammenpassen: Datum, Ort, Sprache, Lippenbewegung, Schatten, Schnitte, Logo, Hintergrund.

- Nutze Gegenchecks wie Rückwärtssuche für Bilder und einzelne Video-Frames. Auffälligkeiten sind aber nur Hinweise, kein Beweis.

-

Für Fake News über KI:

- Misstraue extremen Formulierungen wie „KI denkt jetzt wie ein Mensch“, „100 % genau“, „bewiesen“, „revolutionär“ oder „ersetzt alle Jobs ab sofort“.

- Suche nach dem Originalpaper, der Produktankündigung oder der offiziellen Doku statt nach Sekundärzitaten in Social Posts oder Screenshots.

- Frage: Wer profitiert von der Behauptung — Reichweite, Werbung, Aktienkurs, politische Wirkung?

-

Achte auf typische Warnzeichen:

- nur Screenshot statt Link

- abgeschnittenes Zitat

- fehlender Autor oder fehlendes Datum

- starker Zeitdruck („sofort teilen“)

- nur eine Quelle

- emotionalisierte Sprache statt überprüfbarer Fakten

-

Wichtigster Faktencheck-Grundsatz: Verifiziere nicht „ob es nach KI aussieht“, sondern ob unabhängige, belastbare Quellen dieselbe Behauptung bestätigen. Gerade weil GenAI-Systeme darauf getestet werden, von menschlichem Schreiben schwer unterscheidbar zu sein und glaubwürdige Narrative zu produzieren, ist „klingt plausibel“ ein schwacher Prüfmaßstab.[

1]

-

Kurzregel für den Alltag:

- Originalquelle suchen.

- Kontext prüfen.

- Zweite unabhängige Quelle suchen.

- Erst dann glauben oder teilen.

Wenn du willst, kann ich dir als Nächstes entweder eine 7-Punkte-Checkliste für den Alltag machen oder einen konkreten Post/Artikel Schritt für Schritt faktenchecken.

Die Leute fragen auch

Wie lautet die kurze Antwort auf „Suche & Faktencheck: Wie erkenne ich Fake News mit oder über KI?“?

Am zuverlässigsten erkennst du Fake News mit oder über KI nicht an einem einzelnen „KI-Merkmal“, sondern indem du die Behauptung, die Quelle und den Kontext prüfst. Reine Sichtprüfung reicht oft nicht, weil Generative KI gezielt darauf optimiert wird, menschlich zu wirken und gla

Was sind die wichtigsten Punkte, die zuerst validiert werden müssen?

Am zuverlässigsten erkennst du Fake News mit oder über KI nicht an einem einzelnen „KI-Merkmal“, sondern indem du die Behauptung, die Quelle und den Kontext prüfst. Reine Sichtprüfung reicht oft nicht, weil Generative KI gezielt darauf optimiert wird, menschlich zu wirken und gla Prüfe zuerst die Kernfrage: Was genau wird behauptet, und wo ist die Primärquelle? Wenn ein Post kein Originalvideo, kein vollständiges Zitat, kein Dokument oder keinen belastbaren Link zeigt, ist das ein Warnsignal.

Welches verwandte Thema sollte ich als nächstes untersuchen?

Fahren Sie mit „Suche & Faktencheck: Welche KI ist besser: ChatGPT, Gemini, Claude, Copilot oder Perplexity?“ für einen anderen Blickwinkel und zusätzliche Zitate fort.

Zugehörige Seite öffnenWomit soll ich das vergleichen?

Vergleichen Sie diese Antwort mit „Suche & Faktencheck: Was ist ChatGPT und wie funktioniert es?“.

Zugehörige Seite öffnenSetzen Sie Ihre Recherche fort

Quellen

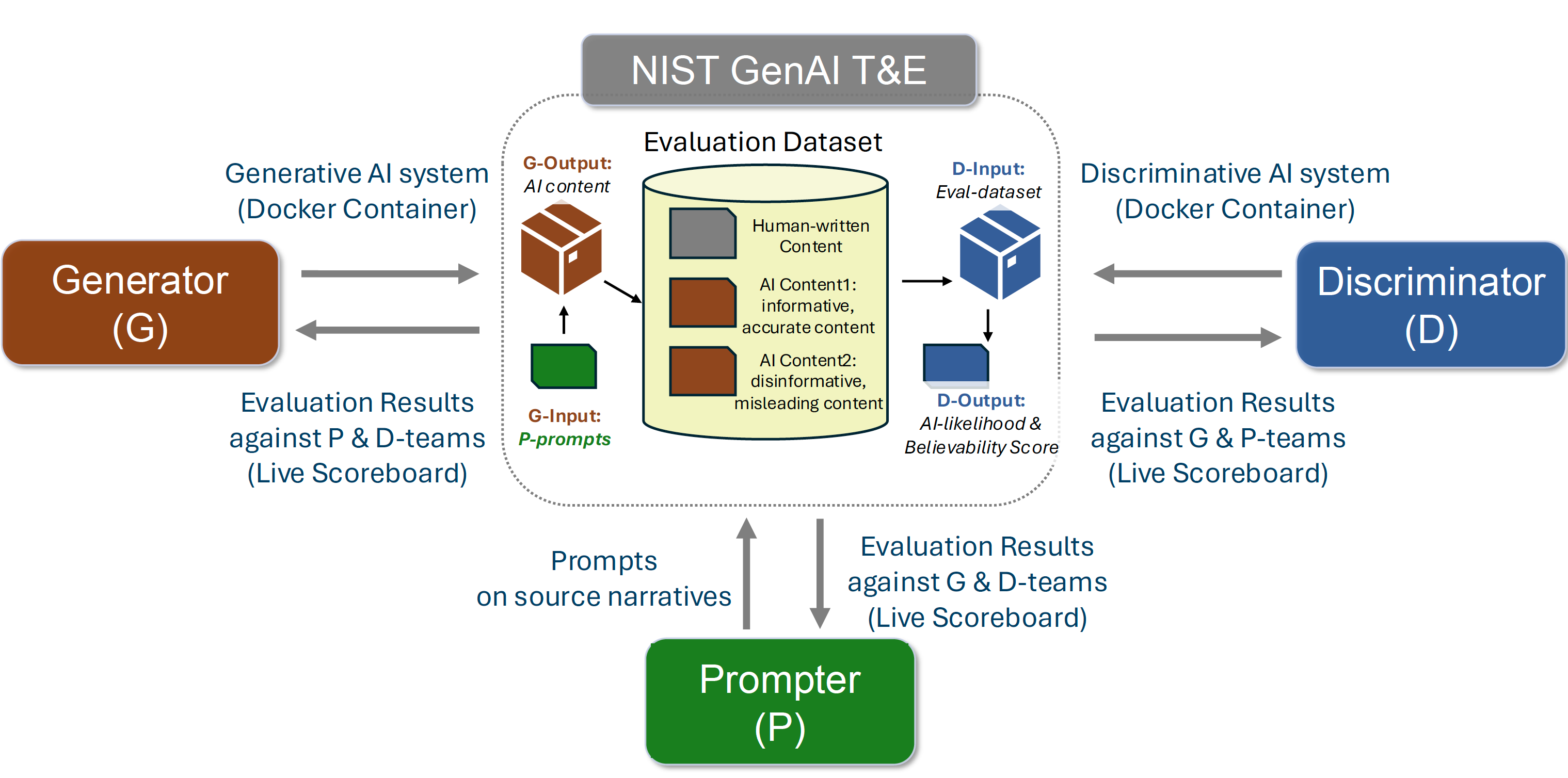

- [1] GenAI - text-2026ai-challenges.nist.gov

Evaluating the indistinguishability from human writing and the believability of generated narratives. The NIST Generative AI (GenAI) program supports research in generative AI with a structured series of evaluations testing the capabilities of multiple AI technologies in various modalities, beginning with text generation. + The purpose of asking prompters to craft prompts for generative AI models that will produce believable but misleading narratives is that the resulting data can be used to train detectors to recognize such narratives. * Evaluate the ability of generative AI models to produc…

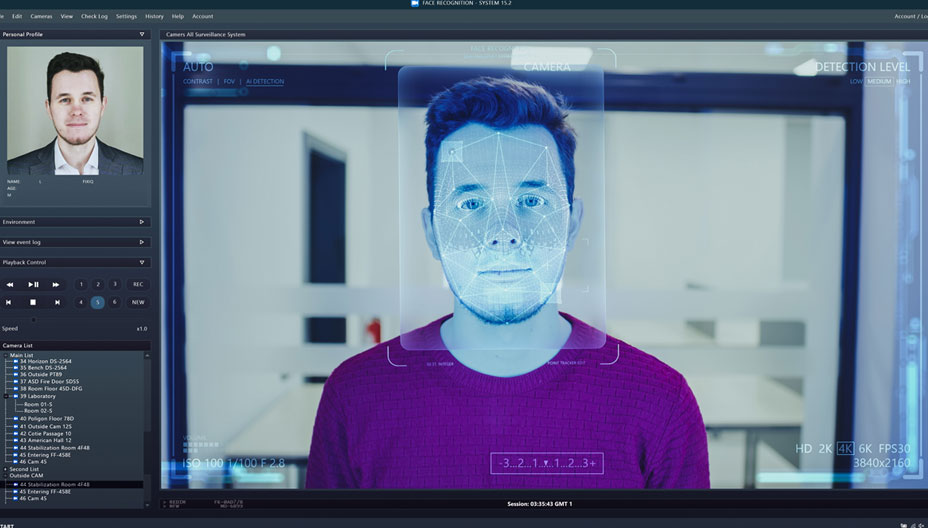

- [2] Digital Literacy for the Age of Deepfakes: Recognizing Misinformation in AI-Generated Media - Bertie County Center | N.C. Cooperative Extensionbertie.ces.ncsu.edu

Digital Literacy for the Age of Deepfakes: Recognizing Misinformation in AI-Generated Media. — Written by Rebecca Jinnette | March 25, 2025.

- [3] UN report urges stronger measures to detect AI-driven deepfakesreuters.com

Companies must use advanced tools to detect and stamp out misinformation and deepfake content to help counter growing risks of election interference and

- [4] Deepfakes and the crisis of knowing | UNESCOunesco.org

Skip to main content. * Governance. * Education. * Futures of Education. E-platform on Intercultural Dialogue UNESCO’s e-Platform on intercultural dialogue is designed for organizations and individuals to learn from shared knowledge or experiences from infl. * [English](https://www.unesco.org/en/articl…

- [5] AI deepfakes in 2025: Global legal actions taken this year - Agility PR Solutionsagilitypr.com

By mid-2025, it had already banned the most harmful uses of AI-based identity manipulation and introduced strict transparency requirements for AI-generated content. If successful, this national initiative could serve as a blueprint for Europe-wide deepfake regulation, shaping the continent’s legal response to AI-driven identity manipulation for years to come. The law zeroes in on non-consensual intimate imagery and impersonations, including deepfake pornography, sexual images, or any AI-generated media that falsely depicts a real person in a damaging way. * **Protect Elections from Deceptive…

- [6] Deepfake Detection 2026: When Reality Became Optionalaymanradwan.pro

Deepfake disinformation campaigns can erode audience trust broadly — not just in the outlet that ran the false content, but in the credibility of video journalism as a format. Reuters Institute for the Study of Journalism — Journalism, Media and Technology Trends 2026 (January 2026) · Keepnet Labs deepfake statistics and trend analysis (March 2026) · IBM Think Insights — New Wave of Deepfake Cybercrime (November 2025) · Deloitte TMT Predictions — Gen AI Trust Standards (December 2025) · NSA/CISA — Strengthening Multimedia Integrity in the Generative AI Era (January 2025) · C2PA Specif…

- [7] NIST announces new initiative to create systems that can detect AI-generated content - SiliconANGLEsiliconangle.com

NIST GenAI will work to create new AI benchmarks and attempt to build what it calls “content authenticity” detection systems that can detect AI-generated media.

- [8] The New Guidelines for Identifying AI Deepfakes - Synovussynovus.com

In September 2025, a partnership between the American Bankers Association and the Department of Justice released new guidelines for detecting AI

- [9] As AI-Generated Content Proliferates, UNESCO Warns of Growing Threat to Information Integrity - The Boca Raton Tribunebocaratontribune.com

As AI systems become more sophisticated and their outputs more convincing, the imperative for widespread media literacy education intensifies.

- [10] 🌍UN Urges Global Standards to Detect and Control AI Deepfakes - AI CERTs Newsaicerts.ai

UN urges global AI deepfake detection standards to fight rising threats from synthetic media, misinformation, and digital manipulation.

- [11] 2024 Press release – WSCworldstandardscooperation.org

Map the landscape of technical standards for AI watermarking, multimedia authenticity, and deepfake detection and how they support the policy