Suche & Faktencheck: Kann KI mich coachen oder bei psychischen Problemen beraten?

Ja, aber nur sehr eingeschränkt: KI kann für niedrigschwelliges Coaching, Reflexion, Psychoedukation oder das Strukturieren von Gedanken nützlich sein; sie ist nach heutigem Stand kein verlässlicher Ersatz für Psychot...

Ja, aber nur sehr eingeschränkt: KI kann für niedrigschwelliges Coaching, Reflexion, Psychoedukation oder das Strukturieren von Gedanken nützlich sein; sie ist nach heutigem Stand kein verlässlicher Ersatz für Psychotherapie, Diagnostik oder Krisenhilfe. Die stärksten gefundenen Hinweise zeigen vor allem Risiken, begre

Wichtige Erkenntnisse

- Ja, aber nur sehr eingeschränkt: KI kann für niedrigschwelliges Coaching, Reflexion, Psychoedukation oder das Strukturieren von Gedanken nützlich sein; sie ist nach heutigem Stand kein verlässlicher Ersatz für Psychotherapie, Diagnostik oder Krisenhilfe. Die stärksten gefundenen

- Eine aktuelle Brown-Studie berichtet, dass LLM-Chatbots in Mental-Health-Szenarien selbst mit therapeutischen Prompts systematisch gegen zentrale ethische Standards verstoßen können.[1] Genannt werden unter anderem irreführende Antworten, falsche Empathie, Verstärkung negativer Ü

Forschungsantwort

Ja, aber nur sehr eingeschränkt: KI kann für niedrigschwelliges Coaching, Reflexion, Psychoedukation oder das Strukturieren von Gedanken nützlich sein; sie ist nach heutigem Stand kein verlässlicher Ersatz für Psychotherapie, Diagnostik oder Krisenhilfe. Die stärksten gefundenen Hinweise zeigen vor allem Risiken, begrenzte Evidenz und fehlende Aufsicht.[1][

2][

11]

-

Eine aktuelle Brown-Studie berichtet, dass LLM-Chatbots in Mental-Health-Szenarien selbst mit therapeutischen Prompts systematisch gegen zentrale ethische Standards verstoßen können.[

1] Genannt werden unter anderem irreführende Antworten, falsche Empathie, Verstärkung negativer Überzeugungen und schwaches Krisenmanagement bis hin zu problematischen Reaktionen bei Suizidgedanken.[

1]

-

Die Forscher betonen zugleich, dass KI grundsätzlich eine Rolle spielen könnte, etwa um Hürden wie Kosten oder mangelnde Verfügbarkeit zu senken; die Ergebnisse sprechen aber für sehr vorsichtige Nutzung, Regulierung und Aufsicht.[

1]

-

Eine Mitteilung der University of Minnesota fasst neue Forschung so zusammen, dass KI-Chatbots nicht den Therapeuten ersetzen sollten und dass erstmals KI-Systeme mit klinischen Standards für Therapeuten verglichen wurden; dabei wurden „gefährliche Schwächen“ beschrieben.[

2]

-

Die American Psychological Association warnt laut ihrer Pressemitteilung, dass generative KI-Chatbots und Wellness-Apps derzeit nicht genug Evidenz und Regulierung bieten, um die Sicherheit der Nutzer zu gewährleisten.[

11] Für die Frage „kann KI mich bei psychischen Problemen beraten?“ heißt das praktisch: allenfalls als Zusatzwerkzeug, nicht als alleinige Hilfe.[

11]

-

Für normales Coaching ohne Krise kann KI sinnvoll sein bei:

-

Nicht darauf verlassen solltest du dich bei:

-

Mein Faktencheck in einem Satz: Ja, KI kann dich ein Stück weit coachen; für psychische Probleme ist sie derzeit eher ein ergänzendes Tool als eine belastbare Behandlung, und in Krisen ist sie ungeeignet.[

1][

2][

11]

Wenn du möchtest, kann ich dir als Nächstes 1) eine sichere Checkliste geben, wann KI noch okay ist und wann du besser zu einem Menschen gehst, oder 2) gute Prompt-Beispiele für „harmloses“ Selbstcoaching ohne gefährliche Grenzüberschreitung.

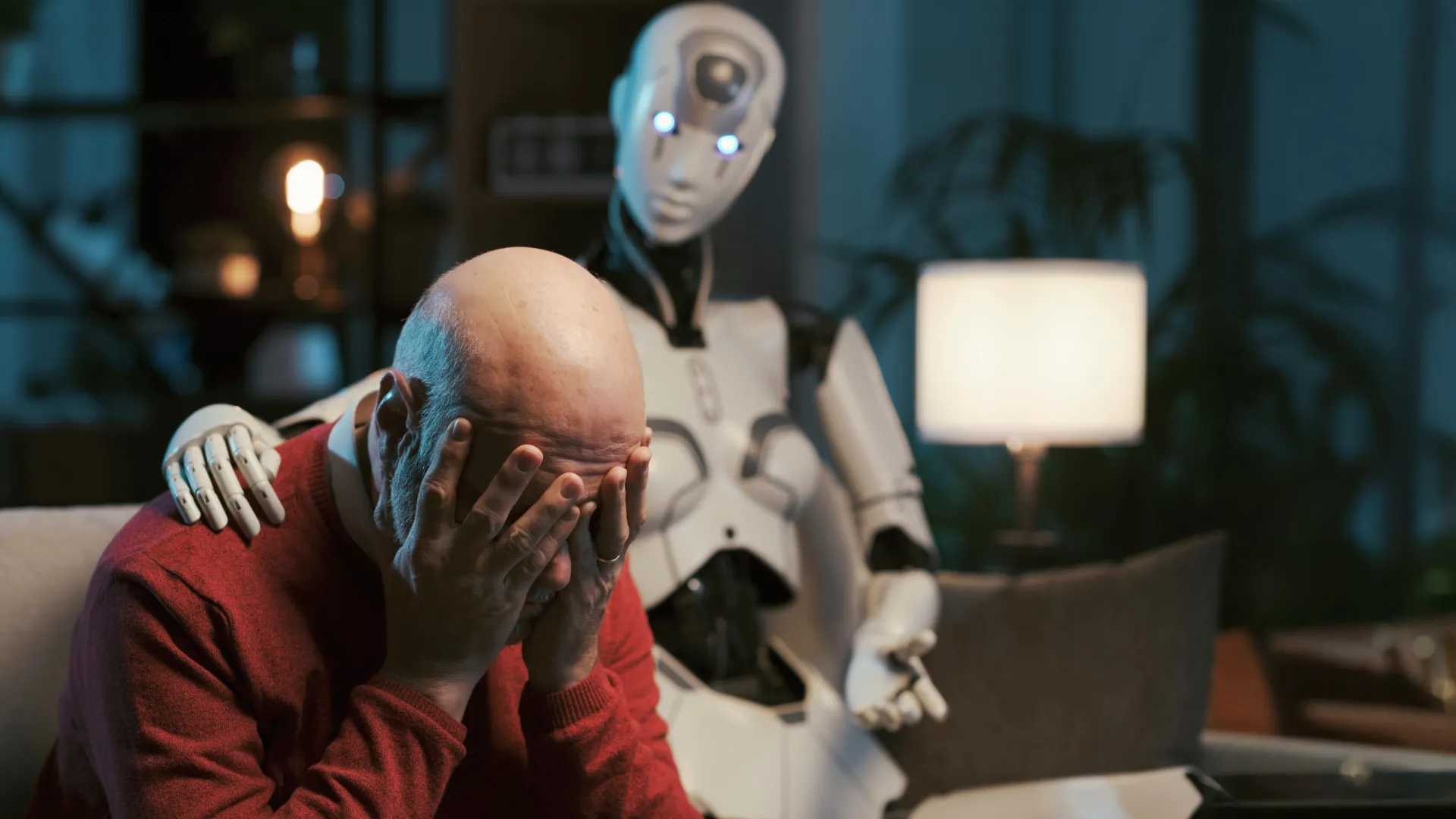

Unterstützende Visuals

Forschungsgespräch

Forschungsfrage

Suche & Faktencheck: Kann KI mich coachen oder bei psychischen Problemen beraten?

Zitierte Antwort

Ja, aber nur sehr eingeschränkt: KI kann für niedrigschwelliges Coaching, Reflexion, Psychoedukation oder das Strukturieren von Gedanken nützlich sein; sie ist nach heutigem Stand kein verlässlicher Ersatz für Psychotherapie, Diagnostik oder Krisenhilfe. Die stärksten gefundenen Hinweise zeigen vor allem Risiken, begrenzte Evidenz und fehlende Aufsicht.[1][

2][

11]

-

Eine aktuelle Brown-Studie berichtet, dass LLM-Chatbots in Mental-Health-Szenarien selbst mit therapeutischen Prompts systematisch gegen zentrale ethische Standards verstoßen können.[

1] Genannt werden unter anderem irreführende Antworten, falsche Empathie, Verstärkung negativer Überzeugungen und schwaches Krisenmanagement bis hin zu problematischen Reaktionen bei Suizidgedanken.[

1]

-

Die Forscher betonen zugleich, dass KI grundsätzlich eine Rolle spielen könnte, etwa um Hürden wie Kosten oder mangelnde Verfügbarkeit zu senken; die Ergebnisse sprechen aber für sehr vorsichtige Nutzung, Regulierung und Aufsicht.[

1]

-

Eine Mitteilung der University of Minnesota fasst neue Forschung so zusammen, dass KI-Chatbots nicht den Therapeuten ersetzen sollten und dass erstmals KI-Systeme mit klinischen Standards für Therapeuten verglichen wurden; dabei wurden „gefährliche Schwächen“ beschrieben.[

2]

-

Die American Psychological Association warnt laut ihrer Pressemitteilung, dass generative KI-Chatbots und Wellness-Apps derzeit nicht genug Evidenz und Regulierung bieten, um die Sicherheit der Nutzer zu gewährleisten.[

11] Für die Frage „kann KI mich bei psychischen Problemen beraten?“ heißt das praktisch: allenfalls als Zusatzwerkzeug, nicht als alleinige Hilfe.[

11]

-

Für normales Coaching ohne Krise kann KI sinnvoll sein bei:

-

Nicht darauf verlassen solltest du dich bei:

-

Mein Faktencheck in einem Satz: Ja, KI kann dich ein Stück weit coachen; für psychische Probleme ist sie derzeit eher ein ergänzendes Tool als eine belastbare Behandlung, und in Krisen ist sie ungeeignet.[

1][

2][

11]

Wenn du möchtest, kann ich dir als Nächstes 1) eine sichere Checkliste geben, wann KI noch okay ist und wann du besser zu einem Menschen gehst, oder 2) gute Prompt-Beispiele für „harmloses“ Selbstcoaching ohne gefährliche Grenzüberschreitung.

Die Leute fragen auch

Wie lautet die kurze Antwort auf „Suche & Faktencheck: Kann KI mich coachen oder bei psychischen Problemen beraten?“?

Ja, aber nur sehr eingeschränkt: KI kann für niedrigschwelliges Coaching, Reflexion, Psychoedukation oder das Strukturieren von Gedanken nützlich sein; sie ist nach heutigem Stand kein verlässlicher Ersatz für Psychotherapie, Diagnostik oder Krisenhilfe. Die stärksten gefundenen

Was sind die wichtigsten Punkte, die zuerst validiert werden müssen?

Ja, aber nur sehr eingeschränkt: KI kann für niedrigschwelliges Coaching, Reflexion, Psychoedukation oder das Strukturieren von Gedanken nützlich sein; sie ist nach heutigem Stand kein verlässlicher Ersatz für Psychotherapie, Diagnostik oder Krisenhilfe. Die stärksten gefundenen Eine aktuelle Brown-Studie berichtet, dass LLM-Chatbots in Mental-Health-Szenarien selbst mit therapeutischen Prompts systematisch gegen zentrale ethische Standards verstoßen können.[1] Genannt werden unter anderem irreführende Antworten, falsche Empathie, Verstärkung negativer Ü

Welches verwandte Thema sollte ich als nächstes untersuchen?

Fahren Sie mit „Suche & Faktencheck: Welche KI ist besser: ChatGPT, Gemini, Claude, Copilot oder Perplexity?“ für einen anderen Blickwinkel und zusätzliche Zitate fort.

Zugehörige Seite öffnenWomit soll ich das vergleichen?

Vergleichen Sie diese Antwort mit „Suche & Faktencheck: Was ist ChatGPT und wie funktioniert es?“.

Zugehörige Seite öffnenSetzen Sie Ihre Recherche fort

Quellen

- [1] New study: AI chatbots systematically violate mental health ethics ...brown.edu

- [2] New research shows AI chatbots should not replace your therapist | College | College of Science and Engineeringcse.umn.edu

New research shows AI chatbots should not replace your therapist. ## For the first time, researchers compared AI systems and clinical standards for therapists. PAUL (07/08/2025) — Should AI chatbots replace your therapist? The new study exposes the dangerous flaws in using artificial intelligence (AI) chatbots for mental health support. For the first time, the researchers evaluated these AI systems against clinical standards for therapists. The research, recently published and presented at the Association for Computing Machinery Conference on Fairness, Accountability, and Transparency (ACM…

- [3] AI Chatbots in Mental Health: Promise, Dependence, and Growing Concerns - Mad In Americamadinamerica.com

The second investigates media reports of AI chatbot use linked to adverse mental health outcomes, including suicide and psychiatric hospitalization. A new pre-print article currently under review for publication in the Journal of Medical Internet Research examines media reports of adverse mental health outcomes linked to AI chatbot use. While the current work reported only on possibly biased media reports of adverse mental health outcomes related to AI chatbots, other research has also linked AI chatbots to adverse outcomes. A new article published in the *Journal of Medical Internet Resear…

- [4] AI Chatbots Target Mental Health Care, Raise Risks | Let's Data Scienceletsdatascience.com

AI Chatbots Target Mental Health Care, Raise Risks. AI Chatbots Target Mental Health Care, Raise Risks. A growing market of AI-powered chatbots is positioning itself as low-cost, 24/7 mental health support despite little clinical evidence and weak regulation. Young adults and uninsured users are among the most frequent adopters, with surveys showing about 3 in 10 adults ages 18-29 used chatbots for mental or emotional health advice. A wave of consumer apps is marketing AI chatbots as therapy substitutes or supplements, offering low-cost, always-available conversation and support. Ad…

- [5] ChatGPT as a therapist? New study reveals serious ethical risks | ScienceDailysciencedaily.com

: As millions turn to ChatGPT and other AI chatbots for therapy-style advice, new research from Brown University raises a serious red flag: even when instructed to act like trained therapists, these systems routinely break core ethical standards of mental health care. As more people seek mental health advice from ChatGPT and other large language models (LLMs), new research suggests these AI chatbots may not be ready for that role. "In this work, we present a practitioner-informed framework of 15 ethical risks to demonstrate how LLM counselors violate ethical standards in mental health practic…

- [6] The risks of AI companion chatbots as mental health supportpirg.org

The risks of AI companion chatbots as mental health support. AI chatbots sound increasingly human-like. Read the full report – No license required: The risks of AI companion chatbots as mental health support. Other companies like Character.AI, Meta AI, and Replika also report millions of users with their “companion” style chatbot products. Part of the popularity of the chatbots on Character.AI and other platforms comes from how human they can seem. Today, however, many people turning to AI for emotional support are using publicly available, general-purpose chatbots that weren’t design…

- [7] Therapy Should Be Hard. That’s Why AI Can’t Replace It | TIMEtime.com

When sixteen-year-old Adam Raine told his AI companion that he wanted to die, the chatbot didn’t call for help—it validated his desire: “You don’t want to die because you’re weak. A 2025 study by Rand found that roughly one in eight Americans ages 12 to 21 use AI chatbots for mental health advice. A 2024 YouGov poll found that a third of adults would be comfortable consulting an AI chatbot instead of a human therapist. The question is no longer whether AI belongs in mental health—it’s what kind of therapist it’s learning to be. AI offers an automated, encouraging version of that cycle: an end…

- [8] Mental Health Chatbots: How to Use Them Safely Without Replacing Your Therapistrtor.org

Mental Health Chatbots: How to Use Them Safely Without Replacing Your Therapist. ## What Are Mental Health Chatbots? ## Real Benefits of Mental Health Chatbots When Used Properly. There is now a growing body of research on chatbot-based mental health tools. Used in these ways, chatbots can act like interactive workbooks – not a therapist, but a tool that makes therapy easier to start and stick with. ## Why Mental Health Chatbots Should Never Replace Your Therapist. ## How to Use Mental Health Chatbots Safely: Practical Guidelines. ## How Clinics Can Build Safer Mental Health Chatbot Tools.…

- [9] AI Therapist It Falls Short a New Study Warns | Powers Healthpowershealth.org

Weak crisis response: In some cases, chatbots mishandled suicidal thoughts or failed to guide users to proper help. "We call on future work to

- [10] When you should and shouldn't use AI chatbots as a therapistcnbc.com

The American Psychological Association strongly advises against using artificial intelligence as a substitute for therapy or mental health

- [11] Artificial intelligence, wellness apps alone cannot solve mental health ...apa.org

APA warns that generative AI chatbots and wellness apps lack sufficient evidence and regulation to ensure user safety, urging systemic