Bei Claude Opus 4.7 reicht ein Blick auf den Preis pro Million Token nicht aus. Für die tatsächliche API-Rechnung zählt immer beides: der offizielle Preis pro Token-Einheit und die Anzahl der Token, die der Tokenizer aus Ihrem Text macht.

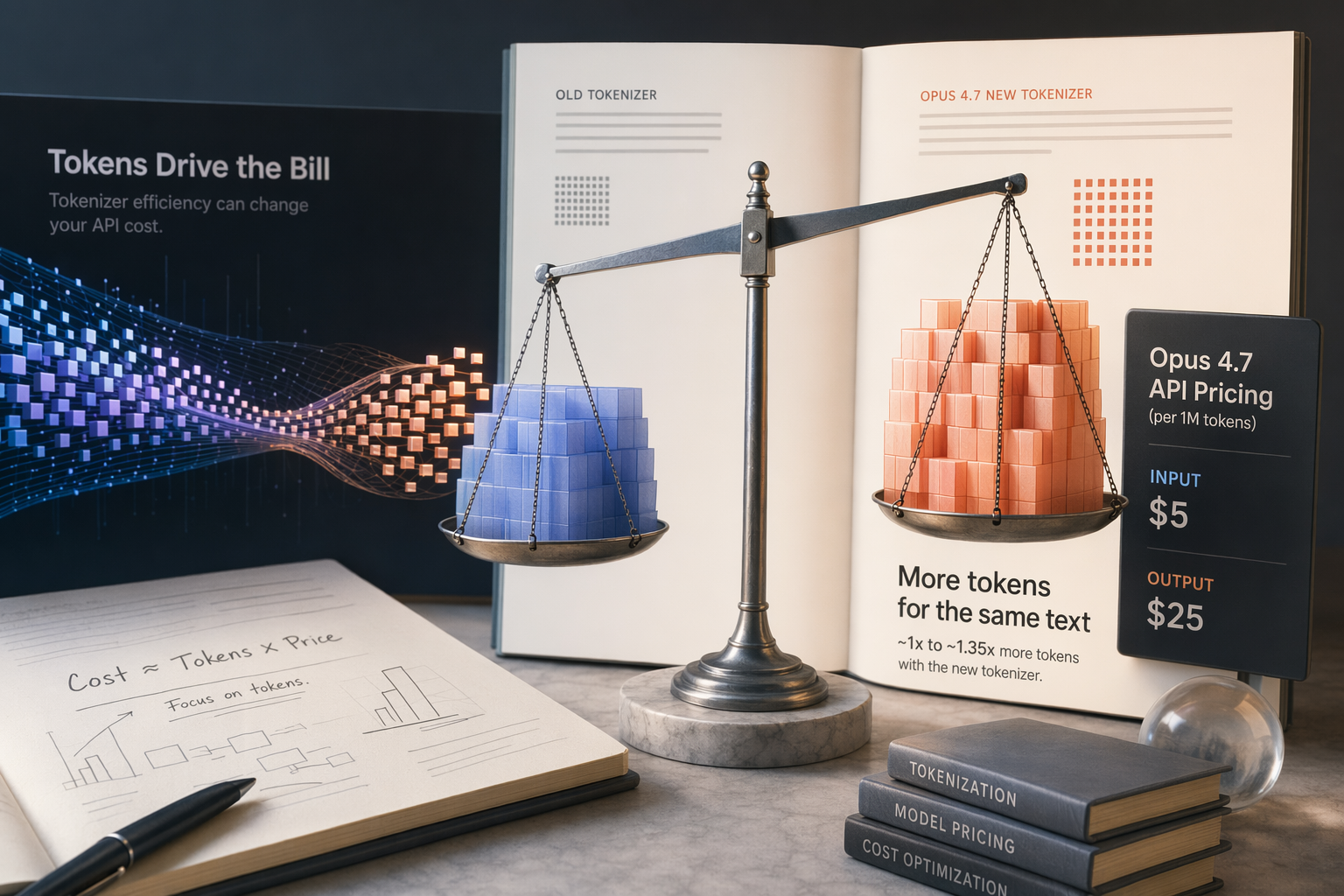

Anthropic listet für Claude Opus 4.7 API-Preise von 5 US-Dollar pro Million Input-Token und 25 US-Dollar pro Million Output-Token. Gleichzeitig steht in der Dokumentation, dass der neue Tokenizer für denselben Text im Vergleich zu früheren Modellen ungefähr das 1- bis 1,35-Fache an Token verwenden kann; der Effekt hängt vom Inhalt ab.[1][

2]

Die kurze Antwort lautet daher: Der öffentliche Listenpreis muss nicht gestiegen sein. Die tatsächliche Rechnung kann aber höher ausfallen, wenn dieselben Prompts, Dokumente oder Codeblöcke unter Opus 4.7 als mehr Token gezählt werden.

Was die offiziellen Angaben bedeuten

Anthropic bestätigt zwei Punkte, die man zusammen lesen muss.

Erstens: In den Hinweisen zu Opus 4.7 schreibt Anthropic, dass der neue Tokenizer bei der Verarbeitung von Text ungefähr 1x bis 1,35x so viele Token verwenden kann wie vorherige Modelle. Außerdem gibt /v1/messages/count_tokens für Claude Opus 4.7 andere Token-Zahlen zurück als für Claude Opus 4.6.[1]

Zweitens: Auf der Opus-4.7-Seite nennt Anthropic die API-Preise mit 5 US-Dollar pro Million Input-Token und 25 US-Dollar pro Million Output-Token.[2]

Daraus folgt: Das Preisblatt ist nur die eine Hälfte der Rechnung. Die andere Hälfte ist die tatsächlich gezählte Token-Menge. Wenn dieselbe Eingabe durch den neuen Tokenizer in mehr abrechenbare Token zerlegt wird, kann die Eingabeseite der Rechnung steigen, auch wenn der Preis pro Million Token gleich aussieht.[1][

2]

Ist das eine Preiserhöhung?

Das hängt davon ab, was man mit „teurer“ meint.

1. Listenpreis pro Token: offiziell 5 US-Dollar Input, 25 US-Dollar Output

Nach den öffentlich genannten Angaben kostet Claude Opus 4.7 in der API 5 US-Dollar pro Million Input-Token und 25 US-Dollar pro Million Output-Token.[2] Wer also nur fragt, ob Anthropic auf der Opus-4.7-Seite einen höheren öffentlichen Preis pro Token-Einheit nennt, sollte aus der Tokenizer-Änderung allein keine solche Schlussfolgerung ziehen.

2. Kosten für dieselben Inhalte: sie können steigen

In der Praxis bezahlen Teams aber nicht für „denselben Prompt“ als Textdatei, sondern für die daraus gezählten Token. Wenn der neue Tokenizer aus derselben Eingabe mehr Token macht, steigt bei ansonsten gleichen Bedingungen auch der Input-Anteil der Kosten.[1][

2]

Ein einfaches Rechenbeispiel: Werden 1.000.000 Input-Token mit 5 US-Dollar pro Million berechnet, kostet dieser Input-Anteil 5 US-Dollar. Würde dieselbe Textmenge unter Opus 4.7 nahe am oberen Rand der von Anthropic genannten Spanne liegen und etwa 1.350.000 Input-Token ergeben, läge der Input-Anteil bei rund 6,75 US-Dollar.[1][

2]

Das ist nur eine Beispielrechnung auf Basis der offiziellen Spanne. Sie bedeutet nicht, dass jede Anwendung automatisch um 35 % teurer wird.

Die 35 % sind kein Pauschalwert

Anthropic spricht von „roughly 1x to 1.35x“ und weist darauf hin, dass die Abweichung vom Inhalt abhängt.[1] Für Kostenmodelle ist das wichtig: Man sollte nicht einfach pauschal den Faktor 1,35 auf alle Workloads legen.

Kurze Prompts, lange Dokumente, Quellcode, strukturierte Daten, Chat-Verläufe und große Kontextfenster können unterschiedlich betroffen sein. Je länger der Kontext und je höher das Anfragevolumen, desto stärker lohnt sich eine genaue Messung. Die tatsächliche Veränderung lässt sich aber nur mit den eigenen Daten belastbar abschätzen.[1]

Vor dem Umstieg: eigene Token-Zahlen messen

Der pragmatische Weg ist nicht Rätselraten, sondern Stichprobenmessung. Anthropic weist darauf hin, dass /v1/messages/count_tokens für Claude Opus 4.7 andere Token-Zahlen zurückgeben kann als für Claude Opus 4.6.[1]

Ein sinnvoller Prüfplan:

- Sammeln Sie typische und kostenträchtige Anfragen: häufige Prompts, lange Zusammenfassungen, Code-Aufgaben, strukturierte Eingaben und mehrstufige Dialoge.

- Zählen Sie diese Beispiele mit

/v1/messages/count_tokensfür Claude Opus 4.7.[1]

- Vergleichen Sie die Werte mit den bisherigen Token-Zahlen oder mit Abrechnungsdaten des aktuellen Modells.

- Rechnen Sie die erwarteten Kosten mit den offiziellen Preisen durch: 5 US-Dollar pro Million Input-Token und 25 US-Dollar pro Million Output-Token.[

2]

- Falls die Kosten deutlich steigen, prüfen Sie kürzere Prompts, weniger mitgeschleppten Kontext, Caching-Strategien oder eine Modell-Routing-Logik.

Die sauberste Formulierung für Teams

Präzise wäre: Claude Opus 4.7 wird offiziell mit 5 US-Dollar pro Million Input-Token und 25 US-Dollar pro Million Output-Token angegeben. Der neue Tokenizer kann für denselben Text jedoch etwa 1x bis 1,35x so viele Token zählen wie frühere Modelle.[1][

2] Deshalb kann die reale API-Rechnung für denselben Workload steigen – abhängig vom Inhalt, der gezählten Token-Menge und der tatsächlich erzeugten Ausgabe.

Fazit

Claude Opus 4.7 lässt sich nicht sauber als einfache „Preissteigerung pro Token“ beschreiben. Genauso falsch wäre aber die Aussage, der neue Tokenizer habe keinerlei Kosteneffekt. Entscheidend ist: Der öffentliche API-Preis muss zusammen mit der neuen Token-Zählung betrachtet werden. Wenn derselbe Inhalt mehr Token ergibt, kann auch die Rechnung höher ausfallen.[1][

2]