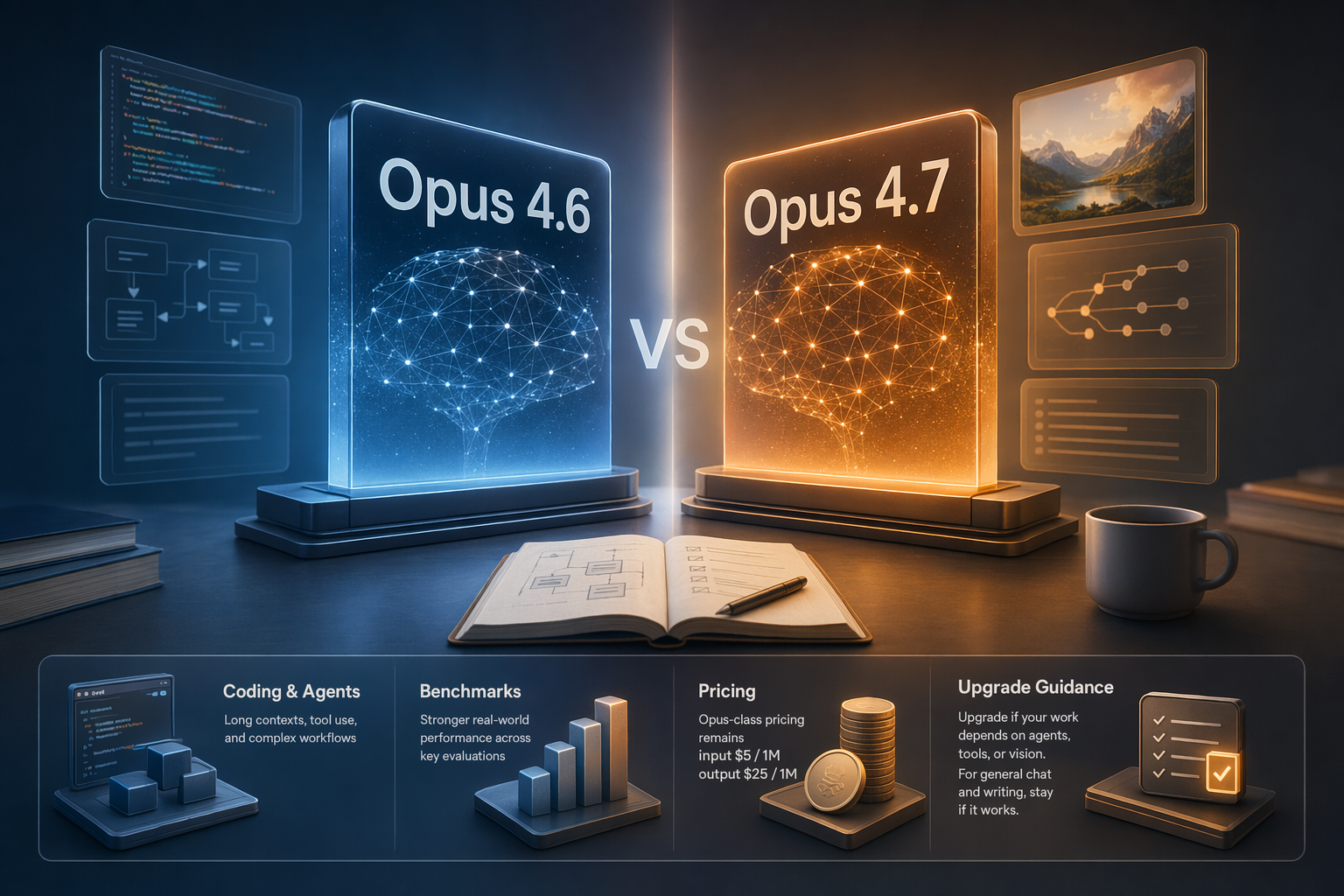

Die kurze Antwort: Claude Opus 4.7 ist kein Modellwechsel, den alle sofort vollziehen müssen. Es ist eher ein gezieltes Upgrade für Teams, die Opus 4.6 bereits für anspruchsvolles Coding, Repository-Analyse, mehrstufige Tool-Nutzung oder Bildverständnis einsetzen. Für diese Workflows gehört 4.7 auf die A/B-Testliste. Wer Opus vor allem für Chat, Zusammenfassungen, Übersetzungen oder Marketingtexte nutzt, sollte dagegen nicht allein wegen der Versionsnummer migrieren.[3][

6][

8][

9]

Was sich gegenüber Opus 4.6 geändert hat

| Bereich | Was öffentlich bekannt ist | Bedeutung für die Upgrade-Entscheidung |

|---|---|---|

| Verfügbarkeit | LLM Stats führt den 16. April 2026 als Veröffentlichungsdatum von Opus 4.7; Anthropic nennt claude-opus-4-7 als Modell für die Claude API.[ | Teams können reale Tests planen, statt nur auf eine Ankündigung zu reagieren. |

| Preis | Laut LLM Stats ist Opus 4.7 ein direkter Nachfolger von Opus 4.6 zum gleichen Preis: $5 pro Million Input-Tokens und $25 pro Million Output-Tokens.[ | Der Token-Einzelpreis steigt nicht. Die tatsächliche Rechnung kann sich trotzdem durch längere Antworten, weniger oder mehr Wiederholungen und andere Workflow-Einstellungen ändern. |

| Coding und Software Engineering | Anthropic positioniert 4.7 als stärker bei Advanced Software Engineering, besonders bei schwierigen Aufgaben; LLM Stats nennt 87,6 % auf SWE-bench Verified, 6,8 Prozentpunkte über 4.6.[ | Der naheliegendste Testfall sind Coding-Agents, Bugfixes, Repo-weite Analysen, Refactorings und Test-Reparaturen. |

| Lange Agent-Aufgaben | LLM Stats beschreibt Verbesserungen für long-running agentic work inklusive Self-Verification; Anthropic nennt ebenfalls Verbesserungen bei long-running tasks.[ | Wenn 4.6 in langen Abläufen Schritte auslässt, vom Plan abweicht oder Tools unzuverlässig nutzt, ist 4.7 ein ernsthafter Kandidat. |

| Vision | Anthropic spricht von deutlich besserer Vision-Leistung und höher aufgelösten Bildern; LLM Stats nennt rund 3,3× höhere Bildauflösung.[ | Spürbar kann das bei UI-Screenshots, technischen Diagrammen, Tabellen, gescannten Dokumenten und Design-Reviews werden. |

| Neue Steueroptionen | Drittanbieter-Übersichten nennen unter anderem xhigh effort und Task Budgets als neue, eher auf Agent- und Coding-Workflows ausgerichtete Funktionen.[ | Für API- und Agent-Entwickler kann das wichtig sein; normale Chat-Nutzer müssen solche Regler meist nicht anfassen. |

Benchmarks: gutes Signal, aber kein Freifahrtschein

Die öffentlichen Zahlen zeigen eine klare Richtung: Opus 4.7 soll vor allem bei schwierigen Coding-Aufgaben, agentischen Workflows und Vision zulegen. LLM Stats berichtet für Opus 4.7 87,6 % auf SWE-bench Verified, 6,8 Prozentpunkte mehr als Opus 4.6, und schreibt, dass 4.7 in 12 von 14 gemeldeten Benchmarks vor 4.6 liegt.[6][

8]

Trotzdem sollten diese Werte nicht überinterpretiert werden. LLM Stats weist darauf hin, dass die Benchmarks von Anthropic selbst berichtet wurden; Verdent AI merkt außerdem an, dass die von Anthropic zitierten Fälle von Notion und Rakuten entweder interne Partner-Szenarien oder proprietäre Benchmarks sind – also keine allgemein reproduzierbaren Standardtests.[3][

6]

Für die Praxis heißt das: Die Benchmarks stützen die Annahme, dass 4.7 bei komplexem Coding, langen Agent-Schleifen und höher aufgelöster Bildanalyse besser passt. Sie beweisen aber nicht, dass jede bestehende Opus-4.6-Pipeline automatisch zuverlässiger, günstiger oder schneller wird.

Preis: gleicher Token-Tarif, aber nicht automatisch gleiche Gesamtkosten

Der wichtigste Kostenpunkt ist zunächst erfreulich einfach: Laut LLM Stats bleibt Opus 4.7 beim Opus-4.6-Preis von $5 pro Million Input-Tokens und $25 pro Million Output-Tokens.[8] Für Teams, die ohnehin Opus bezahlen, senkt das die Hürde für einen Testlauf.

Entscheidend ist aber nicht nur der Preis pro Token, sondern der Preis pro erledigter Aufgabe. Wenn 4.7 längere Antworten erzeugt, andere Effort-Stufen nutzt oder zusätzliche Agent-Schritte ausführt, kann die Rechnung steigen. Wenn es dagegen weniger Tool-Fehler, weniger Wiederholungen oder weniger manuelle Nacharbeit verursacht, kann die Aufgabe insgesamt günstiger werden. Genau deshalb sollte man nicht nur die Token-Preisliste vergleichen, sondern echte Produktionslogs oder zumindest realistische Testfälle auswerten.

Wer sollte Opus 4.7 früh testen?

Ein früher A/B-Test lohnt sich vor allem für diese Gruppen:

- Softwareteams und Coding-Agent-Entwickler: Wenn Opus 4.6 bereits für Repo-Analyse, Bugfixing, Test-Reparaturen, Code-Reviews oder Multi-File-Refactorings eingesetzt wird, passen die öffentlich genannten Verbesserungen von 4.7 sehr gut zum Einsatzprofil.[

8][

9]

- Teams mit langen Tool-Workflows: Wer Agenten über viele Schritte planen, ausführen, prüfen und korrigieren lässt, sollte die Verbesserungen bei long-running agentic work testen.[

6][

8][

9]

- Produkte mit Bild- oder Dokumentverständnis: UI-Screenshots, technische Zeichnungen, Tabellenbilder, Scans und Designentwürfe sind typische Fälle, in denen die höhere Vision-Auflösung relevant werden kann.[

6][

8][

9]

- Organisationen, die bereits Opus-Kosten eingeplant haben: Da der öffentliche Preisvergleich keinen höheren Token-Tarif nennt, ist ein kontrollierter Test finanziell leichter zu begründen.[

8]

Wer kann erst einmal abwarten?

Für allgemeine Chats, kurze Zusammenfassungen, Übersetzungen, Wissensfragen oder klassische Textproduktion gibt es keinen zwingenden Grund, sofort alles umzustellen. Die stärksten öffentlichen Belege konzentrieren sich auf Coding, Agents und Vision; für einfache Content-Aufgaben ist der erwartbare Mehrwert weniger klar belegt.[3][

6][

9]

Vorsicht ist auch angebracht, wenn eine bestehende Produktionsumgebung lange auf Opus 4.6 abgestimmt wurde – etwa mit festen JSON-Formaten, strengem Tonfall, juristisch sensiblen Textbausteinen oder vielen Randfällen. Ein stärkeres Modell kann trotzdem anders formulieren, andere Fehler machen oder Formatdetails anders gewichten. Für solche Workflows ist ein schrittweiser Rollout besser als ein harter Austausch.

Praktische A/B-Testliste vor der Migration

Statt Opus 4.6 über Nacht zu ersetzen, sollten Teams 4.7 mit echten Aufgaben vergleichen:

- Repräsentative Fälle auswählen: Erfolgreiche Standardfälle, bekannte 4.6-Fehler, lange Agent-Abläufe und besonders wertvolle Aufgaben gehören alle in den Test.

- Prompt und Umgebung einfrieren: Modellversion ändern, aber Systemprompt, Tools, Retrieval, Dateien und Evaluationslogik möglichst gleich lassen.

- Messwerte erfassen: Wichtig sind Erfolgsrate, manuelle Korrekturzeit, Tool-Fehler, Input- und Output-Tokens, Wiederholungen und Latenz.

xhighseparat testen:xhigheffort wird in 4.7-Übersichten als neue Steueroption genannt, sollte aber nicht automatisch für alle Aufgaben aktiviert werden.[2][

6][

8]

- Vision-Aufgaben gesondert prüfen: Wer Bildverständnis braucht, sollte mit echten Screenshots, Tabellen, Diagrammen oder Scans testen – nicht nur mit einfachen Demo-Grafiken.[

6][

8][

9]

- Fallback auf 4.6 behalten: Für den Produktivbetrieb empfiehlt sich zunächst ein kleiner Traffic-Anteil. Erst wenn Qualität, Kosten und Latenz stabil sind, sollte der Anteil steigen.

Fazit: Upgrade-Kandidat, nicht Blindwechsel

Für Engineering-, Agent- und Vision-Workflows ist Claude Opus 4.7 ein sehr naheliegender Upgrade-Kandidat. Die Verbesserungen liegen genau dort, und der öffentliche Preisvergleich macht Tests leichter planbar.[8][

9] Für allgemeine Chat- und Content-Aufgaben ist 4.7 nicht uninteressant, aber die derzeit öffentlich belegten Vorteile reichen nicht aus, um eine sofortige Vollmigration allein wegen der Versionsnummer zu rechtfertigen.[

3][

6]

Die beste Entscheidung ist daher pragmatisch: Opus 4.7 gegen die eigenen Opus-4.6-Aufgaben laufen lassen, Erfolg, Formatstabilität, Kosten und Latenz messen – und erst danach entscheiden, ob aus dem Test ein Rollout wird.