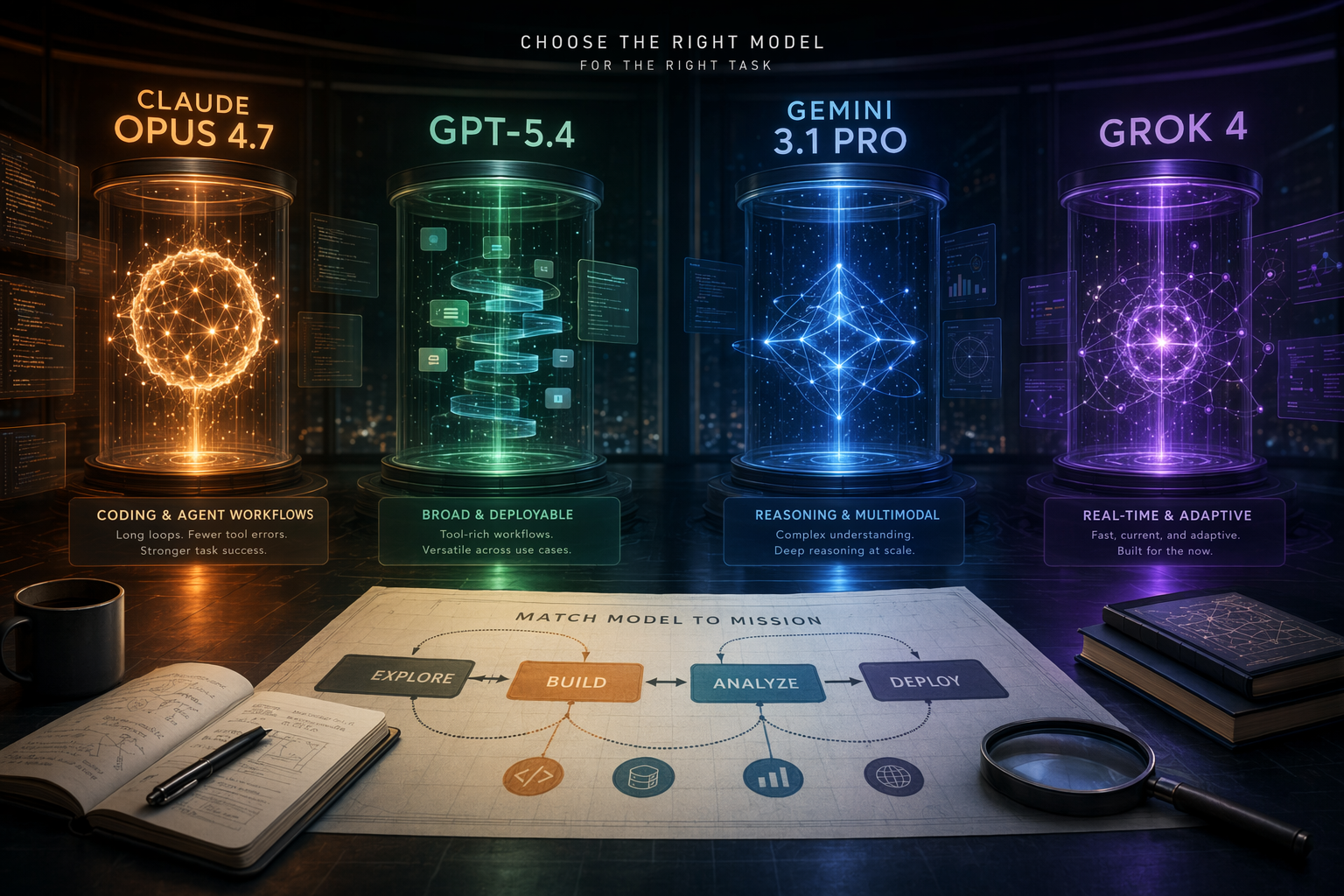

عند وضع Claude Opus 4.7 وGPT-5.4 وGemini 3.1 Pro وGrok 4 في مقارنة واحدة، لا تبدأ بالسؤال: من الأقوى مطلقًا؟ السؤال العملي أكثر تواضعًا: أين يمكن أن تفشل مهمتك؟ فدليل طرف ثالث لاختيار نماذج اللغة الكبيرة يخلص إلى أنه لا يوجد نموذج واحد يهيمن على كل المهام؛ لكل نموذج نقاط قوة مختلفة في البرمجة، والاستدلال المنظّم، والوسائط المتعددة، والأسئلة العلمية أو اختبارات الاستدلال الصعبة.[5]

الاختيار السريع حسب نوع المهمة

| إذا كانت مهمتك الأساسية | ابدأ الاختبار بـ | ما الذي يدعم ذلك؟ | ما التحفّظ؟ |

|---|---|---|---|

| برمجة معقّدة، سير عمل وكلاء الذكاء الاصطناعي، واستدعاء أدوات بثبات | Claude Opus 4.7 | تقول Anthropic إن Opus 4.7 حقق، مقارنةً بـ Opus 4.6، زيادة من 10% إلى 15% في نجاح مهام Factory Droids، مع أخطاء أقل في الأدوات وموثوقية أعلى؛ كما وصفه Axios بأنه ترقية مهمة في البرمجة والرؤية.[ | هذه الأدلة تثبت أساسًا تحسّن Opus 4.7 على Opus 4.6، ولا تكفي وحدها لإعلان فوزه في مواجهة مباشرة مع النماذج الأخرى.[ |

| إجراءات صارمة، تفكير منظّم، استخدام الحاسوب أو تنفيذ خطوات عبر أدوات | GPT-5.4 | يذكر دليل الاختيار أن GPT-5.4 بارز في structured reasoning وcomputer use، ويورد نتيجة OSWorld عند 75%.[ | لا بد من اختباره داخل أدواتك ومعايير الخطأ الخاصة بفريقك. |

| صور، مخططات، لقطات شاشة، أسئلة علمية أو بحثية | Gemini 3.1 Pro | يضع الدليل Gemini 3.1 Pro في المقدمة في abstract reasoning، ومدخلات الوسائط المتعددة، والمعايير العلمية، مع GPQA عند 94.3%.[ | التفوق في الوسائط المتعددة أو العلوم لا يعني تلقائيًا أنه الأفضل في وكلاء البرمجة أو سير العمل الطويل. |

| اختبارات الاستدلال عالية الصعوبة | Grok 4 | يقول الدليل إن Grok 4 يتصدر مؤشر HLE بنتيجة 50.7%.[ | مؤشر واحد صعب لا يكفي للحكم على جودة العمل اليومي أو البرمجة أو استخدام الأدوات. |

| تنويع المورّدين، خفض الكلفة، أو استكشاف بدائل مفتوحة | MiniMax M2.5/M2.7 وGLM-5/5.1 وKimi K2.5 | يذكر الدليل أن هذه النماذج الجديدة باتت تقترب من النماذج المغلقة المتقدمة في مهام من نوع SWE-bench.[ | الاقتراب في SWE-bench لا يعني بالضرورة اقترابًا في الاستقرار، أو الوسائط المتعددة، أو الأمان، أو تكاملات المنتج. |

Claude Opus 4.7: قوته الأوضح في البرمجة وموثوقية الأدوات

أبرز إشارة منشورة حول Claude Opus 4.7 تأتي من Anthropic نفسها: تقول الشركة إن النموذج يتفوق على Opus 4.6 بزيادة من 10% إلى 15% في نجاح مهام Factory Droids، مع أخطاء أقل في الأدوات وأداء أكثر موثوقية.[11]

هذا يجعله مرشحًا طبيعيًا في الجولة الأولى إذا كان عملك يدور حول البرمجة، أو إصلاح الأخطاء، أو تشغيل وكيل ذكاء اصطناعي يتعامل مع ملفات وأدوات وخطوات متعددة. في هذا النوع من العمل، لا يكون الفشل دائمًا إجابة خاطئة في سؤال واحد؛ قد يكون استدعاء أداة في غير محلها، أو تعديل الملف الخطأ، أو فقدان السياق، أو الحاجة إلى تدخل بشري متكرر.

كما وصف Axios إصدار Opus 4.7 بأنه ترقية ذات معنى لنموذج Anthropic الرائد، مع تحسينات في البرمجة والرؤية.[12] لكن القراءة الأكثر أمانًا لهذه المعطيات هي: Opus 4.7 تحسّن بوضوح على Opus 4.6. أما القول إنه يتفوق دائمًا على GPT-5.4 أو Gemini 3.1 Pro أو Grok 4، فالأدلة المتاحة هنا لا تكفي لإثباته.[

11][

5]

GPT-5.4: عندما تكون المشكلة في ترتيب الخطوات

إذا كان عملك يشبه تنفيذ قواعد صارمة، أو ملء جداول، أو تشغيل أدوات، أو اتخاذ قرارات متعددة المراحل وفق شروط واضحة، فضع GPT-5.4 في قائمة الاختبار الأولى. يذكر دليل اختيار نماذج اللغة الكبيرة أن GPT-5.4 يتميز في structured reasoning وcomputer use، ويورد نتيجة OSWorld عند 75%.[5]

هذا لا يعني أنه يتفوق على Opus 4.7 في كل شيء. لكنه يعني أن حالات الفشل المرتبطة بالخطوات، وترتيب العمليات، والتحكم في المسار، تستحق مقارنة مباشرة بين GPT-5.4 وOpus 4.7 داخل بيئتك الفعلية.[5]

Gemini 3.1 Pro: للوسائط المتعددة والعلوم والبحث

إذا كانت مدخلاتك تشمل صورًا، أو رسومًا بيانية، أو لقطات شاشة، أو أوراقًا علمية، أو أسئلة بحثية، فـ Gemini 3.1 Pro يستحق مكانًا متقدمًا في المقارنة. الدليل نفسه يذكر أنه متقدم في abstract reasoning، ومدخلات الوسائط المتعددة، والمعايير العلمية، ويورد GPQA عند 94.3%.[5]

النقطة هنا ليست اسم الشركة، بل طبيعة المهمة. إذا كان العمل اليومي يعتمد كثيرًا على الرؤية، أو تحليل وثائق مصوّرة، أو محتوى علمي، فقد يكون الاعتماد على اختبارات البرمجة وحدها طريقة مضللة لاختيار النموذج.[5]

Grok 4: قوي في مؤشر صعب، لكن لا تعمّم بسرعة

Grok 4 يستحق الانتباه إذا كان اهتمامك منصبًا على اختبارات الاستدلال عالية الصعوبة. يذكر دليل الاختيار أن Grok 4 يتصدر HLE بنتيجة 50.7%.[5]

لكن نتيجة HLE لا ينبغي أن تتحول وحدها إلى حكم شامل على العمل التجاري اليومي، أو جودة المحتوى، أو وكلاء البرمجة، أو استخدام الأدوات. وتذكّر مقالة أخرى عن تصنيفات النماذج بأن الاختبارات المعيارية مفيدة، لكن تجربة البناء اليومية تتأثر كثيرًا بعوامل مثل الموثوقية، وقدرات واجهة الاستخدام، وما إذا كانت الكلفة تسمح بالتجربة والتكرار دون تردد.[6]

لماذا لا يكفي جدول الترتيب؟

أولًا، الجداول قد تجمع اختبارات ومصادر بتواريخ مختلفة. فمقارنة Failing Fast لنماذج البرمجة تذكر مصادر بيانات تشمل SWE-bench في فبراير/شباط 2026، وAider في أكتوبر/تشرين الأول 2025، وArena Code في فبراير/شباط 2026.[2] هذا مفيد لإعطاء اتجاه عام، لكنه ليس بالضرورة ترتيبًا حاسمًا لكل النماذج في اليوم نفسه وبالشروط نفسها.

ثانيًا، المقارنة الرسمية داخل الشركة ليست مثل المقارنة عبر الشركات. بيانات Anthropic عن Opus 4.7 تدعم تحديدًا أنه أفضل من Opus 4.6 في مؤشرات ذكرتها الشركة؛ أما دليل الطرف الثالث فيعطي إشارات مفيدة عبر نماذج مختلفة، لكنه ليس تقييمًا رسميًا مشتركًا صادرًا عن OpenAI وGoogle وxAI وAnthropic بالشروط نفسها.[11][

5]

ثالثًا، ما يحدث في المنتج الحقيقي لا يظهر كله في معيار واحد. فالموثوقية، وسهولة الواجهة، والكلفة، وحدود الأدوات، وسياسات البيانات، كلها قد تغيّر القرار حتى عندما تبدو أرقام الاختبار جذابة.[6]

قائمة اختبار قبل الشراء أو الاعتماد

قبل أن تعتمد نموذجًا لفريق كامل، لا تسأل فقط: أي نموذج هو الأقوى؟ جرّب بدلًا من ذلك مقارنة صغيرة ومنضبطة:

- اختر من 5 إلى 10 مهام حقيقية تتكرر في عملك: إصلاح خطأ، إضافة ميزة، إعادة هيكلة كود، قراءة وثيقة طويلة، تحليل صورة، كتابة مواصفة، أو استدعاء أداة.

- استخدم المطالبات نفسها، والملفات نفسها، ومعايير القبول نفسها مع كل نموذج.

- سجّل نسبة النجاح من المحاولة الأولى، وعدد مرات إعادة العمل، وأخطاء الأدوات، والهلوسة، وزمن الاستجابة، والكلفة، ووقت التصحيح البشري.

- لا تنظر إلى أفضل إجابة فقط؛ افحص أسوأ إجابة أيضًا، لأن نمط الفشل أهم من العرض المبهر عند التشغيل الفعلي.

- إذا كانت البيانات حساسة أو خاضعة لمتطلبات امتثال، افحص سياسات الاحتفاظ بالبيانات، وخيارات النشر، وضوابط المؤسسات قبل القرار.

الحكم المختصر

Claude Opus 4.7 مرشح قوي جدًا للبرمجة، وسير عمل الوكلاء، والاستخدام الموثوق للأدوات. تقول Anthropic إنه حسّن نجاح مهام Factory Droids وقلّل أخطاء الأدوات مقارنةً بـ Opus 4.6، كما وصف Axios الإصدار بأنه ترقية في البرمجة والرؤية.[11][

12]

لكن إذا كان السؤال هو: من الفائز المطلق في كل شيء؟ فالإجابة الأدق هي أن الأدلة لا تكفي. الخلاصة العملية من دليل الاختيار الخارجي هي أن نموذجًا واحدًا لا يهيمن على كل المهام؛ GPT-5.4 وGemini 3.1 Pro وGrok 4، بل وحتى نماذج ناشئة أخرى، لكل منها نقاط قوة مختلفة.[5]

لذلك، ابدأ بـ Claude Opus 4.7 إذا كان قلب عملك هو البرمجة والوكلاء، لكن قارنه على مهامك الواقعية مع GPT-5.4 وGemini 3.1 Pro وGrok 4 قبل أن تحسم القرار.