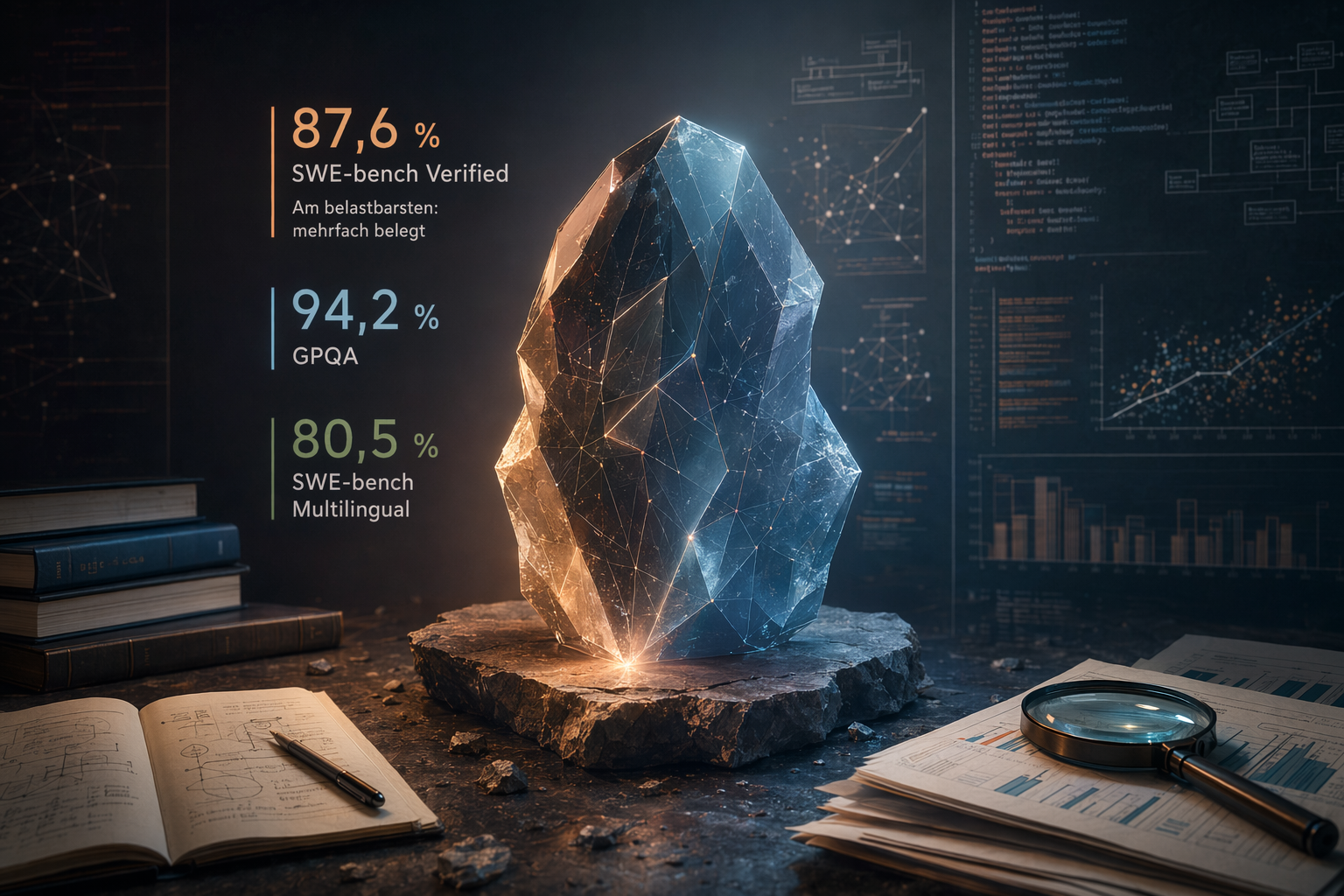

إذا كنت تفاضل بين نماذج الذكاء الاصطناعي لأعمال البرمجة أو الوكلاء الذكيين، فالأرقام وحدها قد تبدو مغرية. لكن في حالة Claude Opus 4.7، الصورة الأدق هي أن هناك ثلاثة أرقام عامة بارزة: 87.6٪ على SWE-bench Verified، و94.2٪ على GPQA، و80.5٪ على SWE-bench Multilingual. الرقم الأكثر صلابة في المصادر المتاحة هو نتيجة SWE-bench Verified، لأنه مذكور بوضوح في أكثر من مصدر. [4][

5]

الأرقام الأساسية في لمحة

| الاختبار | النتيجة المنشورة لـ Claude Opus 4.7 | كيف نقرأها؟ |

|---|---|---|

| SWE-bench Verified | 87.6٪ | أقوى مؤشر عام لأداء البرمجة في هذه الحزمة من المصادر؛ الرقم مذكور في أكثر من موضع. [ |

| GPQA | 94.2٪ | مذكور بوضوح لدى LLM-Stats، لكنه غير ظاهر كجدول Benchmark كامل في مقتطف المصدر الرسمي المتاح هنا. [ |

| SWE-bench Multilingual | 80.5٪ | رقم مهم لمن يهتم ببيئات برمجية متعددة اللغات، لكنه وارد في مصدر أقل اتساعاً من SWE-bench Verified. [ |

هذه قراءة محافظة للأرقام: لا تفترض أكثر مما تقوله المصادر المتاحة. لذلك تصلح كنقطة بداية للمقارنة، لا كبديل عن اختبار النموذج على مستودعاتك وأدواتك وسيناريوهاتك الفعلية.

لماذا نتيجة SWE-bench Verified هي الأهم هنا؟

نتيجة 87.6٪ على SWE-bench Verified هي الرقم الأكثر رسوخاً لـ Claude Opus 4.7 في المصادر المتاحة. فهي مذكورة في مقال يتناول الانتقال إلى النموذج واختباراته، كما تظهر أيضاً في LLM-Stats بالقيمة نفسها. [4][

5]

ويضيف LLM-Stats أن هذه النتيجة تمثل تحسناً قدره 6.8 نقطة مئوية مقارنة بـ Opus 4.6. [5] كما تصف ALM Corp النموذج بأنه أقوى في مهام البرمجة الصعبة وسير العمل القائم على الوكلاء. [

6]

بالنسبة إلى فرق الهندسة البرمجية، هذا يعني أن SWE-bench Verified هو أفضل مرساة عامة للبدء منها. لكنه لا يجيب وحده عن الأسئلة العملية: هل يفهم النموذج بنية مشروعك؟ هل يتعامل جيداً مع أدوات الاختبار والنشر؟ وهل يلتزم بمعايير قبول التغييرات داخل فريقك؟

GPQA: إشارة قوية، لكنها أقل تثبيتاً في هذه المصادر

نتيجة 94.2٪ على GPQA واردة بوضوح في LLM-Stats. [5] أما صفحة Anthropic الرسمية فهي مهمة كمصدر أولي، لكن المقتطف المتاح هنا يثبت تحديداً أن المطورين يستطيعون استخدام

claude-opus-4-7 عبر Claude API، ولا يعرض ضمن المعلومات المتاحة جدول Benchmarks كاملاً يمكن الاستشهاد به للرقم نفسه. [7]

لذلك من الأفضل قراءة GPQA كإشارة إضافية مفيدة، لا كالدليل الأوحد. إذا كان هذا الاختبار جزءاً أساسياً من قرار شراء أو ترحيل، فالأفضل الرجوع إلى المادة الأولية الكاملة أو تشغيل اختبارات داخلية موازية. [5][

7]

SWE-bench Multilingual: مهم للفرق متعددة اللغات، لكن بحذر

لمن يعملون على قواعد كود بلغات أو بيئات متعددة، تبدو نتيجة 80.5٪ على SWE-bench Multilingual لافتة. أحد المصادر يذكر هذا الرقم ويقارنه بنتيجة 77.8٪ لـ Opus 4.6. [9]

لكن نقطة الحذر هنا ضرورية: هذا الرقم لا يظهر في المصادر المتاحة بالاتساع نفسه الذي تظهر به نتيجة SWE-bench Verified. لذا يمكن اعتباره مؤشراً مفيداً للفرق الدولية أو المشاريع التي تجمع بين لغات وأطر عمل متعددة، لا حكماً نهائياً على الأداء في كل بيئة.

ما الذي لا تقوله جداول Benchmarks؟

Claude Opus 4.7 لا يُقدَّم فقط من خلال نتائجه الرقمية. فقد وصفت VentureBeat إطلاقه بأنه أقوى نموذج لغوي كبير متاح علناً من Anthropic حتى الآن. [1] وتصف ALM Corp النموذج بأنه إصدار Opus متاح عموماً وموجه لمهام متقدمة في البرمجة، والوكلاء، والمستندات، والرؤية. [

6]

في الاستخدام الفعلي، قد تكون بعض خصائص المنتج مؤثرة بقدر الاختبارات، وربما أكثر:

- نافذة السياق: يذكر LLM-Stats نافذة سياق بحجم مليون توكن. [

5]

- الرؤية: يذكر LLM-Stats معالجة رؤية أعلى دقة بمقدار 3.3 مرة. [

5]

- مستوى الجهد: يذكر LLM-Stats وALM Corp مستوى جهد جديداً باسم

xhigh. [5][

6]

- الـ tokenizer: تشير ALM Corp إلى tokenizer محدّث قد يؤدي إلى زيادة عدد التوكنات للمدخل نفسه. [

6]

هذه التفاصيل قد تغيّر التكلفة، وزمن الاستجابة، وجودة النتائج في الإنتاج. وبالأخص، يجب اختبار أي تغيير في الـ tokenizer قبل الترحيل، لأنه قد يغيّر حسابات الاستهلاك والميزانية حتى لو بقيت المدخلات كما هي. [6]

كيف تستخدم هذه الأرقام عملياً؟

لمهام البرمجة: ابدأ من SWE-bench Verified كنقطة مقارنة عامة. نتيجة 87.6٪ هي الرقم الأفضل توثيقاً في المصادر المتاحة. [4][

5]

لسير عمل الوكلاء الذكيين: لا تنظر إلى SWE-bench وحده؛ خذ في الحسبان أيضاً تموضع النموذج في مهام البرمجة والوكلاء الصعبة، إضافة إلى مستوى xhigh. [5][

6]

للاستدلال العام: GPQA مهم، لكن نتيجة 94.2٪ أقل اتساعاً في التوثيق هنا مقارنة بنتيجة SWE-bench Verified. [5][

7]

لقواعد الكود متعددة اللغات: نتيجة 80.5٪ على SWE-bench Multilingual تستحق الانتباه، لكنها تحتاج إلى تحقق إضافي بسبب محدودية ظهورها في المصادر المتاحة. [9]

للترحيل إلى الإنتاج: لا تختبر مهاماً شبيهة بالـ Benchmarks فقط. اختبر طول السياق، استخدام الأدوات، حالات الرؤية، استهلاك التوكنات، وزمن الاستجابة تحت ضغط واقعي. التغييرات المتعلقة بنافذة السياق، والرؤية، ومستوى الجهد، والـ tokenizer قد تكون حاسمة في الاستخدام اليومي. [5][

6]

الخلاصة

أقصر قراءة موثوقة هي أن Claude Opus 4.7 يظهر في المصادر العامة بهذه الأرقام: 87.6٪ على SWE-bench Verified، و94.2٪ على GPQA، و80.5٪ على SWE-bench Multilingual. [4][

5][

9] أقوى هذه الأرقام من حيث التوثيق هو SWE-bench Verified لأنه مذكور في أكثر من مصدر. [

4][

5]

أما GPQA وSWE-bench Multilingual فهما إشارتان مفيدتان، لكنهما أقل رسوخاً في هذه المجموعة من المصادر. لذلك، استخدم Benchmarks كمرحلة فرز أولى، ثم احسم القرار باختباراتك أنت على مهام حقيقية.