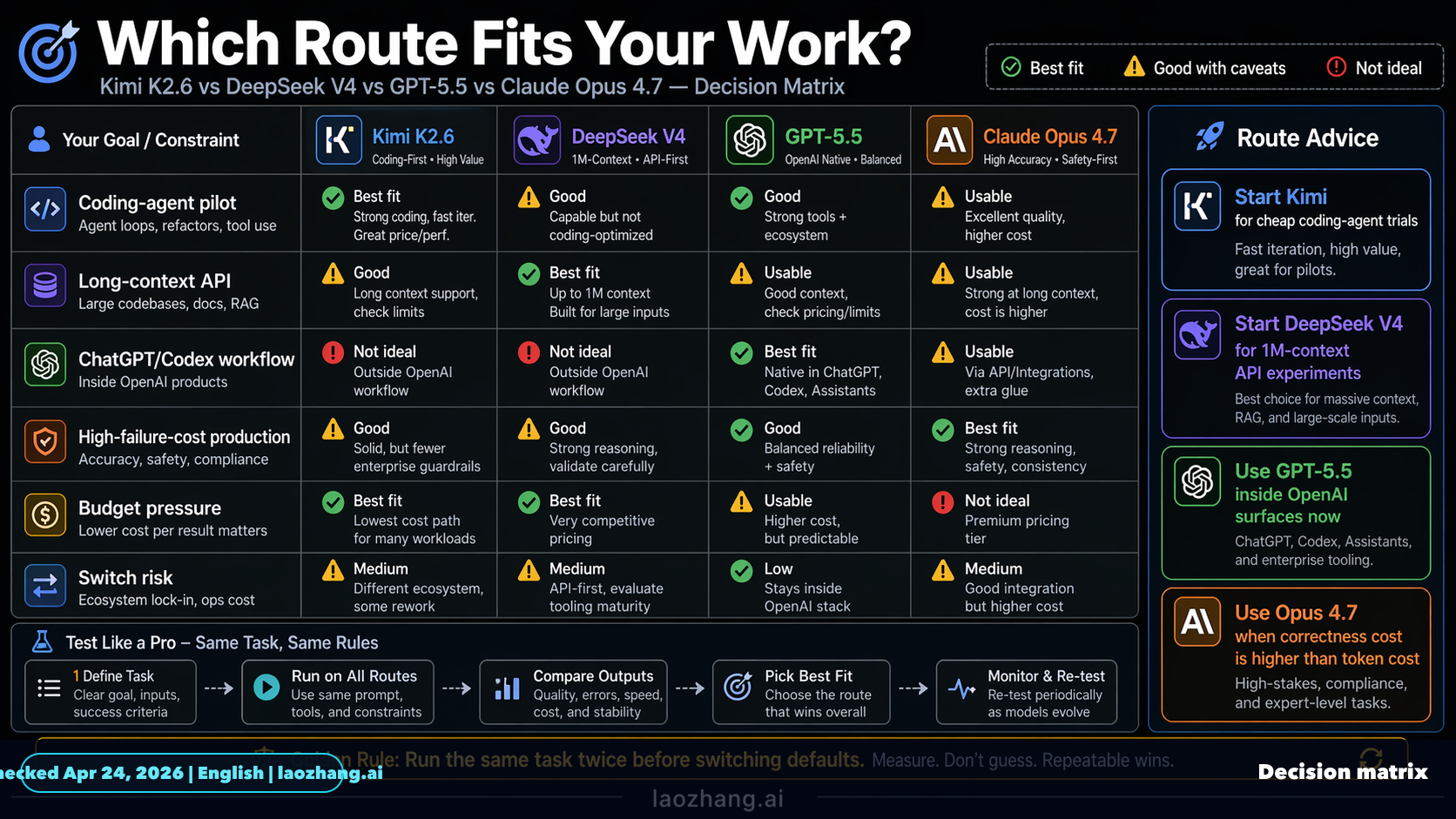

研究 Claude Opus 4.7、GPT-5.5、DeepSeek V4、Kimi K2.6 嘅基準測試,並盡可能全面咁作出比較。

用你提供嘅證據,未能嚴格完成 Claude Opus 4.7、GPT 5.5、DeepSeek V4、Kimi K2.6「同版本、同設定、同基準」嘅全面 benchmark 對比。現有資料對 DeepSeek V4 同 Kimi K2.6 有少量量化分數,但 Claude Opus 4.7 同 GPT 5.5 主要只有定價、上下文長度或定性描述;所以整體結論係:Insufficient evidence. Key findings...

用你提供嘅證據,未能嚴格完成 Claude Opus 4.7、GPT 5.5、DeepSeek V4、Kimi K2.6「同版本、同設定、同基準」嘅全面 benchmark 對比。現有資料對 DeepSeek V4 同 Kimi K2.6 有少量量化分數,但 Claude Opus 4.7 同 GPT 5.5 主要只有定價、上下文長度或定性描述;所以整體結論係:Insufficient evidence. Key findings Claude Opus 4.7 被描述為 Anthropic 最新 Opus 系列模型,重點係提升進階軟件工程、複雜問題解決、困難 coding challenge 同長流程工作表現,但提供證據入面冇可核

重點

- 用你提供嘅證據,未能嚴格完成 Claude Opus 4.7、GPT-5.5、DeepSeek V4、Kimi K2.6「同版本、同設定、同基準」嘅全面 benchmark 對比。現有資料對 DeepSeek V4 同 Kimi K2.6 有少量量化分數,但 Claude Opus 4.7 同 GPT-5.5 主要只有定價、上下文長度或定性描述;所以整體結論係:Insufficient evidence. ## Key findings - Claude Opus 4.7 被描述為 Anthropic 最新 Opus 系列模型,重點係提升進階軟件工程、複雜問題解決、困難 coding chal

- Claude Opus 4.7 被描述為 Anthropic 最新 Opus 系列模型,重點係提升進階軟件工程、複雜問題解決、困難 coding challenge 同長流程工作表現,但提供證據入面冇可核實 benchmark 分數。

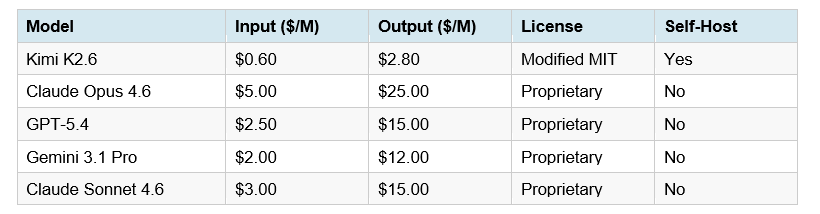

- GPT-5.5 喺現有證據入面主要有價格同上下文資料:每 100 萬 input tokens $5、每 100 萬 output tokens $30、1 million context window;但冇提供可用嚟同 DeepSeek V4、Kimi K2.6、Claude Opus 4.7 直接比較嘅 benchmark 分數。

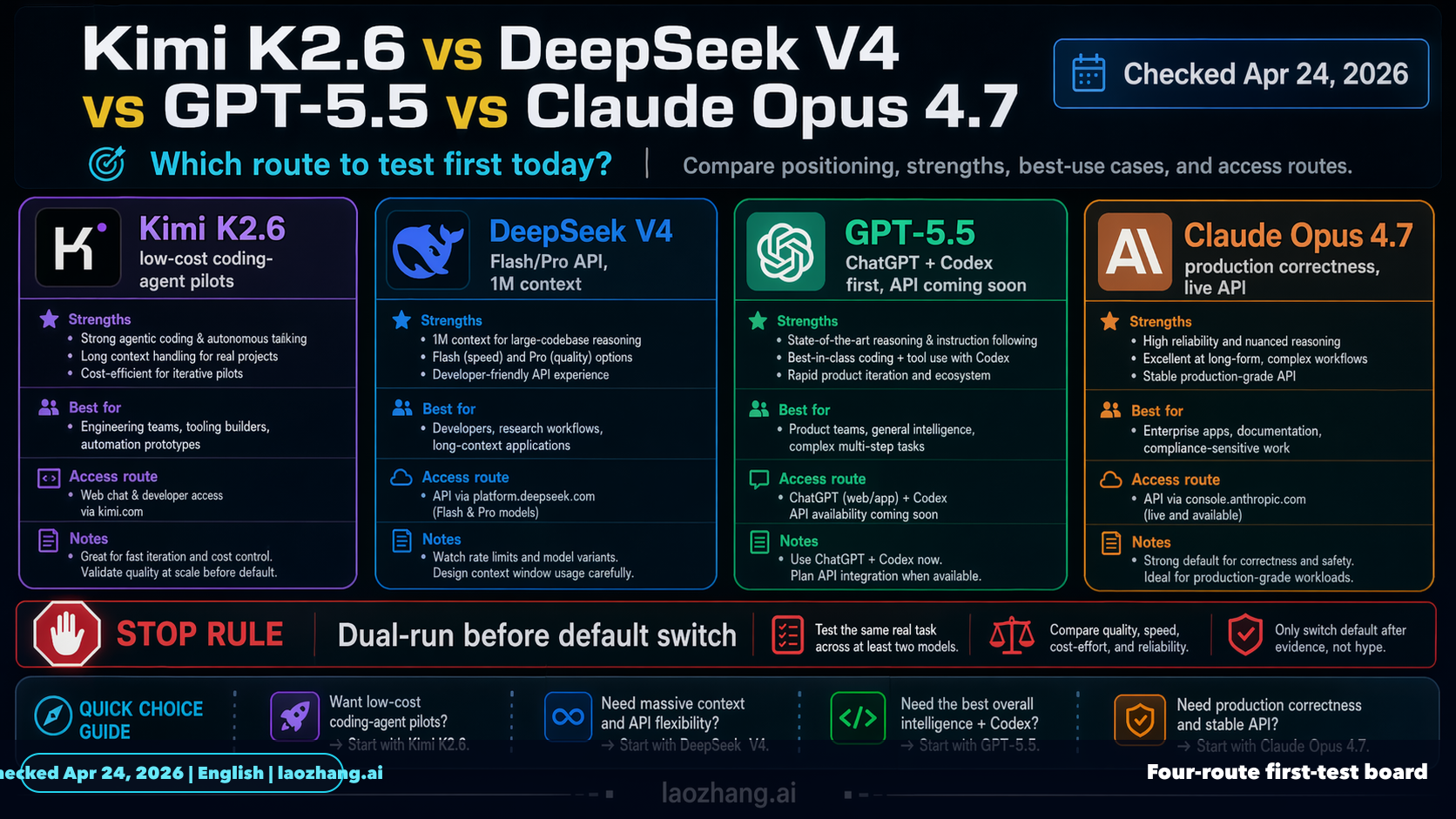

- Claude Opus 4.7 嘅價格資料為每 100 萬 input tokens $5、每 100 萬 output tokens $25、1 million context window;但證據入面冇同場 benchmark 數字。

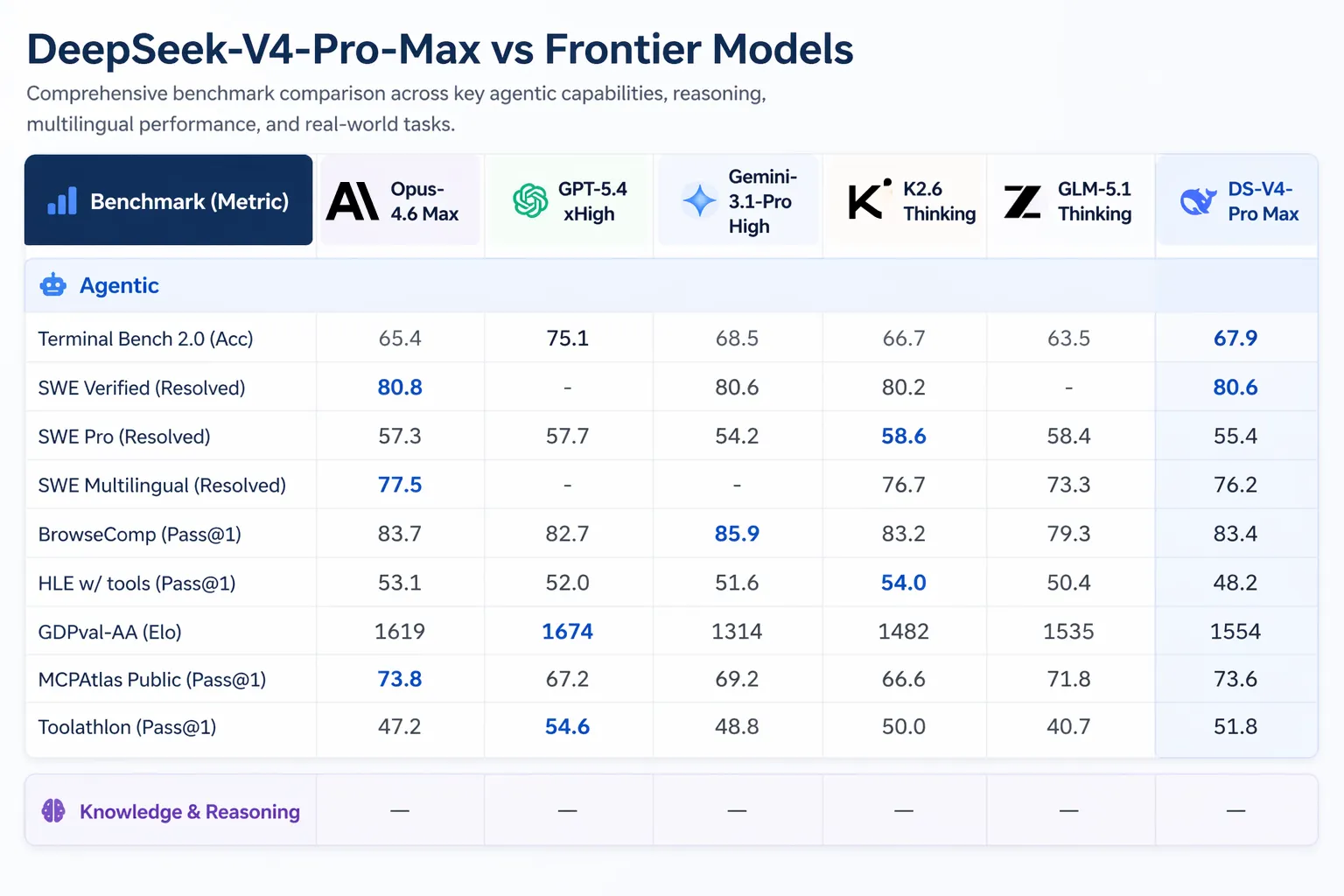

- DeepSeek V4-Pro 有最具體嘅模型規格資料:Pro 版係 MoE 架構,總參數 1.6 trillion、active parameters 49 billion、下載大小 865GB;Flash 版總參數 284 billion、active parameters 13 billion、下載大小 160GB。

- 用你提供嘅證據,未能嚴格完成 Claude Opus 4.7、GPT-5.5、DeepSeek V4、Kimi K2.6「同版本、同設定、同基準」嘅全面 benchmark 對比。現有資料對 DeepSeek V4 同 Kimi K2.6 有少量量化分數,但 Claude Opus 4.7 同 GPT-5.5 主要只有定價、上下文長度或定性描述;所以整體結論係:Insufficient evidence.

- ## Key findings

研究答案

用你提供嘅證據,未能嚴格完成 Claude Opus 4.7、GPT-5.5、DeepSeek V4、Kimi K2.6「同版本、同設定、同基準」嘅全面 benchmark 對比。現有資料對 DeepSeek V4 同 Kimi K2.6 有少量量化分數,但 Claude Opus 4.7 同 GPT-5.5 主要只有定價、上下文長度或定性描述;所以整體結論係:Insufficient evidence.

Key findings

-

Claude Opus 4.7 被描述為 Anthropic 最新 Opus 系列模型,重點係提升進階軟件工程、複雜問題解決、困難 coding challenge 同長流程工作表現,但提供證據入面冇可核實 benchmark 分數。[

1]

-

GPT-5.5 喺現有證據入面主要有價格同上下文資料:每 100 萬 input tokens $5、每 100 萬 output tokens $30、1 million context window;但冇提供可用嚟同 DeepSeek V4、Kimi K2.6、Claude Opus 4.7 直接比較嘅 benchmark 分數。[

4]

-

Claude Opus 4.7 嘅價格資料為每 100 萬 input tokens $5、每 100 萬 output tokens $25、1 million context window;但證據入面冇同場 benchmark 數字。[

4]

-

DeepSeek V4-Pro 有最具體嘅模型規格資料:Pro 版係 MoE 架構,總參數 1.6 trillion、active parameters 49 billion、下載大小 865GB;Flash 版總參數 284 billion、active parameters 13 billion、下載大小 160GB。[

7]

-

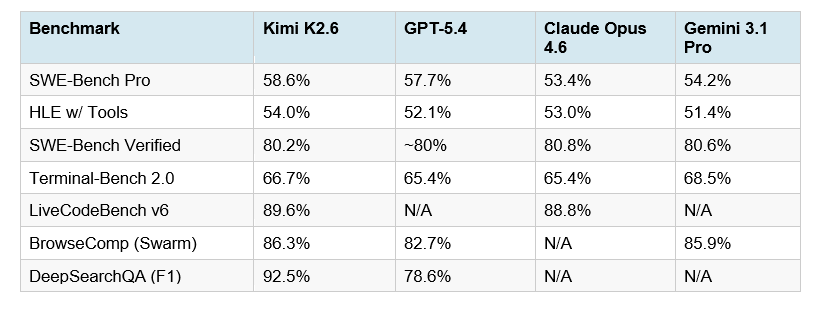

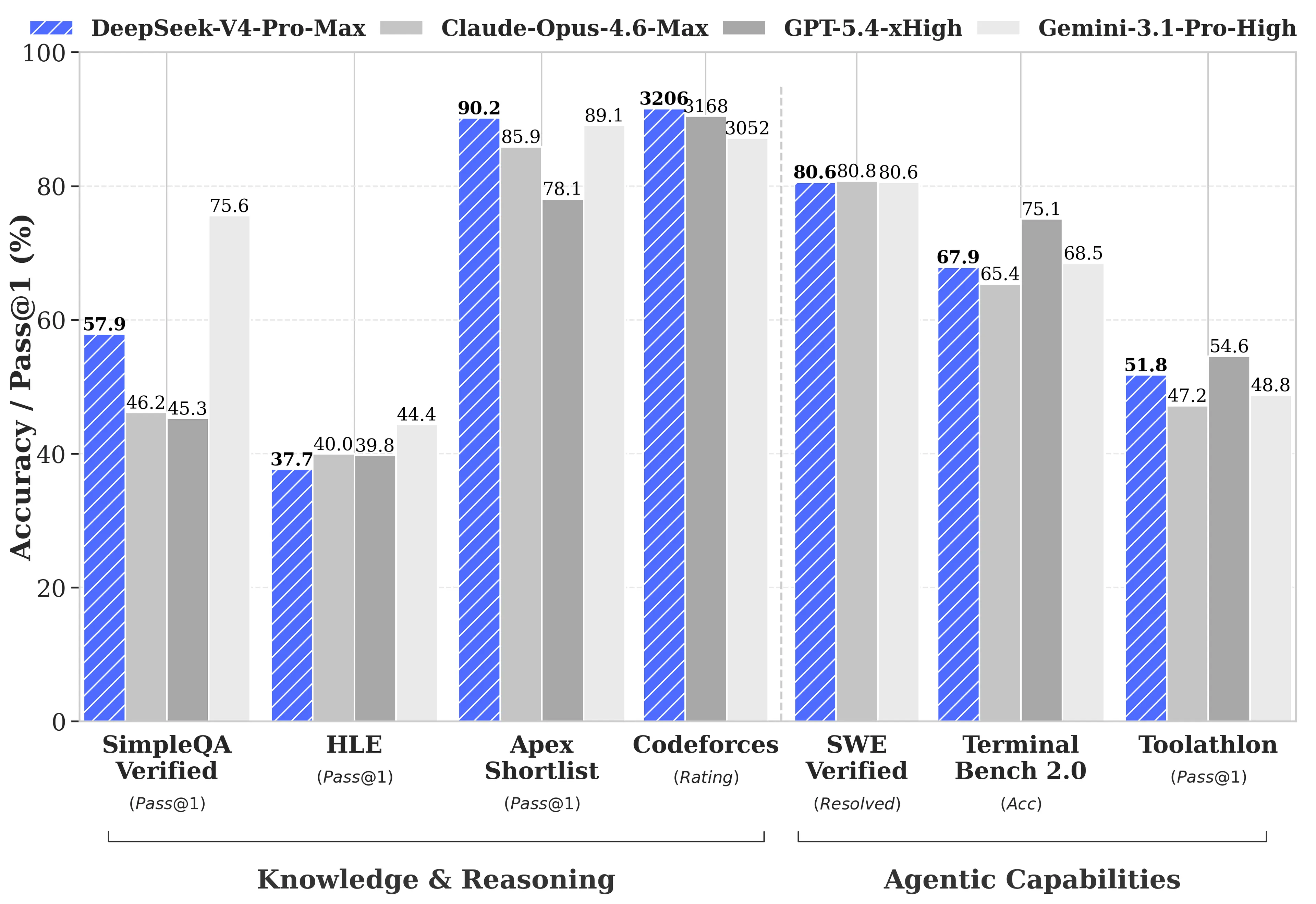

DeepSeek Hugging Face model card 提供咗部分 knowledge / reasoning benchmark:喺 MMLU-Pro,DS-V4-Pro Max 得 87.5,K2.6 Thinking 得 87.1;但同一表格比較嘅係 Opus-4.6 Max 同 GPT-5.4 xHigh,唔係 Claude Opus 4.7 同 GPT-5.5。[

8]

-

喺 SimpleQA-Verified,DS-V4-Pro Max 得 57.9,K2.6 Thinking 得 36.9;同一表格入面 Opus-4.6 Max 係 46.2、GPT-5.4 xHigh 係 45.3、Gemini-3.1-Pro High 係 75.6,但呢啲唔等於 Claude Opus 4.7 / GPT-5.5 嘅成績。[

8]

-

一個次級報道聲稱 DeepSeek V4-Pro 喺 Codeforces 得分 3,206,約等於人類參賽者第 23 名左右;同一來源亦聲稱 DeepSeek V4-Pro 喺 Apex Shortlist 達 90.2%,高過 Opus 4.6 嘅 85.9%。[

2]

-

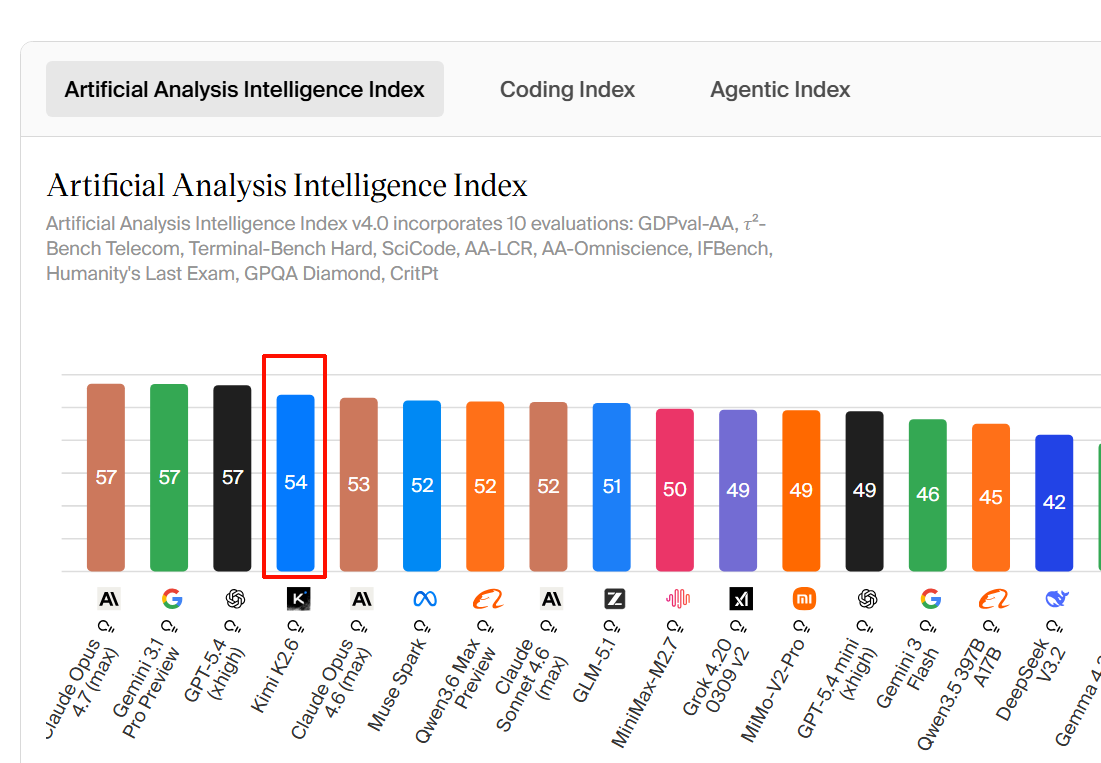

Artificial Analysis 有一個 DeepSeek V4 Pro Reasoning Max Effort vs GPT-5.5 low 嘅比較頁,並列出 Intelligence Index v4.0 包含 GDPval-AA、Terminal-Bench Hard、SciCode、Humanity’s Last Exam、GPQA Diamond 等項目;但你提供嘅證據片段冇實際分數,所以不能用嚟判斷 GPT-5.5 贏定 DeepSeek V4-Pro 贏。[

5]

Benchmark comparison from available evidence

| 項目 | Claude Opus 4.7 | GPT-5.5 | DeepSeek V4 / V4-Pro | Kimi K2.6 |

|---|---|---|---|---|

| MMLU-Pro | 無 Opus 4.7 分數;只見 Opus 4.6 Max 89.1 | 無 GPT-5.5 分數;只見 GPT-5.4 xHigh 87.5 | DS-V4-Pro Max 87.5 | K2.6 Thinking 87.1 |

| SimpleQA-Verified | 無 Opus 4.7 分數;只見 Opus 4.6 Max 46.2 | 無 GPT-5.5 分數;只見 GPT-5.4 xHigh 45.3 | DS-V4-Pro Max 57.9 | K2.6 Thinking 36.9 |

| Codeforces | 無資料 | 無資料 | V4-Pro 3,206;約人類參賽者第 23 名 | 無資料 |

| Apex Shortlist | 無 Opus 4.7 分數;只見 Opus 4.6 85.9 | 片段不足,不能確認 | V4-Pro 90.2% | 無資料 |

| 價格 | $5 / 1M input,$25 / 1M output | $5 / 1M input,$30 / 1M output | 證據不足 | 證據不足 |

| Context window | 1 million | 1 million | 證據不足 | 證據不足 |

以上表格中,MMLU-Pro 同 SimpleQA-Verified 只可以嚴格比較 DeepSeek V4-Pro Max 同 Kimi K2.6 Thinking;Opus 同 GPT 欄位因為係 Opus 4.6 / GPT-5.4,而唔係用戶指定嘅 Opus 4.7 / GPT-5.5,所以只可作參考,不可當成正式同版本比較。[8]

Model-by-model assessment

Claude Opus 4.7

-

現有證據將 Claude Opus 4.7 描述為面向高階 software engineering、complex problem-solving、difficult coding challenges 同 long-running workflows 嘅升級模型。[

1]

-

但提供資料冇 SWE-bench、Aider、Terminal-Bench、GPQA、MMLU-Pro、Humanity’s Last Exam 或其他可核實數字,所以無法判定佢相對 GPT-5.5、DeepSeek V4 或 Kimi K2.6 嘅實際 benchmark 排名。[

1]

-

價格方面,Claude Opus 4.7 係 $5 / 1M input tokens、$25 / 1M output tokens,並列出 1 million context window。[

4]

GPT-5.5

-

現有證據顯示 GPT-5.5 價格係 $5 / 1M input tokens、$30 / 1M output tokens,並列出 1 million context window。[

4]

-

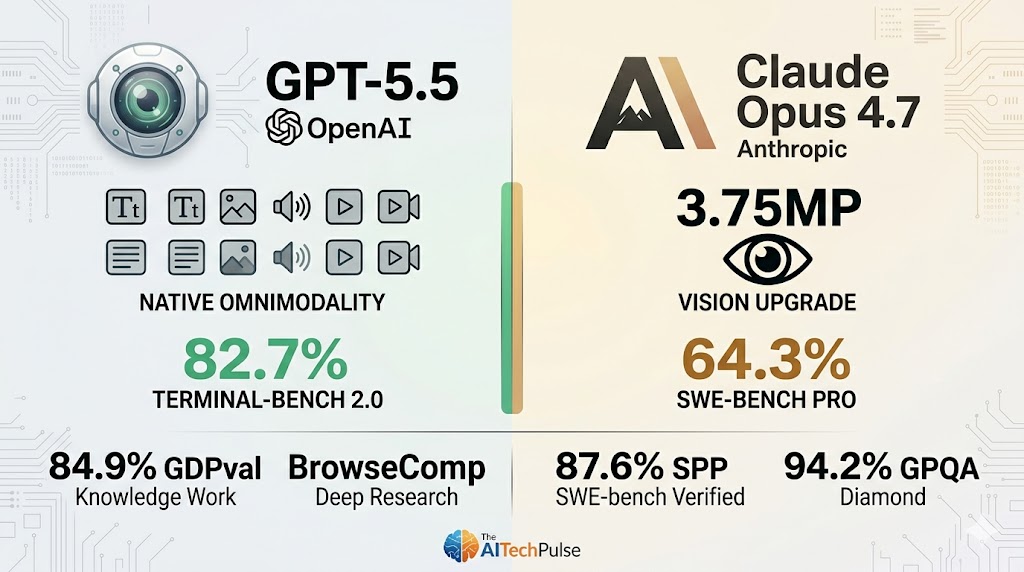

另一個來源描述 GPT-5.5 係 natively omnimodal model,並具備 computer use capabilities;但呢個來源冇提供可直接比較嘅 benchmark 分數。[

6]

-

Artificial Analysis 比較頁涵蓋 DeepSeek V4 Pro vs GPT-5.5 low,並列出多個 benchmark 組件,但提供證據片段冇實際成績,所以不能得出 GPT-5.5 喺該比較中嘅勝負。[

5]

DeepSeek V4 / V4-Pro

-

DeepSeek V4-Pro 係現有證據入面量化資料最多嘅模型:Pro 版採用 MoE,總參數 1.6T、active 49B、下載大小 865GB;Flash 版總參數 284B、active 13B、下載大小 160GB。[

7]

-

喺 Hugging Face model card 表格,DS-V4-Pro Max 喺 MMLU-Pro 得 87.5,略高於 K2.6 Thinking 嘅 87.1,但低於 Opus-4.6 Max 嘅 89.1 同 Gemini-3.1-Pro High 嘅 91.0。[

8]

-

喺 SimpleQA-Verified,DS-V4-Pro Max 得 57.9,高過 K2.6 Thinking 36.9、Opus-4.6 Max 46.2 同 GPT-5.4 xHigh 45.3,但低過 Gemini-3.1-Pro High 75.6。[

8]

-

一個次級報道聲稱 V4-Pro 喺 Codeforces 得 3,206,約等於人類參賽者第 23 名左右;呢個係有用但需要獨立驗證嘅 competitive programming 指標。[

2]

-

同一報道稱 V4-Pro 喺 Apex Shortlist 得 90.2%,高過 Opus 4.6 嘅 85.9%;但該證據唔係官方 benchmark 報告,而且片段未完整列出 GPT 或 Kimi 對應值。[

2]

Kimi K2.6

-

Kimi K2.6 喺現有證據入面主要出現喺 DeepSeek Hugging Face benchmark 表格,版本標示為 K2.6 Thinking。[

8]

-

喺 MMLU-Pro,K2.6 Thinking 得 87.1,略低於 DS-V4-Pro Max 87.5。[

8]

-

喺 SimpleQA-Verified,K2.6 Thinking 得 36.9,低於 DS-V4-Pro Max 57.9、Opus-4.6 Max 46.2 同 GPT-5.4 xHigh 45.3。[

8]

-

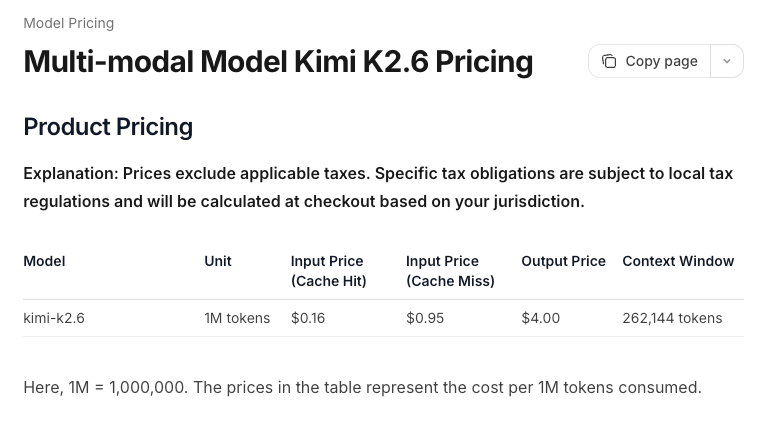

現有證據冇提供 Kimi K2.6 嘅價格、context window、coding benchmark、agent benchmark 或數學 benchmark,因此不能全面評估佢相對另外三個模型嘅整體能力。

Evidence notes

-

最有量化價值嘅證據係 DeepSeek Hugging Face model card,因為佢提供咗 MMLU-Pro 同 SimpleQA-Verified 分數;但佢比較嘅係 DS-V4-Pro Max、K2.6 Thinking、Opus-4.6 Max、GPT-5.4 xHigh 等,唔係完整覆蓋 Claude Opus 4.7 同 GPT-5.5。[

8]

-

Artificial Analysis 來源有潛在價值,因為佢列出一組較全面嘅 Intelligence Index v4.0 benchmarks;但現有片段只見 benchmark 名稱,冇分數,所以不能用嚟作量化結論。[

5]

-

SourceForge 對 Claude Opus 4.7 只提供產品描述式資訊,說明其針對 software engineering、complex problem-solving、long-running workflows 有提升,但缺少 benchmark 數字。[

1]

-

Yahoo / Mashable 片段提供 GPT-5.5 同 Claude Opus 4.7 價格及 context window,但唔提供 benchmark 結果。[

4]

-

Cryptonews 來源提供 DeepSeek V4-Pro 嘅 Codeforces 同 Apex Shortlist 數字,但屬次級報道,可靠性弱過官方 model card 或獨立 benchmark 平台。[

2]

Limitations / uncertainty

-

Insufficient evidence:現有資料不足以對 Claude Opus 4.7、GPT-5.5、DeepSeek V4、Kimi K2.6 做嚴格、全面、同版本、同設定嘅 benchmark 排名。

-

最大問題係版本唔一致:可見量化表格比較咗 Opus-4.6 Max 同 GPT-5.4 xHigh,而用戶問題要求嘅係 Claude Opus 4.7 同 GPT-5.5。[

8]

-

第二個問題係 benchmark 覆蓋唔平均:DeepSeek V4-Pro 同 Kimi K2.6 有少量 knowledge / QA 分數,但 Claude Opus 4.7 同 GPT-5.5 缺少同場分數。[

8]

-

第三個問題係來源可靠性參差:Hugging Face model card 有分數但可能屬模型發布方資料;Artificial Analysis 片段有方法但冇分數;新聞 / blog 類來源提供部分資訊但需要更高權威來源驗證。[

2][

5][

8]

Summary

-

如果只睇現有量化證據,DeepSeek V4-Pro Max 喺 SimpleQA-Verified 明顯高過 Kimi K2.6 Thinking,喺 MMLU-Pro 亦略高過 Kimi K2.6 Thinking。[

8]

-

但 DeepSeek V4-Pro Max 對 Claude Opus 4.7 同 GPT-5.5 嘅直接勝負無法判定,因為可見表格只列 Opus-4.6 Max 同 GPT-5.4 xHigh,而唔係指定版本。[

8]

-

Claude Opus 4.7 目前只可確認其定位係強化 software engineering、complex problem-solving 同 long-running workflows;GPT-5.5 目前只可確認價格、1 million context window,以及一個來源聲稱佢係 natively omnimodal model with computer use capabilities。[

1][

4][

6]

-

最穩妥結論係:DeepSeek V4-Pro 喺你提供嘅證據中有最多可比較數據;Kimi K2.6 有少量可比較數據;Claude Opus 4.7 同 GPT-5.5 缺少足夠 benchmark 數字,所以不能公平排名。

支持視覺效果

研究對話

研究問題

研究 Claude Opus 4.7、GPT-5.5、DeepSeek V4、Kimi K2.6 嘅基準測試,並盡可能全面咁作出比較。

引用的答案

用你提供嘅證據,未能嚴格完成 Claude Opus 4.7、GPT-5.5、DeepSeek V4、Kimi K2.6「同版本、同設定、同基準」嘅全面 benchmark 對比。現有資料對 DeepSeek V4 同 Kimi K2.6 有少量量化分數,但 Claude Opus 4.7 同 GPT-5.5 主要只有定價、上下文長度或定性描述;所以整體結論係:Insufficient evidence.

Key findings

-

Claude Opus 4.7 被描述為 Anthropic 最新 Opus 系列模型,重點係提升進階軟件工程、複雜問題解決、困難 coding challenge 同長流程工作表現,但提供證據入面冇可核實 benchmark 分數。[

1]

-

GPT-5.5 喺現有證據入面主要有價格同上下文資料:每 100 萬 input tokens $5、每 100 萬 output tokens $30、1 million context window;但冇提供可用嚟同 DeepSeek V4、Kimi K2.6、Claude Opus 4.7 直接比較嘅 benchmark 分數。[

4]

-

Claude Opus 4.7 嘅價格資料為每 100 萬 input tokens $5、每 100 萬 output tokens $25、1 million context window;但證據入面冇同場 benchmark 數字。[

4]

-

DeepSeek V4-Pro 有最具體嘅模型規格資料:Pro 版係 MoE 架構,總參數 1.6 trillion、active parameters 49 billion、下載大小 865GB;Flash 版總參數 284 billion、active parameters 13 billion、下載大小 160GB。[

7]

-

DeepSeek Hugging Face model card 提供咗部分 knowledge / reasoning benchmark:喺 MMLU-Pro,DS-V4-Pro Max 得 87.5,K2.6 Thinking 得 87.1;但同一表格比較嘅係 Opus-4.6 Max 同 GPT-5.4 xHigh,唔係 Claude Opus 4.7 同 GPT-5.5。[

8]

-

喺 SimpleQA-Verified,DS-V4-Pro Max 得 57.9,K2.6 Thinking 得 36.9;同一表格入面 Opus-4.6 Max 係 46.2、GPT-5.4 xHigh 係 45.3、Gemini-3.1-Pro High 係 75.6,但呢啲唔等於 Claude Opus 4.7 / GPT-5.5 嘅成績。[

8]

-

一個次級報道聲稱 DeepSeek V4-Pro 喺 Codeforces 得分 3,206,約等於人類參賽者第 23 名左右;同一來源亦聲稱 DeepSeek V4-Pro 喺 Apex Shortlist 達 90.2%,高過 Opus 4.6 嘅 85.9%。[

2]

-

Artificial Analysis 有一個 DeepSeek V4 Pro Reasoning Max Effort vs GPT-5.5 low 嘅比較頁,並列出 Intelligence Index v4.0 包含 GDPval-AA、Terminal-Bench Hard、SciCode、Humanity’s Last Exam、GPQA Diamond 等項目;但你提供嘅證據片段冇實際分數,所以不能用嚟判斷 GPT-5.5 贏定 DeepSeek V4-Pro 贏。[

5]

Benchmark comparison from available evidence

| 項目 | Claude Opus 4.7 | GPT-5.5 | DeepSeek V4 / V4-Pro | Kimi K2.6 |

|---|---|---|---|---|

| MMLU-Pro | 無 Opus 4.7 分數;只見 Opus 4.6 Max 89.1 | 無 GPT-5.5 分數;只見 GPT-5.4 xHigh 87.5 | DS-V4-Pro Max 87.5 | K2.6 Thinking 87.1 |

| SimpleQA-Verified | 無 Opus 4.7 分數;只見 Opus 4.6 Max 46.2 | 無 GPT-5.5 分數;只見 GPT-5.4 xHigh 45.3 | DS-V4-Pro Max 57.9 | K2.6 Thinking 36.9 |

| Codeforces | 無資料 | 無資料 | V4-Pro 3,206;約人類參賽者第 23 名 | 無資料 |

| Apex Shortlist | 無 Opus 4.7 分數;只見 Opus 4.6 85.9 | 片段不足,不能確認 | V4-Pro 90.2% | 無資料 |

| 價格 | $5 / 1M input,$25 / 1M output | $5 / 1M input,$30 / 1M output | 證據不足 | 證據不足 |

| Context window | 1 million | 1 million | 證據不足 | 證據不足 |

以上表格中,MMLU-Pro 同 SimpleQA-Verified 只可以嚴格比較 DeepSeek V4-Pro Max 同 Kimi K2.6 Thinking;Opus 同 GPT 欄位因為係 Opus 4.6 / GPT-5.4,而唔係用戶指定嘅 Opus 4.7 / GPT-5.5,所以只可作參考,不可當成正式同版本比較。[8]

Model-by-model assessment

Claude Opus 4.7

-

現有證據將 Claude Opus 4.7 描述為面向高階 software engineering、complex problem-solving、difficult coding challenges 同 long-running workflows 嘅升級模型。[

1]

-

但提供資料冇 SWE-bench、Aider、Terminal-Bench、GPQA、MMLU-Pro、Humanity’s Last Exam 或其他可核實數字,所以無法判定佢相對 GPT-5.5、DeepSeek V4 或 Kimi K2.6 嘅實際 benchmark 排名。[

1]

-

價格方面,Claude Opus 4.7 係 $5 / 1M input tokens、$25 / 1M output tokens,並列出 1 million context window。[

4]

GPT-5.5

-

現有證據顯示 GPT-5.5 價格係 $5 / 1M input tokens、$30 / 1M output tokens,並列出 1 million context window。[

4]

-

另一個來源描述 GPT-5.5 係 natively omnimodal model,並具備 computer use capabilities;但呢個來源冇提供可直接比較嘅 benchmark 分數。[

6]

-

Artificial Analysis 比較頁涵蓋 DeepSeek V4 Pro vs GPT-5.5 low,並列出多個 benchmark 組件,但提供證據片段冇實際成績,所以不能得出 GPT-5.5 喺該比較中嘅勝負。[

5]

DeepSeek V4 / V4-Pro

-

DeepSeek V4-Pro 係現有證據入面量化資料最多嘅模型:Pro 版採用 MoE,總參數 1.6T、active 49B、下載大小 865GB;Flash 版總參數 284B、active 13B、下載大小 160GB。[

7]

-

喺 Hugging Face model card 表格,DS-V4-Pro Max 喺 MMLU-Pro 得 87.5,略高於 K2.6 Thinking 嘅 87.1,但低於 Opus-4.6 Max 嘅 89.1 同 Gemini-3.1-Pro High 嘅 91.0。[

8]

-

喺 SimpleQA-Verified,DS-V4-Pro Max 得 57.9,高過 K2.6 Thinking 36.9、Opus-4.6 Max 46.2 同 GPT-5.4 xHigh 45.3,但低過 Gemini-3.1-Pro High 75.6。[

8]

-

一個次級報道聲稱 V4-Pro 喺 Codeforces 得 3,206,約等於人類參賽者第 23 名左右;呢個係有用但需要獨立驗證嘅 competitive programming 指標。[

2]

-

同一報道稱 V4-Pro 喺 Apex Shortlist 得 90.2%,高過 Opus 4.6 嘅 85.9%;但該證據唔係官方 benchmark 報告,而且片段未完整列出 GPT 或 Kimi 對應值。[

2]

Kimi K2.6

-

Kimi K2.6 喺現有證據入面主要出現喺 DeepSeek Hugging Face benchmark 表格,版本標示為 K2.6 Thinking。[

8]

-

喺 MMLU-Pro,K2.6 Thinking 得 87.1,略低於 DS-V4-Pro Max 87.5。[

8]

-

喺 SimpleQA-Verified,K2.6 Thinking 得 36.9,低於 DS-V4-Pro Max 57.9、Opus-4.6 Max 46.2 同 GPT-5.4 xHigh 45.3。[

8]

-

現有證據冇提供 Kimi K2.6 嘅價格、context window、coding benchmark、agent benchmark 或數學 benchmark,因此不能全面評估佢相對另外三個模型嘅整體能力。

Evidence notes

-

最有量化價值嘅證據係 DeepSeek Hugging Face model card,因為佢提供咗 MMLU-Pro 同 SimpleQA-Verified 分數;但佢比較嘅係 DS-V4-Pro Max、K2.6 Thinking、Opus-4.6 Max、GPT-5.4 xHigh 等,唔係完整覆蓋 Claude Opus 4.7 同 GPT-5.5。[

8]

-

Artificial Analysis 來源有潛在價值,因為佢列出一組較全面嘅 Intelligence Index v4.0 benchmarks;但現有片段只見 benchmark 名稱,冇分數,所以不能用嚟作量化結論。[

5]

-

SourceForge 對 Claude Opus 4.7 只提供產品描述式資訊,說明其針對 software engineering、complex problem-solving、long-running workflows 有提升,但缺少 benchmark 數字。[

1]

-

Yahoo / Mashable 片段提供 GPT-5.5 同 Claude Opus 4.7 價格及 context window,但唔提供 benchmark 結果。[

4]

-

Cryptonews 來源提供 DeepSeek V4-Pro 嘅 Codeforces 同 Apex Shortlist 數字,但屬次級報道,可靠性弱過官方 model card 或獨立 benchmark 平台。[

2]

Limitations / uncertainty

-

Insufficient evidence:現有資料不足以對 Claude Opus 4.7、GPT-5.5、DeepSeek V4、Kimi K2.6 做嚴格、全面、同版本、同設定嘅 benchmark 排名。

-

最大問題係版本唔一致:可見量化表格比較咗 Opus-4.6 Max 同 GPT-5.4 xHigh,而用戶問題要求嘅係 Claude Opus 4.7 同 GPT-5.5。[

8]

-

第二個問題係 benchmark 覆蓋唔平均:DeepSeek V4-Pro 同 Kimi K2.6 有少量 knowledge / QA 分數,但 Claude Opus 4.7 同 GPT-5.5 缺少同場分數。[

8]

-

第三個問題係來源可靠性參差:Hugging Face model card 有分數但可能屬模型發布方資料;Artificial Analysis 片段有方法但冇分數;新聞 / blog 類來源提供部分資訊但需要更高權威來源驗證。[

2][

5][

8]

Summary

-

如果只睇現有量化證據,DeepSeek V4-Pro Max 喺 SimpleQA-Verified 明顯高過 Kimi K2.6 Thinking,喺 MMLU-Pro 亦略高過 Kimi K2.6 Thinking。[

8]

-

但 DeepSeek V4-Pro Max 對 Claude Opus 4.7 同 GPT-5.5 嘅直接勝負無法判定,因為可見表格只列 Opus-4.6 Max 同 GPT-5.4 xHigh,而唔係指定版本。[

8]

-

Claude Opus 4.7 目前只可確認其定位係強化 software engineering、complex problem-solving 同 long-running workflows;GPT-5.5 目前只可確認價格、1 million context window,以及一個來源聲稱佢係 natively omnimodal model with computer use capabilities。[

1][

4][

6]

-

最穩妥結論係:DeepSeek V4-Pro 喺你提供嘅證據中有最多可比較數據;Kimi K2.6 有少量可比較數據;Claude Opus 4.7 同 GPT-5.5 缺少足夠 benchmark 數字,所以不能公平排名。

人們還問

「研究 Claude Opus 4.7、GPT-5.5、DeepSeek V4、Kimi K2.6 嘅基準測試,並盡可能全面咁作出比較。」的簡短答案是什麼?

用你提供嘅證據,未能嚴格完成 Claude Opus 4.7、GPT-5.5、DeepSeek V4、Kimi K2.6「同版本、同設定、同基準」嘅全面 benchmark 對比。現有資料對 DeepSeek V4 同 Kimi K2.6 有少量量化分數,但 Claude Opus 4.7 同 GPT-5.5 主要只有定價、上下文長度或定性描述;所以整體結論係:Insufficient evidence. ## Key findings - Claude Opus 4.7 被描述為 Anthropic 最新 Opus 系列模型,重點係提升進階軟件工程、複雜問題解決、困難 coding chal

首先要驗證的關鍵點是什麼?

用你提供嘅證據,未能嚴格完成 Claude Opus 4.7、GPT-5.5、DeepSeek V4、Kimi K2.6「同版本、同設定、同基準」嘅全面 benchmark 對比。現有資料對 DeepSeek V4 同 Kimi K2.6 有少量量化分數,但 Claude Opus 4.7 同 GPT-5.5 主要只有定價、上下文長度或定性描述;所以整體結論係:Insufficient evidence. ## Key findings - Claude Opus 4.7 被描述為 Anthropic 最新 Opus 系列模型,重點係提升進階軟件工程、複雜問題解決、困難 coding chal Claude Opus 4.7 被描述為 Anthropic 最新 Opus 系列模型,重點係提升進階軟件工程、複雜問題解決、困難 coding challenge 同長流程工作表現,但提供證據入面冇可核實 benchmark 分數。

接下來在實務上我該做什麼?

GPT-5.5 喺現有證據入面主要有價格同上下文資料:每 100 萬 input tokens $5、每 100 萬 output tokens $30、1 million context window;但冇提供可用嚟同 DeepSeek V4、Kimi K2.6、Claude Opus 4.7 直接比較嘅 benchmark 分數。

接下來我應該探索哪個相關主題?

繼續“請閱讀 Claude Opus 4.7 同 GPT 5.5 嘅介紹: https://www.anthropic.com/news/claude-opus-4-7 https://openai.com/index/introducing-gpt-5-5 請再搜尋更多相關資料,並就”以獲得另一個角度和額外的引用。

開啟相關頁面我應該將其與什麼進行比較?

對照「資料搜集及事實核查:如果 GPT-5.5 Spud 真係推出,正式公布前有冇任何安全評估、紅隊測試或者對齊證據?」交叉檢查此答案。

開啟相關頁面繼續你的研究

來源

- [1] Claude Opus 4.7 vs. Kimi K2.6 Comparison - SourceForgesourceforge.net

About Claude Opus 4.7 is the latest Anthropic AI model release designed to significantly improve performance in advanced software engineering and complex problem-solving tasks. It builds upon the previous Opus 4.6 model by delivering stronger results on dif...

- [2] DeepSeek V4 is here: How it compares to ChatGPT, Claude, Geminimashable.com

Credit: Long Wei/VCG via Getty Images Anything you can do I can do better... That may as well be the motto for the AI arms race, which is unfolding across multiple dimensions in 2026. There's the competition between Silicon Valley AI labs like Anthropic, Op...

- [3] DeepSeek V4 vs Claude Opus 4.7 vs GPT-5.5: Benchmarks & Pricinglushbinary.com

1The April 2026 Frontier Landscape The AI model market has never been this competitive. Anthropic's ARR reportedly grew from $9B to $30B in early 2026. OpenAI shipped GPT-5.5 as a natively omnimodal model with computer use capabilities. And DeepSeek proved...

- [4] DeepSeek-V4 arrives with near state-of-the-art intelligence at 1/6th ...venturebeat.com

BenchmarkDeepSeek-V4-Pro-MaxGPT-5.5GPT-5.5 Pro, where shownClaude Opus 4.7Best result among these GPQA Diamond90.1%93.6%—94.2%Claude Opus 4.7 Humanity’s Last Exam, no tools37.7%41.4%43.1%46.9%Claude Opus 4.7 Humanity’s Last Exam, with tools48.2%52.2%57.2%54...

- [5] Kimi K2.6 vs Claude Opus 4.6 vs GPT-5.4 - Verdent AIverdent.ai

Verdent Features Pricing Latest research updates Product news and stories Guides, comparisons, and best practices Release notes and updates Docs Product documentation Community Discord Join our community X Follow us on X Reddit Join us on Reddit LIMITED-TIM...

- [6] Kimi K2.6 vs Claude Opus 4.7 (Adaptive Reasoning, Max Effort): Model Comparisonartificialanalysis.ai

Highlights Model Comparison Metric Kimi logoKimi K2.6 Anthropic logoClaude Opus 4.7 (Adaptive Reasoning, Max Effort) Analysis --- --- Creator Kimi Anthropic Context Window 256k tokens ( 384 A4 pages of size 12 Arial font) 1000k tokens ( 1500 A4 pages of siz...

- [7] Kimi K2.6 vs DeepSeek V4 vs GPT-5.5 vs Claude Opus 4.7blog.laozhang.ai

As of Apr 24, 2026, this comparison should be built around DeepSeek V4, not an older DeepSeek label. Test Kimi K2.6 first when the job is low-cost coding-agent exploration, test DeepSeek V4 Flash or V4 Pro when you need a cheap callable API route today, use...

- [8] [AINews] Moonshot Kimi K2.6: the world's leading Open Model ...latent.space

DeepSeek V4 rumors are back, and we learned our lesson not to get too excited, but in their deafening silence since v3.2, Moonshot has owned the crown of leading Chinese open model lab for all of 2026 to date, and K2.6 refreshes the lead that K2.5 establish...

- [9] DeepSeek V4 - Vals AIvals.ai

Benchmarks Models Comparison Model Guide App Reports News About Benchmarks Models Comparison Model Guide App Reports About Release date Models 4/23/2026 DeepSeek DeepSeek V4 4/23/2026 OpenAI GPT 5.5 4/20/2026 Moonshot AI Kimi K2.6 4/16/2026 Anthropic Claude...

- [10] Kimi K2.6 vs DeepSeek-V4 Pro - DocsBot AIdocsbot.ai

Benchmark Kimi K2.6 DeepSeek-V4 Pro --- AIME 2026 American Invitational Mathematics Examination 2026 - Evaluates advanced mathematical problem-solving abilities (contest-level math) 96.4% Thinking mode Source Not available APEX Agents Evaluates long-horizon...

- [11] Bad Opus 4.7, Good Kimi K2.6, and Growing Codexaicodingdaily.substack.com

AI Coding Daily Apr 22, 2026 1 Share Another week in AI Coding world, and the main topic on social media are rants on Anthropic. How bad is Opus 4.7, how ridiculous is the token usage, how they don’t clearly communicate pricing changes, etc. Meanwhile, Open...

- [12] DeepSeek V4 vs Claude vs GPT-5.4: A 38-Task Benchmark ... - FundaAIfundaai.substack.com

Sentiment Analysis (Opus 4.7 wins slightly): Opus delivered a 229-line report with 5-step attribution methodology, daily score tracking, and 3 named attribution chains. DeepSeek’s Pro produced strong attribution analysis with CEO interview data that Opus mi...

- [13] DeepSeek V4: Features, Benchmarks, and Comparisonsdatacamp.com

How large are the DeepSeek V4 models? DeepSeek uses a Mixture of Experts (MoE) architecture. The Pro model contains 1.6 trillion total parameters (49 billion active) and requires an 865GB download. The Flash model contains 284 billion parameters (13 billion...

- [14] Kimi K2.6 vs Claude Opus 4.7 - AI Model Comparisonopenrouter.ai

Quantization unknown Max Tokens (input + output)1M Max Output Tokens 128K Stream cancellation Supports Tools No Prompt Training Caching Artificial Analysis Claude Opus 4.7 (Adaptive Reasoning, Max Effort) Intelligence 57.3 100% Coding 52.5 99% Agentic 71.3...

- [15] Kimi K2.6 vs GPT-5.4 vs Claude Opus: Who Wins? (2026)buildfastwithai.com

For historical context: when I wrote the GPT-5.3 Codex vs Claude Opus vs Kimi comparison in February, Kimi K2.5 was sitting at 76.8% on SWE-Bench Verified and trailing the proprietary models on SWE-Bench Pro. K2.6 reversed that in three months. DeepSearchQA...

- [16] LLM Coding Benchmark (April 2026): GPT 5.5, DeepSeek v4, Kimi ...akitaonrails.com

Rank Model Score Tier RubyLLM OK Time Cost --- --- --- 1 Claude Opus 4.7 97 A ✅ 18m $1.10 1 GPT 5.4 xHigh (Codex) 97 A ✅ 22m $16 3 GPT 5.5 xHigh (Codex) 96 A ✅ 18m $10 4 Kimi K2.6 87 A ✅ 20m $0.30 5 Claude Opus 4.6 83 A ✅ 16m $1.10 6 Gemini 3.1 Pro 82 A ✅ 1...

- [17] The Coding Assistant Breakdown: More Tokens Please - SemiAnalysisnewsletter.semianalysis.com

On benchmarks, DeepSeek did not feel that standard benchmarks were good at capturing real-world task capability, so they introduced their own set of agentic benchmarks to measure how V4 compared against other SOTA models: Chinese writing, retrieval augmente...

- [18] AI Leaderboard 2026 - Compare Top AI Models & Rankingsllm-stats.com

6 Image 7: Anthropic Claude Opus 4.5 Anthropic 1,614 1,342 87.0% 80.9% 200K $5.00 $25.00 Proprietary 7 Image 8: Google Gemini 3 Pro Google 1,579 1,045 91.9% 76.2% — — — Proprietary 8 Image 9: Zhipu AI GLM-5 Zhipu AI 1,576 1,158 — 77.8% 200K $1.00 $3.20 Open...

- [19] DeepSeek V4 Is Here—Its Pro Version Costs 98% Less Than GPT ...cryptonews.net

Where V4-Pro-Max actually wins: Codeforces, competitive programming benchmark, rated like human chess. V4-Pro scored 3,206, placing it around 23rd among actual human contest participants. On Apex Shortlist, a curated set of hard math and STEM problems, it s...

- [20] DeepSeek V4 is here: How it compares to ChatGPT, Claude, Geminitech.yahoo.com

DeepSeek V4 is here: How it compares to ChatGPT, Claude, Gemini GPT-5.5 costs at $5 per 1 million input tokens and $30 per 1 million output tokens (1 million context window) Claude Opus 4.7costs at $5 per 1 million input tokens and $25 per 1 million output...

- [21] DeepSeek V4 Pro (Reasoning, Max Effort) vs GPT-5.5 (low): Model Comparisonartificialanalysis.ai

Artificial Analysis Intelligence Index Artificial Analysis Intelligence Index v4.0 includes: GDPval-AA, 𝜏²-Bench Telecom, Terminal-Bench Hard, SciCode, AA-LCR, AA-Omniscience, IFBench, Humanity's Last Exam, GPQA Diamond, CritPt. See Intelligence Index meth...

- [22] deepseek-ai/DeepSeek-V4-Pro - Hugging Facehuggingface.co

Opus-4.6 Max GPT-5.4 xHigh Gemini-3.1-Pro High K2.6 Thinking GLM-5.1 Thinking DS-V4-Pro Max :---: :---: :---: Knowledge & Reasoning MMLU-Pro (EM) 89.1 87.5 91.0 87.1 86.0 87.5 SimpleQA-Verified (Pass@1) 46.2 45.3 75.6 36.9 38.1 57.9 Chinese-SimpleQA (Pass@1...

- [23] DeepSeek-V4 Pro vs Claude Opus 4.7 - DocsBot AIdocsbot.ai

SimpleQA A benchmark that evaluates basic question-answering capabilities across common knowledge domains 57.9% Verified, Pass@1, Think Max Source Not available SWE-Bench Verified Evaluates software engineering capabilities through verified code modificatio...

- [24] DeepSeek-V4-Pro-Max: Pricing, Benchmarks & Performancellm-stats.com

SWE-Bench ProView → 11 of 11 Image 35: LLM Stats Logo SWE-Bench Pro is an advanced version of SWE-Bench that evaluates language models on complex, real-world software engineering tasks requiring extended reasoning and multi-step problem solving. More 1Image...

- [25] Model Drop: DeepSeek V4 - by Jake Handyhandyai.substack.com

+ V4-Pro Max: 80.6% + Opus 4.7: 87.6% + OpenAI didn’t report a GPT-5.5 number on this one Terminal-Bench 2.0 + V4-Pro Max: 67.9% + Opus 4.7: 69.4% + GPT-5.5: 82.7% GPQA Diamond + V4-Pro Max: 90.1% + Opus 4.7: 94.2% BrowseComp + V4-Pro Max: 83.4% + GPT-5.5:...