Tìm kiếm và kiểm chứng thông tin: Làm sao triển khai hoặc tích hợp Kimi K2.6 vào app / production workflow?

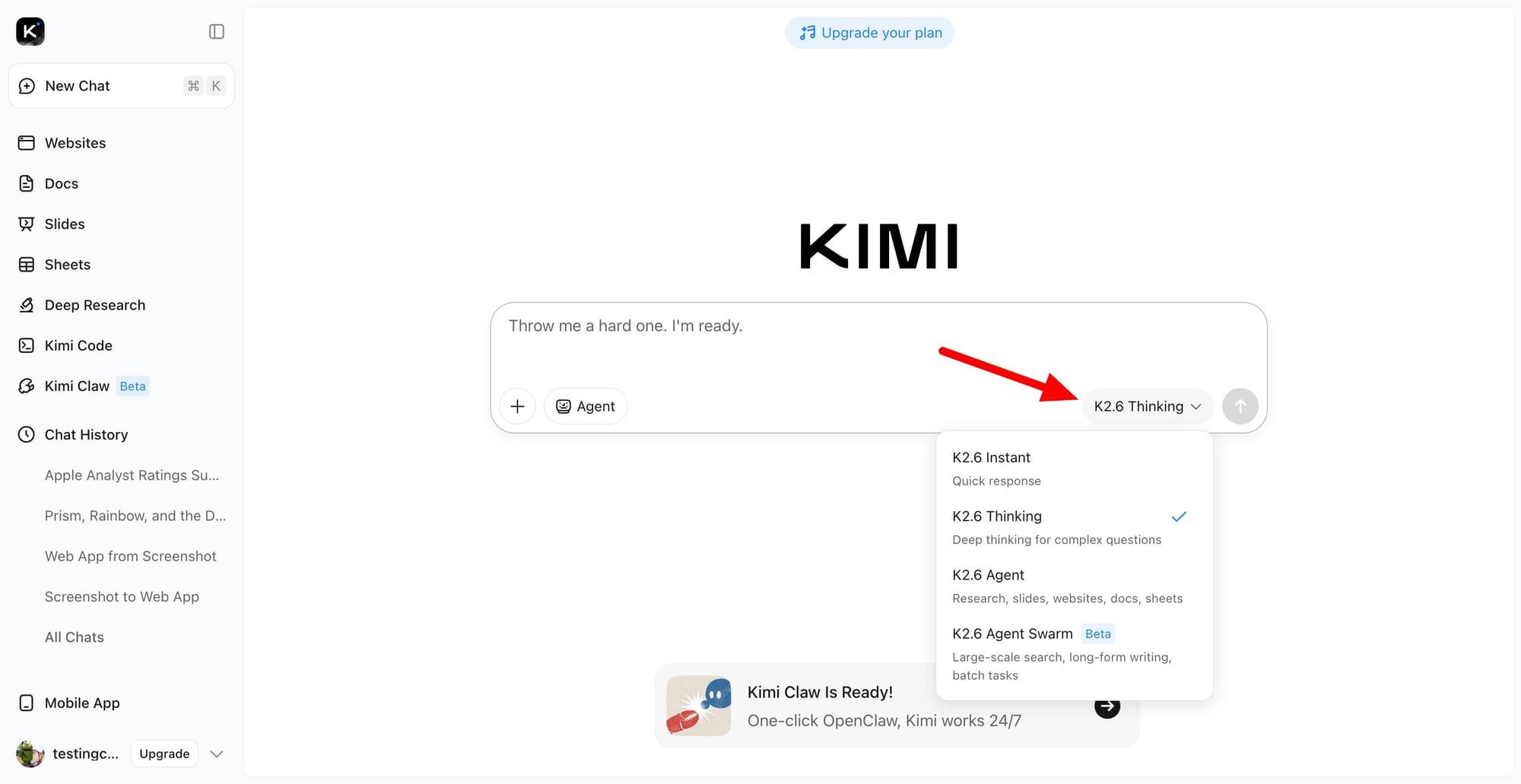

Hiện có 2 đường tích hợp đã được xác nhận trong bộ bằng chứng này: gọi Kimi K2.6 qua Kimi Open Platform bằng API tương thích OpenAI, hoặc dùng model @cf/moonshotai/kimi k2.6 trên Cloudflare AI. [1][3][8] Với app/produ...

Hiện có 2 đường tích hợp đã được xác nhận trong bộ bằng chứng này: gọi Kimi K2.6 qua Kimi Open Platform bằng API tương thích OpenAI, hoặc dùng model @cf/moonshotai/kimi k2.6 trên Cloudflare AI. [1][3][8] Với app/production workflow, hướng rõ ràng nhất là API chính thức vì Kimi xác nhận có OpenAI compatible HTTP APIs, d

Bài học chính

- Hiện có 2 đường tích hợp đã được xác nhận trong bộ bằng chứng này: gọi Kimi K2.6 qua Kimi Open Platform bằng API tương thích OpenAI, hoặc dùng model `@cf/moonshotai/kimi-k2.6` trên Cloudflare AI. [1][3][8] Với app/production workflow, hướng rõ ràng nhất là API chính thức vì Kimi

- ## Cách tích hợp phù hợp nhất cho app / production

Câu trả lời nghiên cứu

Hiện có 2 đường tích hợp đã được xác nhận trong bộ bằng chứng này: gọi Kimi K2.6 qua Kimi Open Platform bằng API tương thích OpenAI, hoặc dùng model @cf/moonshotai/kimi-k2.6 trên Cloudflare AI. [1][

3][

8] Với app/production workflow, hướng rõ ràng nhất là API chính thức vì Kimi xác nhận có OpenAI-compatible HTTP APIs, dùng được OpenAI SDK, và có quickstart riêng cho K2.6. [

3][

7][

8]

Cách tích hợp phù hợp nhất cho app / production

- Kimi Open Platform nói rõ API là OpenAI-compatible; khi dùng SDK,

base_urlcần đặt làhttps://api.moonshot.ai/v1. [3]

- Quickstart chính thức của Kimi K2 dùng

OpenAI(...), truyềnapi_key="$MOONSHOT_API_KEY", rồi gọiclient.chat.completions.create(...). [7]

- Tài liệu K2.6 có trang quickstart riêng với tiêu đề “Kimi K2.6 Multi-modal Model”, cho thấy K2.6 là model được hỗ trợ trực tiếp trên platform. [

8]

- Thực tế triển khai hợp lý là giữ nguyên lớp adapter theo chuẩn OpenAI trong app của bạn, rồi thay

base_url, API key, và model ID theo quickstart K2.6. [3][

7][

8]

Mẫu khung tích hợp tối thiểu có thể đi theo dạng này, vì quickstart chính thức dùng OpenAI SDK và chat.completions.create(...). [7]

from openai import OpenAI

client = OpenAI(

api_key="$MOONSHOT_API_KEY",

base_url="https://api.moonshot.ai/v1",

)

completion = client.chat.completions.create(

model="PUT_K2_6_MODEL_ID_HERE",

# ... payload theo quickstart K2.6

)Phương án thay thế: chạy qua Cloudflare

- Cloudflare Docs liệt kê model

@cf/moonshotai/kimi-k2.6. [1]

- Snippet của Cloudflare cho thấy interface của model này có ít nhất các trường cho prompt đầu vào, upper bound số token sinh ra, và requested output types. [

1]

- Nếu workflow của bạn đã bám vào hạ tầng Cloudflare, đây là một đường tích hợp thay thế đã được tài liệu hóa. [

1]

Các bước setup và vận hành nên có

- Hướng dẫn tích hợp của TypingMind mô tả 3 bước kết nối Moonshot API: tạo tài khoản Moonshot API, nạp số dư, và lấy API key. [

2]

- Từ góc độ vận hành, bạn nên kiểm soát budget token và kiểu output ở tầng ứng dụng, vì Cloudflare docs cho thấy các tham số này có mặt ở interface model. [

1]

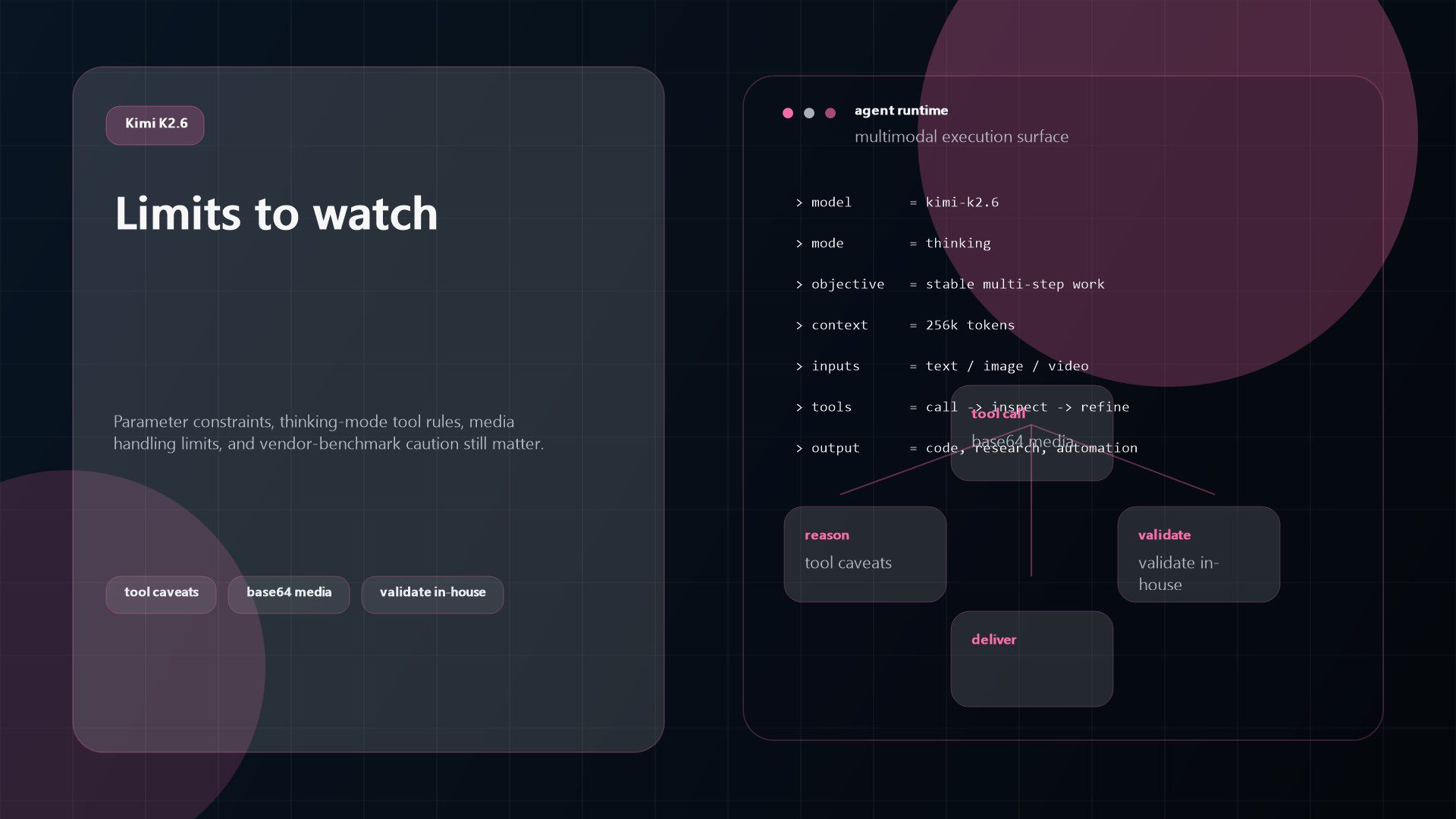

- Trang benchmark best practices của Kimi có các cấu hình eval cho bài toán dùng tools, trong đó có

thinking={"type":"enabled"}, token budget tới 64k hoặc 96k, và max steps khuyến nghị 30 hoặc 120 cho các benchmark cụ thể. [4]

- Các cấu hình benchmark này nên dùng cho pipeline đánh giá nội bộ trước khi bật agent production mặc định. [

4]

Chi phí và những gì chưa kiểm chứng được

- Trang giá hiện có trong bộ bằng chứng là “Generation Model Kimi K2 Pricing”, và trang này nói chi phí được tính theo mỗi 1M tokens. [

6]

- Từ bộ bằng chứng này, tôi chưa kiểm chứng được bảng giá riêng của Kimi K2.6. [

6][

8]

- Có file

docs/deploy_guidance.mdtrong repo Hugging Face củamoonshotai/Kimi-K2.6, nhưng snippet hiện có không đủ để xác nhận self-hosting, yêu cầu GPU, hoặc hướng dẫn triển khai on-prem cụ thể. [5]

- Vì vậy, nếu mục tiêu của bạn là tự host K2.6 thay vì gọi API/Cloudflare, hiện phải nói thẳng là bằng chứng chưa đủ. [

5]

Kết luận ngắn

- Nếu bạn muốn tích hợp nhanh vào app hiện có, hãy đi theo Kimi API chính thức với OpenAI SDK +

base_url="https://api.moonshot.ai/v1". [3][

7]

- Nếu bạn muốn gọi model qua hạ tầng Cloudflare,

@cf/moonshotai/kimi-k2.6là model đã được liệt kê công khai. [1]

- Nếu bạn cần self-host/on-prem, hiện chưa có đủ bằng chứng trong tập tài liệu này để xác nhận cách làm. [

5]

Nếu bạn muốn, tôi có thể viết tiếp cho bạn một bản checklist production ngắn cho Kimi K2.6 theo 3 phần: auth, adapter code, và eval/guardrails.

Hỗ trợ hình ảnh

Trao đổi nghiên cứu

Câu hỏi nghiên cứu

Tìm kiếm và kiểm chứng thông tin: Làm sao triển khai hoặc tích hợp Kimi K2.6 vào app / production workflow?

Câu trả lời được trích dẫn

Hiện có 2 đường tích hợp đã được xác nhận trong bộ bằng chứng này: gọi Kimi K2.6 qua Kimi Open Platform bằng API tương thích OpenAI, hoặc dùng model @cf/moonshotai/kimi-k2.6 trên Cloudflare AI. [1][

3][

8] Với app/production workflow, hướng rõ ràng nhất là API chính thức vì Kimi xác nhận có OpenAI-compatible HTTP APIs, dùng được OpenAI SDK, và có quickstart riêng cho K2.6. [

3][

7][

8]

Cách tích hợp phù hợp nhất cho app / production

- Kimi Open Platform nói rõ API là OpenAI-compatible; khi dùng SDK,

base_urlcần đặt làhttps://api.moonshot.ai/v1. [3]

- Quickstart chính thức của Kimi K2 dùng

OpenAI(...), truyềnapi_key="$MOONSHOT_API_KEY", rồi gọiclient.chat.completions.create(...). [7]

- Tài liệu K2.6 có trang quickstart riêng với tiêu đề “Kimi K2.6 Multi-modal Model”, cho thấy K2.6 là model được hỗ trợ trực tiếp trên platform. [

8]

- Thực tế triển khai hợp lý là giữ nguyên lớp adapter theo chuẩn OpenAI trong app của bạn, rồi thay

base_url, API key, và model ID theo quickstart K2.6. [3][

7][

8]

Mẫu khung tích hợp tối thiểu có thể đi theo dạng này, vì quickstart chính thức dùng OpenAI SDK và chat.completions.create(...). [7]

from openai import OpenAI

client = OpenAI(

api_key="$MOONSHOT_API_KEY",

base_url="https://api.moonshot.ai/v1",

)

completion = client.chat.completions.create(

model="PUT_K2_6_MODEL_ID_HERE",

# ... payload theo quickstart K2.6

)Phương án thay thế: chạy qua Cloudflare

- Cloudflare Docs liệt kê model

@cf/moonshotai/kimi-k2.6. [1]

- Snippet của Cloudflare cho thấy interface của model này có ít nhất các trường cho prompt đầu vào, upper bound số token sinh ra, và requested output types. [

1]

- Nếu workflow của bạn đã bám vào hạ tầng Cloudflare, đây là một đường tích hợp thay thế đã được tài liệu hóa. [

1]

Các bước setup và vận hành nên có

- Hướng dẫn tích hợp của TypingMind mô tả 3 bước kết nối Moonshot API: tạo tài khoản Moonshot API, nạp số dư, và lấy API key. [

2]

- Từ góc độ vận hành, bạn nên kiểm soát budget token và kiểu output ở tầng ứng dụng, vì Cloudflare docs cho thấy các tham số này có mặt ở interface model. [

1]

- Trang benchmark best practices của Kimi có các cấu hình eval cho bài toán dùng tools, trong đó có

thinking={"type":"enabled"}, token budget tới 64k hoặc 96k, và max steps khuyến nghị 30 hoặc 120 cho các benchmark cụ thể. [4]

- Các cấu hình benchmark này nên dùng cho pipeline đánh giá nội bộ trước khi bật agent production mặc định. [

4]

Chi phí và những gì chưa kiểm chứng được

- Trang giá hiện có trong bộ bằng chứng là “Generation Model Kimi K2 Pricing”, và trang này nói chi phí được tính theo mỗi 1M tokens. [

6]

- Từ bộ bằng chứng này, tôi chưa kiểm chứng được bảng giá riêng của Kimi K2.6. [

6][

8]

- Có file

docs/deploy_guidance.mdtrong repo Hugging Face củamoonshotai/Kimi-K2.6, nhưng snippet hiện có không đủ để xác nhận self-hosting, yêu cầu GPU, hoặc hướng dẫn triển khai on-prem cụ thể. [5]

- Vì vậy, nếu mục tiêu của bạn là tự host K2.6 thay vì gọi API/Cloudflare, hiện phải nói thẳng là bằng chứng chưa đủ. [

5]

Kết luận ngắn

- Nếu bạn muốn tích hợp nhanh vào app hiện có, hãy đi theo Kimi API chính thức với OpenAI SDK +

base_url="https://api.moonshot.ai/v1". [3][

7]

- Nếu bạn muốn gọi model qua hạ tầng Cloudflare,

@cf/moonshotai/kimi-k2.6là model đã được liệt kê công khai. [1]

- Nếu bạn cần self-host/on-prem, hiện chưa có đủ bằng chứng trong tập tài liệu này để xác nhận cách làm. [

5]

Nếu bạn muốn, tôi có thể viết tiếp cho bạn một bản checklist production ngắn cho Kimi K2.6 theo 3 phần: auth, adapter code, và eval/guardrails.

Người ta cũng hỏi

Câu trả lời ngắn gọn cho "Tìm kiếm và kiểm chứng thông tin: Làm sao triển khai hoặc tích hợp Kimi K2.6 vào app / production workflow?" là gì?

Hiện có 2 đường tích hợp đã được xác nhận trong bộ bằng chứng này: gọi Kimi K2.6 qua Kimi Open Platform bằng API tương thích OpenAI, hoặc dùng model `@cf/moonshotai/kimi-k2.6` trên Cloudflare AI. [1][3][8] Với app/production workflow, hướng rõ ràng nhất là API chính thức vì Kimi

Những điểm chính cần xác nhận đầu tiên là gì?

Hiện có 2 đường tích hợp đã được xác nhận trong bộ bằng chứng này: gọi Kimi K2.6 qua Kimi Open Platform bằng API tương thích OpenAI, hoặc dùng model `@cf/moonshotai/kimi-k2.6` trên Cloudflare AI. [1][3][8] Với app/production workflow, hướng rõ ràng nhất là API chính thức vì Kimi ## Cách tích hợp phù hợp nhất cho app / production

Tôi nên khám phá chủ đề liên quan nào tiếp theo?

Tiếp tục với "Show me top 5 trending search question Vietnamese users often ask about Kimi K2.6 now. Show me both Vietnamese language & English version wi" để có góc nhìn khác và trích dẫn bổ sung.

Mở trang liên quanTôi nên so sánh điều này với cái gì?

Kiểm tra chéo câu trả lời này với "Tìm kiếm và kiểm chứng thông tin: Cách dùng Kimi K2.6 qua API như thế nào?".

Mở trang liên quanTiếp tục nghiên cứu của bạn

Nguồn

- [1] kimi-k2.6 (Moonshot AI) - Cloudflare Docsdevelopers.cloudflare.com

"description": "The input text prompt for the model to generate a response.". "description": "An upper bound for the number of tokens that can be generated for a completion.". "description": "Output types requested from the model (e.g. "description": "An upper bound for the number of tokens that can be generated for a completion.". "description": "Output types requested from the model (e.g. "description": "The model used for the chat completion.". "description": "The input text prompt for the model to generate a response.". "description": "An upper bound for the number of tokens that can be g…

- [2] Moonshot AI (Kimi K2.6) - TypingMind Docsdocs.typingmind.com

Moonshot AI (Kimi K2.6). ## Step 1: Create a Moonshot API account. Go to and create a new Moonshot API account. ## Step 2: Set up Moonshot API account. To use the model via API, you’ll need to add balance to your account. ## Step 3: Get your Moonshot API key. Be sure to copy and save it securely — you’ll need it to set up Kimi K2 on TypingMind. ## Step 4: Set up Kimi as custom model on TypingMind. On TypingMind, go to Models —> Add Custom Models and enter the following details:. * Enter the endpoint:

https://api.moonshot.ai/v1/chat/completions. * Enter the Model ID and context length: `ki… - [3] docs/deploy_guidance.md · moonshotai/Kimi-K2.6 at mainhuggingface.co

docs/deploy_guidance.md · moonshotai/Kimi-K2.6 at main. * Models. * Docs. #

. moonshotai. Kimi-K2.6.

. moonshotai. Kimi-K2.6.  Moonshot AI 8.99k. [Image-Text-to-Text](https://huggingface.co/models?p…

Moonshot AI 8.99k. [Image-Text-to-Text](https://huggingface.co/models?p… - [4] Kimi K2.6 - Kimi API Platformplatform.kimi.ai

Skip to main content. * Kimi K2.6 Multi-modal Model. * Kimi K2. * Using Thinking Models. * Overview of Kimi K2.6 Model. * Long-Thinking Capabilities. * [Example Usage]…

- [5] Kimi-K2/docs/deploy_guidance.md at main - GitHubgithub.com

Skip to content. Reload to refresh your session.You signed out in another tab or window. Reload to refresh your session.You switched accounts on another tab or window. Reload to refresh your session.Dismiss alert. * Code. * [Issues 61](https…

- [6] MoonshotAI: Kimi K2.6 – API Quickstart | OpenRouteropenrouter.ai

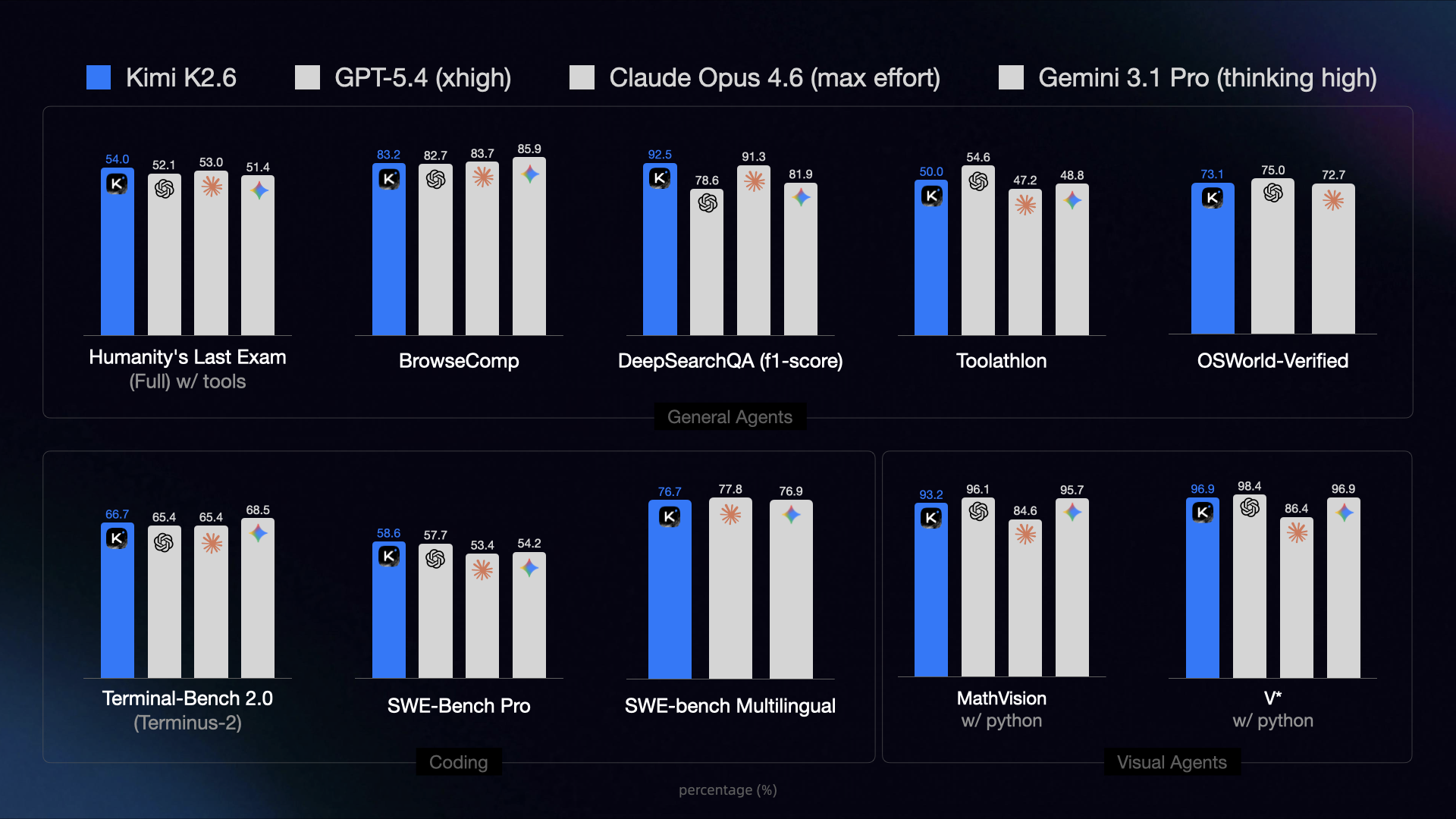

MoonshotAI: Kimi K2.6. ### moonshotai/kimi-k2.6. Kimi K2.6 is Moonshot AI's next-generation multimodal model, designed for long-horizon coding, coding-driven UI/UX generation, and multi-agent orchestration. It handles complex end-to-end coding tasks across Python, Rust, and Go, and can convert prompts and visual inputs into production-ready interfaces. ## Sample code and API for Kimi K2.6. ### OpenRouter normalizes requests and responses across providers for you. OpenRouter supports reasoning-enabled models that can show their step-by-step thinking process. Use the

reasoningparameter in… - [7] Kimi K2 is the large language model series developed by Moonshot ...github.com

Skip to content. Reload to refresh your session.You signed out in another tab or window. Reload to refresh your session.You switched accounts on another tab or window. Reload to refresh your session.Dismiss alert. * Code. * Issues 61. * Pull requests 3. * [Actions](https://github.c…

- [8] Kimi K2.6 Now on SiliconFlow: SOTA Long-horizon Codingsiliconflow.com

Kimi K2.6 Now on SiliconFlow: SOTA Long-horizon Coding. This open-source multimodal model delivers state-of-the-art long-horizon coding, autonomous agent orchestration, and coding-driven design capabilities. With 58.6 on SWE-Bench Pro and 86.3 on BrowseComp (Agent Swarm), K2.6 outperforms leading closed-source models in agentic workflows. Start building with SiliconFlow's API today to explore long-horizon coding tasks. Kimi K2.6, Moonshot AI's latest open-source multimodal agentic model. This release brings exceptional long-horizon coding capabilities, proactive autonomous execution, and sw…

- [9] Moonshot AI Open-Sources Kimi K2.6 — A Coding Model ...chatlyai.app

Moonshot AI Open-Sources Kimi K2.6 — The Coding Model That Runs for Days. Moonshot AI Open-Sources Kimi K2.6 — The Coding Model That Works for Days Without You. Written by Muhammad Bin Habib. Explore what Kimi K2.6's release means for developers, and open-source AI. # Moonshot AI Open-Sources Kimi K2.6 — A Coding Model That Runs Autonomously for Days. Beijing / April 21, 2026 — Moonshot AI has released Kimi K2.6 to the open-source community — a model that executes complex engineering tasks for hours, sometimes days, without a human in the loop. Available immediately via Kimi.com, the…

- [10] Kimi API Platformplatform.moonshot.ai

. *

. *  . *

. *  . *

. *  . *

. *  . *  foundation model with exceptional coding and agent capabilities, featuring 1 trillion total parameters and 32 billion activated parameters. In benchmark evaluations covering general knowledge reasoning, programming, mathematics, and agent-related tasks, the K2 model outperforms other leading open-source models. * kimi-k2-0905-preview: Context length 256k. Based on kimi-k2-0711-preview, w…

- [16] Kimi K2 Quickstart - Kimi API Platformplatform.kimi.ai

from openai import OpenAI from openai import OpenAI client = OpenAI(client = OpenAI( api_key = "$MOONSHOT_API_KEY", api_key = "$MOONSHOT_API_KEY", base_url = "https://api.moonshot.ai/v1", base_url = "https://api.moonshot.ai/v1",)) completion = client.chat.completions.create(completion = client.chat.completions.create( model = "kimi-k2-turbo-preview", model = "kimi-k2-turbo-preview", messages = [ messages = [ {"role": "system", "content": "You are Kimi, an AI assistant provided by Moonshot AI. curl https://api.moonshot.ai/v1/chat/completions \ curl https://api.moonshot.ai/v1/chat/completions \…

- [17] Main Concepts - Kimi API Platformplatform.kimi.ai

Text and Multimodal Models. Text generation models process text in units called Tokens. ## Rate Limits. Rate limits are measured in four ways: concurrency, RPM (requests per minute), TPM (Tokens per minute), and TPD (Tokens per day). For the gateway, for convenience, we calculate rate limits based on the max_completion_tokens parameter in the request. This means that if your request includes the max_completion_tokens parameter, we will use this parameter to calculate the rate limit. If your request does not include the max_completion_tokens parameter, we will use the default max\…

- [18] Migrating from OpenAI to Kimi APIplatform.kimi.ai

Moonshot AI is a proper noun and should not be translated into other languages."}, {"role": "user", "content": "Please search the internet for Context Caching and tell me what it is."} # The user asks Kimi to search online {"role": "user", "content": "Please search the internet for Context Caching and tell me what it is."} # The user asks Kimi to search online]] finish_reason = None finish_reason = None # ==========================================================================================================================================================# ==================================…

- [19] Model Inference Pricing Explanation - Kimi API Platformplatform.kimi.ai

Model Pricing. # Model Inference Pricing Explanation. ### Billing Unit. Token: A token represents a common sequence of characters. The number of tokens used for each English character may vary. Generally speaking, for a typical English text, 1 token is roughly equivalent to 3-4 English characters. The exact number of tokens generated by each call can be obtained through the Token Calculation API. #### Billing Logic. Chat Completion API charges: We bill both the Input and Output based on usage. If you upload and extract content from a document and then pass the extracted content as I…

- [20] Multi-modal Model Kimi K2.5 Pricing - Kimi API Platformplatform.kimi.ai

🎉 New kimi k2.5 Multi-modal Model released! Now supports multimodal understanding and processing. Kimi API Platform home pagelight logodark logo. ##### Model Pricing. ##### Support. # Multi-modal Model Kimi K2.5 Pricing. ## Product Pricing. Explanation: Prices exclude applicable taxes. Specific tax obligations are subject to local tax regulations and will be calculated at checkout based on your jurisdiction. Here, 1M = 1,000,000. The prices in the table represent the cost per 1M tokens consumed. ## Model Description. * Kimi K2.5 is Kimi’s most intelligent model to date. It is also Ki…

- [21] Multi-modal Model Kimi K2.6 Pricingplatform.kimi.ai

🎉 Kimi K2.6 has been released with improved long-context coding stability. Top-up bonus event in progress 🔗. Kimi API Platform home pagelight logodark logo. ##### Model Pricing. ##### Promotions. ##### Support. # Multi-modal Model Kimi K2.6 Pricing. ## Product Pricing. Explanation: Prices exclude applicable taxes. Specific tax obligations are subject to local tax regulations and will be calculated at checkout based on your jurisdiction. Here, 1M = 1,000,000. The prices in the table represent the cost per 1M tokens consumed. ## Model Description. * Kimi K2.6 is Kimi’s latest and most…

- [22] Using Playground to Debug Model - Kimi API Platformplatform.kimi.ai

- Experience the model's tool calling capabilities using Kimi Open Platform's built-in tools. * Kimi Open Platform provides officially supported tools that execute for free. You can select tools in the playground, and the model will automatically determine whether tool calls are needed to complete your instructions. If tool calls are required, the model will generate parameters according to the tool's requirements and integrate them into the final answer. * Currently supported tools: Date/Time tools, Excel file analysis tools, Web search tools, Random number generation tools, etc. * Currentl…

- [23] Frequently Asked Questions and Solutions - Kimi API Platformplatform.kimi.ai

In this case, the Kimi API will only return content within the

max_completion_tokenslimit, and any excess content will be discarded, resulting in the aforementioned “incomplete content” or “truncated content.” When encounteringfinish_reason=length, if you want the Kimi large language model to continue generating content from where it left off, you can use the Partial Mode provided by the Kimi API. - [24] WebSearch Pricing - Kimi API Platformplatform.kimi.ai

Kimi K2.6 Open Platform, providing trillion-parameter K2.5 large language model API, supporting 256K long context and Tool Calling.