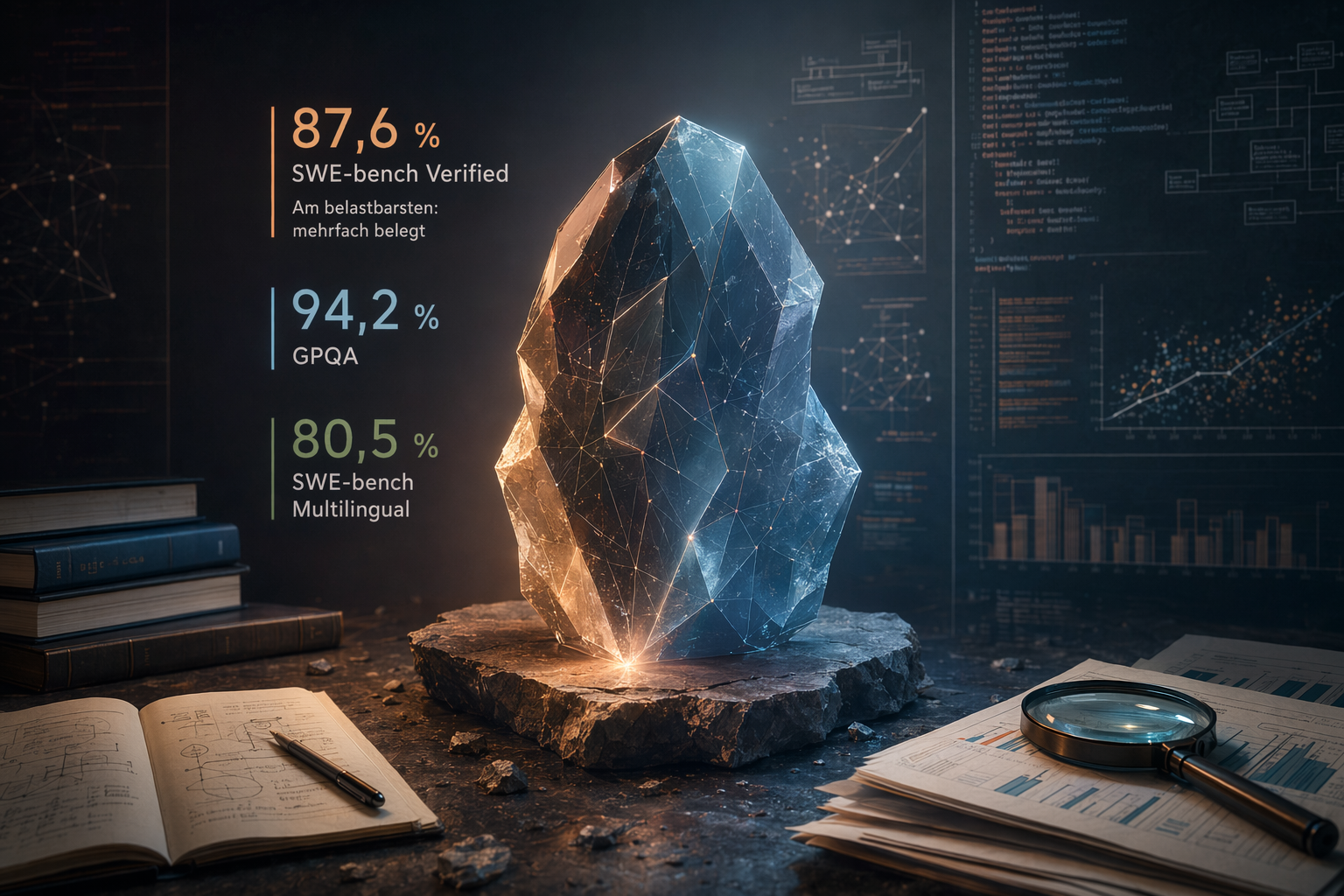

ถ้าต้องสรุปจากแหล่งข้อมูลสาธารณะที่มีอยู่ตอนนี้ ตัวเลข benchmark หลักของ Claude Opus 4.7 คือ 87.6% บน SWE-bench Verified, 94.2% บน GPQA และ 80.5% บน SWE-bench Multilingual [4][

5][

9] ในสามค่านี้ SWE-bench Verified เป็นหลักยึดที่แข็งแรงที่สุด เพราะมีมากกว่าหนึ่งแหล่งระบุค่าเดียวกัน [

4][

5]

ประเด็นสำคัญคือ ตัวเลขเหล่านี้ควรใช้เป็น “จุดเริ่มต้น” ในการคัดกรองโมเดล ไม่ใช่คำตอบสุดท้ายสำหรับการจัดซื้อ การย้ายระบบ หรือการนำไปใช้ใน production เพราะผลลัพธ์จริงยังขึ้นกับ repository, toolchain, รูปแบบ prompt, latency, งบประมาณโทเคน และเกณฑ์ยอมรับของแต่ละทีม

ตัวเลขหลักที่ควรรู้

| Benchmark | ค่าที่ระบุสำหรับ Claude Opus 4.7 | ควรอ่านแหล่งข้อมูลอย่างไร |

|---|---|---|

| SWE-bench Verified | 87.6% | เป็นตัวเลขด้าน coding ที่มีน้ำหนักที่สุดในชุดข้อมูลนี้ เพราะถูกระบุซ้ำในหลายแหล่ง [ |

| GPQA | 94.2% | ระบุชัดใน LLM-Stats แต่ในข้อมูลจาก Anthropic ที่เห็นในชุดแหล่งข้อมูลนี้ยังไม่ปรากฏตาราง benchmark ฉบับเต็ม [ |

| SWE-bench Multilingual | 80.5% | มีอีกแหล่งระบุค่านี้ พร้อมเทียบกับ 77.8% ของ Opus 4.6 จึงน่าสนใจ แต่ควรถ่วงน้ำหนักอย่างระวัง [ |

ตารางนี้ตั้งใจสรุปแบบระมัดระวัง: นำเฉพาะค่าที่ปรากฏอย่างชัดเจนในแหล่งข้อมูลสาธารณะที่มีอยู่มาใช้ ไม่ขยายความเกินหลักฐาน และไม่ควรใช้แทนการทดสอบกับงานจริงขององค์กร

ทำไม SWE-bench Verified 87.6% จึงเป็นหลักยึดที่แข็งแรงที่สุด

ค่า 87.6% บน SWE-bench Verified เป็นตัวเลขที่มีหลักฐานรองรับชัดที่สุดสำหรับ Claude Opus 4.7 ในชุดข้อมูลนี้ ทั้งบทความด้าน migration/benchmark และ LLM-Stats ระบุค่าเดียวกัน [4][

5]

LLM-Stats ยังระบุว่าค่านี้เพิ่มขึ้น 6.8 จุดเปอร์เซ็นต์ เมื่อเทียบกับ Opus 4.6 [5] ขณะที่ ALM Corp อธิบายว่า Opus 4.7 มีสมรรถนะดีขึ้นในงาน coding ที่ยากและเวิร์กโฟลว์แบบ agent [

6]

สำหรับทีมซอฟต์แวร์ ค่า SWE-bench Verified จึงเป็นจุดเริ่มต้นที่ดีที่สุดในการประเมินเชิงสาธารณะ แต่ยังไม่ควรสรุปว่าโมเดลจะทำงานได้ดีเท่ากันใน codebase ของคุณเอง สิ่งที่ต้องทดสอบต่อคือคุณภาพ patch, ความสามารถในการทำตาม style ของ repository, การใช้งานร่วมกับเครื่องมือภายใน และเกณฑ์ review ของทีม

GPQA 94.2%: สัญญาณด้าน reasoning ที่แรง แต่ควรตรวจซ้ำ

ค่า 94.2% บน GPQA ถูกระบุอย่างชัดเจนใน LLM-Stats [5] อย่างไรก็ตาม แหล่งข้อมูลทางการจาก Anthropic ที่ปรากฏในชุดข้อมูลนี้ยืนยันได้ชัดว่า developer สามารถใช้

claude-opus-4-7 ผ่าน Claude API แต่ไม่ได้แสดงตาราง benchmark เต็มในข้อมูลที่เห็น [7]

ดังนั้น GPQA ควรถูกอ่านเป็นสัญญาณเสริมที่สำคัญ โดยเฉพาะถ้าทีมสนใจความสามารถด้าน reasoning และงานความรู้ระดับยาก แต่ถ้าจะใช้เป็นเกณฑ์จัดซื้อหรือเกณฑ์ย้าย workload จริง ควรตรวจสอบกับเอกสารต้นทางเพิ่มเติมหรือทำ evaluation ภายในด้วย [5][

7]

SWE-bench Multilingual 80.5%: น่าสนใจสำหรับงานหลายภาษา แต่หลักฐานยังบางกว่า

สำหรับทีมที่สนใจงานโค้ดหลายภาษา หลายสแต็ก หรือสภาพแวดล้อมการพัฒนาที่ไม่ได้พึ่งภาษาอังกฤษอย่างเดียว ค่า 80.5% บน SWE-bench Multilingual เป็นตัวเลขที่ควรจับตา แหล่งข้อมูลหนึ่งระบุว่าค่านี้เพิ่มจาก 77.8% ของ Opus 4.6 [9]

ข้อจำกัดคือ ค่านี้ยังไม่ได้ปรากฏซ้ำกว้างเท่า SWE-bench Verified ในแหล่งข้อมูลที่มีอยู่ จึงเหมาะใช้เป็น “สัญญาณเบื้องต้น” มากกว่าใช้เป็นหลักฐานหลักเพียงอย่างเดียว หากองค์กรมี codebase หลายภาษา ควรทดสอบกับงานจริงของตัวเองก่อนตัดสินใจ

Benchmark ไม่ได้บอกครบทุกอย่าง

Claude Opus 4.7 ไม่ได้ถูกวางตำแหน่งผ่านคะแนน benchmark เท่านั้น VentureBeat ระบุว่า Anthropic เปิดตัวโมเดลนี้ในฐานะ large language model ที่ทรงพลังที่สุดของบริษัทซึ่งเผยแพร่สู่สาธารณะในขณะนั้น [1] ส่วน ALM Corp ระบุว่า Opus 4.7 เป็น Opus model รุ่นล่าสุดที่เปิดใช้งานทั่วไป และถูกวางไว้สำหรับงาน coding ขั้นสูง งาน agent ระยะยาว งานเอกสาร งาน vision ความละเอียดสูง และเวิร์กโฟลว์ระดับมืออาชีพ [

6]

ปัจจัยเชิงผลิตภัณฑ์ที่ควรดูควบคู่กับ benchmark ได้แก่

- Context window: LLM-Stats ระบุ context window ขนาด 1 ล้านโทเคน [

5]

- Vision: LLM-Stats ระบุการประมวลผล vision ที่ความละเอียดสูงขึ้น 3.3 เท่า [

5]

- Effort level: LLM-Stats และ ALM Corp ระบุระดับ effort ใหม่คือ

xhigh[5][

6]

- Tokenizer: ALM Corp ระบุว่ามี tokenizer ที่อัปเดตแล้ว และอาจทำให้ input เดิมมีจำนวนโทเคนสูงขึ้น [

6]

สำหรับการใช้งานจริง ประเด็นเหล่านี้อาจกระทบทั้งต้นทุน เวลาในการตอบ และคุณภาพผลลัพธ์ โดยเฉพาะ tokenizer เพราะถ้า input เดิมถูกนับเป็นโทเคนมากขึ้น สมมติฐานเรื่องงบประมาณและปริมาณการใช้งานก็อาจเปลี่ยนไป [6]

วิธีใช้ตัวเลขเหล่านี้ในการตัดสินใจ

ถ้าใช้กับงาน coding: ให้เริ่มจาก SWE-bench Verified เพราะค่า 87.6% เป็นตัวเลขที่มีหลักฐานสาธารณะรองรับดีที่สุดในชุดข้อมูลนี้ [4][

5]

ถ้าใช้กับ workflow แบบ agent: อย่าดูเฉพาะคะแนน benchmark แต่ควรดูการวางตำแหน่งด้านงาน coding ที่ยาก งาน agent และระดับ effort ใหม่ xhigh ด้วย [5][

6]

ถ้าใช้กับงาน reasoning ทั่วไป: GPQA 94.2% เป็นสัญญาณที่น่าสนใจ แต่ในชุดข้อมูลนี้ยังยืนยันกว้างน้อยกว่า SWE-bench Verified [5][

7]

ถ้าใช้กับ codebase หลายภาษา: SWE-bench Multilingual 80.5% เป็นข้อมูลประกอบที่มีประโยชน์ แต่ควรทดสอบเพิ่มกับงานจริง เพราะหลักฐานสาธารณะยังบางกว่า [9]

ถ้าจะย้ายไปใช้ใน production: ควรทดสอบมากกว่าโจทย์ที่คล้าย benchmark เช่น context ยาว, การทำงานกับเอกสารจำนวนมาก, use case ด้าน vision, ปริมาณโทเคน, latency และพฤติกรรมเมื่อใช้ระดับ effort ต่างกัน การเปลี่ยนแปลงด้าน context window, vision, effort level และ tokenizer อาจส่งผลต่อการใช้งานจริงอย่างมีนัยสำคัญ [5][

6]

บทสรุป

ภาพรวมที่ระมัดระวังที่สุดคือ Claude Opus 4.7 มีตัวเลขสาธารณะสำคัญอยู่ที่ 87.6% บน SWE-bench Verified, 94.2% บน GPQA และ 80.5% บน SWE-bench Multilingual [4][

5][

9] ในบรรดาตัวเลขเหล่านี้ SWE-bench Verified เป็นหลักยึดที่น่าเชื่อถือที่สุด เพราะถูกระบุซ้ำในหลายแหล่ง [

4][

5]

ส่วน GPQA และ SWE-bench Multilingual เป็นสัญญาณเสริมที่มีประโยชน์ แต่ควรตรวจซ้ำก่อนใช้เป็นเกณฑ์ตัดสินใจสำคัญ สำหรับทีมที่ต้องเลือกโมเดลจริง คำแนะนำสั้น ๆ คือ ใช้ benchmark เพื่อคัดรายชื่อเบื้องต้น แล้วให้ evaluation บน workflow จริงเป็นตัวตัดสินขั้นสุดท้าย