Обновление модели — это не только сравнение цены за миллион токенов. Tokenizer, или токенизатор, — это правило, по которому текст до попадания в модель разбивается на токены. А токены — одна из базовых единиц, через которые API крупных языковых моделей считают стоимость.[20][

12][

32][

2]

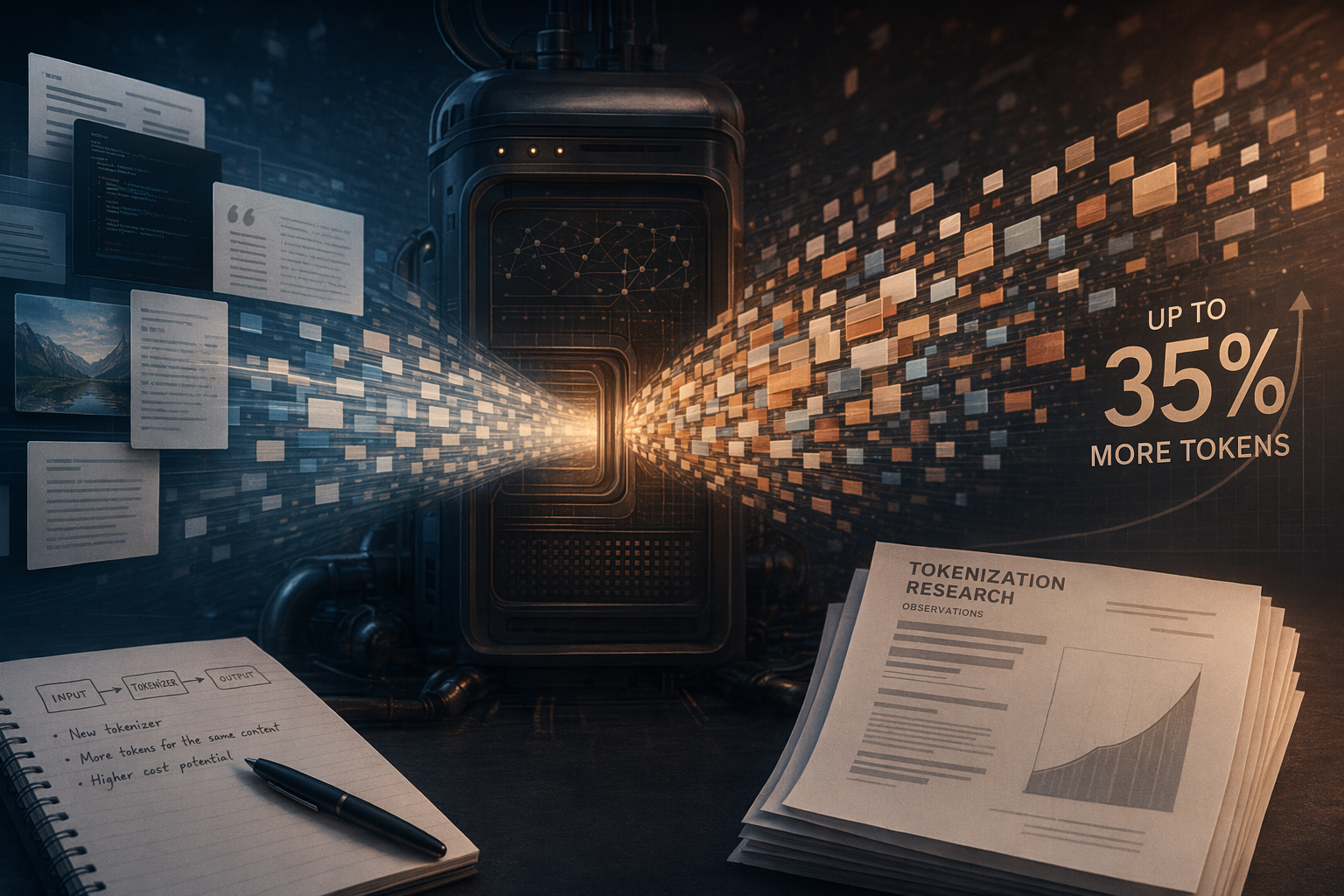

Claude Opus 4.7 — наглядный пример. В документации Anthropic сказано, что новый tokenizer при обработке текста может использовать примерно от 1x до 1,35x токенов по сравнению с предыдущими моделями — до ~35% больше, причём разница зависит от содержимого. Для одного и того же ввода /v1/messages/count_tokens вернёт разные значения для Claude Opus 4.7 и Claude Opus 4.6.[34]

Главное: может стать дороже, но не каждый prompt на 35%

Самая точная формулировка такая: новый tokenizer может увеличить число input tokens у того же prompt’а. Если цена за input token остаётся прежней, input-часть стоимости может вырасти.

Но превращать это в лозунг «всё стало дороже на 35%» неправильно. Anthropic указывает диапазон примерно 1x–1,35x и отдельно подчёркивает, что результат зависит от содержимого.[34]

Кроме того, рост числа input tokens не равен росту всего счёта. В прайсинге Claude API отдельно указаны Base Input Tokens, Cache Writes, Cache Hits и Output Tokens; у OpenAI и Gemini также есть собственные страницы API pricing.[12][

32][

2] То есть итоговая стоимость зависит не только от промпта, но и от ответа модели, кэша, структуры запроса и выбранной модели.

Почему один и тот же текст может дать разное число токенов

Токен — это не слово и не символ. Один tokenizer может разбить фразу одним способом, другой — иначе. В руководстве OpenAI по tiktoken показано, что для подсчёта нужно использовать конкретную encoding-схему; документация Gemini также говорит, что input и output в Gemini API токенизируются, включая текст и изображения.[20][

1]

Поэтому подсчёт по словам, символам или усреднённой формуле годится только для грубой оценки. Для бюджета и миграции модели надёжнее смотреть фактический token count, который возвращает целевой API. Именно это и демонстрирует случай Opus 4.7: один и тот же ввод может получить другой счётчик токенов, чем в Opus 4.6.[34]

Как правильно читать цифру 35%

| Расхожая интерпретация | Более точная версия |

|---|---|

| Opus 4.7 делает каждый prompt на 35% дороже | Это упрощение. Документация говорит о примерно 1x–1,35x токенов и зависимости от содержимого.[ |

| Один и тот же текст может считаться как большее число токенов | Да. Anthropic прямо пишет, что новый tokenizer может использовать больше токенов, а count_tokens даст другой результат для Opus 4.7 по сравнению с Opus 4.6.[ |

| Tokenizer влияет только на лимит контекста, но не на деньги | Неполно. API-прайсинг обычно опирается на input, output и другие токеновые категории, поэтому изменение token count может повлиять на расчёт стоимости.[ |

| Надо проверять официальным счётчиком | Да. У OpenAI есть документация по input token counting и tiktoken, у Gemini — count_tokens, а Anthropic указывает /v1/messages/count_tokens для Claude.[ |

Простая формула для оценки

Если смотреть только на input tokens и предположить, что цена за input token не изменилась, можно использовать упрощённую оценку:

дополнительная input-стоимость ≈ (input tokens в новой модели − input tokens в старой модели) × цена input-токена

Но это только input-часть. Реальный счёт может включать output tokens, cache writes, cache hits и другие категории тарификации. У Anthropic эти поля вынесены отдельно, а у OpenAI и Gemini есть собственные документы с ценами API.[12][

32][

2]

Что сделать перед переходом на Claude Opus 4.7

1. Берите полный payload, а не только сообщение пользователя

В реальном продукте в модель часто уходит не только user message. Там могут быть system-инструкции, длинный контекст, результаты инструментов, файлы, изображения и служебные данные. Документация Gemini говорит, что входы и выходы токенизируются, включая текст и изображения; руководство OpenAI также показывает подсчёт input tokens для запроса с текстом и изображением.[1][

33]

2. Считайте токены инструментом целевой модели

Не полагайтесь на универсальный калькулятор, если речь идёт о бюджете. OpenAI описывает responses.input_tokens.count и tiktoken; Gemini предоставляет count_tokens; Anthropic в документации Opus 4.7 указывает /v1/messages/count_tokens и предупреждает, что Opus 4.7 и Opus 4.6 вернут разные числа токенов.[33][

20][

1][

34]

3. Тестируйте разные типы запросов

Один короткий prompt мало что покажет. Разница зависит от содержимого, поэтому стоит отдельно проверить самые частые, самые длинные и самые дорогие payload’ы: например, запросы с большим контекстом, инструментами, файлами или типовыми пользовательскими сценариями.[34]

4. Пересчитывайте стоимость по официальному прайсингу

Сначала сравните token count старой и новой модели. Затем примените актуальные цены для input tokens. После этого добавьте output, cache writes, cache hits и другие поля, если они есть в вашей архитектуре. Для сверки используйте официальные страницы Anthropic, OpenAI и Gemini.[12][

32][

2]

5. Решайте по данным, а не по заголовку

Если разница небольшая, возможно, достаточно обновить бюджет и мониторинг. Если подорожали высоконагруженные сценарии, тогда уже есть смысл сокращать контекст, уплотнять prompt, пересматривать стратегию кэширования или считать стоимость одного запроса заново. Главное — не паниковать из-за числа 35%, а измерить именно ваши payload’ы.[12][

34]

Итог

Новый tokenizer действительно может сделать тот же prompt «тяжелее» в input tokens. Для Claude Opus 4.7 Anthropic прямо указывает диапазон примерно 1x–1,35x токенов при обработке текста по сравнению с предыдущими моделями, максимум около 35%, с зависимостью от содержимого.[34]

Но правильный вопрос не «прибавилось ли 35% ко всему», а «сколько токенов добавилось в моих реальных запросах». Надёжный путь: взять реальные payload’ы, прогнать их через официальный token counter целевой модели, затем применить официальный pricing с учётом input, output и cache-полей.[33][

1][

34][

12][

32][

2]