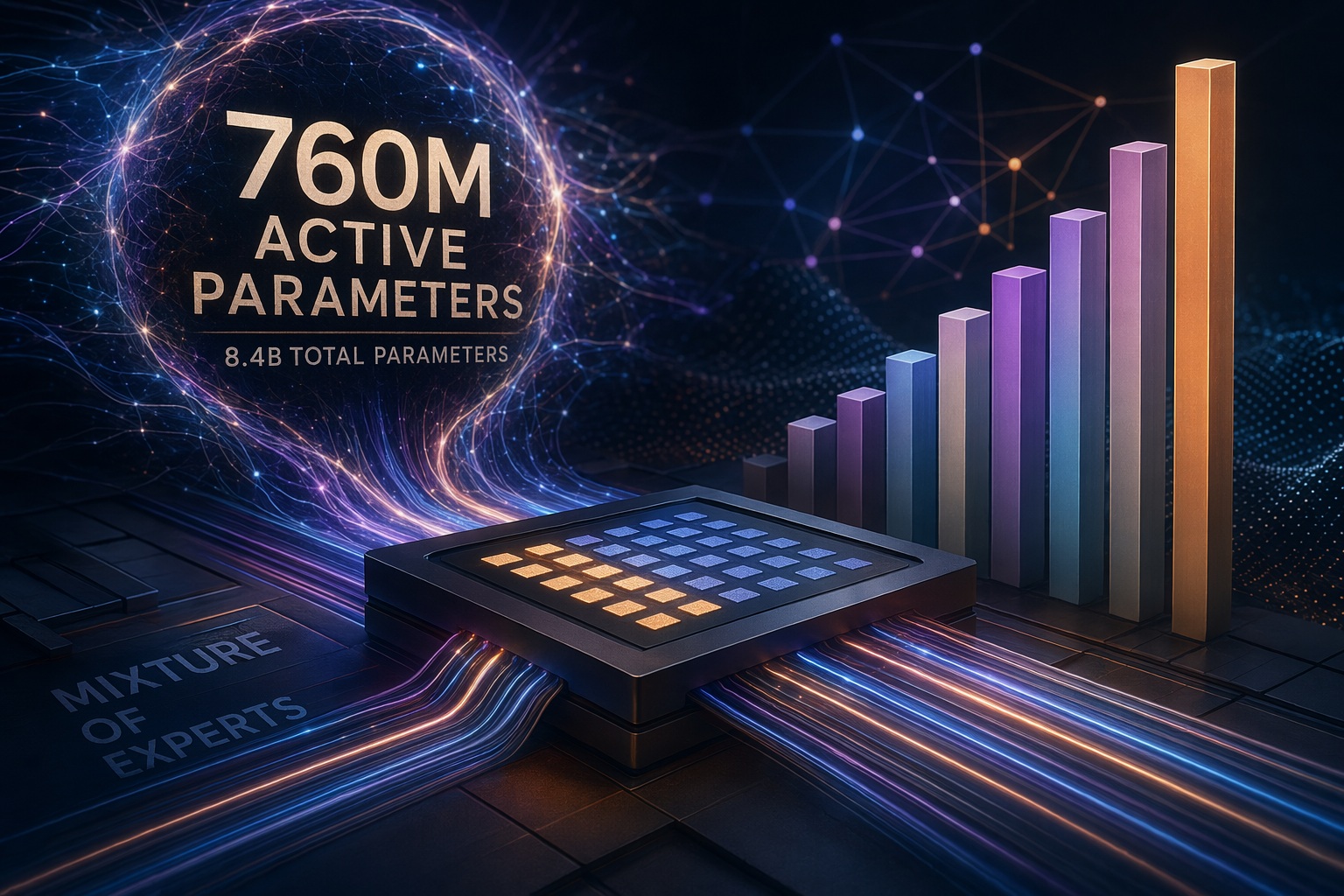

O ZAYA1-8B merece atenção porque muda a pergunta. Em vez de olhar apenas para quantos parâmetros um modelo tem no total, ele força a discussão sobre quantos parâmetros precisam estar ativos para entregar bom desempenho. A Zyphra descreve o ZAYA1-8B como um modelo Mixture-of-Experts, ou MoE, com 8,4 bilhões de parâmetros totais e 760 milhões de parâmetros ativos, com resultados fortes em tarefas de raciocínio, matemática e programação [1][

6].

A leitura cuidadosa é esta: o ZAYA1-8B é um sinal importante de eficiência, não uma prova de que modelos menores substituem automaticamente todos os grandes sistemas de IA de fronteira.

O que é o ZAYA1-8B

O card do modelo no Hugging Face descreve o ZAYA1-8B como um pequeno modelo de linguagem Mixture-of-Experts treinado de ponta a ponta pela Zyphra, com 8,4 bilhões de parâmetros totais e 760 milhões de parâmetros ativos [6]. O mesmo card afirma que ele foi pensado para raciocínio detalhado em respostas longas, especialmente em tarefas matemáticas e de código [

6].

Essa diferença entre parâmetros totais e parâmetros ativos é o ponto central. Em um modelo MoE, há um conjunto maior de especialistas disponíveis, mas apenas uma parte deles é acionada em cada computação. No caso do ZAYA1-8B, o número destacado pela Zyphra é inferior a 1 bilhão de parâmetros ativos, apesar do tamanho total de 8,4 bilhões [4].

.svg)