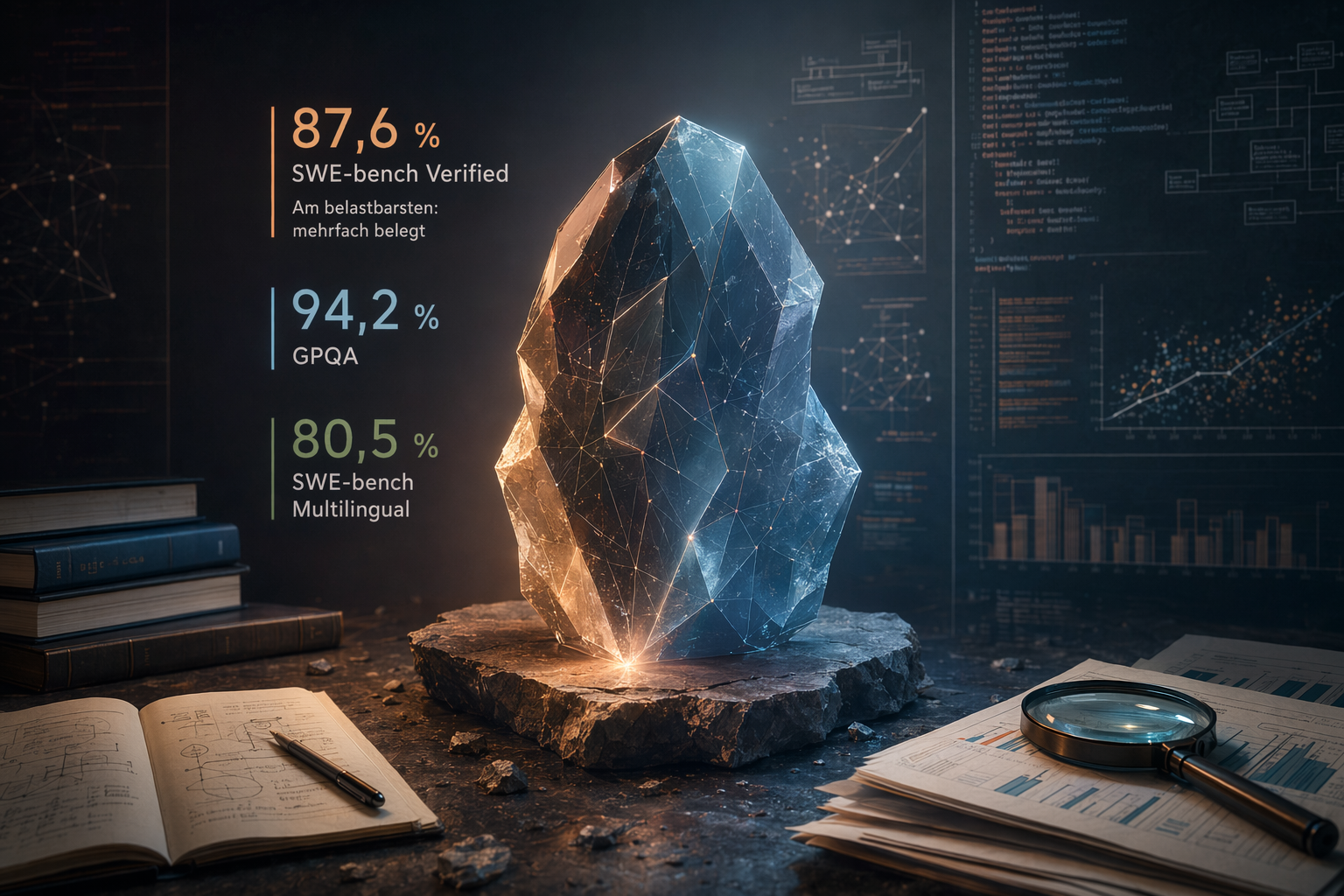

Claude Opus 4.7の実力を公開情報だけで見るなら、まず押さえるべき数字は3つです。SWE-bench Verifiedで87.6%、GPQAで94.2%、そしてSWE-bench Multilingualで80.5%。ただし、3つの数字は同じ重みで見るべきではありません。現時点で最も根拠が厚いのは、複数の公開情報で一致しているSWE-bench Verifiedの87.6%です。[4][

5]

主要スコアの早見表

| ベンチマーク | Claude Opus 4.7の公開スコア | 読み方 |

|---|---|---|

| SWE-bench Verified | 87.6% | この情報セットでは最も強い根拠。複数の公開情報で同じ値が示されている。[ |

| GPQA | 94.2% | LLM-Statsでは明確に示されているが、手元のAnthropic公式ページ抜粋ではベンチマーク表までは確認できない。[ |

| SWE-bench Multilingual | 80.5% | 別の情報源で、Opus 4.6の77.8%から上昇した値として示されている。根拠はやや薄めに見るべき。[ |

ここでは、確認できる公開情報に出ている数値だけを採用しています。モデル導入や移行判断に使う場合は、この表を「候補を絞るための入口」と考え、自社のコード、ツール、運用条件で検証する必要があります。

いちばん頼りになる指標はSWE-bench Verified

Claude Opus 4.7のベンチマークで最も扱いやすいのは、**SWE-bench Verifiedの87.6%**です。移行ガイド系の記事とLLM-Statsの両方が同じ値を挙げています。[4][

5]

LLM-Statsは、この87.6%をOpus 4.6から6.8パーセンテージポイントの改善として位置づけています。[5] また、ALM CorpはOpus 4.7について、難度の高いコーディングやエージェント型ワークフローで性能を高めたモデルとして説明しています。[

6]

ソフトウェア開発で使うなら、この値は有力な比較材料になります。ただし、SWE-bench Verifiedが高いからといって、すべてのリポジトリで同じように効くとは限りません。実際には、既存コードの規模、テストの書き方、CI/CD、利用する開発ツール、レビュー基準によって成果は変わります。

GPQA 94.2%は強いが、確認経路は限定的

**GPQAの94.2%**は、LLM-Statsでは明確に示されています。[5] 一方で、Anthropic公式ページは一次情報として重要ですが、今回確認できる抜粋では、開発者がClaude API経由で

claude-opus-4-7を利用できることは確認できるものの、GPQAの数値を含む完全なベンチマーク表までは見えていません。[7]

そのため、GPQAはClaude Opus 4.7の推論性能を考えるうえで重要な参考値ではありますが、SWE-bench Verifiedほど強く裏取りされた数字としては扱いにくい、というのが現時点での無難な見方です。購入判断や本番移行の決め手にするなら、一次情報や自前の評価セットで確認したいところです。[5][

7]

SWE-bench Multilingualは多言語環境で気になる数字

多言語のコードベースや、英語以外のコメント・仕様書を含む開発環境で使うなら、**SWE-bench Multilingualの80.5%**は注目に値します。ある情報源では、Claude Opus 4.7が80.5%に達し、Opus 4.6の77.8%から上昇したとされています。[9]

ただし、この値はSWE-bench Verifiedほど広く確認できていません。日本語の設計書、英語のAPI仕様、多言語のコメントが混在するような現場では参考になりますが、そのまま実運用の成果を保証するものではありません。自社の実データでのテストが前提です。

スコア表だけでは見落とすポイント

Claude Opus 4.7は、単なるベンチマーク更新としてだけ語られているわけではありません。VentureBeatは、Anthropicが公開する中で最も強力な大規模言語モデルとしてClaude Opus 4.7を紹介しています。[1] ALM Corpも、Opus 4.7を高度なコーディング、長時間のエージェント型タスク、文書中心の推論、高解像度の視覚理解、専門的ワークフロー向けのモデルとして位置づけています。[

6]

実際の導入では、次のような仕様もベンチマークと同じくらい重要です。

- コンテキストウィンドウ: LLM-Statsは100万トークンのコンテキストを挙げています。[

5]

- Vision処理: LLM-Statsは、3.3倍高解像度のVision処理を挙げています。[

5]

- effortレベル: LLM-StatsとALM Corpは、新しい**

xhigheffortレベル**に言及しています。[5][

6]

- トークナイザー: ALM Corpは、更新されたトークナイザーにより、同じ入力でもトークン数が増える可能性があると指摘しています。[

6]

特にトークナイザーの変更は、見落としやすい割に影響が大きい部分です。入力が同じでもトークン数が変われば、コスト、レイテンシ、上限設計、ログ保存の前提が変わる可能性があります。[6]

チーム別の見方

コーディング用途: まずはSWE-bench Verifiedの87.6%を基準に見るのが自然です。この情報セットでは、最もよく裏取りされている数値です。[4][

5]

エージェント型ワークフロー: ベンチマークだけでなく、難度の高いコーディングやエージェントタスク向けという位置づけ、さらにxhigh effortレベルの影響を確認する必要があります。[5][

6]

一般的な推論用途: GPQA 94.2%は有力な参考値ですが、今回の公開情報ではSWE-bench Verifiedほど広く確認できません。[5][

7]

多言語コードベース: SWE-bench Multilingualの80.5%は有用な手がかりです。ただし、根拠がやや限定的なため、英語以外のコメント、仕様書、ドキュメントを含む実データで追加検証すべきです。[9]

本番移行: ベンチマークに近いタスクだけでなく、長いコンテキスト、ツール利用、Vision処理、トークン消費、レイテンシを実運用に近い条件で試す必要があります。コンテキスト、Vision、effortレベル、トークナイザーの変更は、実際の使い勝手を大きく左右し得ます。[5][

6]

結論

Claude Opus 4.7の公開ベンチマークを最短でまとめると、**SWE-bench Verified 87.6%、GPQA 94.2%、SWE-bench Multilingual 80.5%**です。[4][

5][

9] このうち最も信頼して参照しやすいのは、複数の情報源で確認できるSWE-bench Verifiedの87.6%です。[

4][

5]

GPQAとSWE-bench Multilingualも重要なシグナルですが、今回の情報セットでは裏取りの厚さに差があります。モデル選定では、公開ベンチマークを出発点にしつつ、最後は自社のコード、データ、ワークフローで評価するのが安全です。