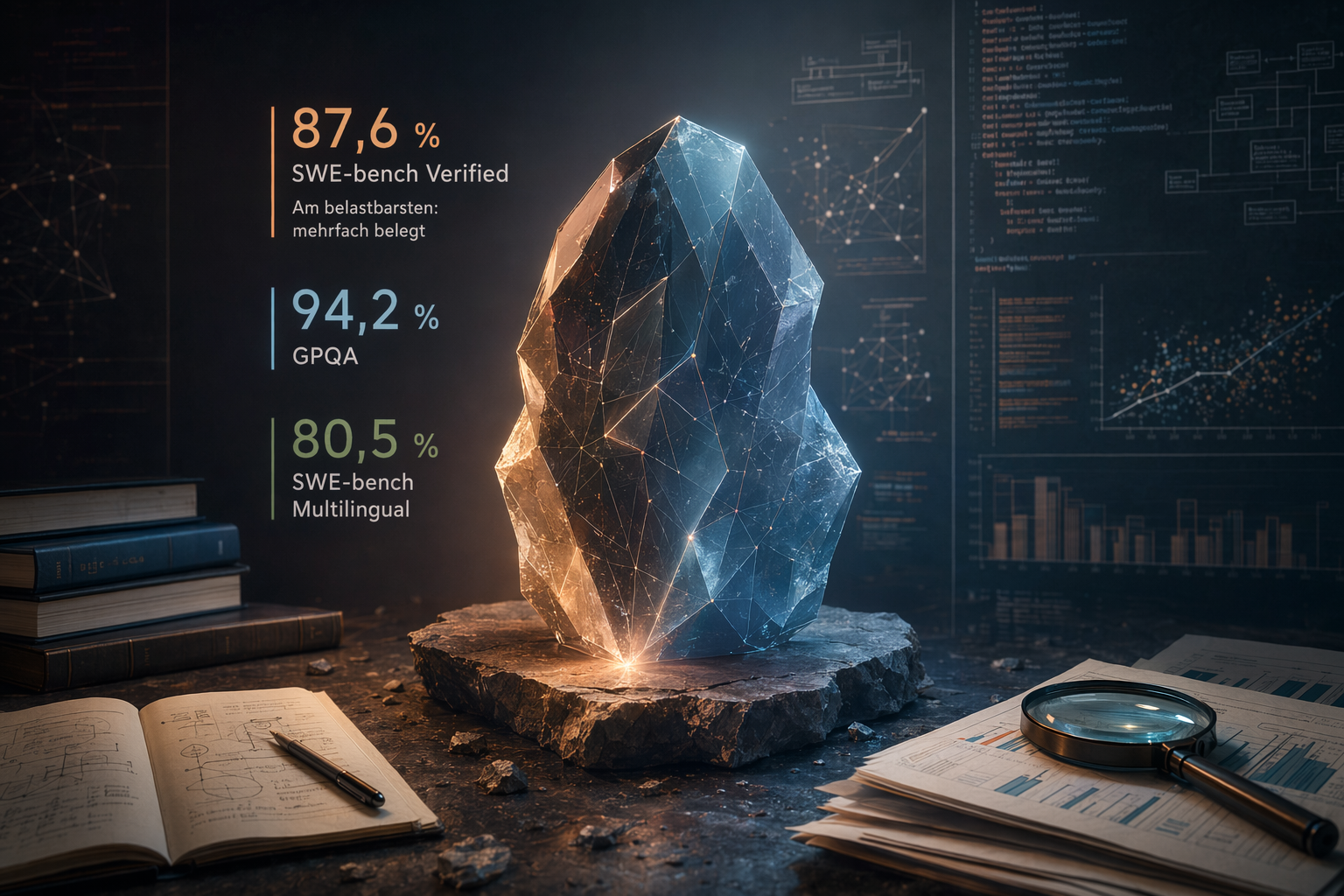

Jika diringkas, posisi benchmark Claude Opus 4.7 saat ini paling aman dibaca lewat tiga angka publik: 87,6% di SWE-bench Verified, 94,2% di GPQA, dan 80,5% di SWE-bench Multilingual. [4][

5][

9] Dari ketiganya, SWE-bench Verified adalah pegangan paling kuat, karena angka yang sama disebut di beberapa sumber yang tersedia. [

4][

5]

Namun, angka benchmark sebaiknya tidak dibaca seperti papan skor olahraga. Untuk tim yang sedang memilih model AI, terutama untuk coding, agen otomatis, atau migrasi API, pertanyaan utamanya bukan hanya “berapa skornya?”, tetapi “seberapa relevan skor itu dengan pekerjaan nyata kita?”

Angka utama Claude Opus 4.7

| Benchmark | Angka yang disebut untuk Claude Opus 4.7 | Catatan sumber |

|---|---|---|

| SWE-bench Verified | 87,6% | Titik acuan coding publik terkuat dalam sumber yang tersedia; angkanya disebut lebih dari sekali. [ |

| GPQA | 94,2% | Disebut jelas oleh LLM-Stats, tetapi dalam cuplikan sumber Anthropic yang tersedia tidak terlihat sebagai tabel benchmark lengkap. [ |

| SWE-bench Multilingual | 80,5% | Disebut dalam sumber lain, dengan pembanding 77,8% untuk Opus 4.6; bobotnya perlu lebih hati-hati karena dukungan sumbernya lebih tipis. [ |

Tabel ini sengaja dibuat konservatif. Artinya, hanya angka yang secara eksplisit muncul dalam sumber publik yang digunakan. Untuk pengadaan, migrasi, atau pemilihan model produksi, angka-angka ini tetap perlu dilengkapi dengan evaluasi internal pada tugas nyata.

Mengapa SWE-bench Verified paling layak jadi acuan awal

Skor 87,6% di SWE-bench Verified adalah angka benchmark Claude Opus 4.7 yang paling kuat dukungan sumbernya dalam konteks ini. Angka tersebut muncul baik di artikel migrasi dan benchmark maupun di LLM-Stats. [4][

5]

LLM-Stats juga menyebut skor 87,6% itu sebagai kenaikan 6,8 poin persentase dibanding Opus 4.6. [5] Sementara itu, ALM Corp menggambarkan Opus 4.7 sebagai model dengan performa lebih kuat untuk coding sulit dan workflow agen. [

6]

Bagi tim software engineering, ini berarti SWE-bench Verified bisa dipakai sebagai titik awal pembanding publik. Tetapi jangan berhenti di sana. Yang lebih menentukan adalah performa model pada repository sendiri, gaya kode sendiri, toolchain sendiri, dan kriteria penerimaan yang dipakai tim.

GPQA: sinyal kuat, tetapi belum sekuat SWE-bench dalam sumber ini

Angka 94,2% di GPQA disebut jelas oleh LLM-Stats. [5] Sumber resmi Anthropic tetap penting sebagai rujukan primer, tetapi cuplikan yang tersedia di sini terutama menunjukkan bahwa developer dapat memakai

claude-opus-4-7 melalui Claude API; tabel benchmark lengkap yang bisa dikutip langsung tidak tampak dalam informasi yang tersedia. [7]

Karena itu, GPQA sebaiknya dibaca sebagai sinyal tambahan yang relevan, bukan sebagai bukti sekuat SWE-bench Verified dalam kumpulan sumber ini. Jika GPQA menjadi dasar keputusan pembelian atau migrasi, angkanya sebaiknya dicek lagi terhadap materi primer atau hasil pengujian sendiri. [5][

7]

SWE-bench Multilingual: menarik untuk codebase multibahasa

Untuk tim yang bekerja dengan codebase atau dokumentasi campuran bahasa, angka 80,5% di SWE-bench Multilingual layak diperhatikan. Satu sumber menyebut angka ini naik dari 77,8% pada Opus 4.6. [9]

Catatannya penting: angka ini tidak muncul seluas SWE-bench Verified dalam sumber yang tersedia. Jadi, untuk codebase internasional, stack bahasa campuran, atau lingkungan pengembangan yang tidak sepenuhnya berbahasa Inggris, skor ini bisa menjadi petunjuk awal — bukan pengganti uji coba langsung.

Hal yang tidak selalu terlihat dari tabel benchmark

Claude Opus 4.7 tidak hanya diposisikan lewat skor. VentureBeat menyebut rilis ini sebagai model bahasa besar terkuat Anthropic yang tersedia secara publik sejauh ini. [1] ALM Corp juga menempatkan Opus 4.7 sebagai model Opus yang tersedia umum untuk workflow coding, agen, dokumen, dan vision yang menuntut kemampuan tinggi. [

6]

Dalam praktik, beberapa fitur produk bisa sama pentingnya dengan skor benchmark:

- Context window: LLM-Stats menyebut context window 1 juta token. [

5]

- Vision: LLM-Stats menyebut pemrosesan vision dengan resolusi 3,3 kali lebih tinggi. [

5]

- Effort level: LLM-Stats dan ALM Corp menyebut level effort baru, yaitu

xhigh. [5][

6]

- Tokenizer: ALM Corp mencatat adanya tokenizer yang diperbarui, yang dapat membuat jumlah token lebih tinggi untuk input yang sama. [

6]

Bagi tim yang menghitung biaya, latensi, dan kualitas output, poin-poin ini tidak boleh dianggap catatan kaki. Perubahan tokenizer, misalnya, perlu diuji sebelum migrasi karena dapat mengubah asumsi soal pemakaian token dan anggaran. [6]

Cara membacanya untuk keputusan tim

Untuk workflow coding: gunakan SWE-bench Verified sebagai pembanding publik pertama. Angka 87,6% adalah yang paling kuat dukungan sumbernya di sini. [4][

5]

Untuk workflow agen: jangan hanya melihat SWE-bench. Pertimbangkan juga positioning model untuk tugas coding dan agen yang lebih sulit, serta keberadaan effort level xhigh. [5][

6]

Untuk reasoning umum: GPQA relevan, tetapi angka 94,2% dalam konteks sumber ini belum terkonfirmasi seluas SWE-bench Verified. [5][

7]

Untuk codebase multibahasa: SWE-bench Multilingual 80,5% adalah sinyal yang berguna, tetapi perlu diuji lagi karena dukungan sumbernya lebih terbatas. [9]

Untuk migrasi produksi: uji bukan hanya tugas yang mirip benchmark. Cek juga panjang konteks, penggunaan tool, kasus vision, konsumsi token, dan latensi dalam kondisi nyata. Perubahan pada context window, vision, effort level, dan tokenizer bisa memengaruhi pengalaman penggunaan secara signifikan. [5][

6]

Kesimpulan

Ringkasan paling aman adalah: Claude Opus 4.7 disebut memiliki 87,6% di SWE-bench Verified, 94,2% di GPQA, dan 80,5% di SWE-bench Multilingual. [4][

5][

9] Di antara tiga angka itu, SWE-bench Verified adalah jangkar paling kuat karena didukung lebih dari satu sumber. [

4][

5]

GPQA dan SWE-bench Multilingual tetap penting sebagai sinyal tambahan, tetapi bobotnya perlu lebih hati-hati dalam kumpulan sumber ini. Untuk keputusan model yang serius, benchmark publik sebaiknya dipakai sebagai filter awal — bukan pengganti evaluasi langsung pada workflow nyata.