Ketika sebuah model LLM naik versi, biaya tidak cukup dilihat dari harga per 1 juta token. Tokenizer adalah aturan yang memecah input sebelum masuk ke model. Jika aturan ini berubah, prompt yang sama bisa dihitung sebagai jumlah token yang berbeda; sementara token adalah salah satu satuan biaya utama dalam dokumen pricing API LLM.[20][

12][

32][

2]

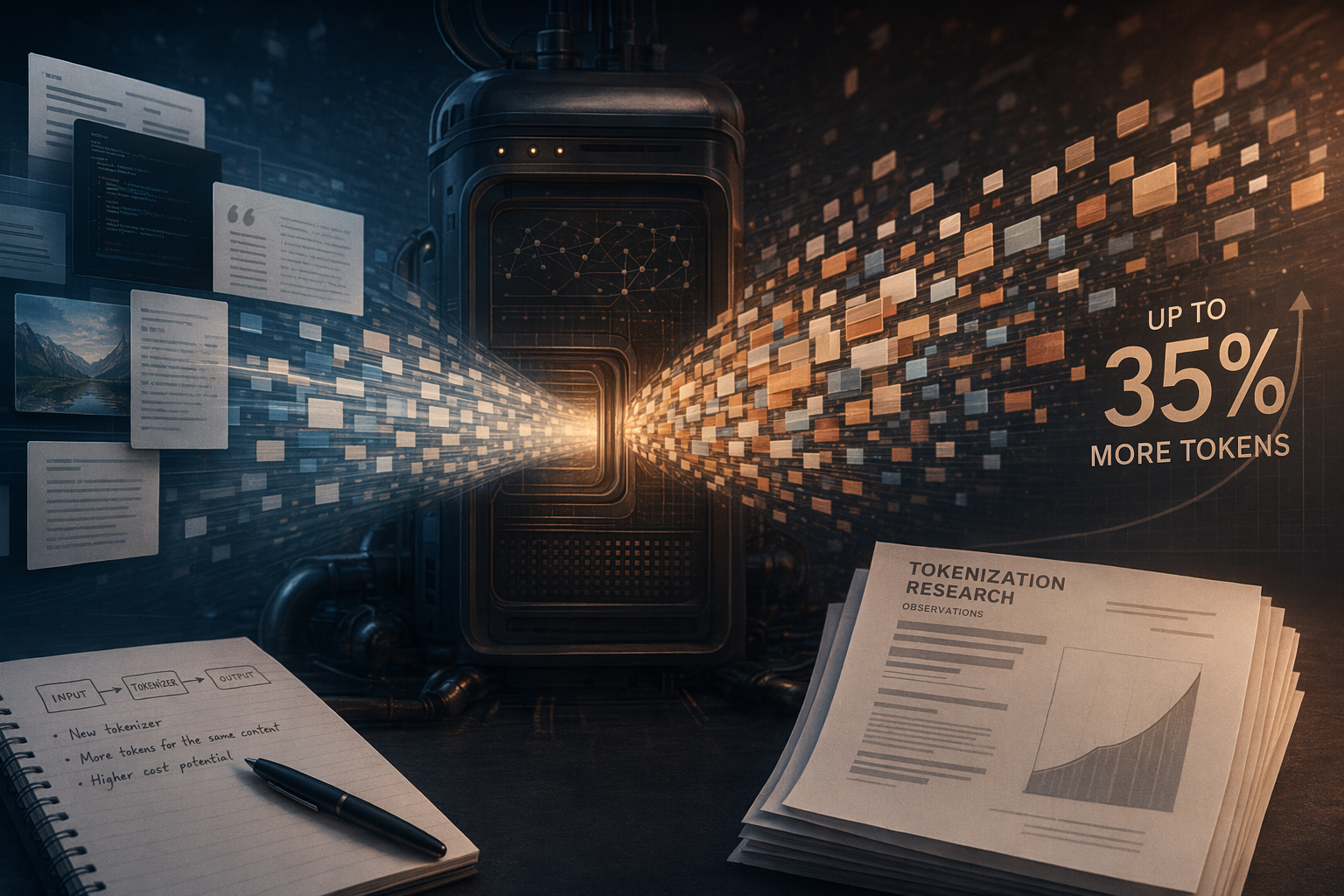

Claude Opus 4.7 adalah contoh yang terang. Anthropic menyebut tokenizer baru ini dapat memakai sekitar 1–1,35 kali jumlah token saat memproses teks dibanding model sebelumnya—hingga sekitar 35% lebih banyak, bergantung pada konten. Anthropic juga menyatakan /v1/messages/count_tokens akan mengembalikan jumlah token berbeda untuk Claude Opus 4.7 dibanding Claude Opus 4.6.[34]

Jawaban singkat: bisa lebih mahal, tetapi bukan otomatis 35%

Jika harga per input token tidak berubah, prompt yang sama tetapi terpecah menjadi lebih banyak input token akan menaikkan biaya input. Namun klaim yang tepat bukan prompt pasti 35% lebih mahal. Rentang resmi yang disebut Anthropic adalah sekitar 1–1,35 kali token, dan efeknya bervariasi menurut konten.[34]

Kenaikan token juga tidak bisa disamakan begitu saja dengan kenaikan total tagihan. Pricing Anthropic memisahkan Base Input Tokens, Cache Writes, Cache Hits, dan Output Tokens; OpenAI dan Gemini juga memiliki dokumen pricing API masing-masing.[12][

32][

2] Jadi biaya akhir tetap bergantung pada output tokens, cache hit atau write, harga model, dan struktur request yang benar-benar dikirim.[

12]

Kenapa teks yang sama bisa berubah jumlah tokennya?

Token bukan sekadar jumlah kata. Panduan tiktoken OpenAI menunjukkan bahwa teks perlu dihitung dengan encoding yang sesuai; dokumentasi Gemini juga menyatakan input dan output Gemini API ditokenisasi, termasuk teks dan gambar.[20][

1]

Artinya, menghitung biaya hanya dari jumlah karakter, jumlah kata, atau rasio kasar paling jauh hanya cocok untuk estimasi awal. Untuk estimasi yang layak dipakai mengelola biaya, gunakan angka token yang dikembalikan oleh model atau tool resmi. Kasus Opus 4.7 versus Opus 4.6 memperlihatkan persis hal ini: endpoint count_tokens dapat memberi angka berbeda untuk konten yang sama ketika tokenizernya berubah.[34]

Cara membaca angka “hingga 35%”

| Klaim yang sering muncul | Cara baca yang lebih aman |

|---|---|

| Opus 4.7 membuat semua prompt 35% lebih mahal | Terlalu menyederhanakan. Dokumen Anthropic menyebut sekitar 1–1,35 kali token dan bergantung pada konten.[ |

| Input yang sama bisa dihitung menjadi lebih banyak token | Benar. Anthropic menyatakan tokenizer baru Opus 4.7 dapat memakai lebih banyak token dan count_tokens akan berbeda dari Opus 4.6.[ |

| Perubahan tokenizer hanya soal batas konteks, bukan biaya | Tidak lengkap. Pricing API memisahkan biaya input, output, cache, dan komponen token lain; perubahan token count bisa masuk ke perhitungan biaya.[ |

| Cara terbaik adalah menguji dengan counter resmi | Benar. OpenAI menyediakan panduan token counting dan tiktoken, Gemini menyediakan count_tokens, dan Anthropic merujuk /v1/messages/count_tokens untuk kasus Opus 4.7.[ |

Rumus sederhana untuk memperkirakan dampak biaya

Untuk bagian input saja, jika harga per input token tetap, gunakan rumus sederhana ini:

tambahan biaya input ≈ (token input baru − token input lama) × harga per input token

Tetapi jangan berhenti di sana. Tagihan riil masih bisa mencakup output tokens, cache writes, cache hits, dan komponen pricing lain. Anthropic memisahkan kolom-kolom itu dalam pricing; OpenAI dan Gemini juga menerbitkan pricing API resmi untuk dicek.[12][

32][

2]

Checklist sebelum memindahkan traffic ke model baru

1. Ambil payload lengkap, bukan hanya pesan pengguna

Yang dihitung bukan selalu teks yang terlihat di kotak chat. Aplikasi bisa mengirim system prompt, konteks panjang, data tool, file, gambar, atau riwayat percakapan. Gemini menyatakan semua input dan output ditokenisasi, dan panduan OpenAI juga mencontohkan penghitungan input token untuk teks serta gambar.[1][

33]

2. Pakai token counter resmi untuk model tujuan

Untuk OpenAI, rujuk responses.input_tokens.count dan panduan tiktoken; untuk Gemini, gunakan count_tokens; untuk Anthropic, dokumen Opus 4.7 merujuk /v1/messages/count_tokens dan menyebut hasilnya berbeda dari Opus 4.6.[33][

20][

1][

34]

3. Uji beberapa jenis konten nyata

Jangan hanya mencoba satu prompt pendek. Karena Anthropic menyebut kenaikan token Opus 4.7 bergantung pada konten, ambil sampel dari payload bertrafik tinggi, konteks panjang, request paling mahal, dan pola penggunaan yang paling sering muncul.[34]

4. Masukkan selisih token ke pricing resmi

Bandingkan token input lama dan baru, lalu kalikan dengan harga input model yang relevan. Setelah itu, baru tambahkan komponen output dan cache ke model biaya total. Pricing resmi Anthropic, OpenAI, dan Gemini adalah rujukan yang sebaiknya dipakai untuk tahap ini.[12][

32][

2]

5. Putuskan apakah perlu optimasi

Jika selisihnya kecil, mungkin cukup memperbarui anggaran dan monitoring. Jika payload bertrafik tinggi naik cukup besar, pertimbangkan kompresi prompt, memangkas konteks, memperbaiki strategi cache, atau menghitung ulang biaya per request. Intinya bukan panik pada angka 35%, melainkan mengukur dampak nyata dengan counter resmi dan pricing resmi.[12][

34]

Intinya

Tokenizer baru memang bisa membuat prompt yang sama memakai lebih banyak token. Untuk Claude Opus 4.7, dokumen Anthropic menyatakan pemrosesan teks dapat memakai sekitar 1–1,35 kali token dibanding model sebelumnya, hingga sekitar 35% lebih banyak, tetapi efeknya bergantung pada konten.[34]

Pertanyaan pentingnya bukan apakah headline menyebut 35%, melainkan: berapa tambahan input token pada payload Anda, apakah perilaku output berubah, bagaimana cache dihitung, dan harga model apa yang berlaku. Jalankan token counter resmi, lalu masukkan hasilnya ke pricing resmi. Itulah cara paling andal untuk tahu apakah prompt Anda benar-benar menjadi lebih mahal.[33][

1][

34][

12][

32][

2]