AI मॉडल की दुनिया में अक्सर सबसे पहले यही पूछा जाता है: मॉडल कितना बड़ा है? Zyphra का ZAYA1-8B इसी सवाल को थोड़ा उलट देता है। इसकी अहमियत इस बात में नहीं है कि यह हर बड़े frontier AI मॉडल को निर्णायक रूप से पीछे छोड़ देता है। असली बात यह है कि Zyphra 8.4 अरब कुल पैरामीटर और सिर्फ 760 मिलियन सक्रिय पैरामीटर वाले Mixture-of-Experts मॉडल से reasoning, math और coding में मजबूत नतीजे रिपोर्ट कर रहा है [1][

6].

सरल शब्दों में कहें, ZAYA1-8B आकार की होड़ में एक और बड़ा नाम नहीं है। यह दक्षता की कहानी है: कम सक्रिय कंप्यूट के साथ कितनी उपयोगी बुद्धिमत्ता निकाली जा सकती है।

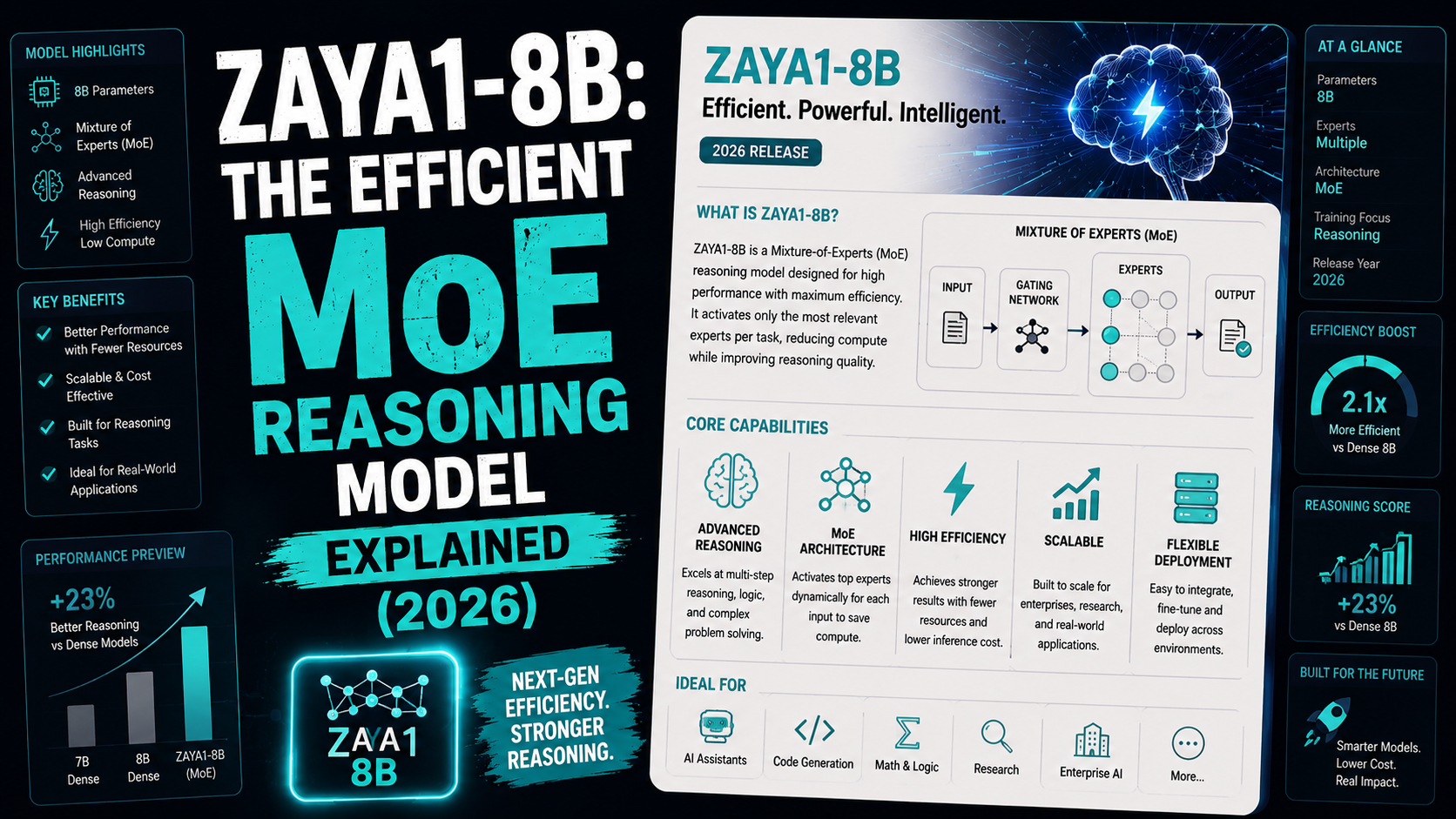

ZAYA1-8B है क्या?

ZAYA1-8B Zyphra का छोटा Mixture-of-Experts, यानी MoE, भाषा मॉडल है। Hugging Face पर इसके model card में 8.4 अरब कुल पैरामीटर, 760 मिलियन सक्रिय पैरामीटर और end-to-end Zyphra द्वारा training का उल्लेख है [6].

MoE मॉडल को समझने का आसान तरीका यह है कि इसमें कई विशेषज्ञ हिस्से होते हैं, लेकिन हर बार पूरा मॉडल सक्रिय नहीं होता। इसलिए कुल पैरामीटर और उस समय वास्तव में काम कर रहे सक्रिय पैरामीटर अलग-अलग हो सकते हैं। यही फर्क ZAYA1-8B की चर्चा के केंद्र में है: Zyphra और इसके announcement में इसे 8.4 अरब कुल पैरामीटर के बावजूद 1 अरब से कम सक्रिय पैरामीटर के साथ चलने वाला मॉडल बताया गया है [4][

6].

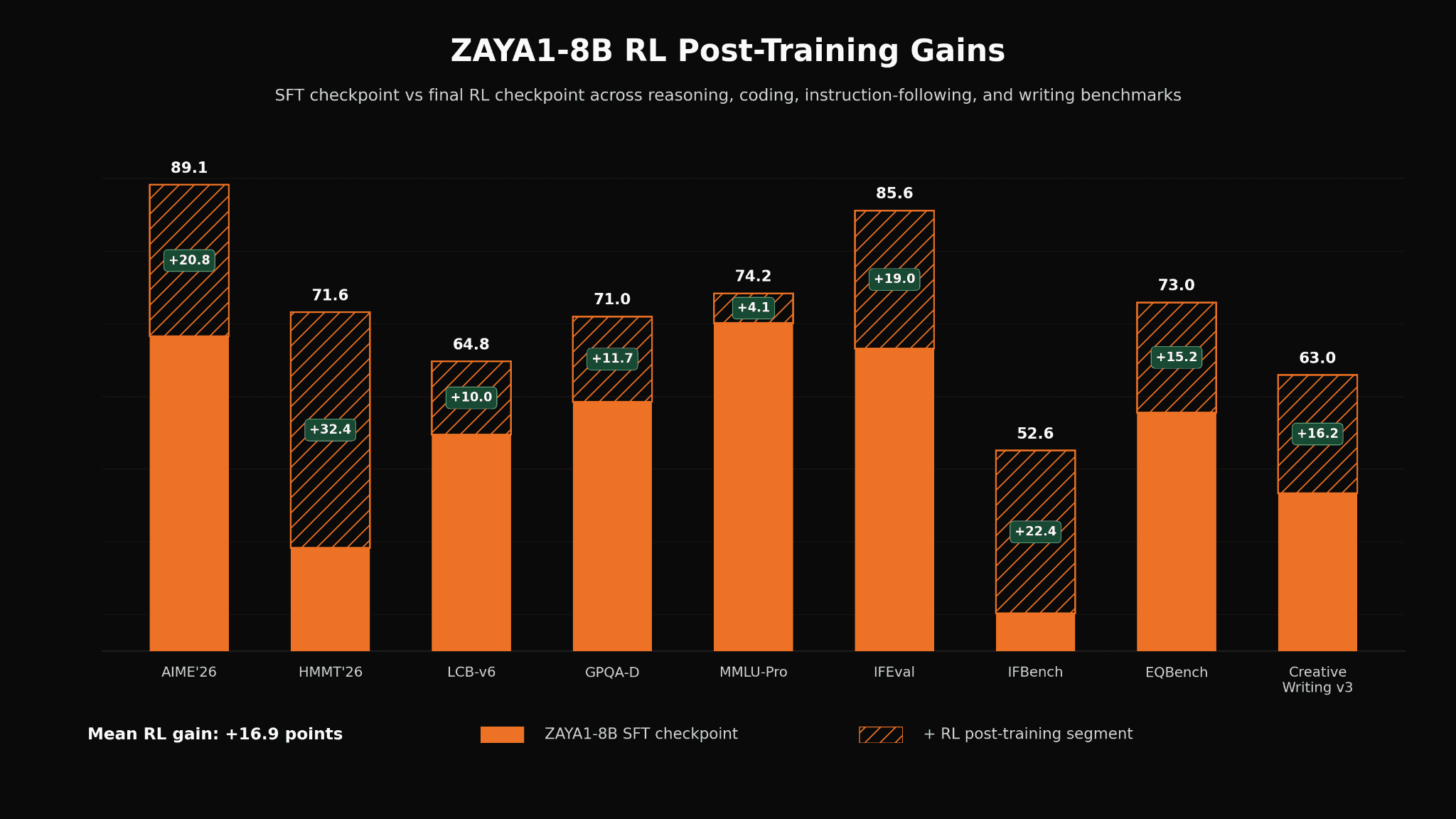

Zyphra इसे अपने parameter count के हिसाब से intelligence efficiency में आगे का कदम बताता है और इसका श्रेय architecture, pretraining और post-training choices के संयोजन को देता है [6]. Model card के अनुसार ZAYA1-8B खास तौर पर detailed long-form reasoning, mathematical tasks और coding tasks पर केंद्रित है [

6].

असली तुलना: मॉडल कितना बड़ा नहीं, सक्रिय हिस्सा कितना कामयाब

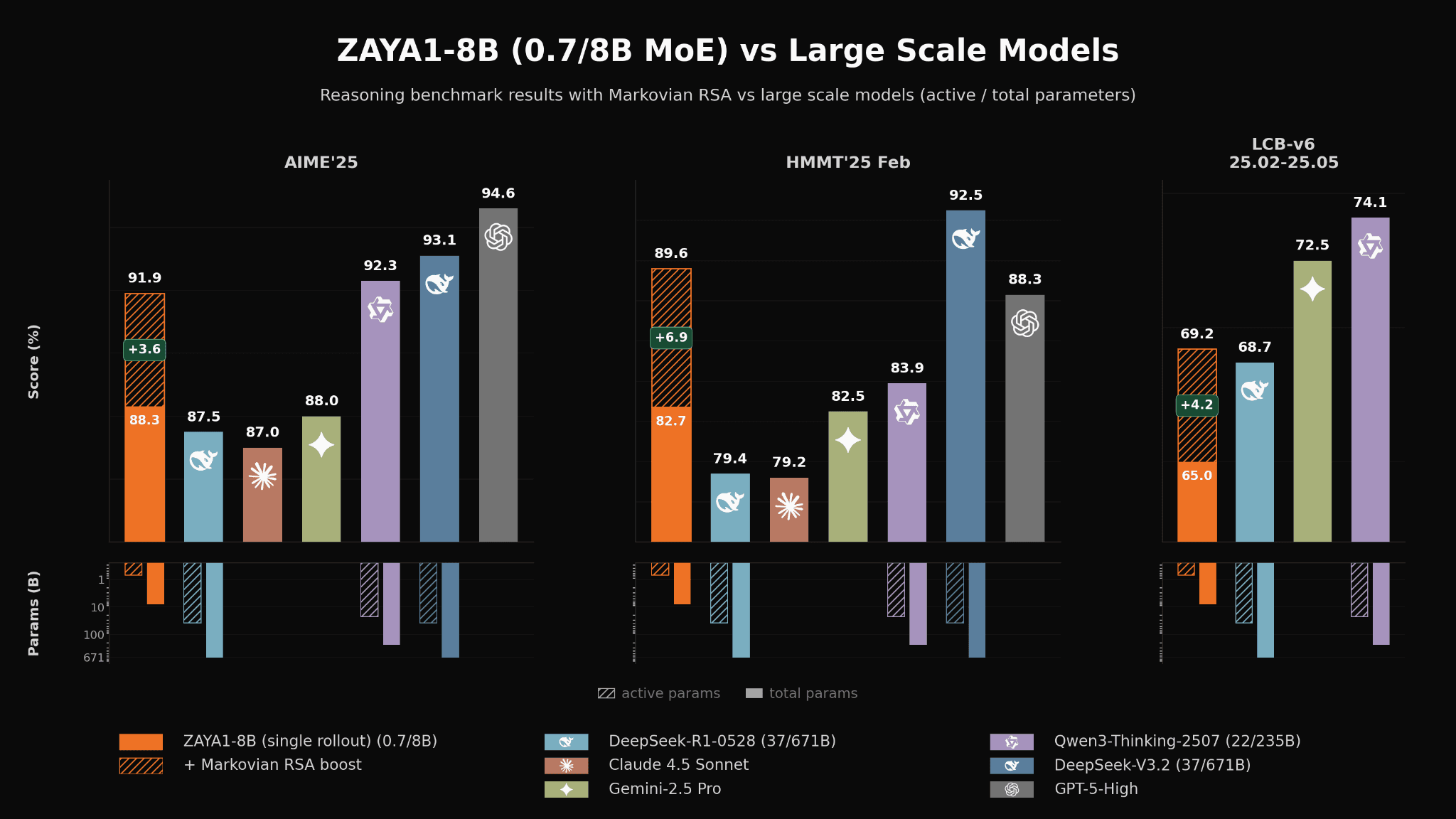

ZAYA1-8B को बड़े मॉडलों के साथ इसलिए रखा जा रहा है क्योंकि इसकी सबसे मजबूत बात raw benchmark dominance नहीं, बल्कि intelligence density है। यानी मॉडल का सक्रिय हिस्सा अपने आकार के मुकाबले कितना उपयोगी reasoning performance दे पाता है।

Zyphra का कहना है कि ZAYA1-8B complex reasoning, mathematics और coding tasks पर मजबूत प्रदर्शन करता है और कुछ mathematics तथा coding benchmarks पर काफी बड़े open-weight मॉडलों से बेहतर नतीजे देता है [1]. कंपनी के announcement में भी कहा गया है कि यह 1 अरब से कम सक्रिय पैरामीटरों के साथ complex reasoning, math और coding में substantially larger open-weight models को match या exceed करता है [

4].

अगर ये नतीजे व्यापक testing में टिकते हैं, तो संकेत यह है कि frontier-style reasoning performance सिर्फ कुल parameter count का खेल नहीं है। Inference-heavy settings में छोटे active footprints मायने रख सकते हैं, और Zyphra का model card खास तौर पर inference efficiency और छोटे size को test-time compute harnesses में उपयोगी होने की वजह बताता है [6].

AMD training वाली बात क्यों चर्चा में है

ZAYA1-8B का दूसरा बड़ा पहलू उसका training stack है। Zyphra का कहना है कि यह AMD Instinct MI300 stack पर pretrained, midtrained और supervised fine-tuned किया गया पहला MoE मॉडल है [1]. कंपनी के announcement में इसे full-stack AMD infrastructure पर trained बताया गया है [

4].

Secondary coverage ने भी इस बात को रेखांकित किया कि ZAYA1-8B Nvidia hardware के बजाय AMD silicon पर बनाया गया [3]. यहां सावधानी जरूरी है: इससे यह साबित नहीं होता कि AMD हर मामले में Nvidia से बेहतर है। समर्थित takeaway इतना ही है कि Zyphra एक alternative accelerator stack पर high-end MoE training run को credible तरीके से सामने रख रहा है [

1][

3][

4].

डेवलपर्स क्या जांच सकते हैं?

ZAYA1-8B Hugging Face पर listed है, इसलिए developers सीधे model card और release details देख सकते हैं [6]. Secondary coverage के मुताबिक यह मॉडल Hugging Face पर Apache 2.0 license के तहत उपलब्ध है और Zyphra Cloud पर serverless endpoint के रूप में भी दिया जा रहा है [

5].

यह availability अहम है, क्योंकि efficiency claims को केवल presentation देखकर नहीं, बल्कि चलाकर और benchmark करके बेहतर समझा जा सकता है। फिर भी model card की मौजूदगी अपने-आप में real-world workloads पर व्यापक स्वतंत्र validation नहीं मानी जा सकती।

क्या अभी साबित नहीं हुआ है

ZAYA1-8B को promising efficiency result की तरह पढ़ना चाहिए, frontier-model race का अंतिम फैसला मानकर नहीं। अभी उपलब्ध claims का बड़ा हिस्सा Zyphra के research post, model card, announcement या secondary write-ups से आता है [1][

4][

5][

6][

9].

Sources का जोर math, coding और long-form reasoning पर है; वे हर तरह के task में सामान्य श्रेष्ठता साबित नहीं करते [1][

6]. VentureBeat की coverage कहती है कि ZAYA1-8B ने GPT-5-High और DeepSeek-V3.2 के मुकाबले third-party benchmarks पर competitive performance दिखाई, लेकिन benchmark comparison यह साबित नहीं करता कि यह हर उपयोग में बेहतर general-purpose model है [

9].

इसलिए सबसे संतुलित निष्कर्ष यह है: ZAYA1-8B कम सक्रिय पैरामीटरों में असामान्य रूप से ऊंची reported reasoning capability समेटने की कोशिश दिखाता है। यह बात अपने-आप में महत्वपूर्ण है, भले ही यह अभी हर बड़े frontier system के मुकाबले production-level superiority साबित न करे।

निचला निष्कर्ष

ZAYA1-8B इसलिए मायने रखता है क्योंकि यह efficiency को headline बनाता है। 8.4 अरब कुल पैरामीटर, 760 मिलियन सक्रिय पैरामीटर, reported strong reasoning/math/coding performance और end-to-end AMD training के साथ यह उस धारणा को चुनौती देता है कि उपयोगी frontier-style reasoning के लिए हमेशा बहुत बड़ा active parameter budget जरूरी है [1][

4][

6].

फिलहाल सुरक्षित verdict यही है: यह महत्वपूर्ण है, करीब से देखने लायक है, लेकिन पूरी तरह स्वतंत्र रूप से settled नहीं है। अगर इसके reported results बड़े पैमाने पर reproduce होते हैं, तो ZAYA1-8B उस AI race की ओर इशारा करता है जहां raw model size जितना ही महत्व architecture, training recipes, post-training और hardware diversity का भी होगा [1][

6].