LLM model upgrade का पहला सवाल अक्सर होता है: प्रति 10 लाख tokens की दर वही है या नहीं? लेकिन लागत में एक और layer छिपी होती है—टोकनाइज़र। यही वह नियम-समूह है जो text को model में जाने से पहले tokens में तोड़ता है; OpenAI के tiktoken guide में भी सही encoding से token count निकालने की बात है, और Anthropic, OpenAI तथा Gemini जैसे providers की pricing में tokens billing unit के तौर पर आते हैं।[20][

12][

32][

2]

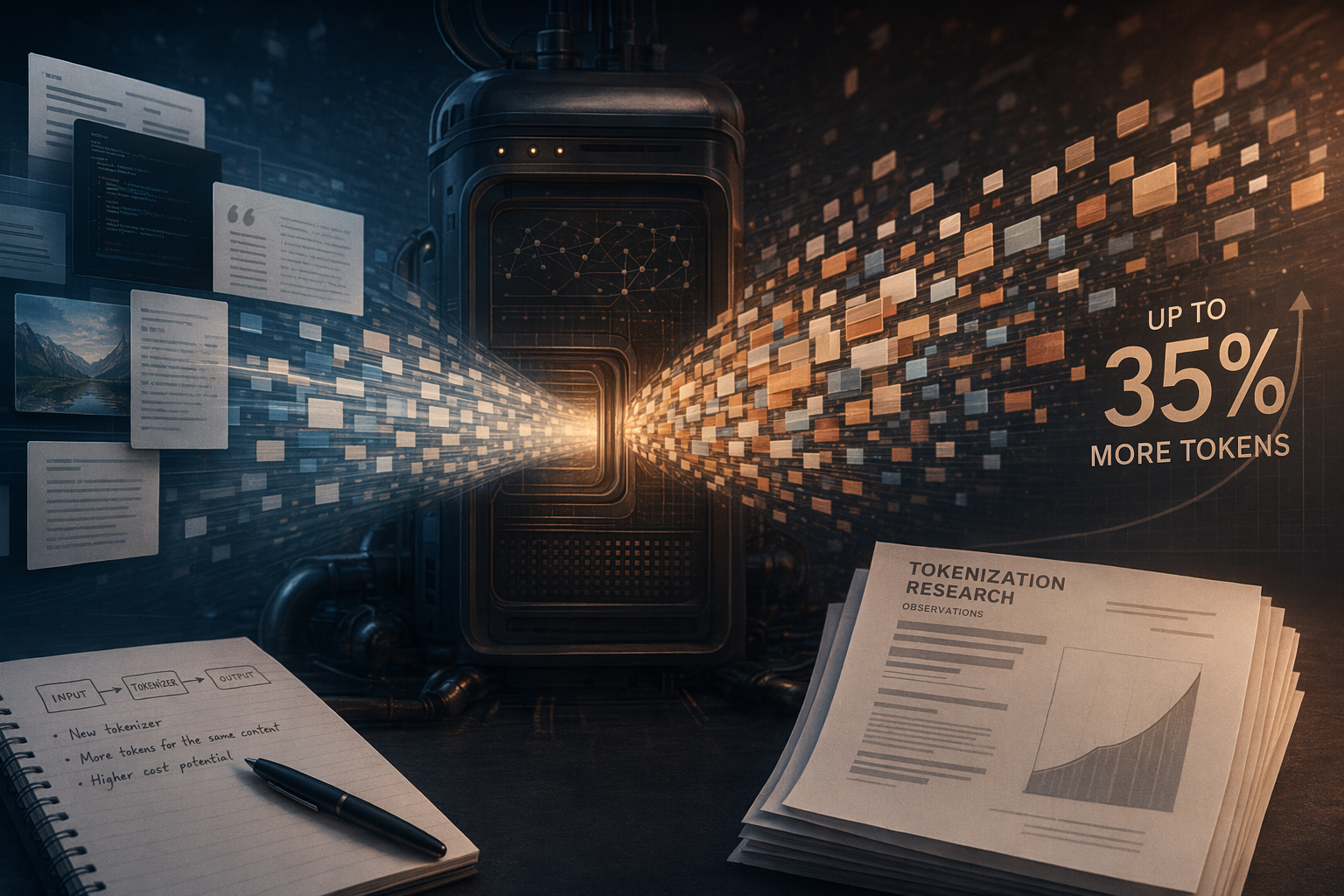

Claude Opus 4.7 इस बात का साफ उदाहरण है। Anthropic के documentation के अनुसार, Opus 4.7 का नया tokenizer text process करते समय पुराने models की तुलना में लगभग 1x से 1.35x tokens इस्तेमाल कर सकता है—यानी content के हिसाब से करीब 35% तक अधिक; Anthropic यह भी कहता है कि /v1/messages/count_tokens Opus 4.7 के लिए Opus 4.6 से अलग token count लौटाएगा।[34]

छोटा जवाब: महंगा हो सकता है, लेकिन हर prompt 35% नहीं

सबसे सही निष्कर्ष यह है: नया tokenizer एक ही prompt के input tokens बढ़ा सकता है। अगर प्रति input token rate वही रहे, तो input cost भी बढ़ सकती है। लेकिन Anthropic ने 1x–1.35x की range बताई है और साफ कहा है कि असर content पर निर्भर करेगा; इसलिए इसे हर prompt पर flat 35% बढ़ोतरी मानना गलत होगा।[34]

दूसरी जरूरी बात: token बढ़ोतरी को सीधे पूरे bill की बढ़ोतरी न मानें। Anthropic की pricing में Base Input TokensCache WritesCache HitsOutput Tokens12][

32][

2] यानी input tokens ज़्यादा होने से input हिस्सा प्रभावित हो सकता है, लेकिन final cost output tokens, cache usage, model pricing और request structure पर भी निर्भर करेगी।[

12]

एक ही prompt का token count क्यों बदल सकता है?

Token शब्दों या characters के बराबर नहीं होते। OpenAI का tiktoken guide दिखाता है कि किसी text का token count निकालने के लिए model/encoding के हिसाब से उसे tokenize करना पड़ता है; Gemini docs भी बताते हैं कि Gemini API में input और output दोनों tokenized होते हैं, जिनमें text और image जैसे inputs भी शामिल हो सकते हैं।[20][

1]

इसलिए सिर्फ word count या character count देखकर cost estimate करना मोटा अंदाजा है। Billing-grade अंदाजे के लिए target model का actual token count देखना बेहतर है। Opus 4.7 और Opus 4.6 के लिए count_tokens का अलग result आना इसी बात का संकेत है कि tokenizer बदलने से वही content अलग संख्या में गिना जा सकता है।[34]

35% वाली बात को कैसे पढ़ें?

| आम धारणा | ज्यादा सही समझ |

|---|---|

| Opus 4.7 से हर prompt 35% महंगा होगा | यह over-simplification है। Anthropic की range लगभग 1x–1.35x tokens है और यह content पर निर्भर करती है।[ |

| वही text नए model में ज़्यादा tokens बन सकता है | हाँ। Anthropic ने कहा है कि नया tokenizer text processing में ज्यादा tokens use कर सकता है और Opus 4.7 का token count Opus 4.6 से अलग होगा।[ |

| Tokenizer बदलाव सिर्फ context limit का मामला है, cost का नहीं | अधूरा। API pricing में input, output और cache जैसे token-based fields लागत को प्रभावित कर सकते हैं।[ |

| Official token counter से test करना चाहिए | सही। OpenAI token-counting guide, tiktoken guide, Gemini count_tokens और Anthropic का /v1/messages/count_tokens इसी काम के लिए उपयोगी हैं।[ |

लागत का quick math

अगर अभी सिर्फ input tokens देखें और प्रति input token price unchanged हो, तो सरल अनुमान यह है:

अतिरिक्त input cost ≈ (नए tokenizer के input tokens − पुराने tokenizer के input tokens) × input-token rate

लेकिन यह सिर्फ input हिस्से का हिसाब है। असली invoice में output tokens, cache writes, cache hits या provider-specific pricing fields भी जुड़ सकते हैं; Anthropic, OpenAI और Gemini की official pricing pages से इन्हें अलग-अलग verify करना चाहिए।[12][

32][

2]

Upgrade से पहले practical checklist

1. पूरा payload निकालें, सिर्फ user message नहीं

Production request में system instructions, long context, tool data, files, images या दूसरे inputs भी हो सकते हैं। Gemini docs के अनुसार API input और output tokenized होते हैं, और OpenAI token-counting guide text plus image input का उदाहरण भी देता है।[1][

33]

2. Target model का official counter इस्तेमाल करें

OpenAI responses.input_tokens.count guide और tiktoken instructions देता है; Gemini के पास count_tokens है; Anthropic ने Opus 4.7 documentation में /v1/messages/count_tokens का उल्लेख किया है और बताया है कि Opus 4.7 का count Opus 4.6 से अलग होगा।[33][

20][

1][

34]

3. अलग-अलग content type sample करें

एक छोटी test prompt काफी नहीं है। क्योंकि Anthropic के अनुसार token increase content के हिसाब से बदलता है, इसलिए high-traffic payloads, long-context requests, महंगे workflows और सबसे common request patterns को अलग-अलग compare करें।[34]

4. Token delta को official pricing में डालें

पहले पुराने और नए model का input token count compare करें। फिर संबंधित provider की official pricing से input cost difference निकालें। उसके बाद output, cache और बाकी fields जोड़कर per-request और monthly cost model update करें।[12][

32][

2]

5. नतीजे के आधार पर optimization तय करें

अगर token delta छोटा है, तो शायद budget और monitoring update करना काफी हो। अगर high-volume payloads में jump बड़ा है, तो prompt compress करना, context छोटा करना, cache strategy सुधारना या per-request cost दोबारा तय करना समझदारी होगी। मुद्दा 35% देखकर घबराना नहीं, बल्कि official counter और official pricing से असर को मापना है।[12][

34]

आखिरी बात

Claude Opus 4.7 का नया tokenizer सच में एक ही text को पुराने models की तुलना में ज्यादा tokens में map कर सकता है—Anthropic ने लगभग 1x–1.35x, यानी content के हिसाब से करीब 35% तक अधिक tokens की बात कही है।[34]

लेकिन सही सवाल यह नहीं है कि headline में 35% लिखा है या नहीं। सही सवाल है: आपके असली payload में कितने extra input tokens आ रहे हैं, output behavior कितना बदल रहा है, cache fields कैसे charge हो रहे हैं और provider की pricing आपके use case पर कैसे लागू होती है। Upgrade से पहले official token counter चलाइए, फिर official pricing लगाइए—यही prompt cost बढ़ने या न बढ़ने का भरोसेमंद तरीका है।[33][

1][

34][

12][

32][

2]