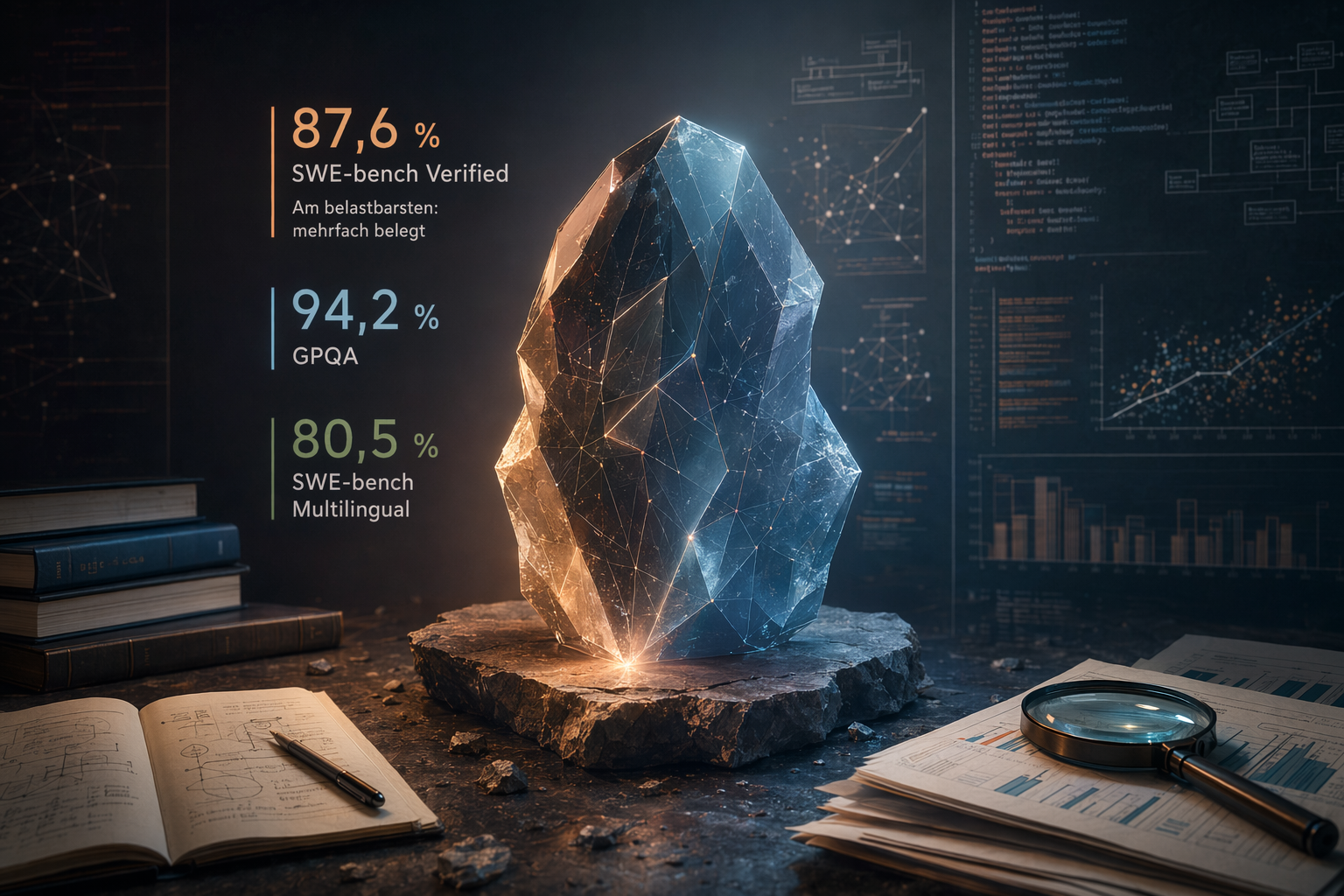

La lectura más prudente de los benchmarks públicos de Claude Opus 4.7 se resume en tres cifras: 87,6 % en SWE-bench Verified, 94,2 % en GPQA y 80,5 % en SWE-bench Multilingual. La referencia más sólida, con los datos disponibles, es SWE-bench Verified, porque aparece citada de forma explícita en más de una fuente. [4][

5]

Las cifras principales, de un vistazo

| Benchmark | Valor citado para Claude Opus 4.7 | Cómo conviene leerlo |

|---|---|---|

| SWE-bench Verified | 87,6 % | Es el ancla pública más fuerte para evaluar rendimiento en tareas de software; el dato se repite en varias fuentes. [ |

| GPQA | 94,2 % | LLM-Stats lo cita claramente, aunque en el extracto disponible de Anthropic no aparece una tabla completa de benchmarks que permita contrastarlo ahí mismo. [ |

| SWE-bench Multilingual | 80,5 % | Un resultado interesante para escenarios multilingües; una fuente lo compara con el 77,8 % de Opus 4.6, pero la base pública disponible es más estrecha. [ |

La tabla está planteada a propósito de forma conservadora: recoge solo valores que aparecen expresamente en las fuentes públicas proporcionadas. Para decidir una compra, una migración o un cambio de modelo en producción, estos números sirven como punto de partida, no como sustituto de una evaluación propia.

Por qué SWE-bench Verified es el dato más robusto

El 87,6 % en SWE-bench Verified es el benchmark mejor respaldado de Claude Opus 4.7 dentro de esta documentación. Tanto un artículo de migración y benchmarks como LLM-Stats citan el mismo valor. [4][

5]

LLM-Stats, además, presenta ese 87,6 % como una mejora de 6,8 puntos porcentuales frente a Opus 4.6. [5] ALM Corp también describe Opus 4.7 como un modelo con mejor rendimiento en flujos exigentes de programación y tareas agentivas. [

6]

Para equipos de ingeniería, esto significa que SWE-bench Verified es el mejor punto de comparación público si el caso de uso principal es código. Aun así, el dato importante no es solo el score general: hay que comprobar cómo se comporta el modelo en el repositorio real, con la cadena de herramientas real y con los criterios de aceptación del equipo.

GPQA: una señal fuerte, pero menos contrastada aquí

El resultado de 94,2 % en GPQA aparece de forma clara en LLM-Stats. [5] La página oficial de Anthropic es relevante como fuente primaria, pero el extracto disponible confirma sobre todo que los desarrolladores pueden usar

claude-opus-4-7 mediante la Claude API; en la información visible aquí no aparece una tabla completa de benchmarks que permita citar ese valor directamente desde Anthropic. [7]

Por eso, GPQA debe leerse como una señal importante, especialmente para quienes miran capacidades de razonamiento general, pero con algo más de cautela que SWE-bench Verified. Si GPQA va a pesar en una decisión de compra o migración, conviene verificarlo contra material primario adicional o reproducir pruebas internas. [5][

7]

SWE-bench Multilingual: útil para equipos globales, pero con menos respaldo

El 80,5 % en SWE-bench Multilingual es especialmente llamativo para organizaciones con bases de código, documentación o equipos de desarrollo en más de un idioma. Una fuente cita ese valor y lo compara con el 77,8 % de Opus 4.6. [9]

La cautela es clave: este dato no aparece con la misma amplitud que SWE-bench Verified en las fuentes disponibles. Para stacks internacionales, repositorios con comentarios o documentación no solo en inglés, o equipos distribuidos, es un indicio útil. Pero no debería reemplazar pruebas propias con incidencias, pull requests y documentación reales.

Lo que un benchmark no cuenta

Claude Opus 4.7 no se está posicionando solo por sus scores. VentureBeat describe el lanzamiento como el del modelo de lenguaje grande más potente que Anthropic ha publicado hasta ahora. [1] ALM Corp lo presenta como un modelo Opus disponible de forma general para programación avanzada, tareas agentivas prolongadas, razonamiento sobre documentos, comprensión visual de alta resolución y flujos profesionales. [

6]

En la práctica, hay características de producto que pueden pesar tanto como un resultado en una tabla:

- Ventana de contexto: LLM-Stats cita una ventana de 1 millón de tokens. [

5]

- Visión: LLM-Stats menciona procesamiento visual con 3,3 veces más resolución. [

5]

- Nivel de esfuerzo: LLM-Stats y ALM Corp señalan el nuevo nivel

xhigh. [5][

6]

- Tokenizador: ALM Corp advierte de un tokenizador actualizado que puede elevar el número de tokens para una misma entrada. [

6]

Estos factores pueden afectar costes, latencia y calidad de respuesta tanto como un benchmark aislado. El cambio de tokenizador merece una revisión específica antes de migrar, porque puede alterar presupuestos y supuestos de consumo. [6]

Cómo leer estos datos si estás evaluando el modelo

Si tu prioridad es programación: usa SWE-bench Verified como referencia pública inicial. El 87,6 % es el valor mejor respaldado en esta selección de fuentes. [4][

5]

Si trabajas con agentes o flujos largos: mira más allá del score. La posición del modelo para tareas difíciles de código y workflows agentivos, junto con el nivel xhigh, puede ser relevante para el rendimiento real. [5][

6]

Si te interesa razonamiento general: GPQA es una señal valiosa, pero el 94,2 % está menos ampliamente confirmado en las fuentes disponibles que el resultado de SWE-bench Verified. [5][

7]

Si tu entorno es multilingüe: el 80,5 % en SWE-bench Multilingual es un dato prometedor, aunque debe tratarse como un indicador preliminar por la menor densidad de fuentes. [9]

Si planeas una migración a producción: no pruebes solo ejercicios parecidos a benchmarks. Evalúa longitud de contexto, uso de herramientas, casos de visión, consumo de tokens, latencia y estabilidad con tareas reales. Los cambios en contexto, visión, nivel de esfuerzo y tokenizador pueden modificar bastante la experiencia final. [5][

6]

Conclusión

La síntesis más defendible con las fuentes disponibles es esta: Claude Opus 4.7 aparece públicamente con 87,6 % en SWE-bench Verified, 94,2 % en GPQA y 80,5 % en SWE-bench Multilingual. [4][

5][

9] De esos tres datos, SWE-bench Verified es el más sólido porque está citado por más de una fuente. [

4][

5]

GPQA y SWE-bench Multilingual completan el cuadro, pero conviene ponderarlos con más prudencia. Para una decisión seria de modelo, los benchmarks ayudan a hacer una primera criba; la decisión final debería depender de pruebas propias sobre los flujos de trabajo que de verdad importan.