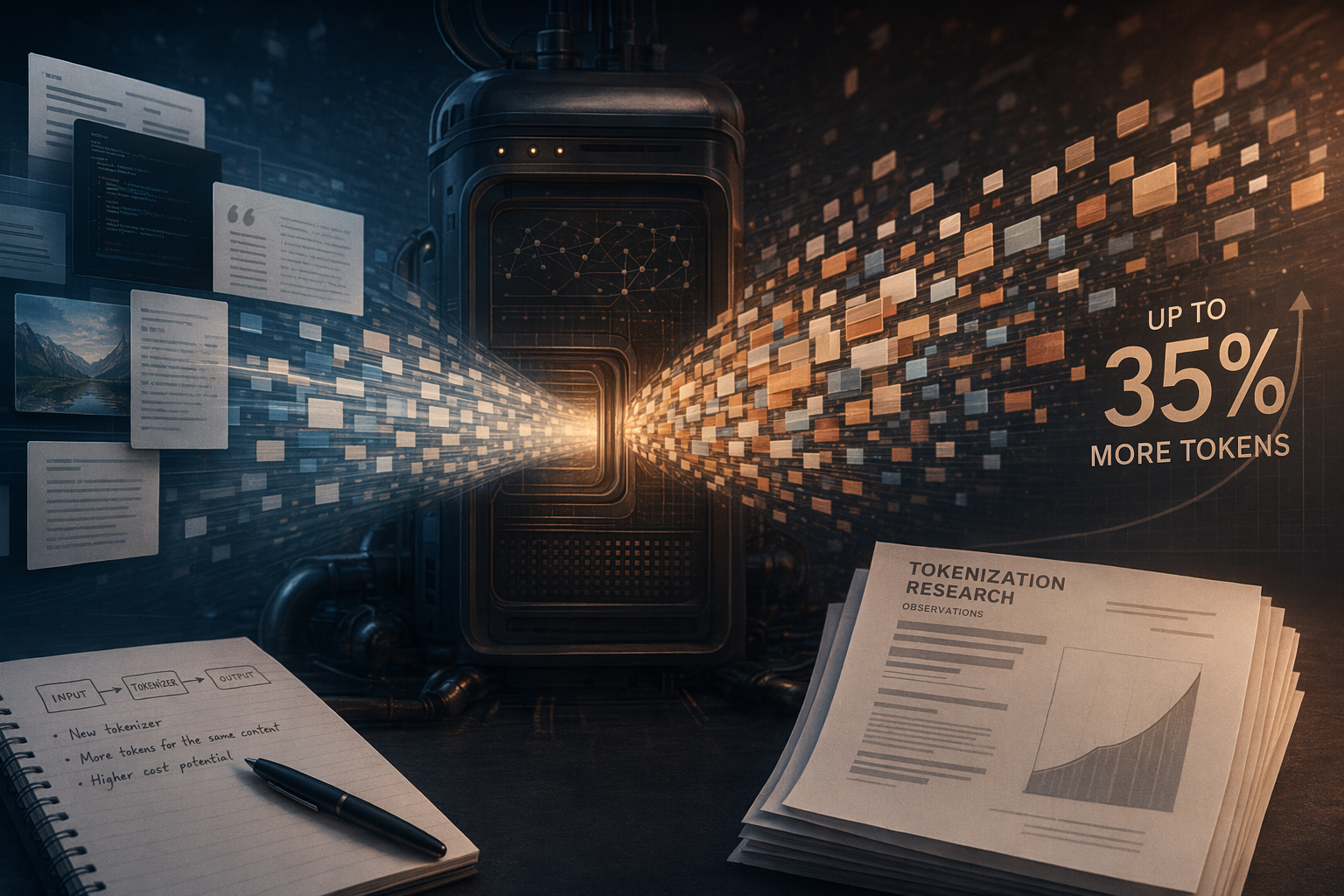

Cambiar de modelo no consiste solo en comparar el precio por millón de tokens. Antes de que un texto llegue a un LLM, pasa por un tokenizador: el conjunto de reglas que parte el texto en unidades que el modelo puede procesar. Si esas reglas cambian, el mismo prompt puede convertirse en un número distinto de tokens; y los tokens son una de las unidades básicas de coste en muchas API de modelos de lenguaje.[20][

12][

32][

2]

Claude Opus 4.7 es un buen caso para verlo. La documentación de Anthropic señala que su nuevo tokenizador puede usar aproximadamente entre 1x y 1,35x tokens al procesar texto en comparación con modelos anteriores; es decir, hasta alrededor de un 35% más, con variación según el contenido. Anthropic también indica que /v1/messages/count_tokens devolverá un número distinto de tokens para Claude Opus 4.7 que para Claude Opus 4.6.[34]

La respuesta corta: puede salir más caro, pero no siempre un 35% más

La lectura correcta es esta: si el nuevo tokenizador convierte el mismo prompt en más tokens de entrada y el precio por token de entrada se mantiene, el coste de esa parte de la petición puede subir. Pero Anthropic no dice que todos los prompts crezcan un 35%; habla de un rango aproximado de 1x a 1,35x y deja claro que depende del contenido.[34]

Tampoco conviene confundir “más tokens de entrada” con “toda la factura sube en la misma proporción”. En Claude, la página de precios separa conceptos como Base Input TokensCache WritesCache HitsOutput Tokens12][

32][

2] Por tanto, el impacto real depende de la mezcla completa: entrada, salida, caché, modelo usado y estructura de cada solicitud.[

12]

Por qué el mismo texto puede tener otra cuenta de tokens

Un token no es lo mismo que una palabra ni que un carácter. La guía de OpenAI sobre tiktoken muestra que hay que usar una codificación concreta para calcular cuántos tokens produce un texto; la documentación de Gemini también explica que las entradas y salidas de su API se tokenizan, incluidos texto e imágenes.[20][

1]

Por eso, estimar costes solo con número de palabras o caracteres sirve, como mucho, para una previsión aproximada. Para una estimación fiable hay que mirar el recuento que devuelve el modelo objetivo. El hecho de que Claude Opus 4.7 y Claude Opus 4.6 puedan devolver cifras distintas en count_tokens ilustra precisamente que un cambio de tokenizador puede alterar la medición del mismo contenido.[34]

Cómo leer el “hasta un 35%” sin caer en el alarmismo

| Lectura habitual | Lectura más precisa |

|---|---|

| “Opus 4.7 encarece todos los prompts un 35%” | Es una simplificación excesiva. El rango oficial es de aproximadamente 1x a 1,35x tokens, y varía según el contenido.[ |

| “El mismo texto puede contarse como más tokens” | Correcto. Anthropic indica que el nuevo tokenizador puede usar más tokens y que el recuento de Opus 4.7 diferirá del de Opus 4.6.[ |

| “El tokenizador solo afecta al límite de contexto, no al coste” | Incompleto. Las API suelen facturar por campos de uso como tokens de entrada, salida y caché, así que un cambio en el recuento puede afectar al cálculo de costes.[ |

| “Lo mejor es medir con el contador oficial” | Correcto. OpenAI ofrece documentación para contar tokens de entrada y guías con tiktoken; Gemini documenta count_tokens; Anthropic remite a /v1/messages/count_tokens para este caso.[ |

Una forma sencilla de estimar el impacto

Si solo se analiza la parte de entrada y el precio por token de entrada no cambia, una fórmula útil es:

coste adicional de entrada ≈ (tokens de entrada con el nuevo tokenizador − tokens de entrada con el tokenizador anterior) × precio por token de entrada

Pero esa fórmula solo cubre la entrada. La factura real puede incluir tokens de salida, escrituras o aciertos de caché y otros conceptos. Anthropic separa esos campos en su documentación de precios, y OpenAI y Gemini tienen sus propias páginas de precios para contrastar el cálculo.[12][

32][

2]

Qué medir antes de migrar a un modelo nuevo

1. Usa la carga real completa, no solo el mensaje del usuario

En producción, lo que llega al modelo puede incluir instrucciones de sistema, contexto largo, datos de herramientas, archivos, imágenes u otras entradas. Gemini indica que todas las entradas y salidas se tokenizan, y la guía de OpenAI para contar tokens muestra ejemplos con texto e imágenes.[1][

33]

2. Cuenta tokens con la herramienta oficial del proveedor

OpenAI documenta responses.input_tokens.count y ofrece guías con tiktoken; Gemini publica documentación para count_tokens; Anthropic, en el contexto de Opus 4.7, menciona /v1/messages/count_tokens y advierte que Opus 4.7 devolverá un recuento distinto al de Opus 4.6.[33][

20][

1][

34]

3. Muestrea distintos tipos de contenido

No basta con probar un prompt corto. Si el aumento depende del contenido, como indica Anthropic para Opus 4.7, conviene medir los casos que más pesan en tu producto: peticiones de alto tráfico, contextos largos, flujos caros o plantillas muy frecuentes.[34]

4. Aplica después la tabla de precios oficial

Primero compara el recuento de tokens de entrada entre el modelo anterior y el nuevo. Luego aplica la tarifa oficial del modelo correspondiente para calcular la diferencia. Por último, añade al modelo de costes los tokens de salida, caché y demás conceptos aplicables. Anthropic, OpenAI y Gemini publican documentación de precios para hacer esa comprobación.[12][

32][

2]

5. Decide si necesitas optimizar

Si la diferencia de tokens es pequeña, quizá baste con ajustar presupuestos y alertas. Si aparece un aumento importante en cargas de mucho volumen, puede tener sentido compactar prompts, recortar contexto, revisar la estrategia de caché o recalcular el coste por petición. La clave no es reaccionar al “35%” del titular, sino cuantificar el impacto con contadores y precios oficiales.[12][

34]

En resumen

Un nuevo tokenizador sí puede hacer que el mismo prompt use más tokens. En Claude Opus 4.7, Anthropic confirma que el procesamiento de texto puede requerir aproximadamente entre 1x y 1,35x tokens frente a modelos anteriores, con un máximo aproximado del 35% y variación según el contenido.[34]

La pregunta importante no es si todos los prompts subirán un 35%, sino cuánto cambian tus cargas reales: cuántos tokens de entrada adicionales aparecen, si cambia el comportamiento de salida, cómo se aplican los conceptos de caché y qué tabla de precios corresponde. Antes de migrar, mide con el contador oficial del modelo y traduce esa diferencia a coste con la documentación de precios del proveedor.[33][

1][

34][

12][

32][

2]